Bias Analysis and Mitigation through Protected Attribute Detection and Regard Classification

作者: Takuma Udagawa, Yang Zhao, Hiroshi Kanayama, Bishwaranjan Bhattacharjee

分类: cs.CL

发布日期: 2025-04-19 (更新: 2025-09-03)

备注: Accepted to EMNLP 2025 (Findings)

💡 一句话要点

提出一种高效的标注流程,用于分析和缓解预训练语料库中的社会偏见。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 社会偏见 大型语言模型 预训练语料库 属性检测 情感分析

📋 核心要点

- 大型语言模型易受预训练数据中社会偏见的影响,现有方法难以有效识别和缓解这些偏见。

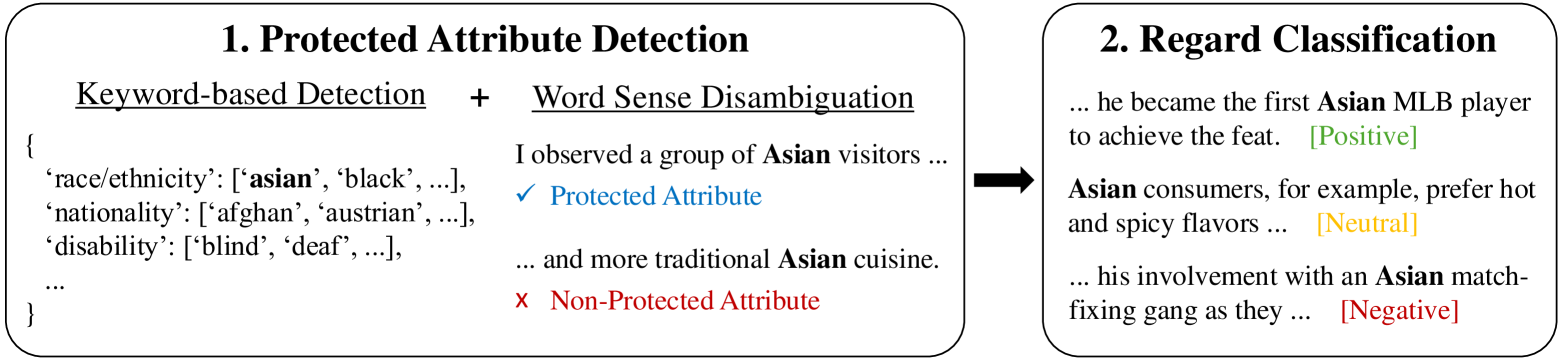

- 该论文提出一种包含受保护属性检测和评价分类的标注流程,用于分析预训练语料库中的社会偏见。

- 实验结果表明,该方法能够有效分析和缓解预训练语料库中的社会偏见,尤其是在Common Crawl数据集上。

📝 摘要(中文)

大型语言模型(LLMs)通过大规模预训练获得通用语言知识。然而,预训练数据主要由网络爬取的文本组成,其中包含不良的社会偏见,这些偏见可能被LLMs延续甚至放大。在本研究中,我们提出了一种高效且有效的标注流程,用于调查预训练语料库中的社会偏见。我们的流程包括受保护属性检测,以识别不同的群体,然后进行评价分类,以分析针对每个属性的语言极性。通过我们的实验,我们展示了我们的偏见分析和缓解措施的效果,重点关注Common Crawl作为最具代表性的预训练语料库。

🔬 方法详解

问题定义:大型语言模型(LLMs)在海量文本数据上进行预训练,虽然获得了强大的语言能力,但也继承了预训练数据中存在的社会偏见。这些偏见可能导致LLMs在生成文本时产生歧视性或不公平的输出。现有方法在检测和缓解这些偏见方面存在不足,例如效率低下、覆盖面窄等。因此,需要一种高效且全面的方法来分析和缓解预训练语料库中的社会偏见。

核心思路:该论文的核心思路是通过一个两阶段的标注流程来分析和缓解预训练语料库中的社会偏见。第一阶段是受保护属性检测,旨在识别语料库中存在的各种人口统计属性(例如,性别、种族、宗教等)。第二阶段是评价分类,旨在分析针对每个属性的语言极性(例如,正面、负面、中性)。通过结合这两个阶段的结果,可以全面了解语料库中存在的偏见类型和程度。

技术框架:该论文提出的技术框架包含两个主要模块:受保护属性检测模块和评价分类模块。受保护属性检测模块负责识别语料库中提及的各种人口统计属性。该模块可以使用现有的命名实体识别(NER)技术或自定义的规则来实现。评价分类模块负责分析针对每个属性的语言极性。该模块可以使用现有的情感分析技术或自定义的分类器来实现。整个流程首先对预训练语料进行受保护属性检测,然后对检测到的属性进行评价分类,最后根据分析结果采取相应的缓解措施。

关键创新:该论文的关键创新在于提出了一种高效且全面的标注流程,用于分析和缓解预训练语料库中的社会偏见。该流程结合了受保护属性检测和评价分类,可以全面了解语料库中存在的偏见类型和程度。此外,该论文还关注了Common Crawl作为最具代表性的预训练语料库,并展示了该方法在该数据集上的有效性。

关键设计:受保护属性检测模块可以使用基于规则的方法或基于机器学习的方法。基于规则的方法需要手动定义规则来识别不同的属性,而基于机器学习的方法则需要训练一个模型来自动识别属性。评价分类模块可以使用现有的情感分析模型,例如BERT或RoBERTa,也可以训练一个自定义的分类器。损失函数可以选择交叉熵损失或焦点损失等。具体的参数设置需要根据实际情况进行调整。

🖼️ 关键图片

📊 实验亮点

该研究通过实验验证了所提出的偏见分析和缓解措施的有效性,尤其是在Common Crawl数据集上。虽然论文中没有提供具体的性能数据,但强调了该方法能够有效地识别和缓解预训练语料库中的社会偏见,为构建更加公平和公正的AI系统奠定了基础。

🎯 应用场景

该研究成果可应用于提升大型语言模型的公平性和公正性,减少其在下游任务中产生歧视性输出的风险。例如,可以用于构建更加公平的搜索引擎、聊天机器人和文本生成系统。此外,该方法还可以用于评估和改进现有的预训练语料库,从而减少社会偏见在人工智能系统中的传播。

📄 摘要(原文)

Large language models (LLMs) acquire general linguistic knowledge from massive-scale pretraining. However, pretraining data mainly comprised of web-crawled texts contain undesirable social biases which can be perpetuated or even amplified by LLMs. In this study, we propose an efficient yet effective annotation pipeline to investigate social biases in the pretraining corpora. Our pipeline consists of protected attribute detection to identify diverse demographics, followed by regard classification to analyze the language polarity towards each attribute. Through our experiments, we demonstrate the effect of our bias analysis and mitigation measures, focusing on Common Crawl as the most representative pretraining corpus.