LogicTree: Structured Proof Exploration for Coherent and Rigorous Logical Reasoning with Large Language Models

作者: Kang He, Kaushik Roy

分类: cs.CL, cs.AI, cs.LG

发布日期: 2025-04-18 (更新: 2025-09-15)

备注: EMNLP 2025 Main Conference

💡 一句话要点

LogicTree:用于大语言模型连贯严谨逻辑推理的结构化证明探索框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 逻辑推理 大语言模型 证明探索 结构化推理 算法引导搜索

📋 核心要点

- 现有LLM在复杂逻辑推理中面临挑战,难以系统探索证明过程并维持逻辑连贯性,尤其是在前提空间大的任务中。

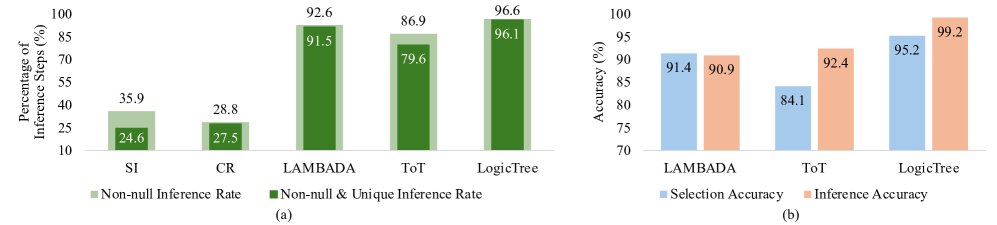

- LogicTree通过算法引导搜索自动化结构化证明探索,结合缓存机制利用历史知识,并将前提搜索分解为线性过程。

- 实验表明,LogicTree在多个数据集上显著提升了证明准确率,优于CoT和ToT,并且能有效提升GPT-4o等模型的性能。

📝 摘要(中文)

大型语言模型(LLM)在各个领域展现了卓越的多步推理能力。然而,LLM在复杂的逻辑推理中仍然面临独特的挑战,因为(1)证明寻找需要系统的探索和逻辑连贯性的维护,以及(2)在具有大量前提空间的任务中,搜索正确的前提组合在每个推理步骤中都具有内在的挑战性。为了解决这个问题,我们提出了LogicTree,这是一个推理时模块化框架,采用算法引导搜索来自动化结构化证明探索并确保逻辑连贯性。为了超越思维树(ToT),我们将缓存机制融入LogicTree,以实现对历史知识的有效利用,防止推理停滞并最小化冗余。此外,我们通过将其分解为线性过程来解决前提搜索的组合复杂性。改进后的前提选择将后续推理限制为每步最多一次推导,从而增强了推理粒度并强制执行严格的逐步推理。此外,我们引入了两种无需LLM的启发式方法来进行前提优先级排序,从而实现战略性证明搜索。在五个数据集上的实验结果表明,LogicTree能够优化推理时计算,从而实现更高的证明准确率,在使用GPT-4o时,分别超过了思维链(CoT)和ToT,平均增益分别为23.6%和12.5%。此外,在LogicTree中,GPT-4o的性能平均超过o3-mini 7.6%。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在复杂逻辑推理中面临的挑战,具体来说,是如何在庞大的前提空间中找到正确的推理路径,并保证推理过程的逻辑连贯性。现有方法,如CoT和ToT,在面对复杂逻辑推理时,缺乏有效的探索机制,容易陷入局部最优或产生冗余推理。

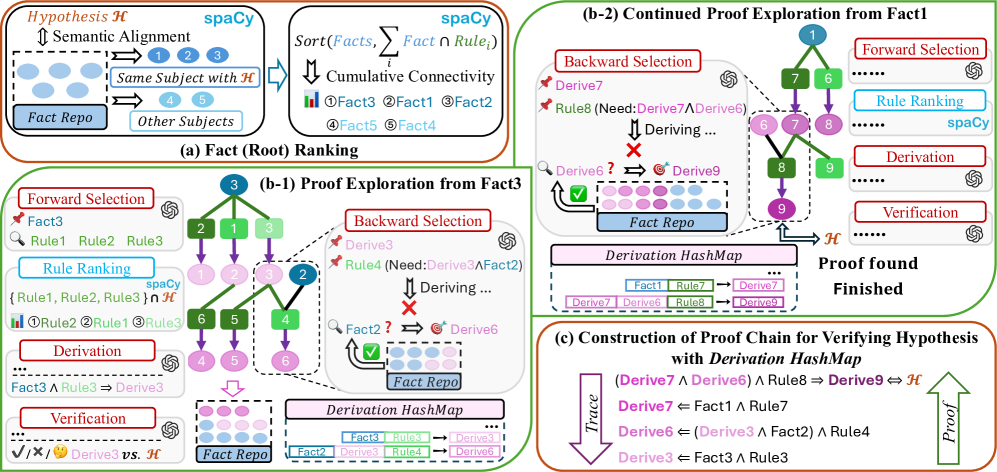

核心思路:LogicTree的核心思路是采用结构化的证明探索方法,通过算法引导搜索,自动化地寻找推理路径。它借鉴了树搜索的思想,但通过引入缓存机制和线性化的前提选择过程,提高了搜索效率和推理的连贯性。这种设计旨在克服传统方法在复杂逻辑推理中的局限性。

技术框架:LogicTree是一个推理时模块化框架,主要包含以下几个模块:1) 算法引导的搜索模块,负责探索可能的推理路径;2) 缓存模块,用于存储和重用历史知识,避免重复推理;3) 线性化的前提选择模块,将复杂的前提搜索分解为线性过程,降低计算复杂度;4) LLM推理模块,基于选定的前提进行推理;5) 启发式优先级排序模块,用于指导搜索方向。整体流程是,从初始状态开始,通过算法引导搜索,选择合适的前提,利用LLM进行推理,并将结果存储在缓存中。重复这个过程,直到找到证明或达到最大搜索步数。

关键创新:LogicTree的关键创新在于:1) 结构化的证明探索方法,通过算法引导搜索,提高了推理效率和准确性;2) 缓存机制,有效利用历史知识,避免重复推理;3) 线性化的前提选择过程,降低了计算复杂度;4) LLM-free的启发式优先级排序,指导搜索方向。与现有方法相比,LogicTree更加系统化和高效,能够更好地应对复杂逻辑推理任务。

关键设计:LogicTree的关键设计包括:1) 缓存机制的具体实现,例如缓存的大小、替换策略等;2) 线性化前提选择的具体方法,例如如何将复杂的前提搜索分解为线性过程;3) 启发式优先级排序的具体策略,例如如何根据前提的特征进行排序;4) 搜索算法的选择,例如深度优先搜索、广度优先搜索等。论文中可能没有详细描述这些细节,但这些都是影响LogicTree性能的关键因素。

🖼️ 关键图片

📊 实验亮点

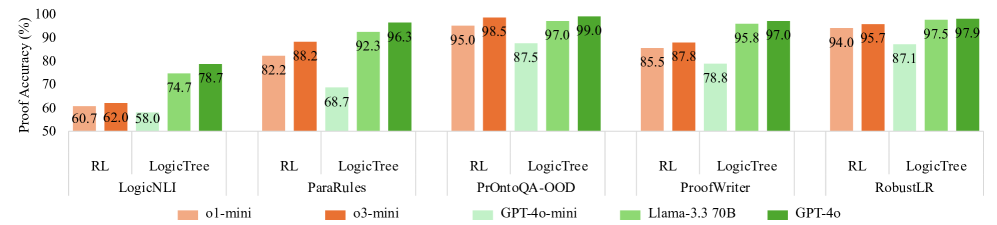

实验结果表明,LogicTree在五个数据集上显著提升了证明准确率。例如,在使用GPT-4o时,LogicTree分别超过了CoT和ToT,平均增益分别为23.6%和12.5%。此外,在LogicTree框架下,GPT-4o的性能平均超过o3-mini 7.6%。这些结果表明,LogicTree能够有效提升LLM在复杂逻辑推理任务中的性能。

🎯 应用场景

LogicTree具有广泛的应用前景,可应用于数学定理证明、程序验证、知识图谱推理、智能问答等领域。它能够提高LLM在复杂逻辑推理任务中的性能,使其在需要严谨推理的场景中发挥更大的作用。未来,LogicTree可以进一步扩展到其他推理任务,并与其他技术相结合,例如符号推理、神经推理等,以构建更加强大的推理系统。

📄 摘要(原文)

Large language models (LLMs) have achieved remarkable multi-step reasoning capabilities across various domains. However, LLMs still face distinct challenges in complex logical reasoning, as (1) proof-finding requires systematic exploration and the maintenance of logical coherence and (2) searching the right combination of premises at each reasoning step is inherently challenging in tasks with large premise space. To address this, we propose LogicTree, an inference-time modular framework employing algorithm-guided search to automate structured proof exploration and ensure logical coherence. Advancing beyond tree-of-thought (ToT), we incorporate caching mechanism into LogicTree to enable effective utilization of historical knowledge, preventing reasoning stagnation and minimizing redundancy. Furthermore, we address the combinatorial complexity of premise search by decomposing it into a linear process. The refined premise selection restricts subsequent inference to at most one derivation per step, enhancing reasoning granularity and enforcing strict step-by-step reasoning. Additionally, we introduce two LLM-free heuristics for premise prioritization, enabling strategic proof search. Experimental results on five datasets demonstrate that LogicTree optimally scales inference-time computation to achieve higher proof accuracy, surpassing chain-of-thought (CoT) and ToT with average gains of 23.6% and 12.5%, respectively, on GPT-4o. Moreover, within LogicTree, GPT-4o outperforms o3-mini by 7.6% on average.