CoT-RAG: Integrating Chain of Thought and Retrieval-Augmented Generation to Enhance Reasoning in Large Language Models

作者: Feiyang Li, Peng Fang, Zhan Shi, Arijit Khan, Fang Wang, Weihao Wang, Xin Zhang, Yongjian Cui

分类: cs.CL, cs.AI

发布日期: 2025-04-18 (更新: 2025-09-10)

💡 一句话要点

提出CoT-RAG以解决大语言模型推理可靠性不足问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 链式推理 知识图 检索增强生成 大语言模型 推理能力 自然语言处理 智能问答 自动化推理

📋 核心要点

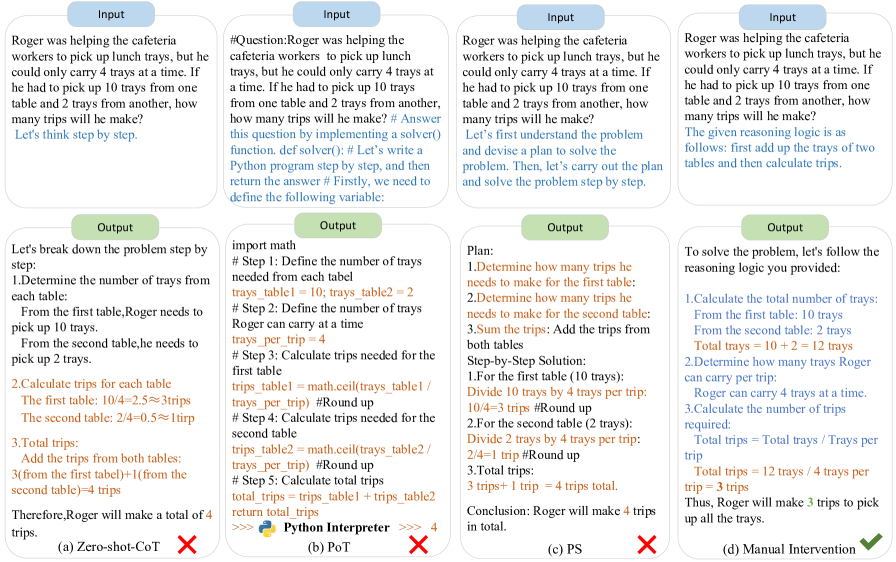

- 现有方法在推理链的可靠性上存在不足,且自然语言提示的推理性能低于代码提示。

- 论文提出CoT-RAG框架,通过知识图和检索增强生成技术,提升推理的可信度和有效性。

- 在九个公共数据集上,CoT-RAG的准确率提升幅度达到4.0%至44.3%,显示出显著的性能改进。

📝 摘要(中文)

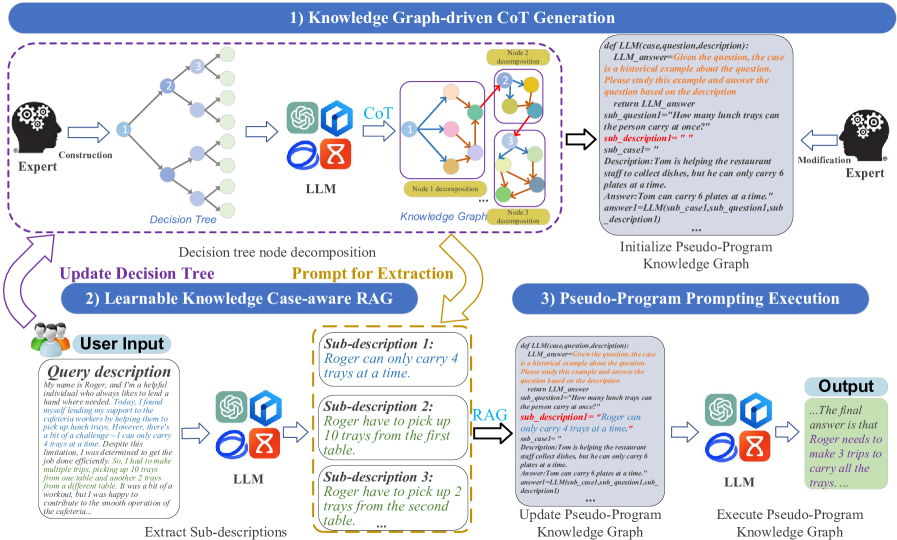

链式推理(CoT)提升了大语言模型(LLMs)在复杂任务上的表现,但存在两个主要限制:依赖LLM生成的推理链时缺乏可靠性,以及自然语言提示的推理性能低于代码提示。为了解决这些问题,本文提出了CoT-RAG,一个新颖的推理框架,包含三个关键设计:知识图驱动的CoT生成、可学习的知识案例感知RAG,以及伪程序提示执行。对九个公共数据集的评估显示,与最先进的方法相比,准确率提升幅度在4.0%到44.3%之间。此外,在四个特定领域的数据集上的测试也展现了卓越的准确性和高效执行,突显了其实际应用性和可扩展性。

🔬 方法详解

问题定义:本文旨在解决大语言模型在复杂推理任务中存在的可靠性不足和推理性能低下的问题,尤其是在自然语言提示下的表现不佳。

核心思路:CoT-RAG框架通过结合知识图和检索增强生成(RAG)技术,提升了推理链的生成质量和可信度,使得模型能够更有效地处理复杂推理任务。

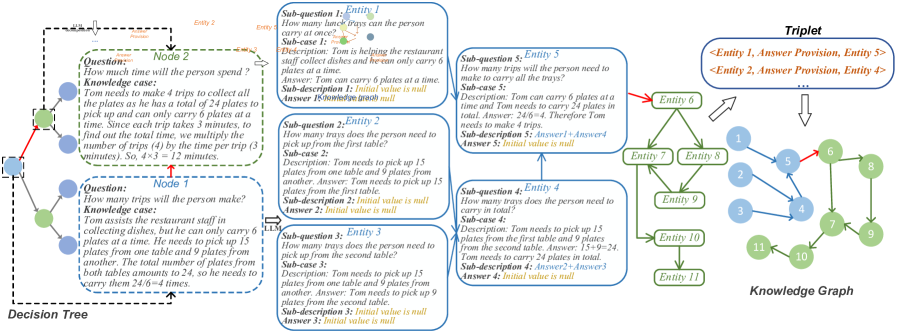

技术框架:该框架主要包括三个模块:知识图驱动的CoT生成模块、可学习的知识案例感知RAG模块,以及伪程序提示执行模块,形成一个完整的推理流程。

关键创新:最重要的创新在于将知识图与RAG相结合,增强了模型在生成推理链时的知识基础,从而提高了推理的逻辑性和准确性。

关键设计:在设计中,知识图用于调节推理链的生成,RAG模块则负责检索相关的子案例和描述,伪程序提示则引导模型以更严谨的逻辑执行推理任务。

🖼️ 关键图片

📊 实验亮点

在九个公共数据集的评估中,CoT-RAG的准确率相比最先进的方法提升了4.0%至44.3%。此外,在四个特定领域的数据集上,模型展现了卓越的准确性和高效的执行能力,证明了其在实际应用中的有效性。

🎯 应用场景

该研究的潜在应用领域包括智能问答系统、自动化推理工具以及教育领域的智能辅导系统。通过提升大语言模型的推理能力,CoT-RAG能够在复杂任务中提供更准确的答案,具有广泛的实际价值和未来影响。

📄 摘要(原文)

Chain-of-thought (CoT) reasoning boosts large language models' (LLMs) performance on complex tasks but faces two key limitations: a lack of reliability when solely relying on LLM-generated reasoning chains and lower reasoning performance from natural language prompts compared with code prompts. To address these issues, we propose CoT-RAG, a novel reasoning framework with three key designs: (i) Knowledge Graph-driven CoT Generation, featuring knowledge graphs to modulate reasoning chain generation of LLMs, thereby enhancing reasoning credibility; (ii) Learnable Knowledge Case-aware RAG, which incorporates retrieval-augmented generation (RAG) into knowledge graphs to retrieve relevant sub-cases and sub-descriptions, providing LLMs with learnable information; (iii) Pseudo Program Prompting Execution, which promotes greater logical rigor by guiding LLMs to execute reasoning tasks as pseudo-programs. Evaluations on nine public datasets spanning three reasoning tasks reveal significant accuracy gains-ranging from 4.0% to 44.3%-over state-of-the-art methods. Furthermore, tests on four domain-specific datasets demonstrate exceptional accuracy and efficient execution, underscoring its practical applicability and scalability. Our code and data are available at https: //github.com/hustlfy123/CoT-RAG.