Accommodate Knowledge Conflicts in Retrieval-augmented LLMs: Towards Robust Response Generation in the Wild

作者: Jiatai Wang, Zhiwei Xu, Di Jin, Xuewen Yang, Tao Li

分类: cs.CL, cs.AI

发布日期: 2025-04-17 (更新: 2025-11-16)

💡 一句话要点

提出Swin-VIB框架,解决检索增强LLM中知识冲突导致的响应不确定性问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 检索增强LLM 知识冲突 变分信息瓶颈 Swin Transformer 信息过滤

📋 核心要点

- 现有检索增强LLM易受知识冲突影响,导致响应不确定和可靠性下降,源于错误或过时信息。

- 论文提出Swin-VIB框架,通过变分信息瓶颈模型适应检索信息差异,提升LLM在冲突环境下的响应能力。

- 实验表明,Swin-VIB在多项选择题准确率上优于基线,开放问答的EM值提升至少11.14%。

📝 摘要(中文)

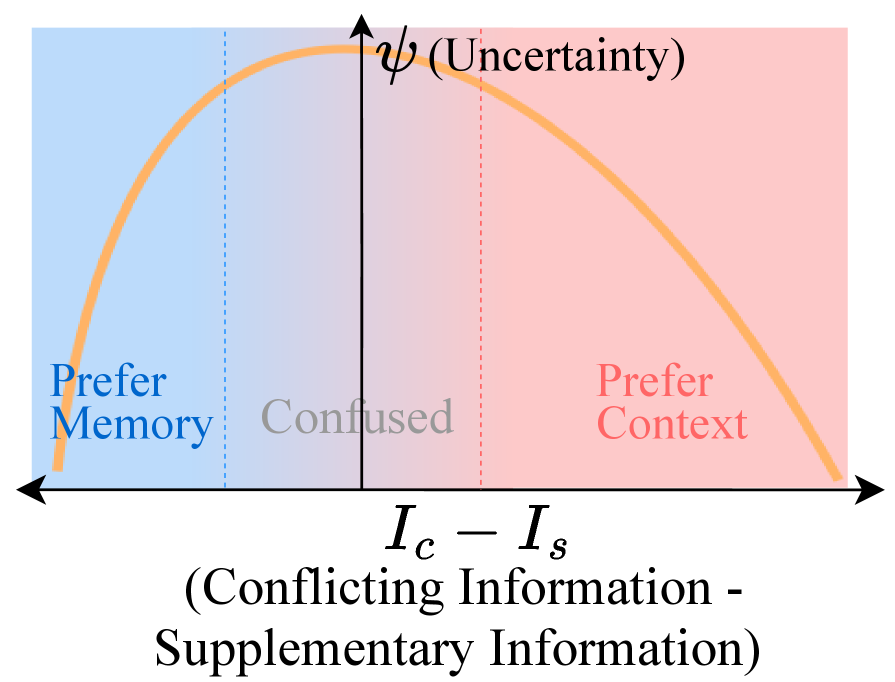

大型语言模型(LLM)的普及显著推动了智能系统的发展。然而,LLM经常面临内部记忆与检索到的外部信息之间的知识冲突,这些冲突源于错误信息、偏见或过时知识,从而损害了响应的可靠性,并给决策带来不确定性。本文从信息论的角度分析了LLM如何处理知识冲突,发现当冲突和补充信息表现出显著差异时,LLM能够自信地解决其偏好,并减轻响应生成过程中的不确定性。当这种差异模糊时,LLM对其生成结果会产生相当大的不确定性。基于此,我们提出了一种名为Swin-VIB的新框架,该框架集成了变分信息瓶颈模型流水线,以适应检索到的信息差异,从而即使在冲突环境中也能促进LLM的稳健响应生成。大量实验证实了我们的理论分析,并证明了Swin-VIB的性能。值得注意的是,Swin-VIB在多项选择任务的准确性方面优于所有竞争基线,同时在开放式问答任务中,EM值至少提高了11.14%。

🔬 方法详解

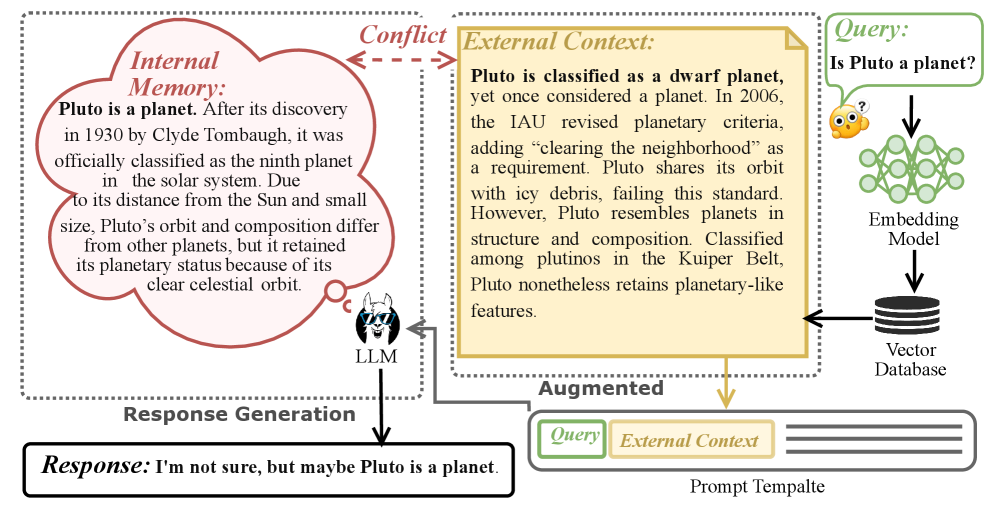

问题定义:论文旨在解决检索增强的LLM在面对知识冲突时,生成不准确或不可靠响应的问题。现有的检索增强方法没有充分考虑内部知识与外部检索信息之间的冲突,导致LLM在生成响应时面临不确定性,降低了其在实际应用中的可靠性。

核心思路:论文的核心思路是利用变分信息瓶颈(VIB)模型来区分和处理冲突信息。通过VIB,模型能够学习到检索信息中与生成任务最相关且一致的部分,从而过滤掉冲突或噪声信息,降低LLM生成响应时的不确定性。这种方法旨在使LLM更加关注可靠的信息来源,从而提高响应的准确性和鲁棒性。

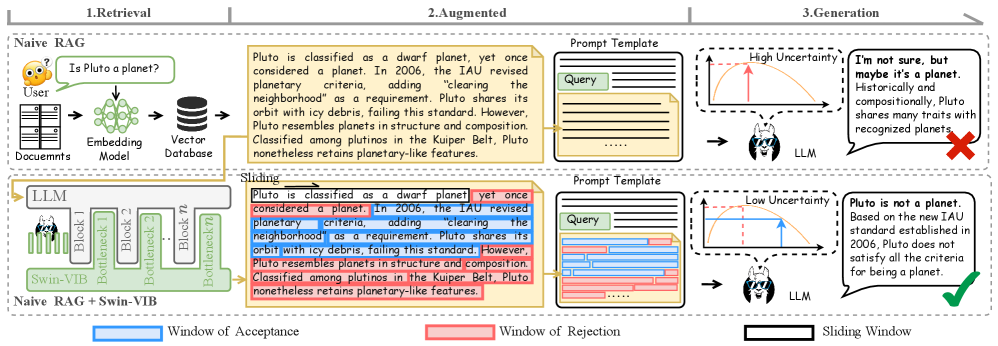

技术框架:Swin-VIB框架包含以下主要模块:1) 信息检索模块,用于从外部知识库检索相关信息;2) 冲突检测模块,用于识别检索信息与LLM内部知识之间的冲突;3) Swin Transformer编码器,用于对检索到的信息进行编码,提取特征;4) 变分信息瓶颈(VIB)模块,用于学习信息瓶颈,过滤掉不相关或冲突的信息;5) LLM生成模块,利用过滤后的信息生成最终响应。整个流程旨在使LLM在生成响应时更加关注可靠的信息,从而提高响应的准确性和鲁棒性。

关键创新:该论文的关键创新在于将变分信息瓶颈(VIB)模型引入到检索增强的LLM框架中,用于处理知识冲突。与传统的检索增强方法不同,Swin-VIB能够显式地建模和处理信息之间的冲突,从而提高LLM在复杂和不确定环境下的适应能力。此外,使用Swin Transformer作为编码器,增强了模型对上下文信息的理解能力。

关键设计:Swin-VIB框架的关键设计包括:1) 使用Swin Transformer作为编码器,以捕捉检索信息的上下文关系;2) 使用变分信息瓶颈(VIB)模型,通过最小化互信息来学习信息瓶颈,从而过滤掉不相关或冲突的信息;3) 设计了特定的损失函数,鼓励模型学习到与生成任务最相关的信息表示。具体的参数设置和网络结构细节在论文中有详细描述,例如VIB模块的参数设置,Swin Transformer的层数和维度等。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Swin-VIB在多项选择任务中取得了最高的准确率,显著优于其他基线方法。在开放式问答任务中,Swin-VIB的EM值至少提高了11.14%,表明该方法能够有效提高LLM在知识冲突环境下的响应质量。这些结果验证了Swin-VIB框架的有效性和优越性。

🎯 应用场景

该研究成果可应用于智能问答系统、对话机器人、信息检索等领域。通过提高LLM在知识冲突环境下的响应准确性和鲁棒性,可以提升用户体验,减少错误信息的传播。未来,该方法可以扩展到其他类型的知识冲突场景,例如多模态信息融合、跨领域知识迁移等。

📄 摘要(原文)

The proliferation of large language models (LLMs) has significantly advanced intelligent systems. Unfortunately, LLMs often face knowledge conflicts between internal memory and retrieved external information, arising from misinformation, biases, or outdated knowledge. These conflicts undermine response reliability and introduce uncertainty in decision-making. In this work, we analyze how LLMs navigate knowledge conflicts from an information-theoretic perspective and reveal that when conflicting and supplementary information exhibit significant differences, LLMs confidently resolve their preferences and alleviate the uncertainty during their response generation. When this difference is ambiguous, LLMs experience considerable uncertainty about their generation. Based on this insight, we propose Swin-VIB, a novel framework that integrates a pipeline of variational information bottleneck models to adapt the retrieved information difference, facilitating robust response generation of LLMs even in conflicting contexts. Extensive experiments confirm our theoretical analysis and demonstrate the performance of Swin-VIB. Notably, Swin-VIB outperforms all competitive baselines in terms of the accuracy of the multiple-choice task, while improving the EM values in the open-ended QA task by at least 11.14%.