ViClaim: A Multilingual Multilabel Dataset for Automatic Claim Detection in Videos

作者: Patrick Giedemann, Pius von Däniken, Jan Deriu, Alvaro Rodrigo, Anselmo Peñas, Mark Cieliebak

分类: cs.CL

发布日期: 2025-04-17 (更新: 2025-10-10)

💡 一句话要点

ViClaim:一个用于视频自动声明检测的多语言多标签数据集

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视频声明检测 多语言数据集 多标签分类 错误信息检测 视频内容分析

📋 核心要点

- 现有错误信息检测方法主要集中于书面文本,忽略了视频转录中口语文本的复杂性,缺乏多语言和多主题的支持。

- ViClaim数据集通过提供多语言(英、德、西)和多主题的视频转录标注,为视频声明检测提供了新的资源。

- 实验表明,现有模型在ViClaim数据集上表现良好,但在跨主题泛化方面存在挑战,突显了视频声明检测的复杂性。

📝 摘要(中文)

视频内容作为一种交流和错误信息的媒介,其影响日益增长,这突显了在多语言和多主题环境中分析声明的有效工具的迫切需求。目前在错误信息检测方面的工作主要集中在书面文本上,在解决视频转录中口语文本的复杂性方面存在显著差距。我们推出了ViClaim,一个包含1,798个带注释的视频转录的数据集,涵盖三种语言(英语、德语、西班牙语)和六个主题。转录中的每个句子都标有三个与声明相关的类别:值得事实核查、不值得事实核查或观点。我们开发了一个定制的注释工具,以促进高度复杂的注释过程。使用最先进的多语言语言模型进行的实验表明,在交叉验证中表现出色(宏F1值高达0.896),但在推广到未见过的主题时,尤其是在不同领域,存在挑战。我们的研究结果突出了视频转录中声明检测的复杂性。ViClaim为推进基于视频通信的错误信息检测提供了一个强大的基础,解决了多模态分析中的一个关键差距。

🔬 方法详解

问题定义:论文旨在解决视频内容中自动声明检测的问题,特别是针对多语言和多主题的视频转录。现有方法主要集中于文本数据,忽略了视频中口语文本的复杂性,并且缺乏对多语言和多主题场景的有效支持。这导致在视频内容中识别和验证声明的准确性和效率较低。

核心思路:论文的核心思路是构建一个高质量的多语言多标签数据集ViClaim,用于训练和评估视频声明检测模型。通过提供包含多种语言和主题的标注数据,可以促进开发更鲁棒和泛化的模型,从而更好地应对视频内容中声明检测的挑战。

技术框架:ViClaim数据集的构建流程包括以下几个主要阶段:1) 视频选择:选择涵盖不同主题和语言的视频。2) 转录生成:将视频中的语音转换为文本。3) 标注:对转录中的每个句子进行标注,分为“值得事实核查”、“不值得事实核查”和“观点”三个类别。4) 数据集发布:将标注好的数据以标准格式发布,供研究人员使用。论文还开发了一个定制的注释工具来简化标注过程。

关键创新:该论文的关键创新在于构建了一个多语言多标签的视频声明检测数据集ViClaim。该数据集涵盖了三种语言(英语、德语、西班牙语)和六个主题,为研究人员提供了一个新的资源,用于开发和评估视频声明检测模型。此外,论文还开发了一个定制的注释工具,以提高标注效率和质量。

关键设计:数据集的标注方案设计了三个类别:“值得事实核查”、“不值得事实核查”和“观点”。选择这三个类别是为了区分需要进一步验证的声明、不需要验证的陈述以及主观观点。论文没有详细说明具体的模型结构或损失函数,而是侧重于数据集的构建和评估。实验部分使用了现有的多语言语言模型,并评估了它们在ViClaim数据集上的性能。

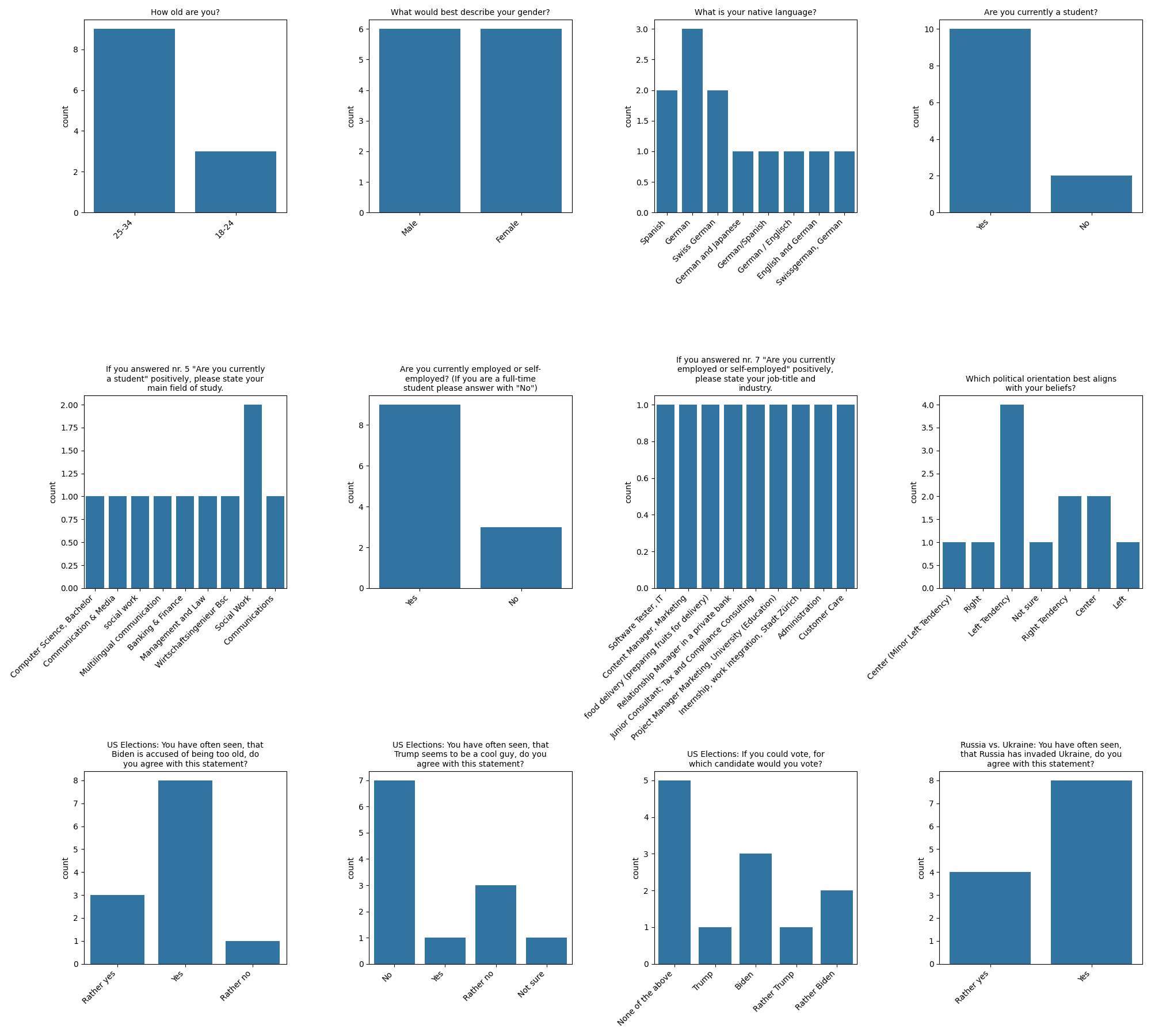

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用最先进的多语言语言模型在ViClaim数据集上进行交叉验证时,宏F1值最高可达0.896。然而,模型在推广到未见过的主题时面临挑战,尤其是在不同领域之间。这表明,虽然现有模型在特定领域表现良好,但在跨领域泛化能力方面仍有提升空间,需要进一步研究。

🎯 应用场景

该研究成果可应用于在线视频平台的内容审核、新闻媒体的事实核查、以及教育领域的批判性思维培养。通过自动检测视频中的可疑声明,可以帮助用户识别虚假信息,提高信息辨别能力,从而减少错误信息传播带来的负面影响。未来,该技术还可用于开发智能助手,帮助用户快速评估视频内容的真实性。

📄 摘要(原文)

The growing influence of video content as a medium for communication and misinformation underscores the urgent need for effective tools to analyze claims in multilingual and multi-topic settings. Existing efforts in misinformation detection largely focus on written text, leaving a significant gap in addressing the complexity of spoken text in video transcripts. We introduce ViClaim, a dataset of 1,798 annotated video transcripts across three languages (English, German, Spanish) and six topics. Each sentence in the transcripts is labeled with three claim-related categories: fact-check-worthy, fact-non-check-worthy, or opinion. We developed a custom annotation tool to facilitate the highly complex annotation process. Experiments with state-of-the-art multilingual language models demonstrate strong performance in cross-validation (macro F1 up to 0.896) but reveal challenges in generalization to unseen topics, particularly for distinct domains. Our findings highlight the complexity of claim detection in video transcripts. ViClaim offers a robust foundation for advancing misinformation detection in video-based communication, addressing a critical gap in multimodal analysis.