Identifying and Mitigating the Influence of the Prior Distribution in Large Language Models

作者: Liyi Zhang, Veniamin Veselovsky, R. Thomas McCoy, Thomas L. Griffiths

分类: cs.CL, cs.AI, cs.LG

发布日期: 2025-04-17

备注: 16 pages, 5 figures

💡 一句话要点

通过干预先验分布提升大语言模型在确定性任务中的表现

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 先验分布 确定性任务 机制可解释性 提示工程 微调 幻觉抑制

📋 核心要点

- 大语言模型在确定性任务中表现不佳,主要原因是其固有的先验知识干扰了正确答案的生成。

- 通过提示工程抑制先验知识的影响,并利用机制可解释性定位并干预模型中的先验分布。

- 实验表明,轻量级微调能够显著提升模型在受先验影响任务上的性能,且微调后误差与先验的相关性降低。

📝 摘要(中文)

大型语言模型(LLMs)有时无法正确响应确定性任务,例如计数或形成首字母缩略词,因为它们学习到的序列token的隐式先验分布会影响其响应。本文表明,在某些情况下,LLMs实际上计算了正确执行这些任务所需的信息,并确定了一些干预措施,可以使它们访问此信息以提高其性能。首先,简单地提示语言模型不要依赖其先验知识,就可以显著改善受先验影响的任务。然后,使用机制可解释性技术来定位LLM中的先验,并操纵该先验对其响应的影响程度。具体来说,可以识别与响应的先验概率相关的底层神经网络层,并且使用基本提示对这些层进行轻量级微调,可以在保留的答案上实现高性能。这些结果表明,产生正确响应所需的信息包含在模型形成的问题表示中。此外,这种微调对于受先验影响的任务更为有效,并且微调后的误差不再与先验相关。研究结果表明,可能可以定义有效的方法来操纵LLM在解决问题时对先验的依赖程度,从而可能提高LLM在由于token序列的先验概率而产生幻觉的设置中的性能。

🔬 方法详解

问题定义:大语言模型在执行如计数、缩写等确定性任务时,常常受到其预训练过程中学习到的先验分布的影响,导致输出错误或不准确的结果。现有的方法难以有效抑制这种先验偏差,使得模型在这些任务上的表现受到限制。

核心思路:论文的核心思路是,尽管LLM受到先验知识的影响,但模型内部实际上包含了正确解决问题所需的信息。通过干预模型对先验知识的依赖,使其能够更好地利用内部信息,从而提高在确定性任务上的表现。这种干预包括提示工程和模型内部的微调。

技术框架:论文主要包含以下几个阶段:1) 问题识别:识别LLM中受先验影响的任务。2) 提示工程:设计提示语,引导模型减少对先验知识的依赖。3) 机制可解释性分析:利用技术手段定位模型中与先验分布相关的网络层。4) 轻量级微调:针对识别出的网络层进行微调,以减少先验的影响。5) 性能评估:在保留数据集上评估干预后的模型性能。

关键创新:论文的关键创新在于:1) 证明了LLM在受先验影响的任务中,实际上包含了正确答案所需的信息。2) 提出了通过提示工程和轻量级微调相结合的方法,有效抑制先验知识的干扰。3) 利用机制可解释性技术,精确定位了模型中与先验分布相关的网络层,为干预提供了依据。

关键设计:1) 提示语设计:设计明确的提示语,例如“不要依赖你的先验知识”,以引导模型减少对先验的依赖。2) 微调目标:使用基本提示和正确答案对模型进行微调,目标是使模型能够更好地利用内部信息,而不是依赖先验知识。3) 微调层选择:通过机制可解释性分析,选择与先验分布相关的特定网络层进行微调,而不是对整个模型进行微调,从而降低了计算成本。

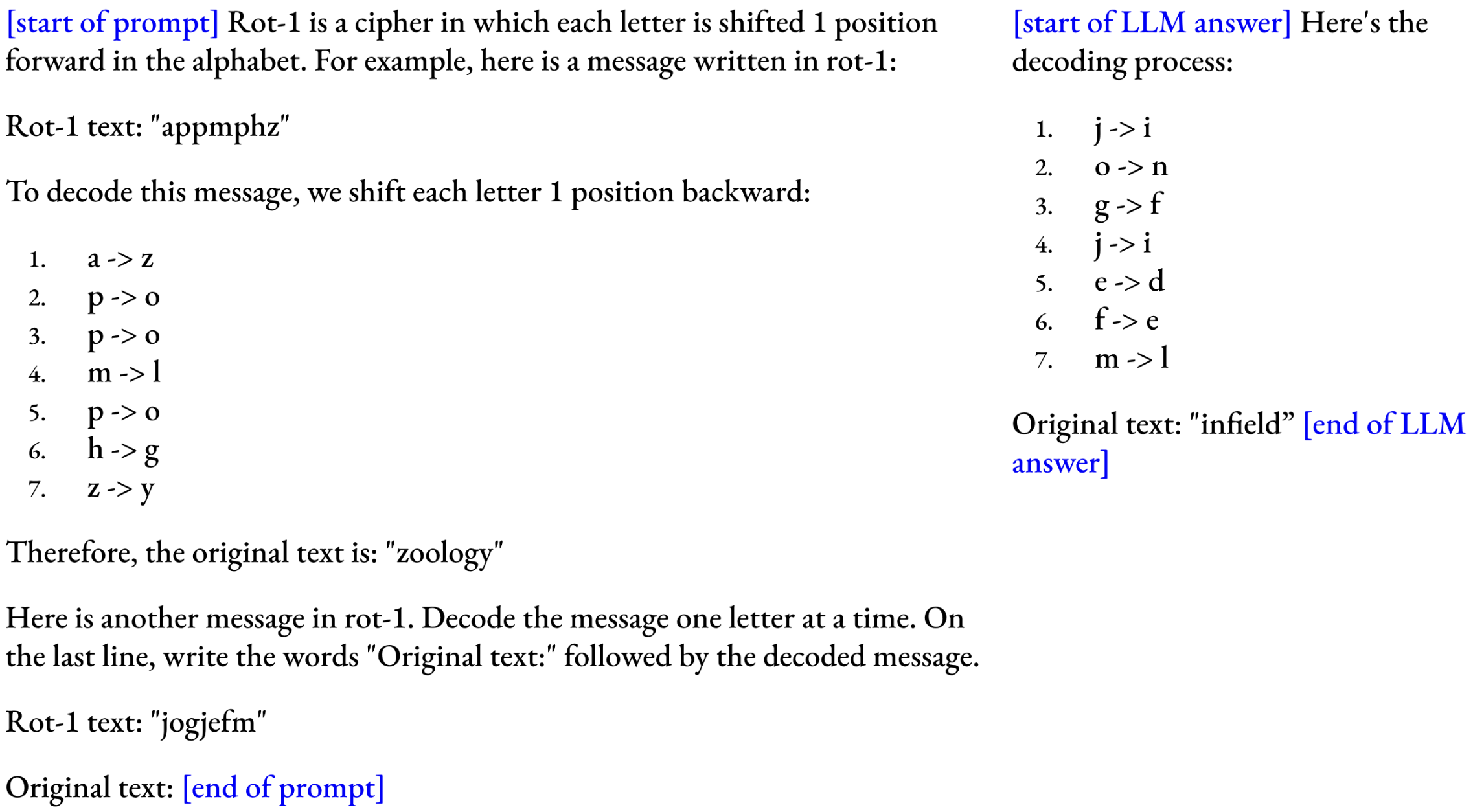

🖼️ 关键图片

📊 实验亮点

实验结果表明,简单地提示模型不要依赖先验知识就能显著提升性能。更重要的是,通过对与先验概率相关的网络层进行轻量级微调,模型在受先验影响的任务上的性能得到了显著提升,并且微调后的误差与先验的相关性降低。这表明该方法能够有效抑制先验知识的干扰,使模型更好地利用内部信息。

🎯 应用场景

该研究成果可应用于提升大语言模型在各种需要精确推理和计算的场景中的表现,例如金融分析、科学计算、代码生成等。通过减少模型对先验知识的过度依赖,可以提高其在特定领域的专业性和可靠性,减少幻觉现象,并提升用户体验。未来,该方法有望推广到其他类型的语言模型和任务中。

📄 摘要(原文)

Large language models (LLMs) sometimes fail to respond appropriately to deterministic tasks -- such as counting or forming acronyms -- because the implicit prior distribution they have learned over sequences of tokens influences their responses. In this work, we show that, in at least some cases, LLMs actually compute the information needed to perform these tasks correctly, and we identify some interventions that can allow them to access this information to improve their performance. First, we show that simply prompting the language model to not rely on its prior knowledge leads to dramatic improvements in prior-dominated tasks. We then use mechanistic interpretability techniques to localize the prior within the LLM and manipulate the extent to which that prior influences its responses. Specifically, we show that it is possible to identify layers of the underlying neural network that correlate with the prior probability of a response and that lightweight finetuning of these layers with basic prompts on prior-dominated tasks achieves high performance on held-out answers. These results suggest that the information required to produce a correct response is contained within the representations of the problems formed by the models. Furthermore, we show that this finetuning is significantly more effective for prior-dominated tasks, and that the error after finetuning is no longer correlated with the prior. Our results suggest that it may be possible to define effective methods for manipulating the extent to which LLMs rely upon their priors in solving problems, potentially increasing their performance in settings where LLMs hallucinate for reasons related to the prior probability of token sequences.