LazyReview A Dataset for Uncovering Lazy Thinking in NLP Peer Reviews

作者: Sukannya Purkayastha, Zhuang Li, Anne Lauscher, Lizhen Qu, Iryna Gurevych

分类: cs.CL

发布日期: 2025-04-15 (更新: 2025-06-03)

备注: Accepted at ACL 2025: 29 pages, 18 Figures, 15 Tables

🔗 代码/项目: GITHUB

💡 一句话要点

提出LazyReview数据集,用于检测NLP同行评审中的惰性思维。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 同行评审 惰性思维 自然语言处理 数据集构建 指令微调 大型语言模型 评审质量

📋 核心要点

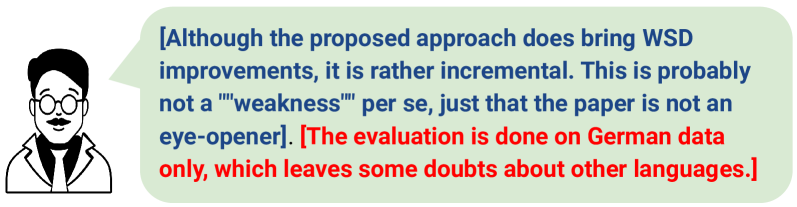

- 同行评审质量受损,源于评审员使用“惰性思维”启发式方法,但缺乏相关NLP研究和数据集。

- 构建LazyReview数据集,包含细粒度惰性思维标注的同行评审句子,用于训练检测模型。

- 实验表明,大型语言模型在零样本学习中表现不佳,但经过微调后性能显著提升10-20个百分点。

📝 摘要(中文)

同行评审是科学出版中质量控制的基石。随着工作量的增加,无意中使用“快速”启发式方法(称为惰性思维)已成为一个反复出现的问题,损害了评审质量。自动检测此类启发式方法可以帮助改进同行评审过程。然而,关于这个问题的NLP研究有限,并且没有真实世界的数据集来支持检测工具的开发。本研究介绍了LazyReview,这是一个同行评审句子数据集,标注了细粒度的惰性思维类别。分析表明,大型语言模型(LLM)难以在零样本设置中检测到这些实例。然而,基于指令的微调在我们的数据集上显著提高了10-20个性能点,突出了高质量训练数据的重要性。此外,一项对照实验表明,经过惰性思维反馈修订的评审比没有此类反馈的评审更全面和更具可操作性。我们将发布我们的数据集和增强的指南,这些指南可用于培训社区中的初级评审员。

🔬 方法详解

问题定义:论文旨在解决同行评审中存在的“惰性思维”问题,即评审员为了快速完成任务而采用的简化或不严谨的评审方式。现有方法缺乏有效的数据集和工具来检测和纠正这种惰性思维,导致评审质量下降。

核心思路:论文的核心思路是构建一个高质量的标注数据集,用于训练能够识别同行评审文本中惰性思维的模型。通过对模型进行微调,使其能够准确地检测出不同类型的惰性思维,并为评审员提供反馈,从而提高评审质量。

技术框架:该研究主要包含以下几个阶段:1) 数据收集:收集真实的同行评审文本数据。2) 标注:对评审文本进行细粒度的惰性思维标注,构建LazyReview数据集。3) 模型训练:使用大型语言模型(LLM)在LazyReview数据集上进行微调,训练惰性思维检测模型。4) 实验评估:评估模型在检测惰性思维方面的性能,并进行对照实验,验证使用惰性思维反馈对评审质量的提升效果。

关键创新:该研究的关键创新在于构建了LazyReview数据集,这是一个专门用于检测同行评审中惰性思维的数据集。该数据集包含细粒度的惰性思维类别标注,为训练高性能的惰性思维检测模型提供了基础。此外,该研究还验证了使用惰性思维反馈可以有效提高评审质量。

关键设计:该研究的关键设计包括:1) 细粒度的惰性思维类别定义,例如笼统概括、缺乏证据支持等。2) 基于指令的微调方法,利用指令提示来引导模型学习惰性思维的特征。3) 对照实验的设计,通过比较有无惰性思维反馈的评审结果,评估反馈的有效性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,大型语言模型在零样本设置下难以有效检测惰性思维,但在LazyReview数据集上进行指令微调后,性能显著提升10-20个百分点。对照实验还表明,经过惰性思维反馈修订的评审比没有反馈的评审更全面和更具可操作性,验证了该研究的实际价值。

🎯 应用场景

该研究成果可应用于改进学术出版的同行评审流程,通过自动检测和纠正评审中的惰性思维,提高评审质量和效率。此外,该数据集和相关工具可用于培训初级评审员,帮助他们避免常见的评审错误,提升评审能力。未来,该技术还可扩展到其他需要高质量反馈的领域,例如代码审查、产品评估等。

📄 摘要(原文)

Peer review is a cornerstone of quality control in scientific publishing. With the increasing workload, the unintended use of `quick' heuristics, referred to as lazy thinking, has emerged as a recurring issue compromising review quality. Automated methods to detect such heuristics can help improve the peer-reviewing process. However, there is limited NLP research on this issue, and no real-world dataset exists to support the development of detection tools. This work introduces LazyReview, a dataset of peer-review sentences annotated with fine-grained lazy thinking categories. Our analysis reveals that Large Language Models (LLMs) struggle to detect these instances in a zero-shot setting. However, instruction-based fine-tuning on our dataset significantly boosts performance by 10-20 performance points, highlighting the importance of high-quality training data. Furthermore, a controlled experiment demonstrates that reviews revised with lazy thinking feedback are more comprehensive and actionable than those written without such feedback. We will release our dataset and the enhanced guidelines that can be used to train junior reviewers in the community. (Code available here: https://github.com/UKPLab/acl2025-lazy-review)