Unchecked and Overlooked: Addressing the Checkbox Blind Spot in Large Language Models with CheckboxQA

作者: Michał Turski, Mateusz Chiliński, Łukasz Borchmann

分类: cs.CL

发布日期: 2025-04-14 (更新: 2025-04-15)

🔗 代码/项目: GITHUB

💡 一句话要点

CheckboxQA数据集:解决大语言模型在复选框理解上的盲点

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 复选框理解 大型语言模型 文档理解 问答数据集 视觉语言模型

📋 核心要点

- 大型视觉语言模型在复选框理解方面存在盲点,这在文档处理中可能导致严重错误。

- CheckboxQA数据集旨在评估和改进模型在复选框相关任务上的性能,填补现有模型的不足。

- 该数据集为推进文档理解系统提供了一个有价值的工具,对法律科技和金融等领域具有重要意义。

📝 摘要(中文)

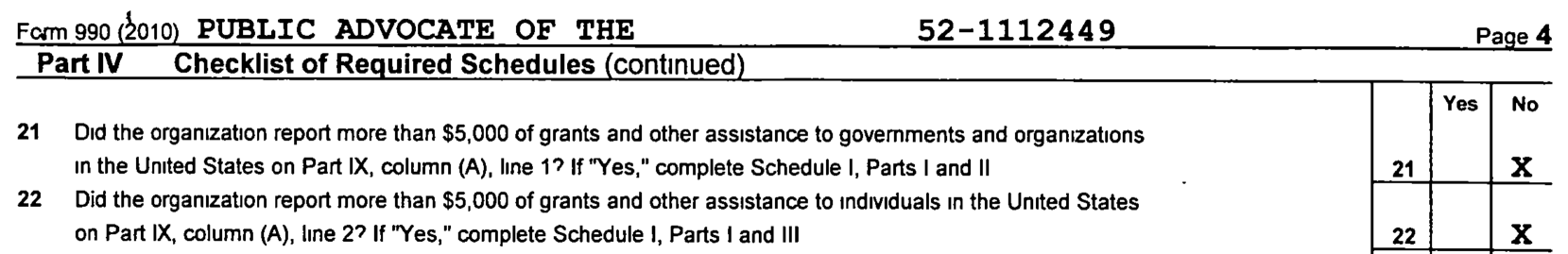

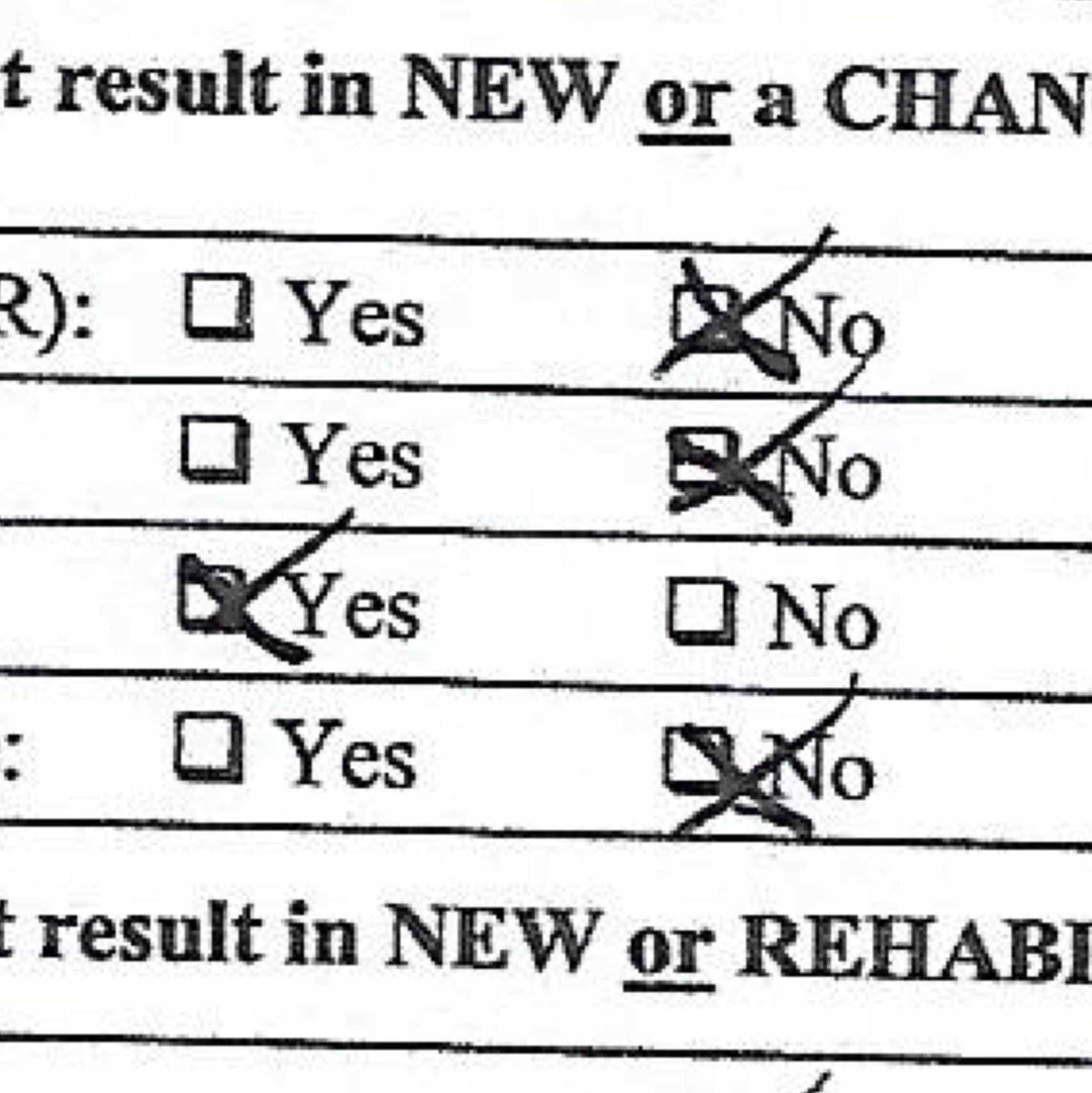

复选框在现实文档处理中至关重要,其选中与否直接影响数据提取和决策过程。尽管大型视觉语言模型在各种任务中表现出色,但它们在解释可勾选内容方面存在困难。这种挑战在法律科技和金融等行业尤为突出,因为忽略一个复选框可能导致代价高昂的监管或合同疏忽。为了解决这一问题,我们推出了CheckboxQA数据集,旨在评估和提高模型在复选框相关任务上的性能。该数据集揭示了当前模型的局限性,并为推进文档理解系统提供了一个有价值的工具,对法律科技和金融等领域的应用具有重要意义。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)在处理包含复选框的文档时存在的理解盲点。现有方法在处理此类文档时,容易忽略或错误识别复选框的状态,导致信息提取和决策过程出现偏差。尤其是在法律、金融等对准确性要求极高的领域,这种错误可能造成严重的后果。

核心思路:论文的核心思路是通过构建一个专门针对复选框理解的问答数据集(CheckboxQA),来系统性地评估和提升LLMs在此方面的能力。该数据集包含各种类型的复选框文档,并设计了相应的问答,旨在考察模型对复选框状态的识别和推理能力。通过在该数据集上训练和评估模型,可以有效暴露模型在复选框理解方面的弱点,并指导模型进行针对性的改进。

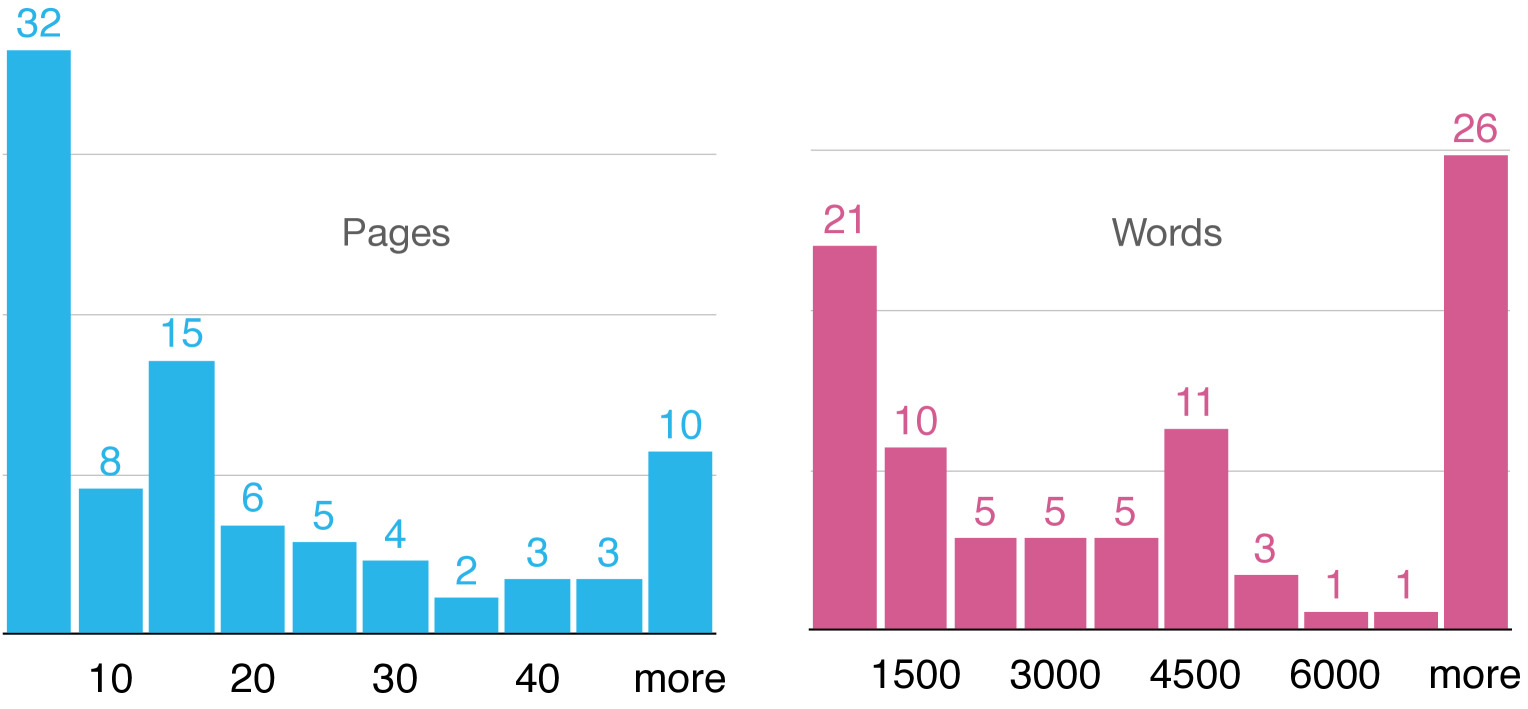

技术框架:论文主要贡献在于构建了CheckboxQA数据集,并没有提出新的模型架构。数据集的构建流程包括:1) 收集包含复选框的文档;2) 对文档进行标注,标注复选框的位置和状态;3) 基于标注信息,生成相应的问答对。问答对的设计需要覆盖各种场景,例如询问特定复选框的状态、询问满足特定条件的复选框数量等。

关键创新:论文的关键创新在于构建了一个高质量的、专门针对复选框理解的问答数据集。与现有数据集相比,CheckboxQA更加聚焦于复选框的理解,能够更有效地评估和提升模型在此方面的能力。此外,该数据集的构建过程也考虑了实际应用场景,例如法律和金融领域,使得该数据集更具有实用价值。

关键设计:CheckboxQA数据集的关键设计在于问答对的设计。问答对需要覆盖各种场景,例如询问特定复选框的状态、询问满足特定条件的复选框数量等。此外,问答对还需要具有一定的难度,能够考察模型的推理能力。论文中没有详细说明问答对的具体生成方法,但强调了问答对的多样性和难度。

🖼️ 关键图片

📊 实验亮点

论文构建了CheckboxQA数据集,揭示了现有大型视觉语言模型在复选框理解方面的局限性。该数据集为后续研究提供了一个标准化的评估平台,并为改进文档理解系统提供了有价值的资源。具体性能数据和对比基线需要在论文中查找,此处未知。

🎯 应用场景

该研究成果可应用于法律科技、金融、医疗保健等领域,提高文档处理的自动化程度和准确性。通过提升模型对复选框的理解能力,可以减少人工审核的需求,降低错误率,并提高工作效率。未来,该研究可以扩展到其他类型的文档元素,例如表格、签名等,进一步提升文档理解系统的能力。

📄 摘要(原文)

Checkboxes are critical in real-world document processing where the presence or absence of ticks directly informs data extraction and decision-making processes. Yet, despite the strong performance of Large Vision and Language Models across a wide range of tasks, they struggle with interpreting checkable content. This challenge becomes particularly pressing in industries where a single overlooked checkbox may lead to costly regulatory or contractual oversights. To address this gap, we introduce the CheckboxQA dataset, a targeted resource designed to evaluate and improve model performance on checkbox-related tasks. It reveals the limitations of current models and serves as a valuable tool for advancing document comprehension systems, with significant implications for applications in sectors such as legal tech and finance. The dataset is publicly available at: https://github.com/Snowflake-Labs/CheckboxQA