AgentA/B: Automated and Scalable Web A/BTesting with Interactive LLM Agents

作者: Dakuo Wang, Ting-Yao Hsu, Yuxuan Lu, Hansu Gu, Limeng Cui, Yaochen Xie, William Headean, Bingsheng Yao, Akash Veeragouni, Jiapeng Liu, Sreyashi Nag, Jessie Wang

分类: cs.HC, cs.CL

发布日期: 2025-04-13 (更新: 2025-09-19)

💡 一句话要点

AgentA/B:利用交互式LLM Agent实现自动化和可扩展的Web A/B测试

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: A/B测试 LLM Agent 用户行为模拟 自动化测试 Web应用 UI/UX设计 大型语言模型 交互式Agent

📋 核心要点

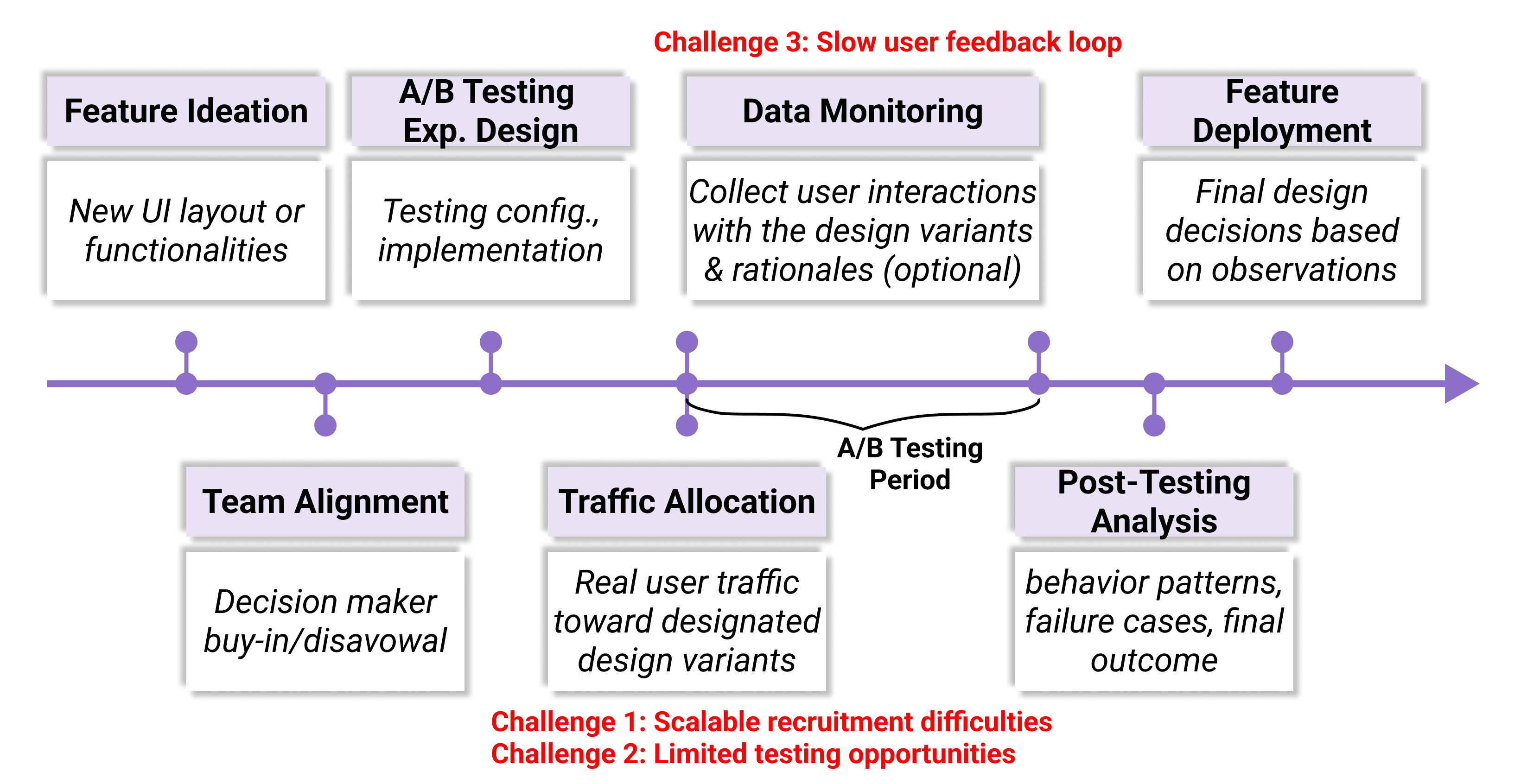

- 传统A/B测试依赖真实用户流量,耗时较长,难以快速迭代UI/UX设计。

- AgentA/B利用LLM Agent模拟用户行为,实现自动化和可扩展的A/B测试,无需真实用户参与。

- 实验表明,AgentA/B能够模拟类似人类的行为模式,为A/B测试提供了一种新的解决方案。

📝 摘要(中文)

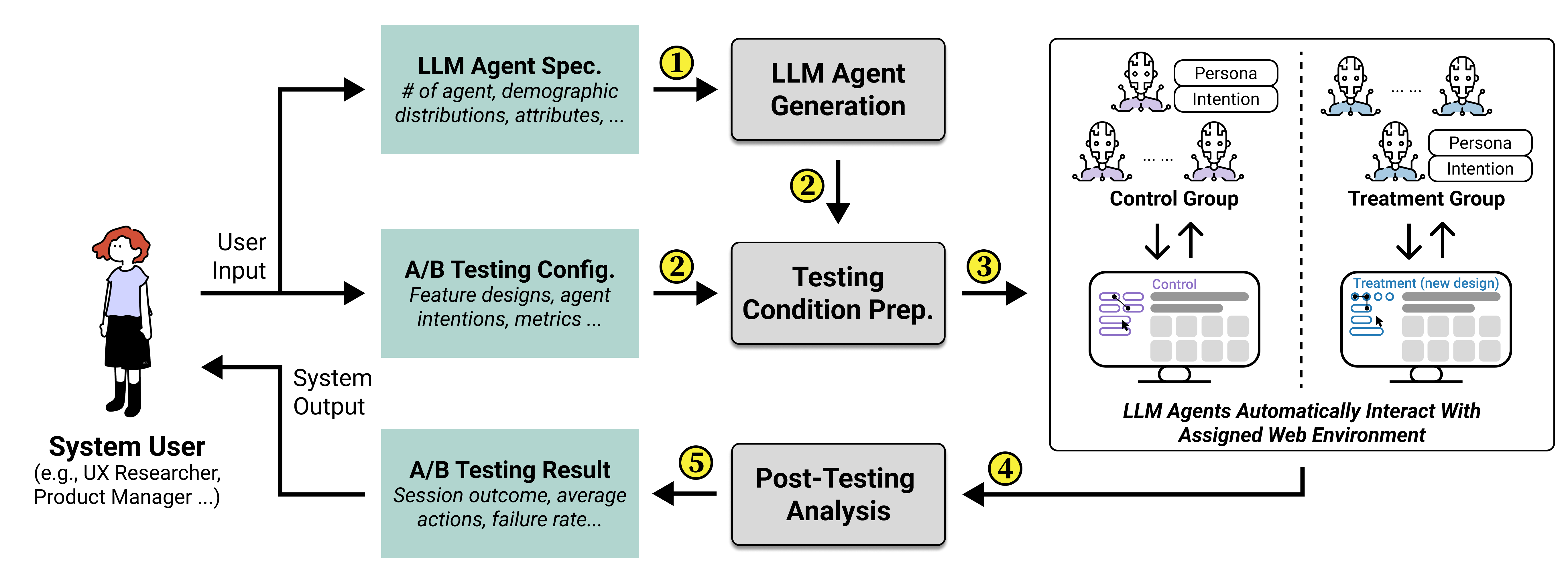

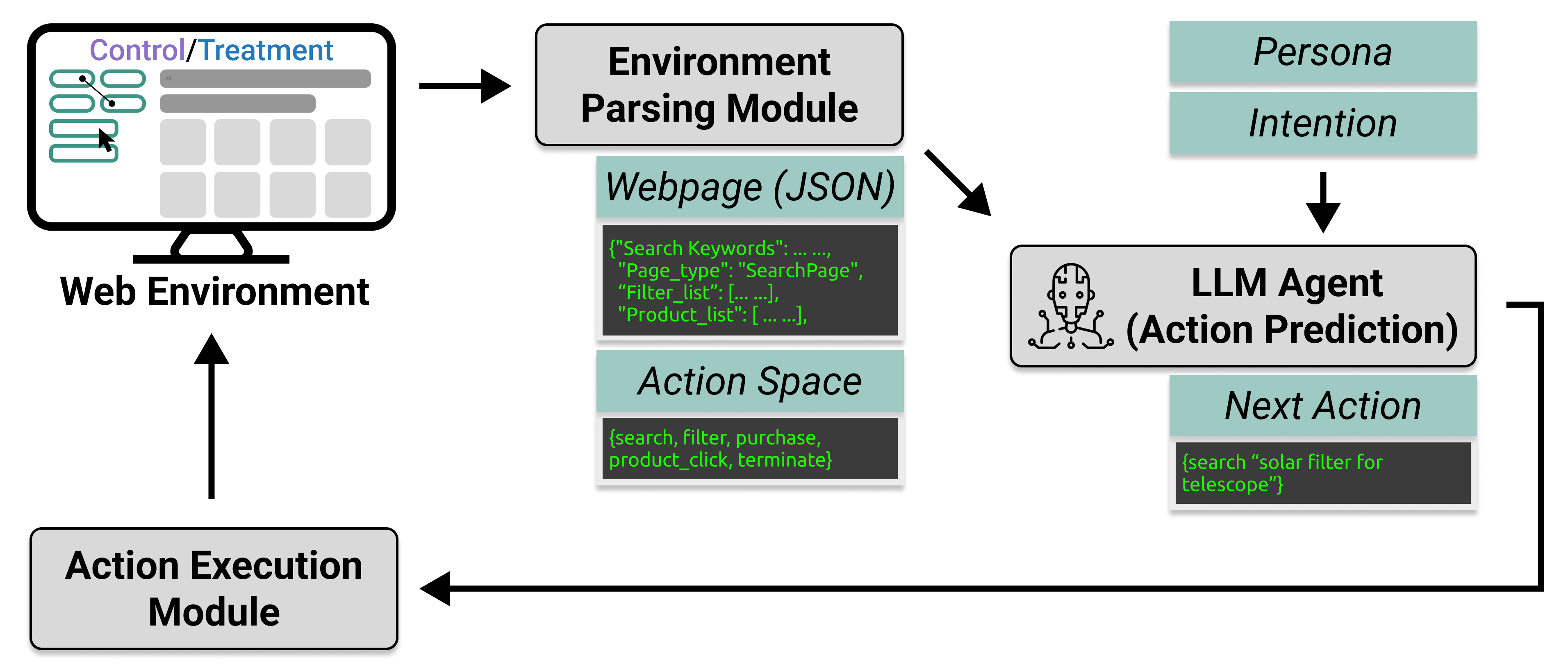

A/B测试是评估现代Web应用中UI/UX设计决策的常用方法。然而,传统的A/B测试依赖于大规模的真实用户流量以及漫长的等待时间。通过对六位经验丰富的行业从业者的访谈,我们发现了当前A/B测试工作流程中的关键瓶颈。为此,我们提出了AgentA/B,一种利用基于大型语言模型的自主Agent(LLM Agent)自动模拟用户与真实网页交互行为的新系统。AgentA/B能够以可扩展的方式部署具有不同角色的LLM Agent,每个Agent都能够导航动态网页并交互式地执行多步骤交互,如搜索、点击、过滤和购买。在一个演示性的受控实验中,我们使用AgentA/B模拟了Amazon.com上1000个LLM Agent的受试者间A/B测试,并将Agent的行为与大规模的真实人类购物行为进行了比较。我们的研究结果表明,AgentA/B可以模拟类似人类的行为模式。

🔬 方法详解

问题定义:传统A/B测试依赖于真实用户的参与,需要收集大量数据才能得出可靠的结论,这导致测试周期长、成本高。此外,对于一些低流量的页面或功能,很难进行有效的A/B测试。现有方法难以快速、低成本地评估UI/UX设计决策。

核心思路:AgentA/B的核心思路是利用LLM Agent模拟用户的行为,从而在没有真实用户参与的情况下进行A/B测试。通过赋予Agent不同的角色和目标,可以模拟不同类型的用户行为,从而评估不同UI/UX设计对不同用户群体的效果。这样可以大大缩短测试周期,降低测试成本,并提高测试效率。

技术框架:AgentA/B的整体架构包含以下几个主要模块:1) Agent管理模块:负责创建、配置和管理LLM Agent。2) 网页交互模块:负责与真实网页进行交互,包括页面加载、元素定位、点击、输入等。3) 行为模拟模块:负责根据Agent的角色和目标,生成相应的用户行为序列。4) 数据分析模块:负责收集和分析Agent的行为数据,从而评估不同UI/UX设计的优劣。

关键创新:AgentA/B最重要的技术创新点是利用LLM Agent模拟用户行为,从而实现自动化和可扩展的A/B测试。与传统的A/B测试方法相比,AgentA/B无需真实用户参与,可以大大缩短测试周期,降低测试成本,并提高测试效率。此外,AgentA/B还可以模拟不同类型的用户行为,从而更全面地评估UI/UX设计的效果。

关键设计:AgentA/B的关键设计包括:1) Agent的角色定义:定义Agent的性别、年龄、职业、兴趣等属性,从而模拟不同类型的用户。2) Agent的目标设定:设定Agent的任务目标,例如购买特定商品、浏览特定页面等。3) 行为生成策略:设计Agent的行为生成策略,例如使用强化学习、规则引擎等方法生成用户行为序列。4) 网页元素定位方法:使用XPath、CSS Selector等方法定位网页元素,从而实现与网页的交互。

🖼️ 关键图片

📊 实验亮点

AgentA/B在Amazon.com上进行了实验,模拟了1000个LLM Agent的购物行为。实验结果表明,AgentA/B能够模拟类似人类的行为模式,例如在搜索商品时会考虑价格、评价等因素,在购买商品时会选择合适的支付方式和配送地址。这些结果表明,AgentA/B可以作为一种有效的A/B测试工具,帮助开发者优化UI/UX设计。

🎯 应用场景

AgentA/B可应用于各种Web应用的UI/UX设计优化,例如电商网站、社交媒体平台、新闻网站等。它可以帮助开发者快速、低成本地评估不同设计方案的效果,从而提高用户满意度和转化率。未来,AgentA/B还可以扩展到移动应用、桌面应用等领域,为更广泛的应用场景提供A/B测试解决方案。

📄 摘要(原文)

A/B testing experiment is a widely adopted method for evaluating UI/UX design decisions in modern web applications. Yet, traditional A/B testing remains constrained by its dependence on the large-scale and live traffic of human participants, and the long time of waiting for the testing result. Through formative interviews with six experienced industry practitioners, we identified critical bottlenecks in current A/B testing workflows. In response, we present AgentA/B, a novel system that leverages Large Language Model-based autonomous agents (LLM Agents) to automatically simulate user interaction behaviors with real webpages. AgentA/B enables scalable deployment of LLM agents with diverse personas, each capable of navigating the dynamic webpage and interactively executing multi-step interactions like search, clicking, filtering, and purchasing. In a demonstrative controlled experiment, we employ AgentA/B to simulate a between-subject A/B testing with 1,000 LLM agents Amazon.com, and compare agent behaviors with real human shopping behaviors at a scale. Our findings suggest AgentA/B can emulate human-like behavior patterns.