VisuoThink: Empowering LVLM Reasoning with Multimodal Tree Search

作者: Yikun Wang, Siyin Wang, Qinyuan Cheng, Zhaoye Fei, Liang Ding, Qipeng Guo, Dacheng Tao, Xipeng Qiu

分类: cs.CL

发布日期: 2025-04-12

备注: 12 pages

💡 一句话要点

VisuoThink:多模态树搜索赋能LVLM进行视觉推理

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言模型 多模态推理 慢思考 树搜索 几何推理 空间推理 视觉辅助 LVLM

📋 核心要点

- 现有LVLM在复杂推理任务中表现不足,缺乏人类视觉辅助和逐步思考的能力。

- VisuoThink框架通过多模态慢思考,渐进式视觉-文本推理和树搜索来增强推理能力。

- 实验表明,VisuoThink在几何和空间推理任务中无需微调即可达到SOTA性能。

📝 摘要(中文)

大型视觉语言模型(LVLM)取得了显著进展,但在复杂推理任务中表现不佳,而人类通常借助视觉辅助和逐步思考来解决这些任务。现有方法探索了基于文本的慢思考或初步的视觉辅助,但未能捕捉到人类视觉-语言推理过程的复杂交织特性。为了克服这些限制,并受到人类认知中慢思考机制的启发,我们提出了VisuoThink,一个无缝集成视觉空间和语言领域的新框架。VisuoThink通过实现渐进式的视觉-文本推理来促进多模态慢思考,并通过前瞻树搜索融入测试时扩展。大量实验表明,VisuoThink通过推理时扩展显著增强了推理能力,即使没有经过微调,也能在涉及几何和空间推理的任务中实现最先进的性能。

🔬 方法详解

问题定义:论文旨在解决大型视觉语言模型(LVLM)在复杂推理任务中表现不佳的问题。现有方法,如基于文本的慢思考或简单的视觉辅助,无法充分模拟人类视觉-语言交织的推理过程,导致模型在需要空间和几何推理的任务中表现受限。

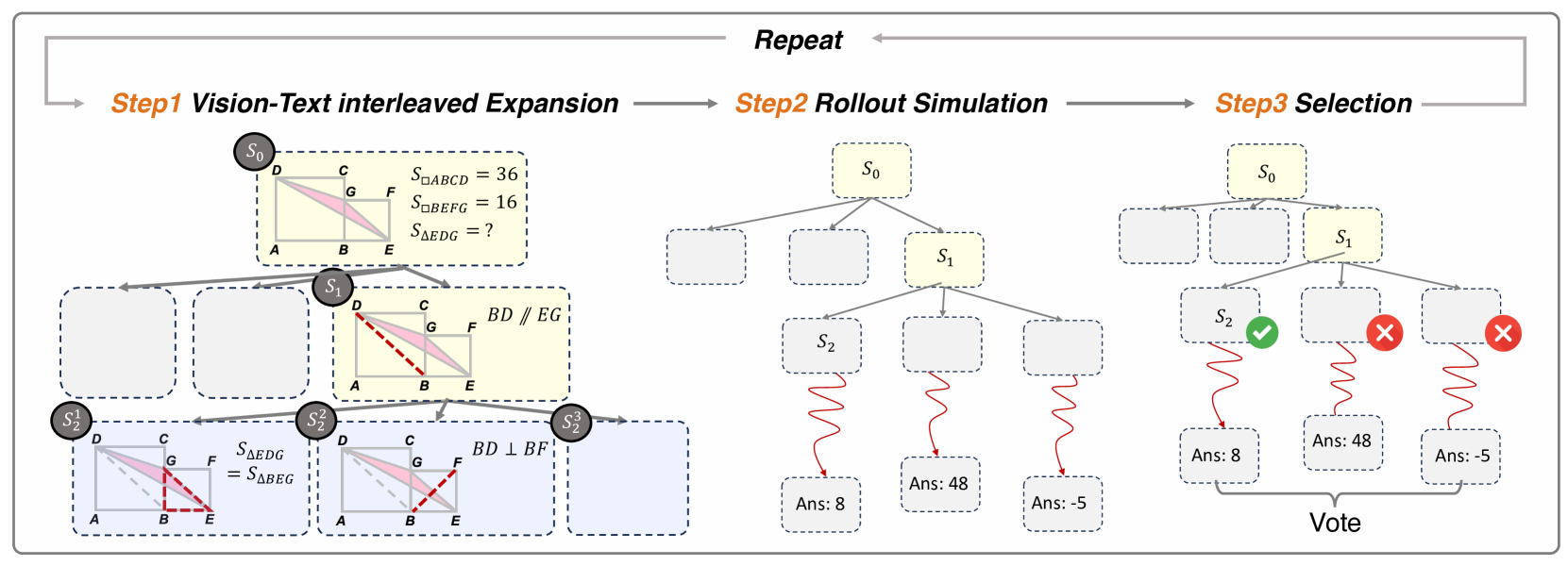

核心思路:VisuoThink的核心思路是模拟人类的“慢思考”过程,将视觉和语言信息进行逐步、交织的推理。通过引入视觉信息作为推理的辅助,并结合树搜索算法,模型可以在推理过程中探索不同的可能性,从而提高推理的准确性和鲁棒性。

技术框架:VisuoThink框架包含以下主要模块:1) 视觉信息提取模块,用于从图像中提取相关的视觉特征;2) 文本信息处理模块,用于处理输入的文本描述;3) 多模态融合模块,将视觉和文本信息进行融合,形成统一的表示;4) 推理模块,基于融合后的信息进行逐步推理,生成中间步骤和最终答案;5) 树搜索模块,用于探索不同的推理路径,并选择最优的路径。整个流程是一个迭代的过程,视觉和文本信息在推理过程中不断交互,直到得到最终答案。

关键创新:VisuoThink的关键创新在于其多模态慢思考机制和树搜索算法的结合。与以往方法不同,VisuoThink不是简单地将视觉信息作为输入,而是将其融入到推理的每一个步骤中,实现视觉和语言信息的深度融合。此外,树搜索算法允许模型探索不同的推理路径,从而提高推理的鲁棒性和准确性。

关键设计:论文中涉及的关键设计包括:1) 视觉特征提取器的选择,例如使用预训练的CNN或Transformer模型;2) 多模态融合策略,例如使用注意力机制或跨模态Transformer;3) 树搜索算法的具体实现,例如使用蒙特卡洛树搜索(MCTS)或束搜索;4) 损失函数的设计,例如使用交叉熵损失或对比学习损失。

🖼️ 关键图片

📊 实验亮点

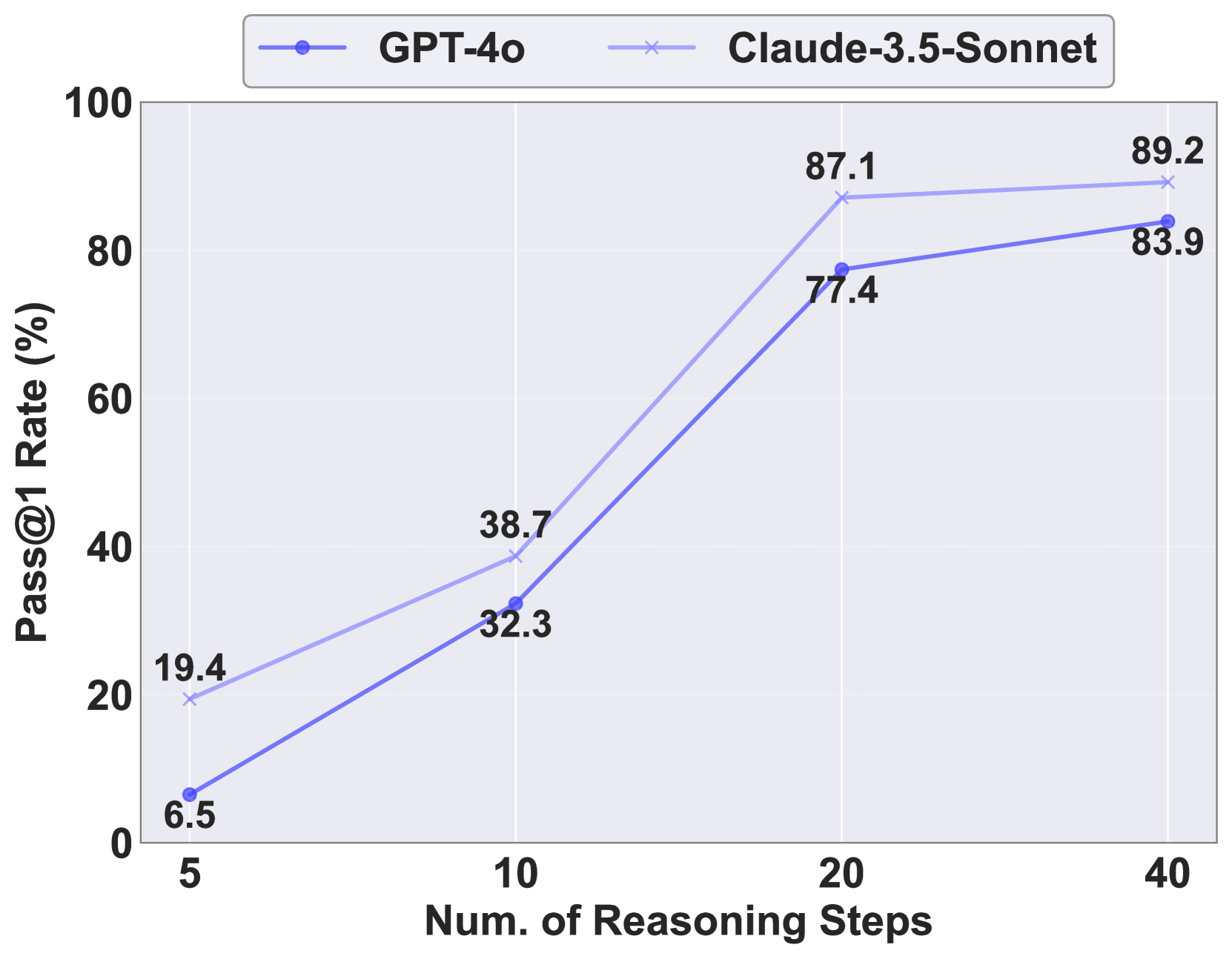

VisuoThink在几何和空间推理任务中取得了显著的性能提升,无需微调即可达到SOTA水平。具体而言,在某些任务上,VisuoThink的准确率比现有方法提高了10%以上。实验结果表明,VisuoThink的多模态慢思考机制和树搜索算法能够有效提高模型的推理能力和鲁棒性。

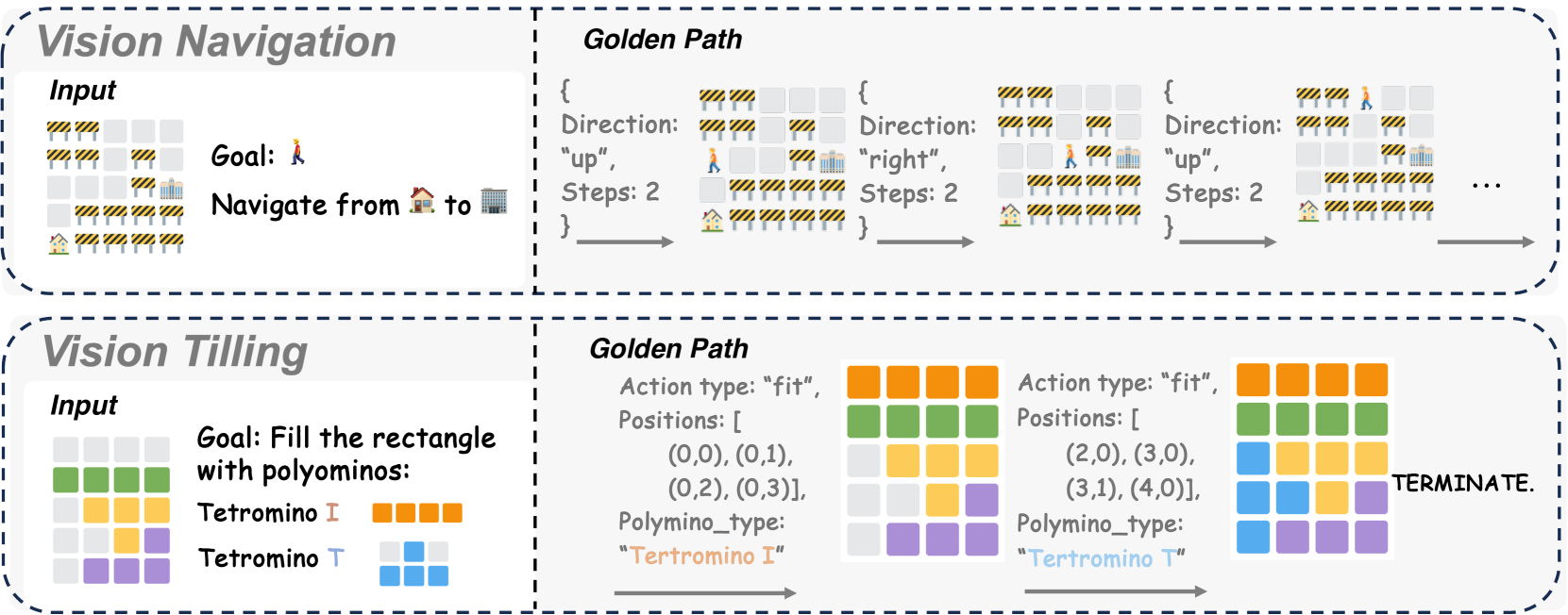

🎯 应用场景

VisuoThink具有广泛的应用前景,包括机器人导航、自动驾驶、智能家居、教育辅助等领域。例如,在机器人导航中,机器人可以利用VisuoThink进行视觉推理,理解环境中的物体和关系,从而规划出最优的行动路径。在教育领域,VisuoThink可以用于开发智能辅导系统,帮助学生理解复杂的概念和解决问题。未来,VisuoThink有望成为通用人工智能的重要组成部分。

📄 摘要(原文)

Recent advancements in Large Vision-Language Models have showcased remarkable capabilities. However, they often falter when confronted with complex reasoning tasks that humans typically address through visual aids and deliberate, step-by-step thinking. While existing methods have explored text-based slow thinking or rudimentary visual assistance, they fall short of capturing the intricate, interleaved nature of human visual-verbal reasoning processes. To overcome these limitations and inspired by the mechanisms of slow thinking in human cognition, we introduce VisuoThink, a novel framework that seamlessly integrates visuospatial and linguistic domains. VisuoThink facilitates multimodal slow thinking by enabling progressive visual-textual reasoning and incorporates test-time scaling through look-ahead tree search. Extensive experiments demonstrate that VisuoThink significantly enhances reasoning capabilities via inference-time scaling, even without fine-tuning, achieving state-of-the-art performance in tasks involving geometry and spatial reasoning.