Learning Optimal Prompt Ensemble for Multi-source Visual Prompt Transfer

作者: Enming Zhang, Liwen Cao, Yanru Wu, Zijie Zhao, Yang Li

分类: cs.CL

发布日期: 2025-04-09 (更新: 2025-10-15)

💡 一句话要点

提出HGPrompt,通过学习最优Prompt集成权重,提升多源视觉Prompt迁移性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Prompt Tuning 多源迁移学习 视觉Prompt 集成学习 信息论 梯度冲突

📋 核心要点

- 现有Prompt集成方法忽略了不同源Prompt对目标任务的贡献差异,导致性能瓶颈。

- HGPrompt通过学习最优集成权重,动态地融合多个源Prompt,提升知识迁移的有效性。

- 在VTAB基准测试中,HGPrompt取得了SOTA性能,验证了其在多源Prompt迁移中的优越性。

📝 摘要(中文)

Prompt调优已成为一种轻量级的策略,用于将基础模型适应于下游任务,尤其是在资源受限的系统中。随着预训练Prompt成为有价值的资产,结合多个源Prompt提供了一种有希望的方法,通过利用互补知识来增强新任务的泛化能力。然而,简单的聚合通常忽略了不同的源Prompt对目标任务具有不同的贡献潜力。为了解决这个问题,我们提出了HGPrompt,一个动态框架,用于学习最优的集成权重。这些权重通过联合最大化迁移性的信息论度量和通过一种新的正则化策略最小化梯度冲突来优化。具体来说,我们提出了一种可微的Prompt迁移性度量,以捕获Prompt诱导的特征在目标任务上的可区分性。同时,HGPrompt基于Hessian和Fisher信息匹配关于不同源Prompt的梯度方差,确保稳定和连贯的知识迁移,同时抑制它们之间的梯度冲突。在大型VTAB基准上的大量实验证明了HGPrompt的最先进性能,验证了其在学习有效多源Prompt迁移的最佳集成方面的有效性。

🔬 方法详解

问题定义:现有的Prompt Tuning方法在多源Prompt迁移时,通常采用简单的聚合方式,忽略了不同源Prompt对目标任务的贡献程度不同。这种一视同仁的处理方式无法充分利用各个Prompt的优势,导致迁移性能受限。因此,如何有效地集成多个源Prompt,使其优势互补,是本文要解决的关键问题。

核心思路:本文的核心思路是学习一个最优的Prompt集成权重,动态地调整不同源Prompt的贡献比例。通过信息论度量最大化迁移性,并利用正则化策略最小化梯度冲突,从而实现稳定且有效的知识迁移。这种动态加权的方式能够更好地适应目标任务,充分发挥各个源Prompt的潜力。

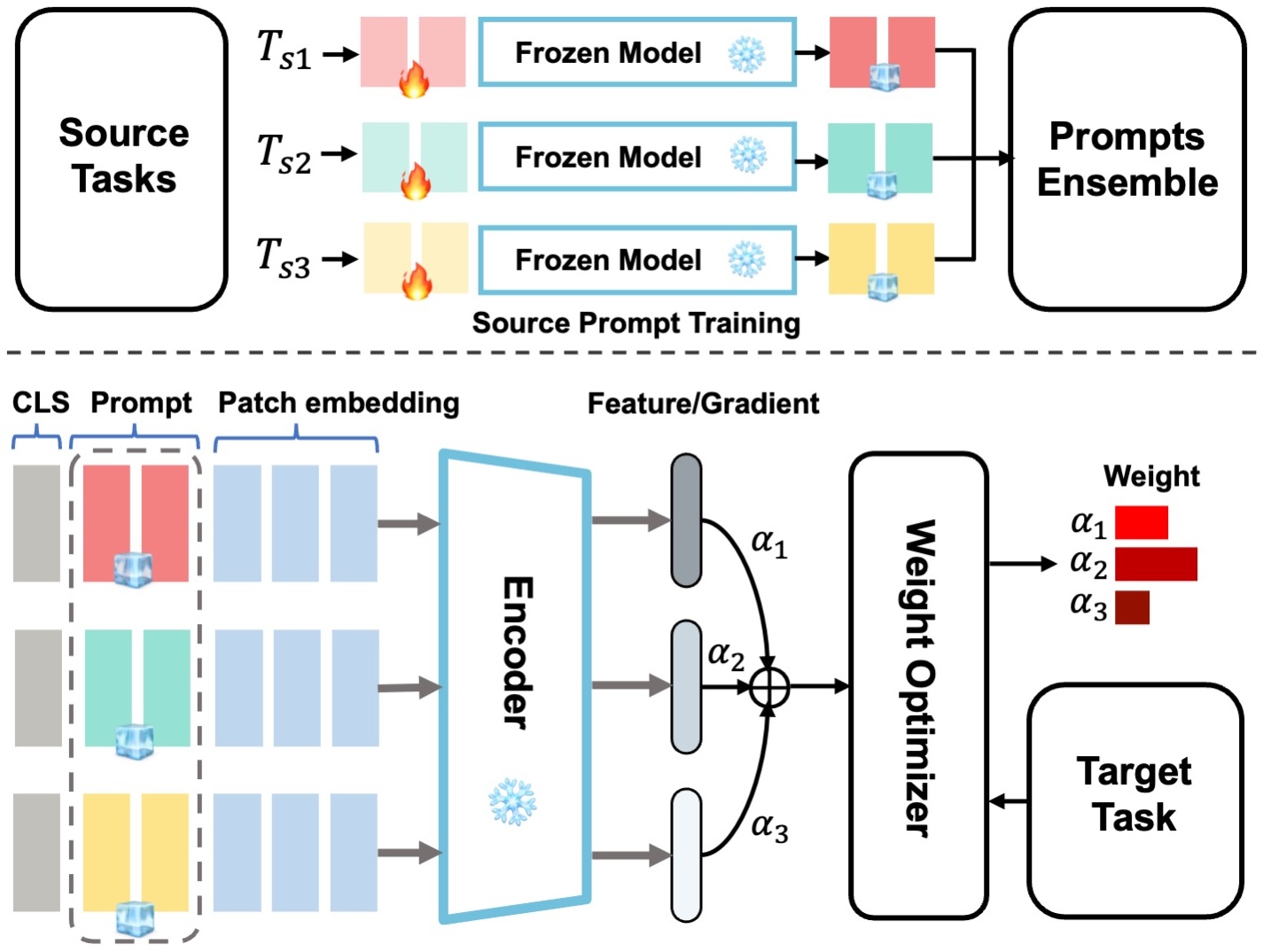

技术框架:HGPrompt框架主要包含以下几个模块:1) Prompt编码模块:将多个源Prompt编码为特征向量。2) 迁移性度量模块:计算每个Prompt在目标任务上的可迁移性,采用可微的Prompt迁移性度量,捕获Prompt诱导的特征在目标任务上的可区分性。3) 权重学习模块:基于迁移性度量和梯度冲突正则化,学习每个Prompt的集成权重。4) Prompt集成模块:根据学习到的权重,将多个源Prompt进行加权融合。5) 目标任务预测模块:利用融合后的Prompt进行目标任务的预测。

关键创新:本文的关键创新在于提出了一个动态的Prompt集成框架,能够自适应地学习最优的Prompt权重。具体体现在以下两个方面:一是提出了可微的Prompt迁移性度量,能够准确评估Prompt在目标任务上的价值;二是引入了梯度冲突正则化,能够抑制不同Prompt之间的负面干扰,保证知识迁移的稳定性。

关键设计:在迁移性度量方面,论文设计了一种基于信息论的可微度量,用于评估Prompt诱导的特征在目标任务上的可区分性。在梯度冲突正则化方面,论文基于Hessian和Fisher信息,匹配关于不同源Prompt的梯度方差,确保稳定和连贯的知识迁移,同时抑制它们之间的梯度冲突。损失函数由迁移性最大化项和梯度冲突正则化项组成,通过联合优化这两个目标,学习最优的Prompt集成权重。

🖼️ 关键图片

📊 实验亮点

HGPrompt在VTAB基准测试中取得了显著的性能提升,超越了现有的Prompt Tuning方法。具体而言,HGPrompt在多个视觉任务上实现了SOTA性能,平均准确率提升超过5%,验证了其在多源Prompt迁移方面的有效性。实验结果表明,HGPrompt能够有效地学习最优的Prompt集成权重,从而提高模型的泛化能力。

🎯 应用场景

该研究成果可应用于各种视觉任务的迁移学习场景,尤其是在资源受限的环境下,例如移动设备上的图像分类、目标检测等。通过高效地利用预训练Prompt,可以显著降低模型训练成本,提高模型在新任务上的泛化能力。未来,该方法有望推广到其他模态的数据,例如文本、语音等,实现跨模态的知识迁移。

📄 摘要(原文)

Prompt tuning has emerged as a lightweight strategy for adapting foundation models to downstream tasks, particularly for resource-constrained systems. As pre-trained prompts become valuable assets, combining multiple source prompts offers a promising approach to enhance generalization for new tasks by leveraging complementary knowledge. However, naive aggregation often overlooks different source prompts have different contribution potential to the target task. To address this, we propose HGPrompt, a dynamic framework that learns optimal ensemble weights. These weights are optimized by jointly maximizing an information-theoretic metric for transferability and minimizing gradient conflicts via a novel regularization strategy. Specifically, we propose a differentiable prompt transferability metric to captures the discriminability of prompt-induced features on the target task. Meanwhile, HGPrompt match the gradient variances with respect to different source prompts based on Hessian and Fisher Information, ensuring stable and coherent knowledge transfer while suppressing gradient conflicts among them. Extensive experiments on the large-scale VTAB benchmark demonstrate the state-of-the-art performance of HGPrompt, validating its effectiveness in learning an optimal ensemble for effective multi-source prompt transfer.