Exposure to Content Written by Large Language Models Can Reduce Stigma Around Opioid Use Disorder in Online Communities

作者: Shravika Mittal, Darshi Shah, Shin Won Do, Mai ElSherief, Tanushree Mitra, Munmun De Choudhury

分类: cs.SI, cs.CL, cs.CY, cs.HC

发布日期: 2025-04-08

💡 一句话要点

利用大型语言模型减少在线社区中对鸦片类药物使用障碍的污名化

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 鸦片类药物使用障碍 社会污名化 药物成瘾治疗 在线社区

📋 核心要点

- 鸦片类药物使用障碍(OUD)相关的社会污名化阻碍了有效的治疗和干预措施的实施。

- 该研究探索利用大型语言模型(LLM)生成的内容,能否有效减少在线社区中对OUD的污名化。

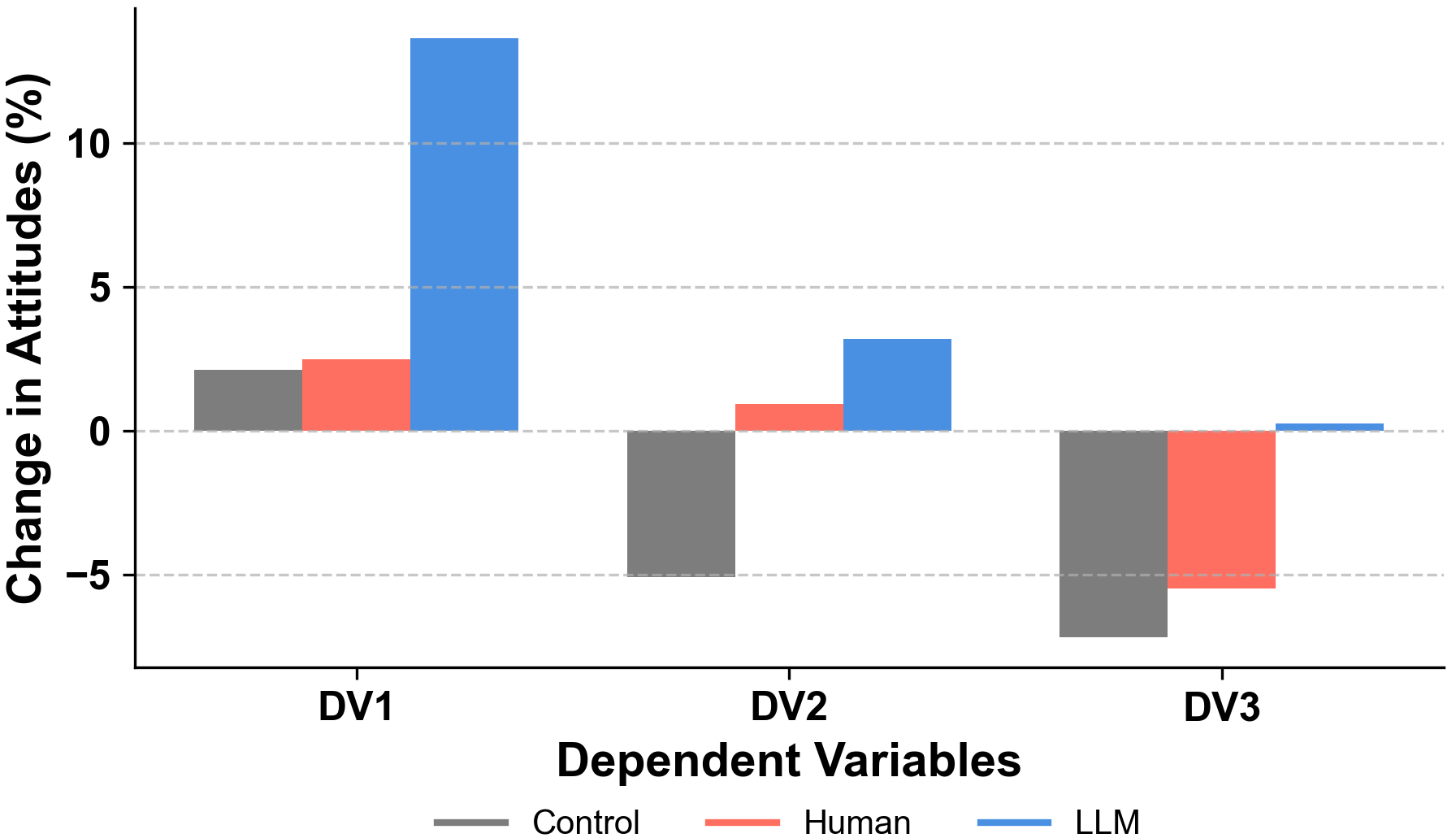

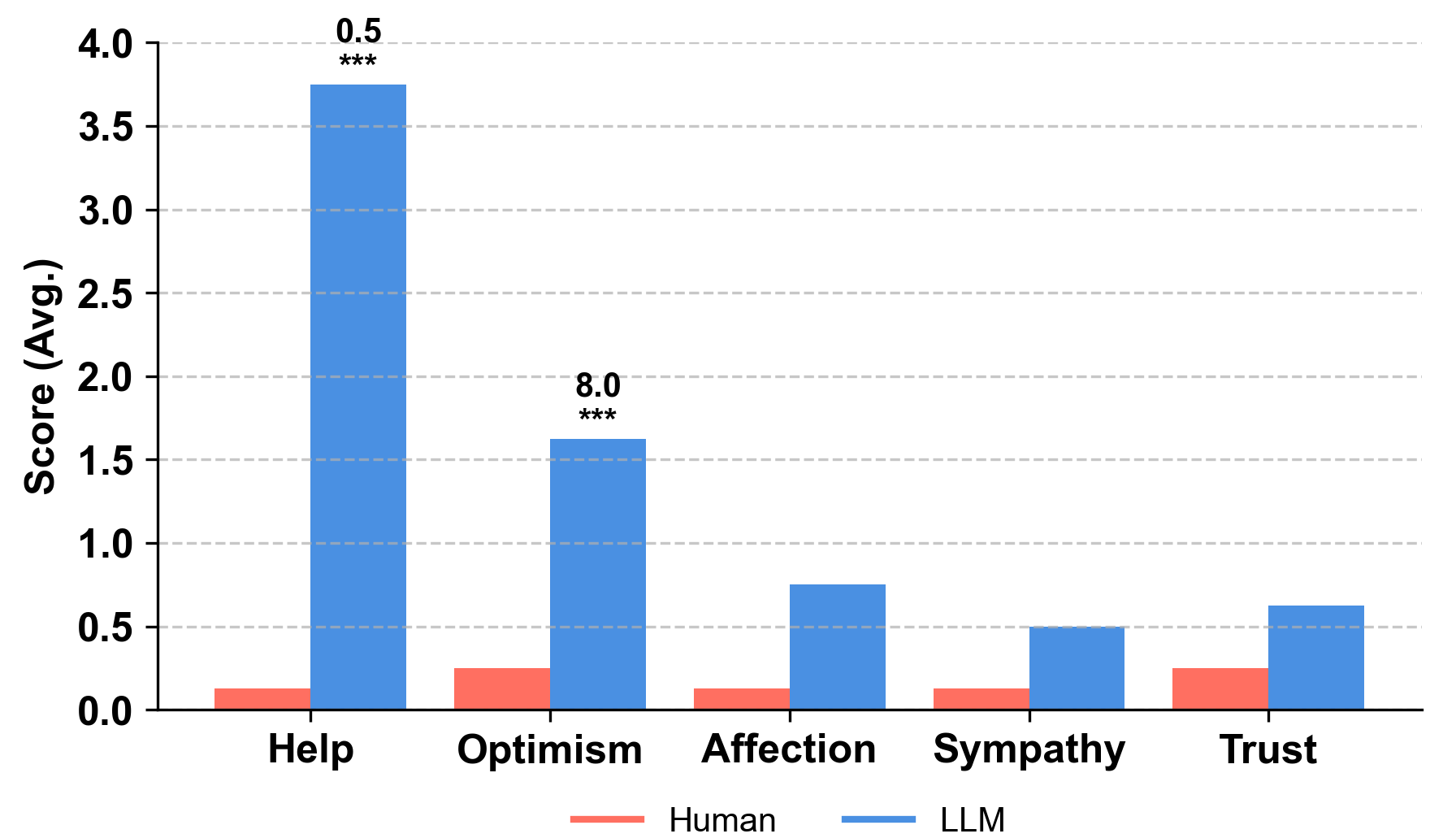

- 实验结果表明,相比人工撰写或无回复,阅读LLM生成的内容能显著降低参与者对药物成瘾治疗(MAT)的污名化态度。

📝 摘要(中文)

在线和线下空间中普遍存在的污名化阻碍了鸦片类药物使用障碍(OUD)的危害降低工作。这种污名化主要针对临床批准的药物成瘾治疗(MAT)、患者以及疾病本身。鉴于人工智能技术在促进健康公平和促进共情对话方面的潜力,本研究探讨了大型语言模型(LLM)是否能帮助减轻在线社区中与OUD相关的污名。为此,我们进行了一系列预先注册的随机对照实验,参与者阅读LLM生成、人工撰写或无回复的在线社区中寻求OUD相关帮助的内容。实验在两种设置下进行,即参与者阅读回复一次(N = 2,141)或重复阅读14天(N = 107)。我们发现,在两种设置下,参与者在阅读LLM生成的回复后,对MAT的态度污名化程度最低。这项研究为促进关于OUD的包容性在线讨论提供了策略,例如,根据我们的发现,LLM可以用作一种基于教育的干预手段,以促进积极的态度并提高人们对MAT的倾向。

🔬 方法详解

问题定义:该论文旨在解决在线社区中普遍存在的对鸦片类药物使用障碍(OUD)及其治疗方法(MAT)的污名化问题。现有的干预措施往往难以有效触及大量人群,且人工干预成本高昂,难以规模化。因此,如何利用技术手段,低成本、大规模地减少这种污名化,是一个亟待解决的问题。

核心思路:论文的核心思路是利用大型语言模型(LLM)生成具有同情心和教育意义的回复,以改变人们对OUD和MAT的负面认知。作者认为,LLM能够模拟人类的语言风格,生成更具说服力和同理心的内容,从而有效地减少污名化。这种方法旨在通过提供准确的信息和积极的视角,来消除人们的偏见和误解。

技术框架:该研究采用了一系列预先注册的随机对照实验。参与者被随机分配到三个组:阅读LLM生成回复组、阅读人工撰写回复组和无回复组。实验分为两种设置:单次阅读和重复阅读(14天)。在实验过程中,研究人员收集参与者对OUD和MAT的态度数据,并进行统计分析,以评估不同干预措施的效果。

关键创新:该研究的关键创新在于将大型语言模型应用于减少社会污名化领域。以往的研究主要集中在人工干预或传统媒体宣传,而该研究首次探索了利用LLM生成内容来改变人们的认知和态度。这种方法具有成本低、可扩展性强的优势,为解决社会污名化问题提供了一种新的思路。

关键设计:实验设计的关键在于控制变量和确保实验的可靠性。研究人员采用了预先注册的方法,明确了实验的目标、假设和分析方法,以避免事后偏差。此外,研究人员还采用了多种测量工具来评估参与者的态度,并进行了严格的统计分析,以确保结果的有效性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,与人工撰写或无回复相比,阅读LLM生成的回复能显著降低参与者对MAT的污名化态度。在单次阅读实验中,LLM组的污名化程度最低。在重复阅读实验中,LLM组的效果同样优于其他两组。这些结果表明,LLM在减少OUD相关污名化方面具有显著的潜力。

🎯 应用场景

该研究成果可应用于在线健康社区、社交媒体平台和公共卫生宣传活动中,通过部署LLM生成的回复,减少对OUD患者的歧视,提高MAT的接受度,促进患者积极寻求治疗。未来,该方法可扩展到其他受污名化影响的疾病或群体,例如精神疾病、艾滋病等,具有广泛的应用前景和社会价值。

📄 摘要(原文)

Widespread stigma, both in the offline and online spaces, acts as a barrier to harm reduction efforts in the context of opioid use disorder (OUD). This stigma is prominently directed towards clinically approved medications for addiction treatment (MAT), people with the condition, and the condition itself. Given the potential of artificial intelligence based technologies in promoting health equity, and facilitating empathic conversations, this work examines whether large language models (LLMs) can help abate OUD-related stigma in online communities. To answer this, we conducted a series of pre-registered randomized controlled experiments, where participants read LLM-generated, human-written, or no responses to help seeking OUD-related content in online communities. The experiment was conducted under two setups, i.e., participants read the responses either once (N = 2,141), or repeatedly for 14 days (N = 107). We found that participants reported the least stigmatized attitudes toward MAT after consuming LLM-generated responses under both the setups. This study offers insights into strategies that can foster inclusive online discourse on OUD, e.g., based on our findings LLMs can be used as an education-based intervention to promote positive attitudes and increase people's propensity toward MAT.