Self-Adaptive Cognitive Debiasing for Large Language Models in Decision-Making

作者: Yougang Lyu, Shijie Ren, Yue Feng, Zihan Wang, Zhumin Chen, Zhaochun Ren, Maarten de Rijke

分类: cs.CL

发布日期: 2025-04-05 (更新: 2025-11-02)

💡 一句话要点

提出自适应认知偏差消除方法SACD,提升大语言模型在决策场景中的可靠性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 认知偏差 决策制定 提示工程 自适应学习

📋 核心要点

- 现有认知偏差缓解方法假设输入提示仅包含单一偏差,无法有效处理多重偏差并存的复杂场景。

- 论文提出自适应认知偏差消除(SACD)方法,通过迭代地进行偏差确定、分析和消除,提升LLM决策可靠性。

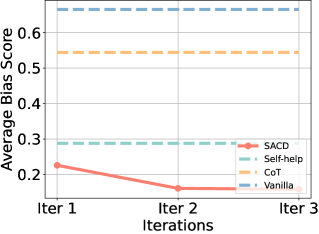

- 实验结果表明,SACD在金融、医疗和法律决策任务中,相较于现有方法,显著降低了单偏差和多偏差场景下的平均偏差分数。

📝 摘要(中文)

大语言模型(LLMs)在决策支持应用中展现出潜力,尤其是在金融、医疗和法律领域作为个人助理。虽然提示工程策略增强了LLMs在决策方面的能力,但LLMs固有的认知偏差带来了重大挑战。认知偏差是决策中系统性地偏离规范或理性的模式,可能导致不准确的输出。现有的认知偏差缓解策略假设输入提示只包含一种类型的认知偏差,限制了它们在涉及多种认知偏差的更具挑战性的场景中的有效性。为了填补这一空白,我们提出了一种认知偏差消除方法,即自适应认知偏差消除(SACD),通过迭代地改进提示来提高LLMs的可靠性。我们的方法遵循三个连续的步骤——偏差确定、偏差分析和认知偏差消除——以迭代地减轻提示中潜在的认知偏差。我们使用开源和闭源LLMs在金融、医疗和法律决策任务上评估SACD。与先进的提示工程方法和现有的认知偏差消除技术相比,SACD在单偏差和多偏差设置中都实现了最低的平均偏差分数。

🔬 方法详解

问题定义:论文旨在解决大语言模型在决策制定过程中,由于固有的认知偏差而产生不准确或不合理输出的问题。现有认知偏差缓解策略的局限性在于,它们通常假设输入提示中只存在单一类型的认知偏差,这与现实世界中可能存在多种认知偏差的情况不符。因此,当面对包含多种认知偏差的复杂提示时,现有方法的效果会大打折扣。

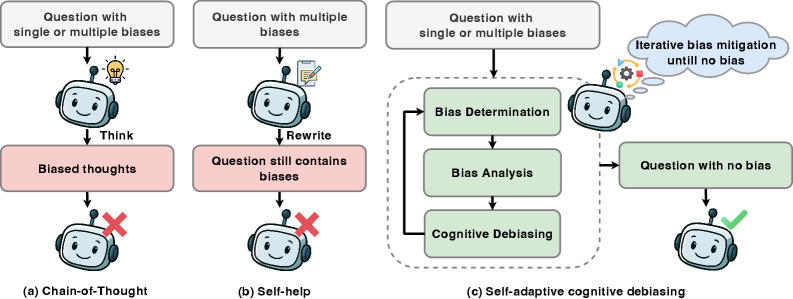

核心思路:论文的核心思路是通过迭代地分析和消除提示中的认知偏差,从而提高LLM决策的可靠性。SACD方法不预先假设偏差的类型,而是通过自适应的方式,逐步识别并减轻提示中存在的各种认知偏差。这种迭代式的优化过程使得模型能够更好地适应复杂和多变的输入,从而产生更准确和合理的决策结果。

技术框架:SACD方法包含三个主要阶段:偏差确定、偏差分析和认知偏差消除。首先,偏差确定阶段旨在识别提示中可能存在的认知偏差类型。然后,偏差分析阶段对已识别的偏差进行深入分析,评估其对LLM决策的影响程度。最后,认知偏差消除阶段利用特定的策略来减轻或消除这些偏差,从而优化提示。整个过程是迭代进行的,每次迭代都会对提示进行改进,直到达到预定的收敛标准或偏差水平。

关键创新:SACD的关键创新在于其自适应性和迭代性。与现有方法不同,SACD不依赖于预定义的偏差类型,而是能够动态地识别和处理提示中存在的各种认知偏差。此外,SACD的迭代优化过程使得模型能够逐步逼近最优的提示,从而获得更准确和可靠的决策结果。这种自适应和迭代的特性使得SACD能够更好地应对复杂和多变的决策场景。

关键设计:论文中没有详细说明具体的参数设置、损失函数或网络结构等技术细节。但是,可以推断,偏差确定阶段可能涉及到对LLM输出的分析,以识别与特定认知偏差相关的模式。偏差分析阶段可能需要评估这些模式对决策结果的影响程度。认知偏差消除阶段可能涉及到对提示的修改,例如添加额外的约束或信息,以减轻偏差的影响。具体的实现细节可能取决于所使用的LLM和决策任务。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SACD在金融、医疗和法律决策任务中,相较于先进的提示工程方法和现有的认知偏差消除技术,显著降低了平均偏差分数。在单偏差和多偏差设置下,SACD均取得了最佳性能,验证了其在复杂决策场景中的有效性。具体性能提升数据未知,但结论表明SACD优于现有方法。

🎯 应用场景

该研究成果可广泛应用于金融、医疗、法律等决策辅助领域,提升大语言模型作为智能助手的可靠性。通过消除认知偏差,SACD能够帮助用户做出更明智、更合理的决策,降低因模型偏差导致的潜在风险。未来,该技术有望应用于更广泛的领域,例如政策制定、风险评估等,为各行各业提供更可靠的决策支持。

📄 摘要(原文)

Large language models (LLMs) have shown potential in supporting decision-making applications, particularly as personal assistants in the financial, healthcare, and legal domains. While prompt engineering strategies have enhanced the capabilities of LLMs in decision-making, cognitive biases inherent to LLMs present significant challenges. Cognitive biases are systematic patterns of deviation from norms or rationality in decision-making that can lead to the production of inaccurate outputs. Existing cognitive bias mitigation strategies assume that input prompts only contain one type of cognitive bias, limiting their effectiveness in more challenging scenarios involving multiple cognitive biases. To fill this gap, we propose a cognitive debiasing approach, self-adaptive cognitive debiasing (SACD), that enhances the reliability of LLMs by iteratively refining prompts. Our method follows three sequential steps - bias determination, bias analysis, and cognitive debiasing - to iteratively mitigate potential cognitive biases in prompts. We evaluate SACD on finance, healthcare, and legal decision-making tasks using both open-weight and closed-weight LLMs. Compared to advanced prompt engineering methods and existing cognitive debiasing techniques, SACD achieves the lowest average bias scores in both single-bias and multi-bias settings.