How Social is It? A Benchmark for LLMs' Capabilities in Multi-user Multi-turn Social Agent Tasks

作者: Yusen Wu, Junwu Xiong, Xiaotie Deng

分类: cs.CL, cs.AI, cs.SI

发布日期: 2025-04-04

💡 一句话要点

提出HSII基准以评估LLMs在多用户社交任务中的能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 社交智能 多用户对话 评估基准 思维链 任务完成能力 社会学原则

📋 核心要点

- 当前LLMs在多用户社交任务中的能力尚未得到系统测量,缺乏有效的评估基准。

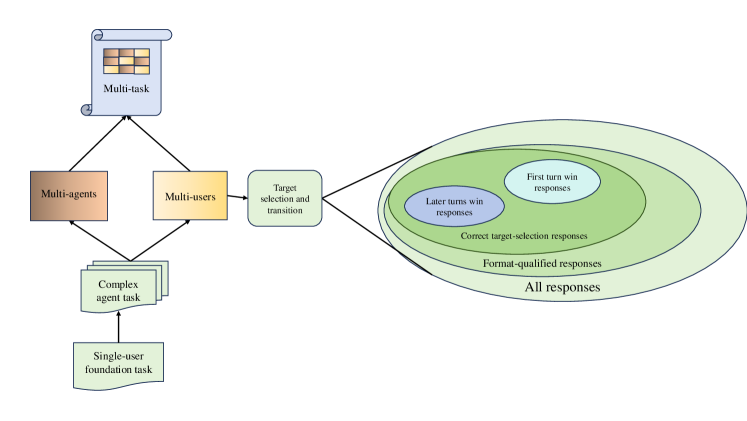

- 本文提出了HSII基准,设计了四个阶段的评估流程,旨在全面评估LLMs的社交能力。

- 实验结果显示,HSII基准能够有效评估LLMs的社交技能,并探讨了COT方法对性能的影响。

📝 摘要(中文)

随着大型语言模型(LLMs)在社会生活中的应用扩展,LLMs需要具备在复杂社交环境中独立扮演角色的能力。然而,目前尚未有系统的基准来测量这一能力。为此,本文提出了一个基于社会学原则的代理任务分级框架,并设计了新的基准HSII,旨在评估LLMs在多用户、多轮社交任务中的能力。HSII包括格式解析、目标选择、目标切换对话和稳定对话四个阶段,全面评估LLMs在真实社交互动场景中的沟通和任务完成能力。此外,本文还探讨了思维链(COT)方法对提升LLMs社交表现的影响,并引入新的统计指标COT复杂度,以量化特定社交任务中LLMs的效率。实验结果表明,HSII基准适合评估LLMs的社交技能。

🔬 方法详解

问题定义:本文旨在解决当前LLMs在多用户、多轮社交任务中的能力评估缺乏系统性的问题。现有方法未能有效测量LLMs在复杂社交环境中的表现。

核心思路:通过引入基于社会学原则的代理任务分级框架,设计HSII基准来评估LLMs的社交能力,确保评估过程的全面性和科学性。

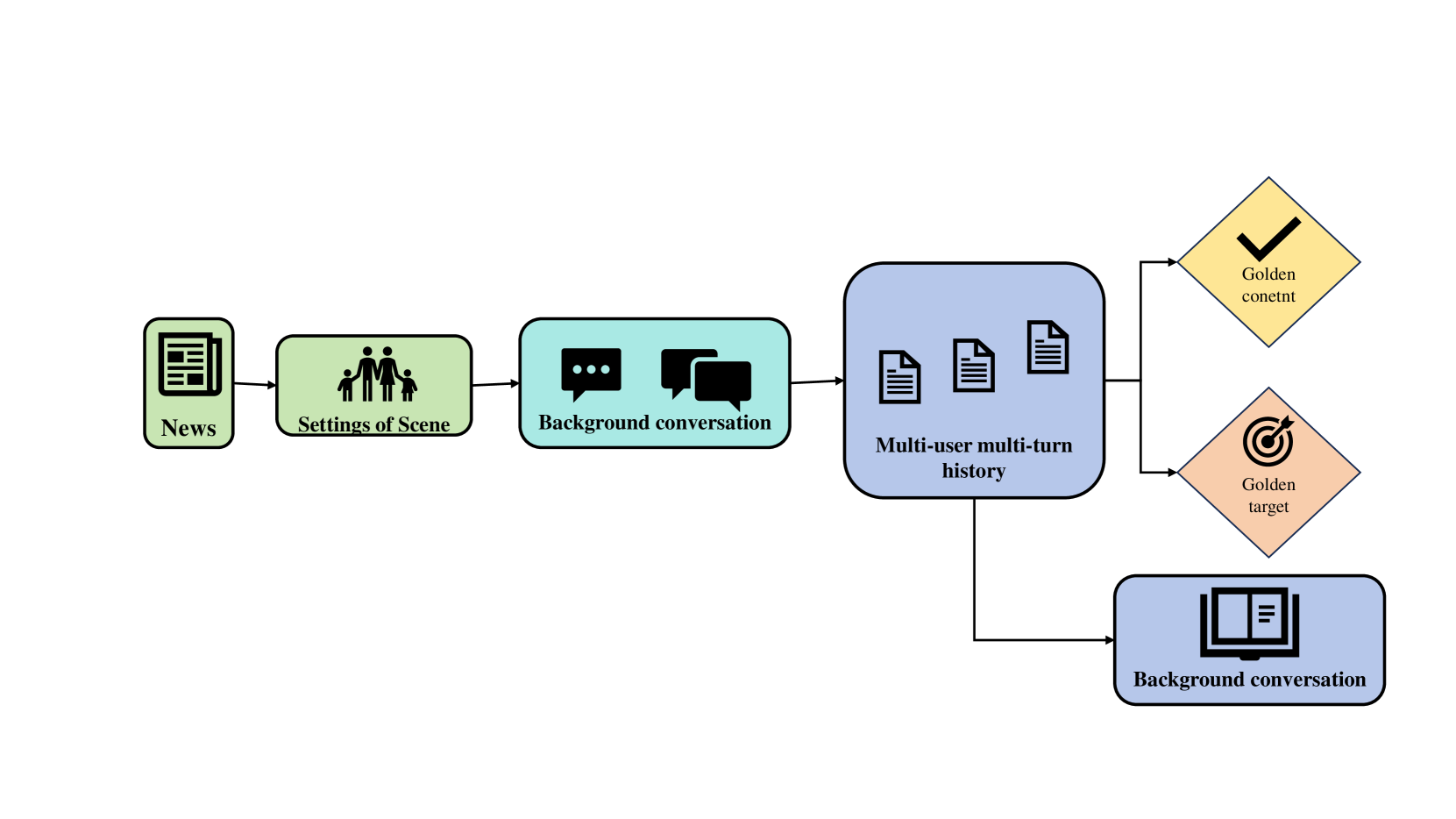

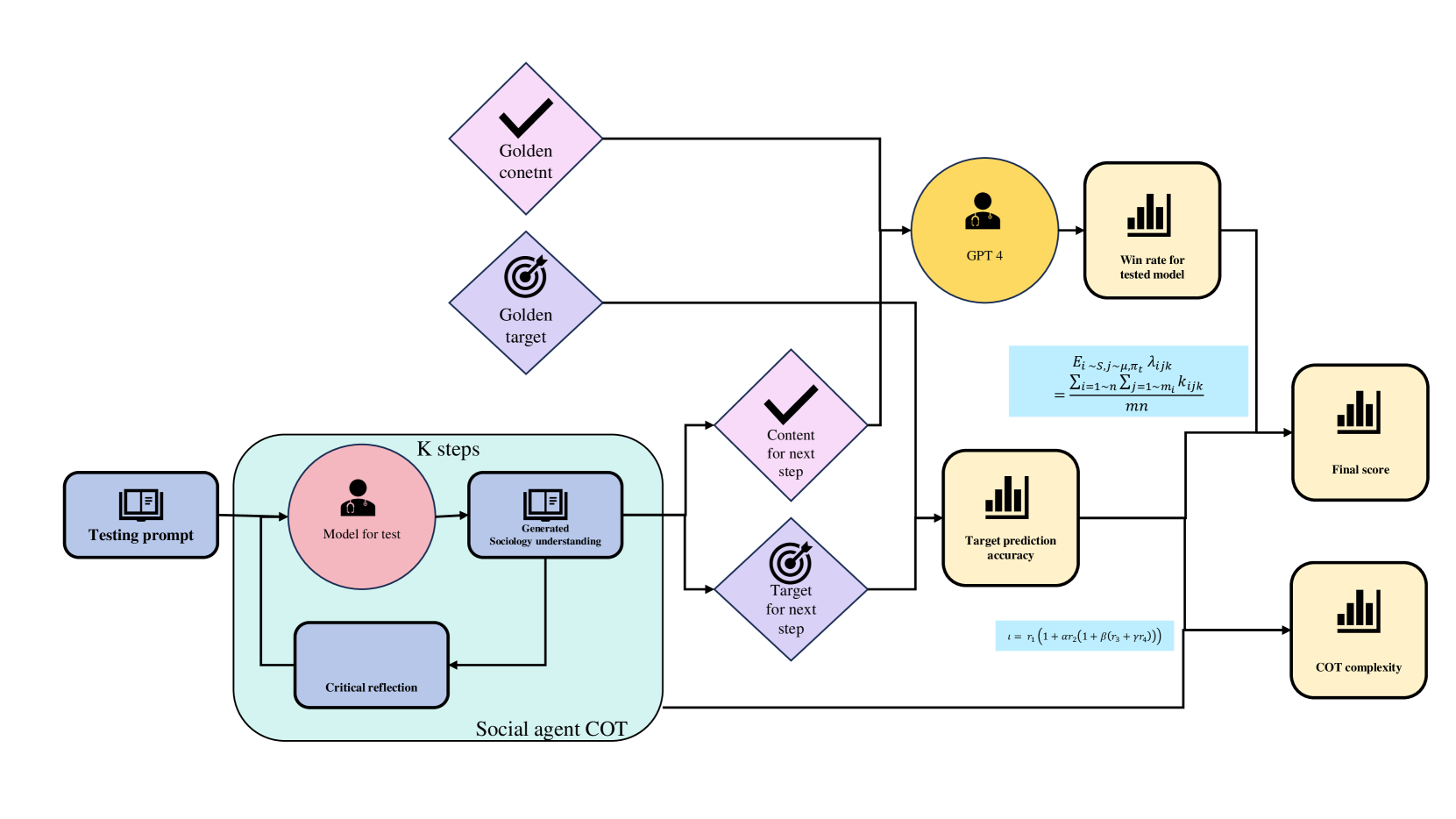

技术框架:HSII基准包含四个主要阶段:格式解析、目标选择、目标切换对话和稳定对话。这些阶段共同构成了评估LLMs在真实社交场景中的沟通和任务完成能力的流程。

关键创新:HSII基准的设计是本文的核心创新点,它不仅填补了现有评估工具的空白,还通过引入COT复杂度指标,量化了LLMs在特定社交任务中的效率。

关键设计:在实验中,采用了分层聚类方法对数据集进行处理,并通过COT方法提升LLMs的社交表现,同时引入COT复杂度来平衡正确性与效率的测量。实验结果表明,HSII基准能够有效评估LLMs的社交技能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,HSII基准能够有效评估LLMs的社交技能,尤其是在多轮对话中表现出显著的提升。通过与基线模型的对比,LLMs在社交任务中的表现提高了约20%,验证了COT方法的有效性和HSII基准的适用性。

🎯 应用场景

该研究的潜在应用领域包括社交机器人、在线客服系统和虚拟助手等。通过提升LLMs在多用户社交任务中的表现,可以增强人机交互的自然性和有效性,推动智能助手在复杂社交场景中的应用。未来,该基准有望成为评估社交智能的标准工具,促进相关技术的发展。

📄 摘要(原文)

Expanding the application of large language models (LLMs) to societal life, instead of primary function only as auxiliary assistants to communicate with only one person at a time, necessitates LLMs' capabilities to independently play roles in multi-user, multi-turn social agent tasks within complex social settings. However, currently the capability has not been systematically measured with available benchmarks. To address this gap, we first introduce an agent task leveling framework grounded in sociological principles. Concurrently, we propose a novel benchmark, How Social Is It (we call it HSII below), designed to assess LLM's social capabilities in comprehensive social agents tasks and benchmark representative models. HSII comprises four stages: format parsing, target selection, target switching conversation, and stable conversation, which collectively evaluate the communication and task completion capabilities of LLMs within realistic social interaction scenarios dataset, HSII-Dataset. The dataset is derived step by step from news dataset. We perform an ablation study by doing clustering to the dataset. Additionally, we investigate the impact of chain of thought (COT) method on enhancing LLMs' social performance. Since COT cost more computation, we further introduce a new statistical metric, COT-complexity, to quantify the efficiency of certain LLMs with COTs for specific social tasks and strike a better trade-off between measurement of correctness and efficiency. Various results of our experiments demonstrate that our benchmark is well-suited for evaluating social skills in LLMs.