Hummus: A Dataset of Humorous Multimodal Metaphor Use

作者: Xiaoyu Tong, Zhi Zhang, Martha Lewis, Ekaterina Shutova

分类: cs.CL, cs.CV

发布日期: 2025-04-03

💡 一句话要点

构建Hummus数据集,用于评估多模态大语言模型对幽默隐喻的理解能力

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 幽默理解 隐喻识别 数据集构建 视觉文本融合

📋 核心要点

- 现有方法在理解图像和文本结合产生的幽默隐喻方面存在不足,尤其是在多模态信息的融合上。

- 论文核心在于构建了一个名为Hummus的数据集,并设计了相应的标注方案,用于研究多模态幽默隐喻。

- 实验结果表明,当前的多模态大语言模型在处理幽默多模态隐喻时表现不佳,视觉和文本信息的整合是瓶颈。

📝 摘要(中文)

本研究关注多模态隐喻的幽默能力,这是社区中尚未受到足够重视的领域。我们从幽默的不协调理论、概念隐喻理论以及VU阿姆斯特丹隐喻语料库的标注方案中获得灵感,为图像-标题对中幽默多模态隐喻的使用开发了一种新的标注方案。我们创建了Hummus数据集,该数据集包含对从《纽约客》漫画标题竞赛语料库中抽样的1000个图像-标题对的专家标注。我们使用该数据集测试了最先进的多模态大型语言模型(MLLM)检测和理解幽默多模态隐喻的能力。实验表明,当前的MLLM在处理幽默多模态隐喻方面仍然存在困难,尤其是在整合视觉和文本信息方面。我们将在github.com/xiaoyuisrain/humorous-multimodal-metaphor-use上发布我们的数据集和代码。

🔬 方法详解

问题定义:论文旨在解决多模态幽默隐喻的理解问题。现有方法,特别是多模态大语言模型,在处理图像和文本结合产生的幽默隐喻时,难以有效融合视觉和文本信息,导致理解偏差或失败。这主要是因为现有模型缺乏针对幽默隐喻的训练数据和专门的理解机制。

核心思路:论文的核心思路是构建一个高质量的、带有专家标注的多模态幽默隐喻数据集,并利用该数据集评估现有模型的能力。通过分析模型在数据集上的表现,可以揭示模型在理解幽默隐喻方面的不足,并为未来的模型改进提供方向。数据集的构建基于幽默的不协调理论和概念隐喻理论,确保标注的准确性和一致性。

技术框架:论文的技术框架主要包括数据集构建和模型评估两个阶段。数据集构建阶段,首先从《纽约客》漫画标题竞赛语料库中抽取图像-标题对,然后基于设计的标注方案进行专家标注,标注内容包括隐喻的存在、类型以及幽默的来源等。模型评估阶段,选择当前最先进的多模态大语言模型,并在Hummus数据集上进行测试,评估模型在隐喻检测和幽默理解方面的性能。

关键创新:论文的关键创新在于构建了Hummus数据集,这是一个专门针对多模态幽默隐喻的数据集,填补了该领域的数据空白。此外,论文还提出了一个基于幽默的不协调理论和概念隐喻理论的标注方案,为多模态幽默隐喻的标注提供了理论基础和实践指导。

关键设计:Hummus数据集包含1000个图像-标题对,每个样本都经过专家标注,标注信息包括隐喻的存在与否、隐喻的类型(例如,视觉隐喻、文本隐喻、多模态隐喻)以及幽默的来源(例如,不协调、双关语)。在模型评估阶段,使用了常用的多模态大语言模型,并采用标准的评估指标,例如准确率、召回率和F1值,来评估模型的性能。

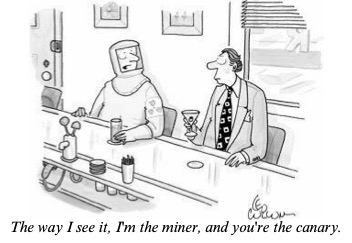

🖼️ 关键图片

📊 实验亮点

实验结果表明,当前最先进的多模态大语言模型在Hummus数据集上的表现远低于人类水平,这表明这些模型在理解幽默多模态隐喻方面仍存在显著差距。具体而言,模型在整合视觉和文本信息方面表现不佳,导致无法准确识别和理解图像-标题对中的幽默元素。该研究揭示了现有模型在处理复杂语义和多模态推理方面的局限性。

🎯 应用场景

该研究成果可应用于提升多模态对话系统、图像描述生成和社交媒体内容理解等领域。更准确地理解幽默隐喻有助于改善人机交互的自然性和趣味性,并能帮助机器更好地理解人类的情感和意图。未来,该数据集可以促进更强大的多模态幽默理解模型的开发。

📄 摘要(原文)

Metaphor and humor share a lot of common ground, and metaphor is one of the most common humorous mechanisms. This study focuses on the humorous capacity of multimodal metaphors, which has not received due attention in the community. We take inspiration from the Incongruity Theory of humor, the Conceptual Metaphor Theory, and the annotation scheme behind the VU Amsterdam Metaphor Corpus, and developed a novel annotation scheme for humorous multimodal metaphor use in image-caption pairs. We create the Hummus Dataset of Humorous Multimodal Metaphor Use, providing expert annotation on 1k image-caption pairs sampled from the New Yorker Caption Contest corpus. Using the dataset, we test state-of-the-art multimodal large language models (MLLMs) on their ability to detect and understand humorous multimodal metaphor use. Our experiments show that current MLLMs still struggle with processing humorous multimodal metaphors, particularly with regard to integrating visual and textual information. We release our dataset and code at github.com/xiaoyuisrain/humorous-multimodal-metaphor-use.