Adapting Large Language Models for Multi-Domain Retrieval-Augmented-Generation

作者: Alexandre Misrahi, Nadezhda Chirkova, Maxime Louis, Vassilina Nikoulina

分类: cs.CL

发布日期: 2025-04-03

备注: 25 pages, 8 figures, 21 tables

💡 一句话要点

提出多领域RAG基准并利用序列蒸馏提升大语言模型泛化能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 检索增强生成 多领域学习 序列蒸馏 领域泛化 大语言模型

📋 核心要点

- 现有RAG方法在多领域应用中缺乏有效基准测试和领域外泛化能力。

- 提出使用序列级蒸馏,通过教师模型生成标签,提供更连贯的监督信号。

- 实验表明,序列级蒸馏能有效提升RAG在多领域问答任务中的领域外泛化性能。

📝 摘要(中文)

检索增强生成(RAG)技术可以提高大语言模型的事实性,但多领域应用面临着缺乏多样化基准和领域外泛化能力差等挑战。本文首先构建了一个包含来自8个来源、覆盖13个领域的问答任务的多样化基准。其次,系统地测试了典型RAG调优策略的领域外泛化能力。研究发现,标准的微调方法无法有效泛化,而使用教师模型生成的标签进行序列级蒸馏可以通过提供更连贯的监督来提高领域外性能。研究结果强调了提高多领域RAG鲁棒性的关键策略。

🔬 方法详解

问题定义:论文旨在解决检索增强生成(RAG)模型在多领域应用中泛化能力不足的问题。现有的RAG模型在特定领域表现良好,但在面对未见过的领域时,性能会显著下降。这主要是因为缺乏足够多样化的训练数据和有效的训练策略,导致模型无法学习到跨领域的通用知识和推理能力。

核心思路:论文的核心思路是利用序列级蒸馏技术,通过一个更强大的教师模型来指导学生模型的训练,从而提高学生模型的泛化能力。教师模型在多个领域的数据上进行训练,可以学习到更丰富的知识和更通用的推理模式。然后,教师模型生成高质量的标签(例如,答案序列),用于训练学生模型。

技术框架:整体框架包括以下几个主要步骤:1) 构建多领域基准数据集,包含来自多个领域的问答数据;2) 训练一个强大的教师模型,使其在所有领域的数据上都表现良好;3) 使用教师模型为训练数据生成标签;4) 使用生成的标签训练学生模型,采用序列级蒸馏损失函数;5) 在领域外数据集上评估学生模型的泛化能力。

关键创新:最重要的技术创新点是使用序列级蒸馏来提高RAG模型的泛化能力。与传统的微调方法相比,序列级蒸馏可以提供更连贯和更丰富的监督信号,从而帮助学生模型更好地学习到跨领域的知识和推理能力。此外,构建的多领域基准数据集也为RAG模型的研究提供了一个有价值的资源。

关键设计:关键设计包括:1) 多领域基准数据集的构建,需要选择具有代表性的领域和高质量的问答数据;2) 教师模型的选择和训练,需要选择一个足够强大的模型,并在所有领域的数据上进行充分的训练;3) 序列级蒸馏损失函数的选择,需要选择一个能够有效衡量学生模型和教师模型输出差异的损失函数;4) 学生模型的训练,需要调整合适的超参数,以获得最佳的性能。

🖼️ 关键图片

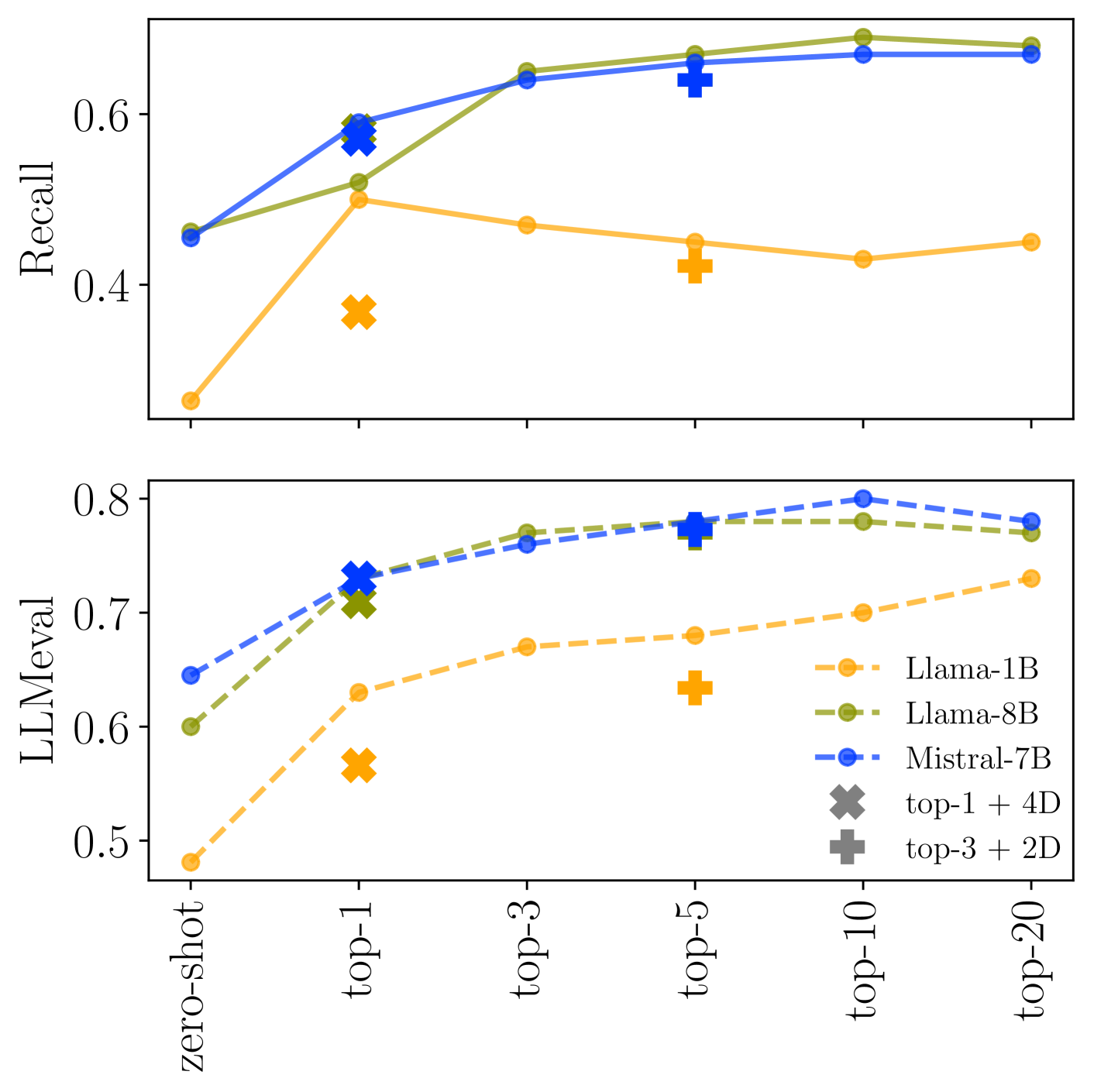

📊 实验亮点

实验结果表明,使用序列级蒸馏可以显著提高RAG模型在领域外数据集上的性能。与标准的微调方法相比,序列级蒸馏在多个领域外数据集上取得了显著的提升,证明了其在提高RAG模型泛化能力方面的有效性。具体性能提升数据在论文中有详细展示。

🎯 应用场景

该研究成果可应用于智能客服、知识问答、内容生成等多个领域。通过提高RAG模型在多领域的泛化能力,可以构建更加智能和可靠的AI系统,为用户提供更准确、更全面的信息服务。未来,该技术有望应用于更广泛的场景,例如跨领域医疗诊断、金融风险评估等。

📄 摘要(原文)

Retrieval-Augmented Generation (RAG) enhances LLM factuality, but multi-domain applications face challenges like lack of diverse benchmarks and poor out-of-domain generalization. The first contribution of this work is to introduce a diverse benchmark comprising a variety of question-answering tasks from 8 sources and covering 13 domains. Our second contribution consists in systematically testing out-of-domain generalization for typical RAG tuning strategies. While our findings reveal that standard fine-tuning fails to generalize effectively, we show that sequence-level distillation with teacher-generated labels improves out-of-domain performance by providing more coherent supervision. Our findings highlight key strategies for improving multi-domain RAG robustness.