A Practical Synthesis of Detecting AI-Generated Textual, Visual, and Audio Content

作者: Lele Cao

分类: cs.CL, cs.LG

发布日期: 2025-04-02 (更新: 2025-09-26)

备注: Accepted and presented at ICDM 2025 Workshop on Multimodal AI (MMAI)

💡 一句话要点

综述AI生成文本、图像和音频内容检测的实用方法,应对虚假信息等风险。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: AI生成内容检测 深度伪造 内容真实性 鲁棒性 对抗性攻击 领域泛化 人机协作

📋 核心要点

- 现有AI内容生成技术快速发展,但缺乏有效的检测和防御机制,导致虚假信息和安全风险。

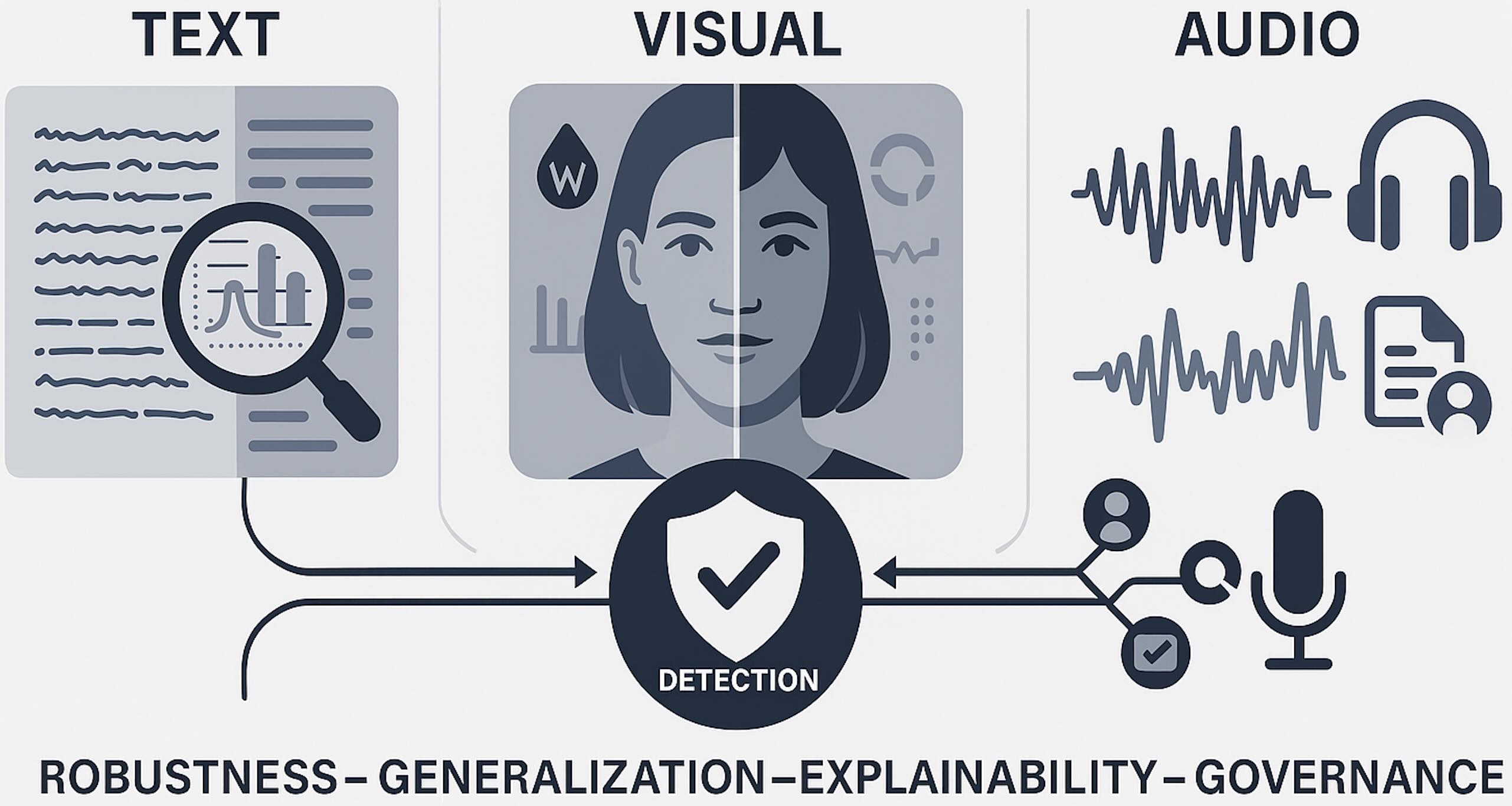

- 本文全面综述了多种AI生成内容检测方法,包括观察、统计分析、模型方法、水印等,并提出新的鲁棒性视角。

- 通过案例分析,本文旨在为研究人员、从业者和监管者提供指导,以应对AI生成内容带来的挑战,维护内容真实性。

📝 摘要(中文)

人工智能生成内容(AIGC)的进步推动了大型语言模型、扩散模型图像生成器和合成音频工具的广泛应用。然而,这些发展也引发了对虚假信息、版权侵权、安全威胁和公众信任度下降的严重担忧。本文探讨了旨在检测和缓解AI生成文本、图像和音频内容的大量方法。首先讨论了与基于AI的内容生成相关的动机和潜在影响,包括现实世界的风险和伦理困境。然后概述了检测技术,包括基于观察的策略、语言和统计分析、基于模型的流程、水印和指纹识别,以及新兴的集成方法。还提出了关于鲁棒性、适应快速改进的生成架构以及人机协作验证的关键作用的新视角。通过调查最先进的研究,并强调学术、新闻、法律和工业领域的案例研究,本文旨在为稳健的解决方案和政策制定提供信息。最后,讨论了开放的挑战,包括对抗性转换、领域泛化和伦理问题,从而为研究人员、从业人员和监管机构提供了一个全面的指南,以便在面对日益复杂的AI生成媒体时保持内容的真实性。

🔬 方法详解

问题定义:论文旨在解决AI生成内容(文本、图像、音频)的检测问题。现有方法在面对快速发展的生成模型时,鲁棒性不足,难以适应新的对抗性攻击,且领域泛化能力有限。此外,伦理问题也日益突出,例如如何平衡检测的准确性和对用户隐私的保护。

核心思路:论文的核心思路是对现有AI生成内容检测方法进行系统性的梳理和总结,并在此基础上提出新的视角,例如关注检测方法的鲁棒性、适应性和伦理影响。通过综合运用多种检测技术,并结合人机协作,可以更有效地识别和应对AI生成内容带来的挑战。

技术框架:论文采用综述的形式,没有提出具体的算法框架。其技术框架体现在对各种检测方法的分类和总结上,包括:1) 基于观察的策略;2) 语言和统计分析;3) 基于模型的流程;4) 水印和指纹识别;5) 集成方法。此外,论文还强调了人机协作的重要性,认为人工审核在最终验证阶段不可或缺。

关键创新:论文的主要创新在于其全面性和前瞻性。它不仅对现有检测方法进行了系统性的总结,还提出了关于鲁棒性、适应性和伦理影响的新视角。这种综合性的分析有助于研究人员更好地理解AI生成内容检测领域的现状和未来发展趋势。

关键设计:由于是综述论文,没有具体的技术细节。但论文强调了以下几个关键设计原则:1) 鲁棒性:检测方法应能抵抗对抗性攻击;2) 适应性:检测方法应能适应快速发展的生成模型;3) 可解释性:检测结果应具有一定的可解释性,以便人工审核;4) 伦理考量:检测方法应充分考虑用户隐私和公平性。

🖼️ 关键图片

📊 实验亮点

本文通过案例研究,展示了现有检测方法在不同场景下的性能表现,并指出了其局限性。强调了集成方法和人机协作在提高检测准确率和鲁棒性方面的重要性。同时,也突出了对抗性攻击和领域泛化等开放挑战。

🎯 应用场景

该研究成果可应用于新闻媒体、社交平台、版权保护、安全监控等领域,用于识别和过滤AI生成的虚假信息、侵权内容和恶意攻击。有助于维护网络安全、保护知识产权、提升公众信任度,并为相关政策制定提供参考。

📄 摘要(原文)

Advances in AI-generated content have led to wide adoption of large language models, diffusion-based visual generators, and synthetic audio tools. However, these developments raise critical concerns about misinformation, copyright infringement, security threats, and the erosion of public trust. In this paper, we explore an extensive range of methods designed to detect and mitigate AI-generated textual, visual, and audio content. We begin by discussing motivations and potential impacts associated with AI-based content generation, including real-world risks and ethical dilemmas. We then outline detection techniques spanning observation-based strategies, linguistic and statistical analysis, model-based pipelines, watermarking and fingerprinting, as well as emergent ensemble approaches. We also present new perspectives on robustness, adaptation to rapidly improving generative architectures, and the critical role of human-in-the-loop verification. By surveying state-of-the-art research and highlighting case studies in academic, journalistic, legal, and industrial contexts, this paper aims to inform robust solutions and policymaking. We conclude by discussing open challenges, including adversarial transformations, domain generalization, and ethical concerns, thereby offering a holistic guide for researchers, practitioners, and regulators to preserve content authenticity in the face of increasingly sophisticated AI-generated media.