Bridging the Linguistic Divide: A Survey on Leveraging Large Language Models for Machine Translation

作者: Baban Gain, Dibyanayan Bandyopadhyay, Asif Ekbal, Trilok Nath Singh

分类: cs.CL, cs.AI

发布日期: 2025-04-02 (更新: 2026-01-12)

💡 一句话要点

综述:利用大型语言模型弥合机器翻译的语言鸿沟

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 机器翻译 低资源翻译 提示学习 强化学习 上下文学习 偏好对齐

📋 核心要点

- 传统机器翻译依赖监督学习,缺乏对上下文和人类偏好的有效利用,导致翻译质量受限。

- 该综述探讨了如何利用LLM的指令遵循、上下文学习和偏好对齐能力来改进机器翻译。

- 综述分析了各种LLM在机器翻译中的应用,包括低资源翻译、文档级翻译和评估方法。

📝 摘要(中文)

大型语言模型(LLM)正迅速重塑机器翻译(MT)领域,特别是通过将指令遵循、上下文学习和基于偏好的对齐引入到传统的监督编码器-解码器范式中。本综述全面且最新地概述了如何在各种数据机制、语言和应用场景中利用LLM进行MT。我们系统地分析了基于提示的方法、参数高效和完全微调策略、合成数据生成、基于偏好的优化以及利用人类和弱监督反馈的强化学习。特别关注低资源翻译,我们考察了合成数据质量、多样性和偏好信号的作用,以及当前RLHF流程的局限性。我们进一步回顾了混合专家模型、以MT为中心的LLM和多语言对齐的最新进展,强调了可扩展性、专业化和可访问性之间的权衡。除了句子级翻译之外,我们还调研了新兴的文档级和语篇感知MT方法,这些方法表明,大多数方法通过结构化上下文选择、后编辑或重新排序来扩展句子级流程,而不是需要根本性的新数据机制或架构。最后,我们讨论了基于LLM的评估、其优势和偏差,以及它与学习指标并行的作用。总的来说,本综述将基于LLM的MT定位为传统MT系统的演变,其中收益越来越依赖于数据质量、偏好对齐和上下文利用,而不是仅仅依赖于规模,并概述了构建稳健、包容和可控的翻译系统的开放性挑战。

🔬 方法详解

问题定义:现有机器翻译系统,特别是基于监督学习的编码器-解码器模型,在处理低资源语言、捕捉上下文信息和对齐人类偏好方面存在局限性。这些系统往往依赖大规模平行语料库,难以适应新的领域和语言,并且缺乏对翻译质量细粒度的控制。

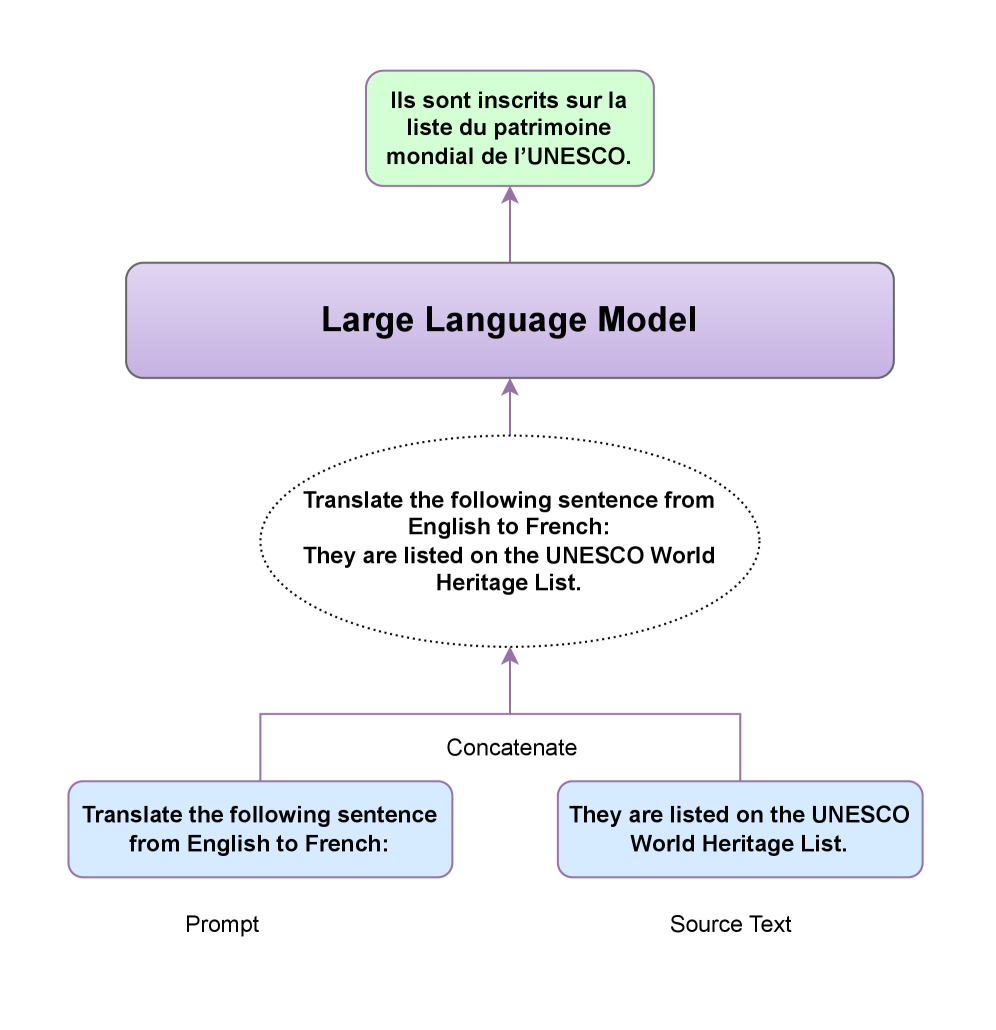

核心思路:利用大型语言模型(LLM)强大的语言理解和生成能力,通过指令提示、上下文学习和偏好优化等技术,改进机器翻译的质量、效率和可控性。核心在于将机器翻译任务转化为LLM能够理解和执行的指令,并利用人类反馈或弱监督信号来引导LLM生成更符合人类偏好的翻译结果。

技术框架:该综述涵盖了多种利用LLM进行机器翻译的技术框架,包括:1) 基于提示的方法,通过设计合适的提示词来引导LLM进行翻译;2) 参数高效微调策略,在预训练的LLM基础上进行少量参数的微调,以适应特定的翻译任务;3) 合成数据生成,利用LLM生成伪平行语料,用于训练或增强翻译模型;4) 基于偏好的优化,利用人类反馈或弱监督信号,通过强化学习等方法优化LLM的翻译结果;5) 混合专家模型,结合多个LLM的优势,提高翻译的准确性和流畅性。

关键创新:该综述的关键创新在于系统性地总结和分析了LLM在机器翻译中的应用,并指出了未来的研究方向。与传统的机器翻译方法相比,LLM能够更好地利用上下文信息、适应新的领域和语言,并且能够通过人类反馈进行优化。此外,LLM还能够生成更多样化和更自然的翻译结果。

关键设计:具体的技术细节包括:1) 提示词的设计,需要考虑如何清晰地表达翻译任务,并引导LLM生成高质量的翻译结果;2) 参数高效微调策略的选择,需要根据具体的任务和数据量进行调整;3) 合成数据的质量和多样性,需要保证合成数据能够有效地增强翻译模型;4) 偏好信号的获取和利用,需要设计合适的奖励函数和优化算法;5) 混合专家模型的结构和训练方法,需要考虑如何有效地结合多个LLM的优势。

🖼️ 关键图片

📊 实验亮点

该综述强调了数据质量、偏好对齐和上下文利用在LLM驱动的机器翻译中的重要性,指出未来的研究应侧重于构建更鲁棒、更具包容性和可控性的翻译系统。它还讨论了LLM在机器翻译评估中的作用,以及其固有的偏见。

🎯 应用场景

该研究成果可广泛应用于机器翻译领域,特别是在低资源语言翻译、文档级翻译和个性化翻译等方面。通过利用LLM,可以显著提高翻译质量和效率,降低翻译成本,并为跨语言交流提供更便捷的工具。未来,该技术有望应用于智能客服、跨境电商、国际会议等多个领域。

📄 摘要(原文)

Large Language Models (LLMs) are rapidly reshaping machine translation (MT), particularly by introducing instruction-following, in-context learning, and preference-based alignment into what has traditionally been a supervised encoder-decoder paradigm. This survey provides a comprehensive and up-to-date overview of how LLMs are being leveraged for MT across data regimes, languages, and application settings. We systematically analyze prompting-based methods, parameter-efficient and full fine-tuning strategies, synthetic data generation, preference-based optimization, and reinforcement learning with human and weakly supervised feedback. Special attention is given to low-resource translation, where we examine the roles of synthetic data quality, diversity, and preference signals, as well as the limitations of current RLHF pipelines. We further review recent advances in Mixture-of-Experts models, MT-focused LLMs, and multilingual alignment, highlighting trade-offs between scalability, specialization, and accessibility. Beyond sentence-level translation, we survey emerging document-level and discourse-aware MT methods with LLMs, showing that most approaches extend sentence-level pipelines through structured context selection, post-editing, or reranking rather than requiring fundamentally new data regimes or architectures. Finally, we discuss LLM-based evaluation, its strengths and biases, and its role alongside learned metrics. Overall, this survey positions LLM-based MT as an evolution of traditional MT systems, where gains increasingly depend on data quality, preference alignment, and context utilization rather than scale alone, and outlines open challenges for building robust, inclusive, and controllable translation systems.