ToolACE-R: Model-aware Iterative Training and Adaptive Refinement for Tool Learning

作者: Xingshan Zeng, Weiwen Liu, Xu Huang, Zezhong Wang, Lingzhi Wang, Liangyou Li, Yasheng Wang, Lifeng Shang, Xin Jiang, Ruiming Tang, Qun Liu

分类: cs.CL, cs.AI, cs.LG

发布日期: 2025-04-02 (更新: 2026-01-10)

备注: Accepted by AAAI2026

💡 一句话要点

ToolACE-R:面向工具学习的模型感知迭代训练与自适应精炼框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 工具学习 大型语言模型 迭代训练 自适应精炼 模型感知 自反馈 智能助手

📋 核心要点

- 现有工具学习方法主要关注数据合成以微调LLM,忽略了如何充分激发模型的潜力。

- ToolACE-R通过模型感知的迭代训练和自适应精炼,逐步调整训练样本并优化模型。

- 实验表明,ToolACE-R在多个基准数据集上表现出竞争力,并通过自适应精炼进一步提升性能。

📝 摘要(中文)

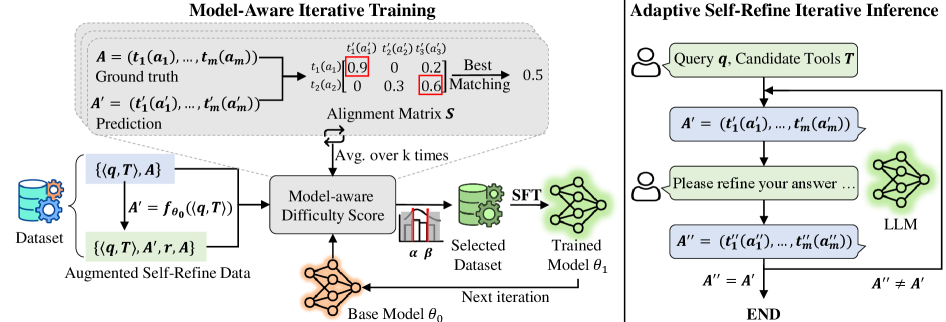

本文提出ToolACE-R,一个新颖的工具学习框架,包含模型感知的迭代训练和自适应精炼。ToolACE-R采用模型感知的迭代训练过程,基于模型不断发展的能力逐步调整训练样本,以最大化其潜力。此外,它还包含自精炼训练语料库,强调LLM迭代改进工具调用的能力,无需外部反馈即可优化性能。进一步地,我们引入自适应自精炼机制,用于高效的测试时扩展,训练后的模型可以自主决定何时停止迭代过程。在多个基准数据集上进行的大量实验表明,ToolACE-R与先进的基于API的模型相比,实现了具有竞争力的性能。通过自适应自精炼,工具调用性能可以得到进一步有效提升。这些结果突出了ToolACE-R的有效性和泛化性,为更高效和可扩展的工具学习提供了一个有希望的方向。

🔬 方法详解

问题定义:现有工具学习方法主要依赖于数据合成来微调大型语言模型(LLMs),以使其能够有效地调用外部工具。然而,这些方法往往忽略了如何充分利用模型自身的潜力,即如何根据模型的能力演进动态地调整训练过程,从而导致模型性能提升受限。此外,缺乏有效的自反馈机制使得模型难以在没有外部干预的情况下迭代改进工具调用。

核心思路:ToolACE-R的核心思路是通过模型感知的迭代训练和自适应精炼来解决上述问题。模型感知的迭代训练旨在根据模型在训练过程中的能力变化,动态调整训练样本,从而更有效地训练模型。自适应精炼则允许模型在测试时自主决定何时停止迭代改进,从而在性能和效率之间取得平衡。

技术框架:ToolACE-R框架主要包含两个阶段:模型感知的迭代训练和自适应自精炼。在模型感知的迭代训练阶段,首先使用初始数据集训练模型,然后根据模型的表现调整训练数据,例如增加模型难以处理的样本。这个过程迭代进行,直到模型达到预定的性能指标。在自适应自精炼阶段,模型在测试时可以迭代地改进其工具调用,每次迭代都基于前一次迭代的结果。模型使用一个自适应机制来决定何时停止迭代,该机制考虑了迭代次数和性能提升等因素。

关键创新:ToolACE-R的关键创新在于其模型感知的迭代训练和自适应自精炼机制。模型感知的迭代训练能够更有效地利用训练数据,并根据模型的能力演进动态调整训练过程。自适应自精炼则允许模型在测试时自主决定何时停止迭代改进,从而在性能和效率之间取得平衡。与现有方法相比,ToolACE-R不需要外部反馈即可进行迭代改进,并且能够更有效地利用模型自身的潜力。

关键设计:ToolACE-R的关键设计包括:1) 模型感知的数据选择策略,用于在每次迭代中选择最有价值的训练样本;2) 自精炼训练语料库,用于训练模型迭代改进工具调用的能力;3) 自适应停止机制,用于在测试时决定何时停止迭代改进。具体的参数设置和损失函数等细节取决于具体的模型和任务,但总体目标是最大化模型的性能,同时最小化计算成本。

🖼️ 关键图片

📊 实验亮点

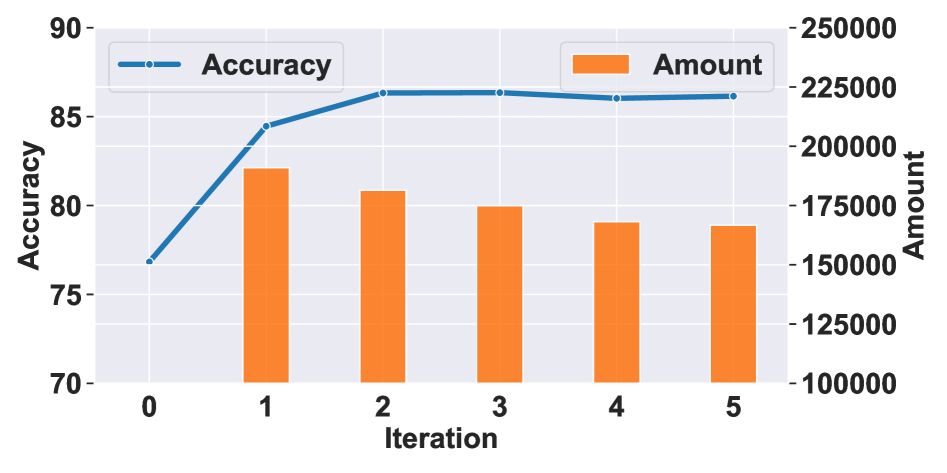

实验结果表明,ToolACE-R在多个基准数据集上取得了与先进的基于API的模型相媲美的性能。更重要的是,通过自适应自精炼,ToolACE-R能够进一步提升工具调用性能,而无需额外的外部反馈。这些结果验证了ToolACE-R的有效性和泛化性,并表明其为工具学习提供了一个有希望的方向。

🎯 应用场景

ToolACE-R具有广泛的应用前景,例如智能助手、自动化流程、科学研究等领域。它可以帮助LLM更有效地利用外部工具来解决复杂的用户任务,提高工作效率和问题解决能力。未来,ToolACE-R可以进一步扩展到更多领域,例如机器人控制、医疗诊断等,为各行各业带来智能化变革。

📄 摘要(原文)

Tool learning, which allows Large Language Models (LLMs) to leverage external tools for solving complex user tasks, has emerged as a promising avenue for extending model capabilities. However, existing approaches primarily focus on data synthesis for fine-tuning LLMs to invoke tools effectively, largely ignoring how to fully stimulate the potential of the model. In this paper, we propose ToolACE-R, a novel framework that includes both model-aware iterative training and adaptive refinement for tool learning. ToolACE-R features a model-aware iterative training procedure that progressively adjust training samples based on the model's evolving capabilities to maximize its potential. Additionally, it incorporates self-refinement training corpus which emphasizes LLM's ability to iteratively refine their tool calls, optimizing performance without requiring external feedback. Furthermore, we introduce adaptive self-refinement mechanism for efficient test-time scaling, where the trained model can autonomously determine when to stop the process based on iterative self-refinement. We conduct extensive experiments across several benchmark datasets, showing that ToolACE-R achieves competitive performance compared to advanced API-based models. The performance of tool invocation can be further improved efficiently through adaptive self-refinement. These results highlight the effectiveness and generalizability of ToolACE-R, offering a promising direction for more efficient and scalable tool learning.