Adaptive Rectification Sampling for Test-Time Compute Scaling

作者: Zhendong Tan, Xingjun Zhang, Chaoyi Hu, Yancheng Pan, Shaoxun Wang

分类: cs.CL, cs.AI

发布日期: 2025-04-02 (更新: 2025-09-30)

💡 一句话要点

提出自适应修正采样(AR-Sampling),提升LLM在推理任务中的细粒度纠错能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 思维链 自适应修正 过程监督奖励模型 推理任务 测试时扩展 细粒度纠错

📋 核心要点

- 现有CoT方法在测试时扩展中存在token浪费问题,尤其是在推理步骤已经正确的情况下,自我修正反而降低效率。

- AR-Sampling的核心思想是利用过程监督奖励模型(PRM)作为验证器,引导LLM在推理的适当步骤进行自适应的自我修正。

- 在GSM8K和MATH500数据集上的实验表明,AR-Sampling能提升模型在细粒度推理上的准确性,并控制额外token的生成数量。

📝 摘要(中文)

OpenAI-o1和DeepSeek-R1等模型表明,测试时扩展能显著提升模型性能,尤其是在逻辑推理等复杂任务中。常见的测试时扩展方法包括生成更多的思维链(CoT)或更长的CoT并进行自我修正。然而,虽然自我修正可以提高性能,但如果推理步骤已经正确,可能会导致大量的token浪费并降低CoT的可读性。为了证明大型语言模型(LLM)可以在更细粒度的层面上纠正错误,我们提出了自适应修正采样(AR-Sampling),它可以引导LLM在适当的步骤进行自我修正。AR-Sampling利用过程监督奖励模型(PRM)作为验证器,并构建触发语句来引导模型进行自适应的步骤级反思。在GSM8K和MATH500上的实验表明,我们的方法使模型能够在更细粒度的层面上进行反思,提高了解的准确性,同时生成合理数量的额外token。

🔬 方法详解

问题定义:现有的大型语言模型在进行复杂推理任务时,通常采用生成思维链(CoT)并进行自我修正的方法来提升性能。然而,这种方法存在一个明显的痛点:当推理过程中的某些步骤已经正确时,模型仍然会进行不必要的修正,导致token浪费,降低效率,并可能引入新的错误。因此,如何让模型在需要修正的步骤上进行精准的自我修正,避免不必要的计算开销,是本文要解决的核心问题。

核心思路:本文的核心思路是引入一个过程监督奖励模型(PRM)作为验证器,用于评估推理过程中的每一步是否正确。基于PRM的评估结果,模型可以自适应地决定是否需要对当前步骤进行反思和修正。这种方法避免了对所有步骤都进行无差别修正,从而提高了效率,并降低了引入新错误的风险。

技术框架:AR-Sampling的整体框架包含以下几个主要模块:1) 推理过程生成:使用LLM生成初始的思维链。2) 过程监督奖励模型(PRM):PRM对思维链中的每一步进行评估,给出奖励信号,指示该步骤是否需要修正。3) 触发语句构建:根据PRM的奖励信号,构建触发语句,引导LLM对需要修正的步骤进行反思。4) 自适应修正:LLM根据触发语句,对需要修正的步骤进行重新推理,生成修正后的结果。5) 结果整合:将修正后的结果整合到原始思维链中,得到最终的推理结果。

关键创新:AR-Sampling的关键创新在于其自适应的修正机制。与传统的CoT方法不同,AR-Sampling不是对整个思维链进行无差别修正,而是根据PRM的评估结果,有选择性地对需要修正的步骤进行反思。这种方法实现了更细粒度的控制,提高了修正的效率和准确性。

关键设计:PRM的设计至关重要,需要能够准确评估推理步骤的正确性。触发语句的设计也需要精心考虑,既要能够引导LLM进行反思,又不能引入过多的噪声。此外,还需要设计合适的策略来整合修正后的结果,确保最终推理结果的正确性。具体参数设置和损失函数等细节在论文中应该有更详细的描述(未知)。

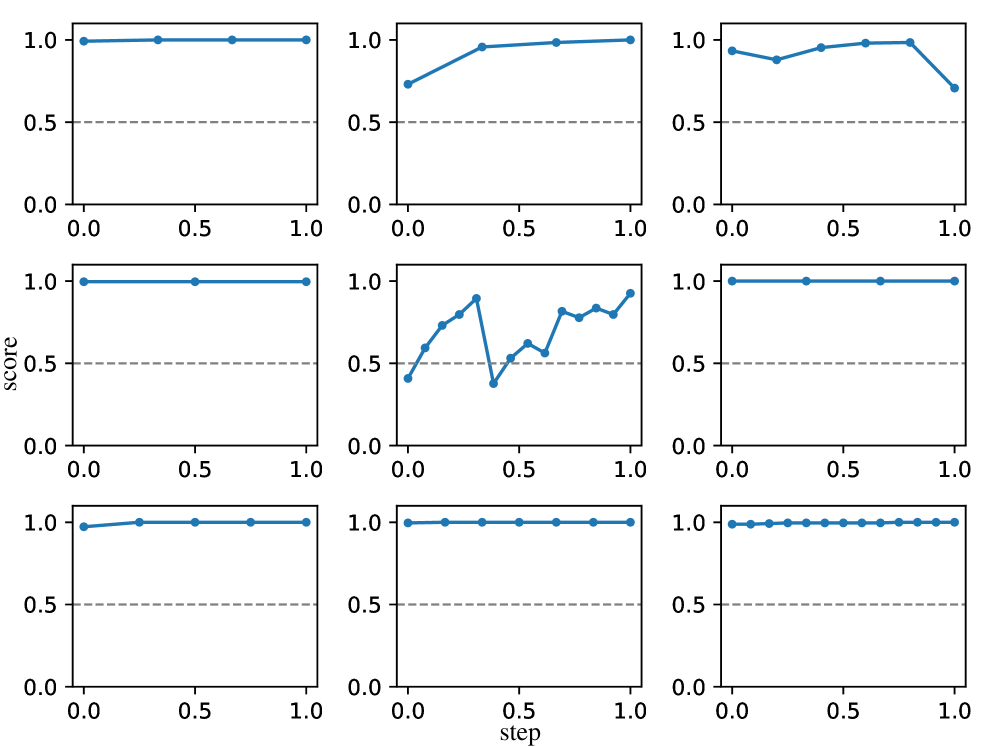

🖼️ 关键图片

📊 实验亮点

实验结果表明,AR-Sampling在GSM8K和MATH500数据集上均取得了显著的性能提升。具体而言,AR-Sampling能够在生成合理数量的额外token的情况下,提高解题的准确率。与传统的CoT方法相比,AR-Sampling能够更有效地利用计算资源,并获得更好的推理效果。具体的性能数据和提升幅度在论文中应该有更详细的描述(未知)。

🎯 应用场景

AR-Sampling具有广泛的应用前景,可以应用于各种需要复杂推理的任务中,例如数学问题求解、代码生成、知识图谱推理等。通过提高推理的准确性和效率,AR-Sampling可以帮助LLM更好地解决实际问题,并降低计算成本。未来,该方法有望应用于智能客服、自动驾驶等领域。

📄 摘要(原文)

The newly released OpenAI-o1 and DeepSeek-R1 have demonstrated that test-time scaling can significantly improve model performance, especially in complex tasks such as logical reasoning. Common test-time scaling methods involve generating more chains of thought (CoTs) or longer CoTs with self-correction. However, while self-correction can improve performance, it may lead to significant token waste and reduce readability of the CoT if the reasoning steps are already correct. To demonstrate that large language models (LLMs) can rectify errors at a more fine-grained level, we propose Adaptive Rectification Sampling (AR-Sampling), which can guide the LLMs to self-correction at the appropriate step. AR-Sampling leverages a process-supervised reward model (PRM) as a verifier and constructed trigger sentences to guide the model in adaptive step-level rethinking. Through the experiments on GSM8K and MATH500, it indicates that our approach enables the models to rethink in more fine-grained level, improving the accuracy of solutions, while generating a reasonable number of additional tokens.