Harnessing the Reasoning Economy: A Survey of Efficient Reasoning for Large Language Models

作者: Rui Wang, Hongru Wang, Boyang Xue, Jianhui Pang, Shudong Liu, Yi Chen, Jiahao Qiu, Derek Fai Wong, Heng Ji, Kam-Fai Wong

分类: cs.CL, cs.AI

发布日期: 2025-03-31

备注: In Progress; Paper list Repo: https://github.com/DevoAllen/Awesome-Reasoning-Economy-Papers

💡 一句话要点

综述:探索大语言模型中的高效推理经济性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 推理经济性 高效推理 计算成本 系统1推理 系统2推理 综述 模型优化

📋 核心要点

- 现有大语言模型在复杂推理任务中面临计算成本高昂的问题,需要平衡性能与计算资源。

- 该综述旨在全面分析大语言模型推理过程中的经济性,并探索提升推理效率的潜在解决方案。

- 通过分析推理低效的原因、不同推理模式的行为,并提供可操作的建议,推动该领域的研究进展。

📝 摘要(中文)

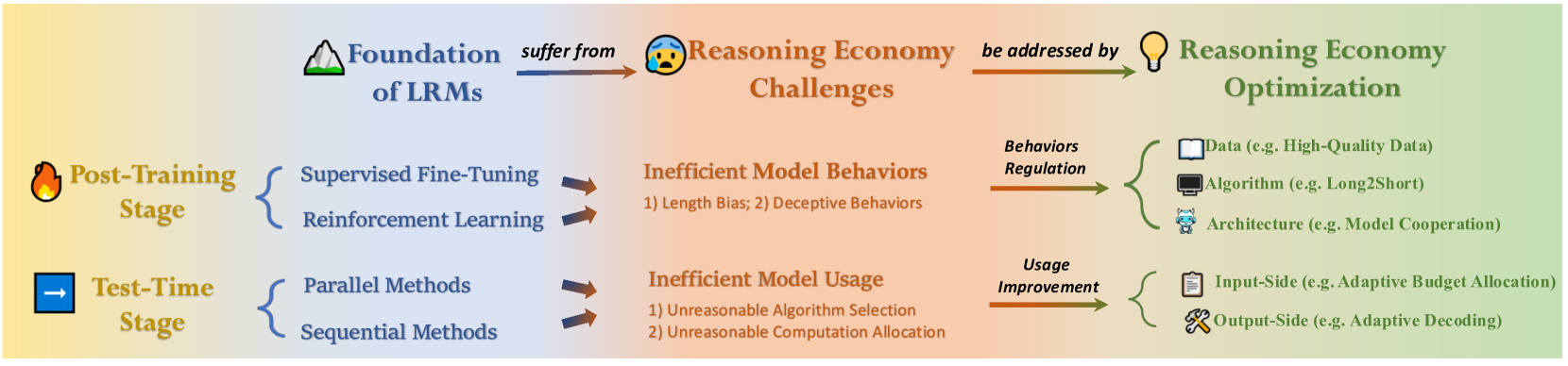

大语言模型(LLM)的最新进展显著增强了其执行复杂推理任务的能力,使其能够从快速直观的思考(系统1)过渡到缓慢而深入的推理(系统2)。虽然系统2推理提高了任务准确性,但由于其缓慢的思考性质以及低效或不必要的推理行为,通常会产生巨大的计算成本。相比之下,系统1推理在计算上是高效的,但会导致次优的性能。因此,平衡性能(收益)和计算成本(预算)之间的权衡至关重要,从而产生了推理经济性的概念。在本综述中,我们对LLM后训练和测试时推理阶段的推理经济性进行了全面分析,包括i)推理效率低下的原因,ii)不同推理模式的行为分析,以及iii)实现推理经济性的潜在解决方案。通过提供可操作的见解并强调未解决的挑战,我们旨在阐明提高LLM推理经济性的策略,从而为推进这一快速发展领域的研究提供有价值的资源。我们还提供了一个公共存储库,以不断跟踪这一快速发展领域的进展。

🔬 方法详解

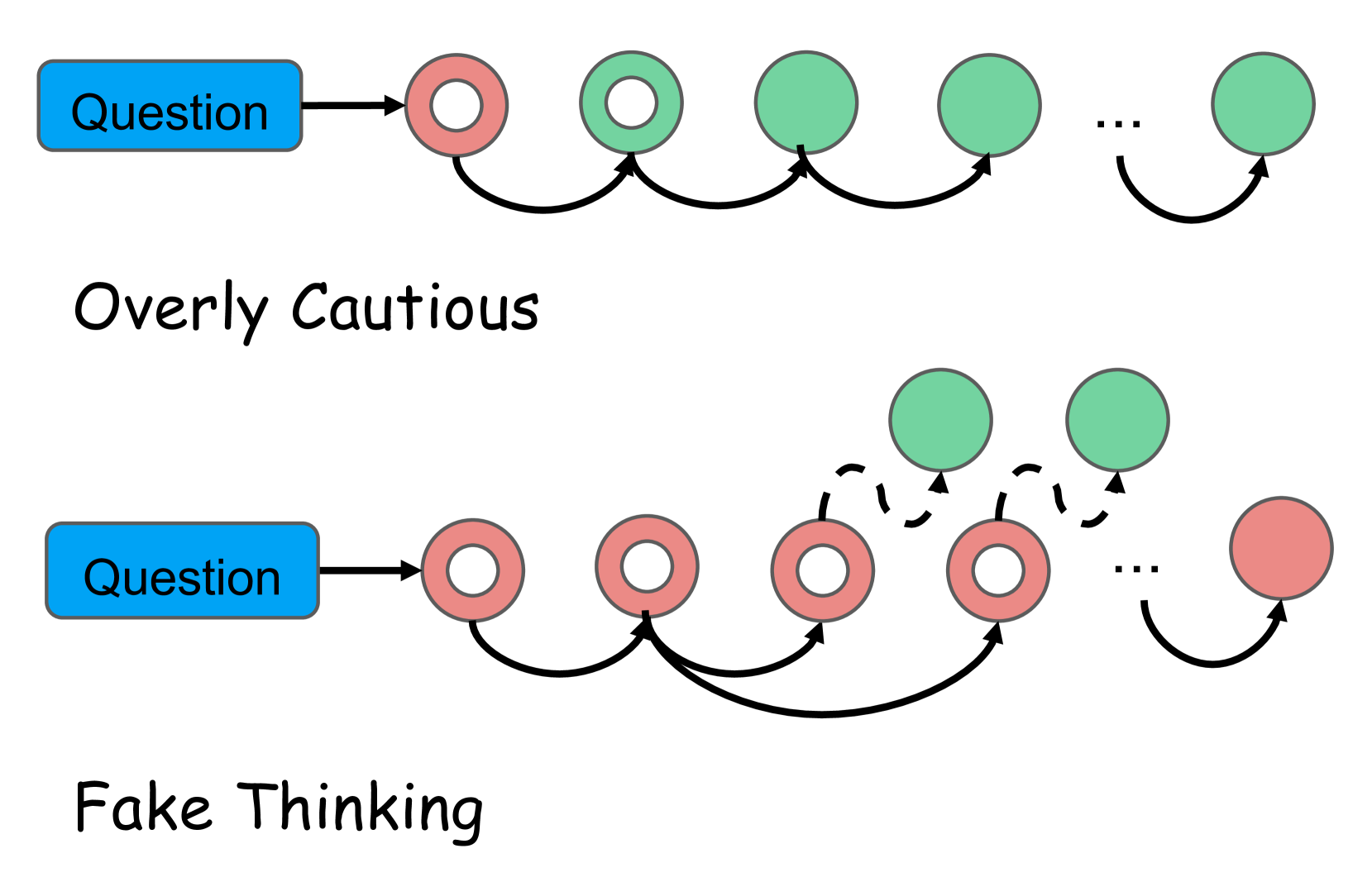

问题定义:论文旨在解决大语言模型在推理过程中存在的效率问题。现有方法,特别是依赖于“系统2”推理的策略,虽然能提高准确性,但计算成本过高。这种高成本源于推理过程的缓慢、不必要的步骤以及整体的低效性,使得在实际应用中难以部署。因此,如何在保证性能的同时降低计算成本,成为了一个关键的挑战。

核心思路:论文的核心思路是深入研究和分析大语言模型推理过程中的“推理经济性”。这意味着需要理解推理效率低下的根本原因,分析不同推理模式的行为特征,并在此基础上探索能够优化推理过程、降低计算成本的潜在解决方案。通过对推理过程进行精细化管理,实现性能与成本之间的最佳平衡。

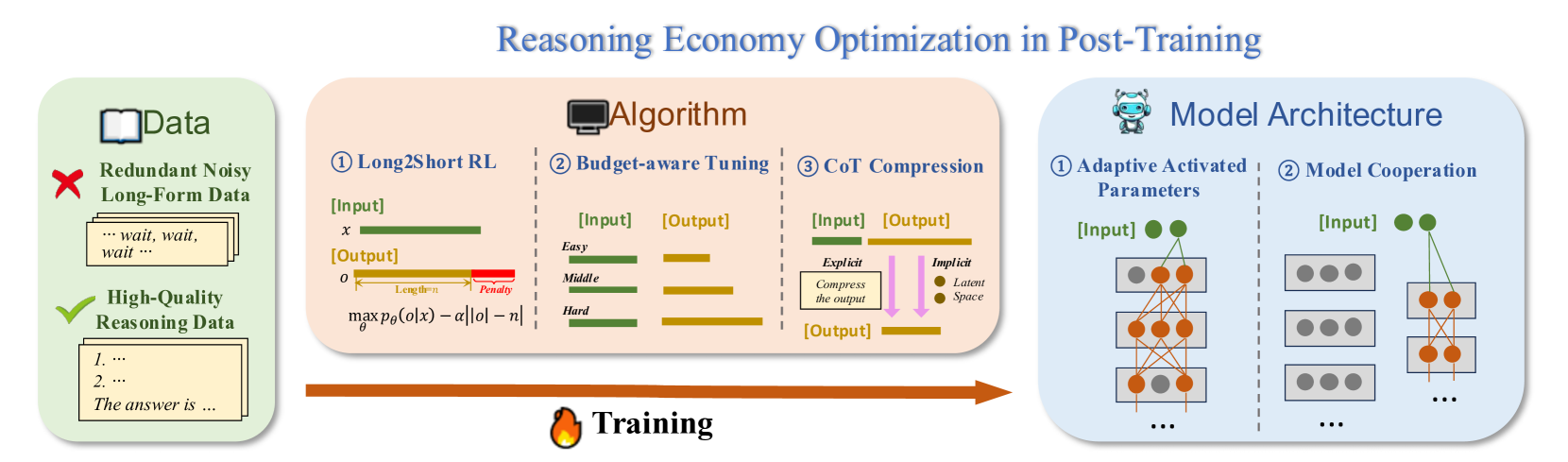

技术框架:该综述论文并没有提出一个具体的算法框架,而是对现有研究进行了系统性的梳理和分析。其框架主要体现在对推理经济性的三个关键方面的考察:1)推理效率低下的原因分析;2)不同推理模式(如系统1和系统2)的行为分析;3)实现推理经济性的潜在解决方案。通过对这三个方面的深入探讨,为未来的研究方向提供了指导。

关键创新:该综述的关键创新在于提出了“推理经济性”这一概念,并将其作为评估和优化大语言模型推理过程的重要指标。它强调了在追求高性能的同时,必须关注计算成本,并探索如何在两者之间取得平衡。这种以经济性为导向的视角,为大语言模型的研究提供了一个新的维度。

关键设计:由于这是一篇综述论文,因此没有具体的参数设置、损失函数或网络结构等技术细节。其关键设计体现在对现有研究的分类和总结,以及对未来研究方向的展望。例如,论文可能会讨论如何通过知识蒸馏、模型剪枝等技术来降低模型的计算复杂度,或者如何设计更高效的推理算法来减少不必要的计算步骤。这些讨论为未来的研究提供了重要的参考。

🖼️ 关键图片

📊 实验亮点

该综述重点分析了推理效率低下的原因,并对不同推理模式的行为进行了深入分析。它还总结了实现推理经济性的潜在解决方案,为未来的研究提供了有价值的参考。通过强调推理经济性的重要性,该综述为大语言模型的研究提供了一个新的视角。

🎯 应用场景

该研究成果对大语言模型的实际应用具有重要意义。通过提高推理经济性,可以降低模型部署和运行的成本,使其更容易在资源受限的环境中使用。潜在应用领域包括智能客服、自动翻译、内容生成等,有助于推动人工智能技术的普及和发展。

📄 摘要(原文)

Recent advancements in Large Language Models (LLMs) have significantly enhanced their ability to perform complex reasoning tasks, transitioning from fast and intuitive thinking (System 1) to slow and deep reasoning (System 2). While System 2 reasoning improves task accuracy, it often incurs substantial computational costs due to its slow thinking nature and inefficient or unnecessary reasoning behaviors. In contrast, System 1 reasoning is computationally efficient but leads to suboptimal performance. Consequently, it is critical to balance the trade-off between performance (benefits) and computational costs (budgets), giving rise to the concept of reasoning economy. In this survey, we provide a comprehensive analysis of reasoning economy in both the post-training and test-time inference stages of LLMs, encompassing i) the cause of reasoning inefficiency, ii) behavior analysis of different reasoning patterns, and iii) potential solutions to achieve reasoning economy. By offering actionable insights and highlighting open challenges, we aim to shed light on strategies for improving the reasoning economy of LLMs, thereby serving as a valuable resource for advancing research in this evolving area. We also provide a public repository to continually track developments in this fast-evolving field.