Focus Directions Make Your Language Models Pay More Attention to Relevant Contexts

作者: Youxiang Zhu, Ruochen Li, Danqing Wang, Daniel Haehn, Xiaohui Liang

分类: cs.CL

发布日期: 2025-03-30

💡 一句话要点

提出焦点方向,提升长文本语言模型对相关上下文的关注度

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 长文本语言模型 注意力机制 上下文学习 焦点方向 任务对齐

📋 核心要点

- 长文本LLM易受无关信息干扰,根本原因在于注意力机制未能有效聚焦关键上下文。

- 论文提出“焦点方向”概念,通过调整注意力头的键和查询激活,引导模型关注相关上下文。

- 实验表明,该方法能有效缓解长文本LLM的任务对齐问题,提升模型在长文本任务上的性能。

📝 摘要(中文)

长文本大型语言模型(LLM)容易被无关的上下文分散注意力,但造成这种现象的原因尚不清楚。本文首先识别出上下文头,这是一组控制LLM整体注意力的特殊注意力头。然后,证明了当上下文头未能充分关注相关上下文时,就会出现注意力分散,并且可以通过增加对这些上下文的关注来缓解。进一步地,本文识别出焦点方向,它位于这些头的键和查询激活中,使它们能够更多地关注相关上下文,而无需明确指定哪个上下文是相关的。对各种长文本任务进行了全面评估,发现焦点方向有助于缓解长文本LLM的任务对齐问题。研究结果有助于推动长文本LLM对齐的进一步研究。

🔬 方法详解

问题定义:长文本语言模型在处理长序列时,容易受到无关上下文的干扰,导致性能下降。现有的方法难以有效区分相关和无关信息,使得模型无法专注于关键信息,造成任务对齐问题。

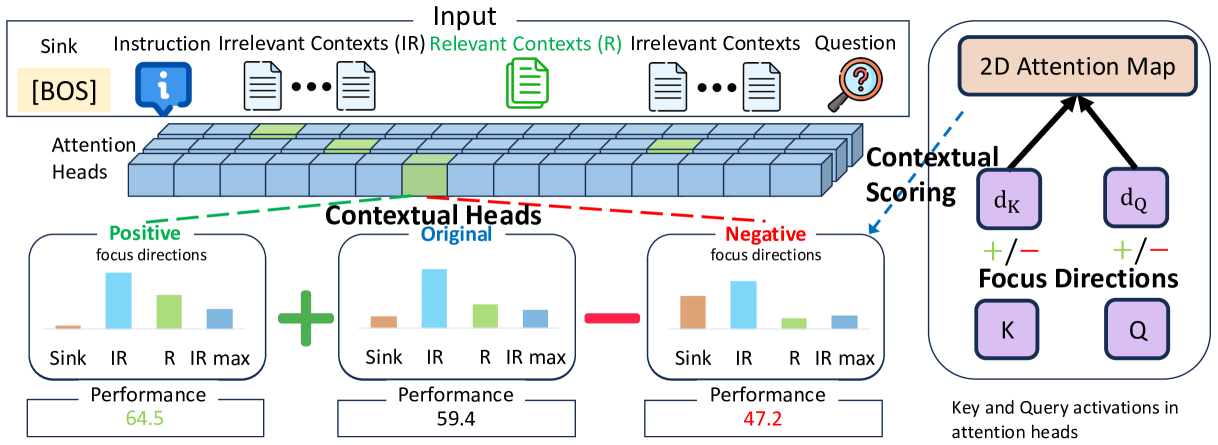

核心思路:论文的核心思路是识别并调整影响注意力分配的关键参数,即“焦点方向”。通过在注意力头的键(Key)和查询(Query)激活中找到这些方向,并对其进行调整,可以引导模型更多地关注相关上下文,从而减少无关信息的干扰。

技术框架:该方法首先识别出控制LLM整体注意力的“上下文头”。然后,通过分析这些头的键和查询激活,找到“焦点方向”。最后,通过调整这些方向,使模型能够更有效地关注相关上下文。整体流程包括:1) 识别上下文头;2) 确定焦点方向;3) 调整注意力分配。

关键创新:该方法最重要的创新点在于提出了“焦点方向”的概念,并证明了通过调整注意力头的键和查询激活,可以有效地引导模型关注相关上下文。与现有方法相比,该方法不需要显式地指定哪些上下文是相关的,而是通过学习到的方向来实现注意力分配。

关键设计:论文的关键设计包括:1) 上下文头的识别方法(具体方法未知);2) 焦点方向的确定方法(具体方法未知);3) 如何调整焦点方向以优化注意力分配(具体方法未知)。这些细节决定了该方法的有效性和适用性。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了“焦点方向”的有效性,表明该方法能够缓解长文本LLM的任务对齐问题。具体的性能数据、对比基线和提升幅度等信息未知,但结论是该方法能够帮助模型更好地关注相关上下文,从而提升在长文本任务上的表现。

🎯 应用场景

该研究成果可应用于各种需要处理长文本的场景,例如文档摘要、机器翻译、问答系统等。通过提升模型对相关上下文的关注度,可以提高这些应用在处理长文本时的准确性和效率。未来,该方法有望进一步提升长文本LLM的性能,使其更好地服务于实际应用。

📄 摘要(原文)

Long-context large language models (LLMs) are prone to be distracted by irrelevant contexts. The reason for distraction remains poorly understood. In this paper, we first identify the contextual heads, a special group of attention heads that control the overall attention of the LLM. Then, we demonstrate that distraction arises when contextual heads fail to allocate sufficient attention to relevant contexts and can be mitigated by increasing attention to these contexts. We further identify focus directions, located at the key and query activations of these heads, which enable them to allocate more attention to relevant contexts without explicitly specifying which context is relevant. We comprehensively evaluate the effect of focus direction on various long-context tasks and find out focus directions could help to mitigate the poor task alignment of the long-context LLMs. We believe our findings could promote further research on long-context LLM alignment.