Cocktail: Chunk-Adaptive Mixed-Precision Quantization for Long-Context LLM Inference

作者: Wei Tao, Bin Zhang, Xiaoyang Qu, Jiguang Wan, Jianzong Wang

分类: cs.CL

发布日期: 2025-03-30

备注: Accepted by the Design, Automation, and Test in Europe 2025 (DATE 2025)

💡 一句话要点

Cocktail:针对长文本LLM推理的块自适应混合精度量化

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 长文本LLM KV缓存 混合精度量化 块自适应 推理加速

📋 核心要点

- 现有方法基于token粒度量化KV缓存,存在搜索耗时和硬件效率低下的问题,限制了长文本LLM的推理效率。

- Cocktail采用块自适应混合精度量化,通过块级量化搜索和块级KV缓存计算优化KV缓存,提升推理效率。

- 实验结果表明,Cocktail在多种模型和数据集上优于现有KV缓存量化方法,有效降低了推理延迟和内存占用。

📝 摘要(中文)

大型语言模型(LLM)处理的上下文越来越长,但过长的上下文会导致难以忍受的推理延迟和GPU内存占用。现有方法基于token粒度对LLM中的键值(KV)缓存进行混合精度量化,搜索过程耗时且计算效率低。本文提出了一种名为Cocktail的新方法,采用块自适应混合精度量化来优化KV缓存。Cocktail包含两个模块:块级量化搜索和块级KV缓存计算。块级量化搜索基于上下文块和查询之间的相似度快速确定KV缓存块的最佳位宽配置,从而保持模型精度。此外,块级KV缓存计算在量化之前重新排序KV缓存块,避免了推理计算中混合精度量化导致的硬件效率低下。大量实验表明,Cocktail在各种模型和数据集上优于最先进的KV缓存量化方法。

🔬 方法详解

问题定义:论文旨在解决长文本LLM推理过程中,由于KV缓存过大导致的推理延迟和GPU内存占用问题。现有基于token粒度的混合精度量化方法,在搜索最佳量化配置时计算开销大,并且混合精度量化后的数据排布不利于硬件加速,导致计算效率低下。

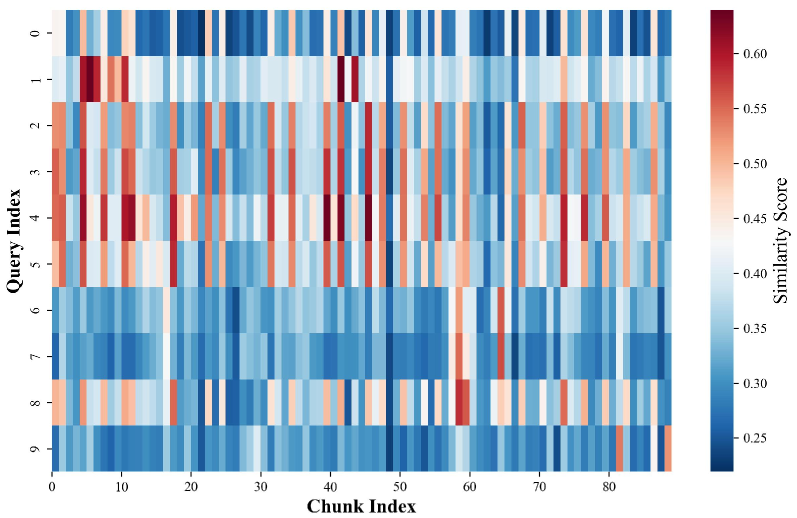

核心思路:论文的核心思路是将KV缓存划分为多个块,并根据每个块与当前查询的相似度,自适应地选择不同的量化位宽。通过块级量化,降低了搜索空间,加速了量化配置的确定。同时,通过重新排序KV缓存块,使得相同位宽的数据连续存储,从而提高硬件计算效率。

技术框架:Cocktail主要包含两个模块:块级量化搜索和块级KV缓存计算。首先,将上下文划分为多个块,并计算每个块与当前查询之间的相似度。然后,基于相似度,搜索每个块的最佳量化位宽。最后,在量化之前,重新排序KV缓存块,将相同位宽的块连续存储,并进行量化和推理计算。

关键创新:Cocktail的关键创新在于提出了块自适应的混合精度量化方法。与现有方法相比,Cocktail不再以token为粒度进行量化,而是以块为粒度,从而降低了搜索空间,加速了量化配置的确定。此外,Cocktail还通过重新排序KV缓存块,优化了数据排布,提高了硬件计算效率。

关键设计:块级量化搜索中,相似度度量方式的选择会影响量化效果。论文可能采用了余弦相似度或其他相似度度量方法。此外,如何根据相似度确定最佳量化位宽也是一个关键设计。论文可能采用了一种基于阈值的策略,或者采用了一种基于优化的方法。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了Cocktail的有效性。实验结果表明,Cocktail在多种模型和数据集上优于现有的KV缓存量化方法。具体的性能提升数据(例如,推理延迟降低百分比、内存占用减少百分比)需要在论文中查找。Cocktail在保持模型精度的前提下,显著降低了推理延迟和内存占用。

🎯 应用场景

Cocktail可应用于各种需要处理长文本的LLM推理场景,例如长文档摘要、长篇小说生成、代码生成等。通过降低推理延迟和内存占用,Cocktail可以提高LLM在资源受限设备上的部署能力,并降低云计算成本。该研究对于推动LLM在实际应用中的普及具有重要意义。

📄 摘要(原文)

Recently, large language models (LLMs) have been able to handle longer and longer contexts. However, a context that is too long may cause intolerant inference latency and GPU memory usage. Existing methods propose mixed-precision quantization to the key-value (KV) cache in LLMs based on token granularity, which is time-consuming in the search process and hardware inefficient during computation. This paper introduces a novel approach called Cocktail, which employs chunk-adaptive mixed-precision quantization to optimize the KV cache. Cocktail consists of two modules: chunk-level quantization search and chunk-level KV cache computation. Chunk-level quantization search determines the optimal bitwidth configuration of the KV cache chunks quickly based on the similarity scores between the corresponding context chunks and the query, maintaining the model accuracy. Furthermore, chunk-level KV cache computation reorders the KV cache chunks before quantization, avoiding the hardware inefficiency caused by mixed-precision quantization in inference computation. Extensive experiments demonstrate that Cocktail outperforms state-of-the-art KV cache quantization methods on various models and datasets.