The Reasoning-Memorization Interplay in Language Models Is Mediated by a Single Direction

作者: Yihuai Hong, Dian Zhou, Meng Cao, Lei Yu, Zhijing Jin

分类: cs.CL, cs.AI

发布日期: 2025-03-29

💡 一句话要点

揭示LLM推理与记忆间的线性特征,实现可控的性能提升

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 推理 记忆 线性特征 残差流

📋 核心要点

- 现有LLM在推理任务中过度依赖记忆,泛化能力受限,缺乏对推理与记忆切换机制的理解。

- 通过识别残差流中的线性特征,论文揭示了控制推理和记忆平衡的关键因素。

- 实验表明,操纵这些特征可以显著影响LLM在推理任务中的表现,提升问题解决能力。

📝 摘要(中文)

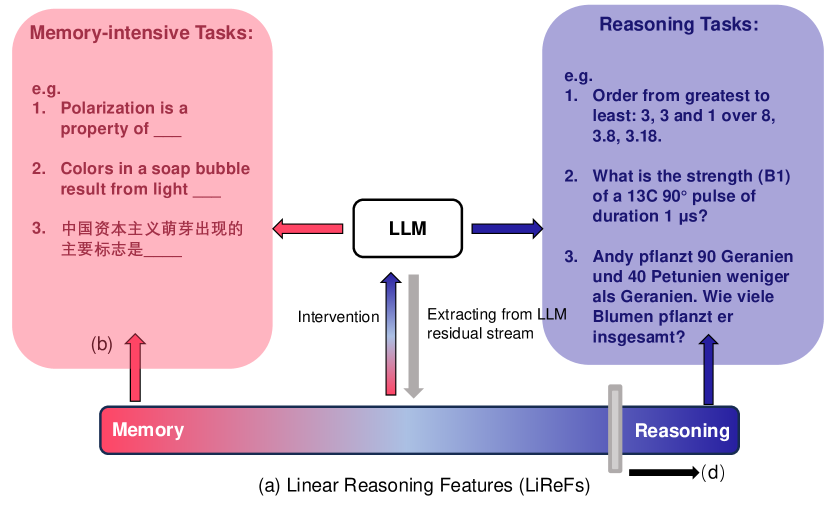

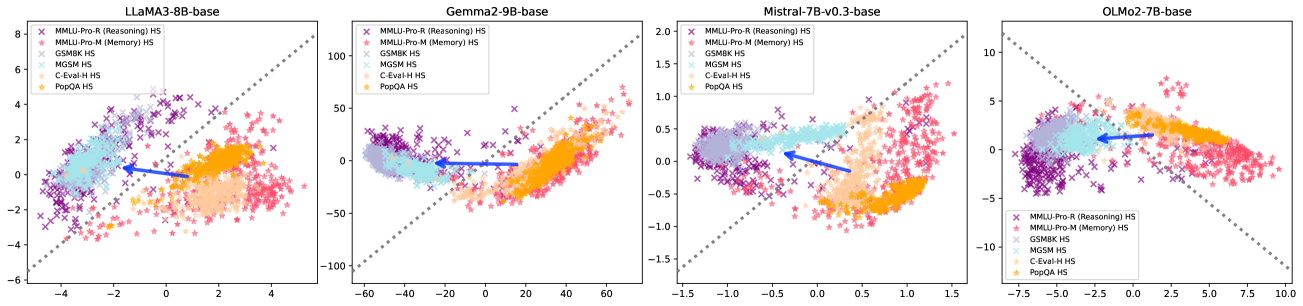

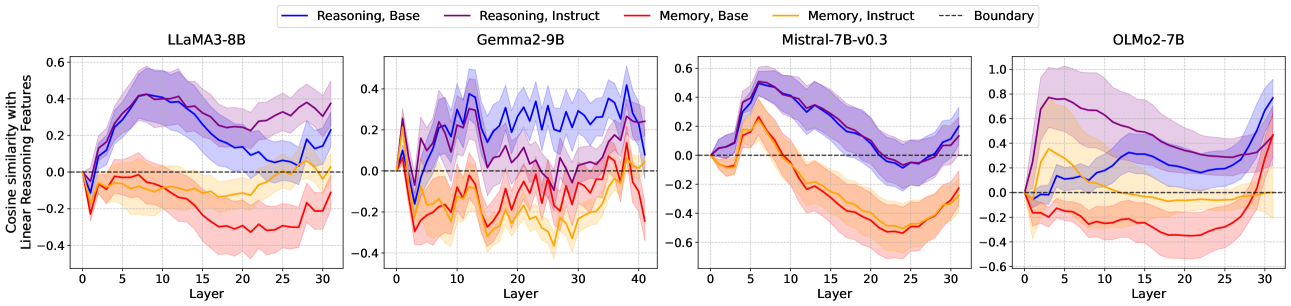

大型语言模型(LLM)在各种推理基准测试中表现出色,但先前的研究表明,它们有时难以泛化到未见过的问题,这可能是由于过度依赖记忆的训练样本。然而,LLM在文本生成过程中,推理和记忆之间切换的具体条件仍不清楚。本文通过识别模型残差流中的一组线性特征,对LLM的推理-记忆动态提供了一种机制性的理解,这些特征控制着真实推理和记忆回忆之间的平衡。这些特征不仅区分了推理任务和记忆密集型任务,还可以被操纵以因果地影响模型在推理任务中的性能。此外,我们表明,干预这些推理特征有助于模型在答案生成过程中更准确地激活最相关的解决问题的能力。我们的发现为LLM中推理和记忆的潜在机制提供了新的见解,并为开发更强大和可解释的生成式AI系统铺平了道路。

🔬 方法详解

问题定义:现有大型语言模型在推理任务中表现出色,但存在过度依赖记忆的问题,导致在未见过的任务上泛化能力不足。现有方法缺乏对LLM内部推理和记忆机制的深入理解,难以有效控制模型行为。

核心思路:论文的核心思路是识别并操纵LLM残差流中控制推理和记忆平衡的关键线性特征。通过干预这些特征,可以引导模型更多地进行推理,减少对记忆的依赖,从而提高泛化能力。这种方法旨在实现对LLM行为的更精细控制。

技术框架:该研究的技术框架主要包括以下几个步骤:1) 分析LLM在不同任务上的激活模式,区分推理任务和记忆密集型任务;2) 识别残差流中与推理和记忆相关的线性特征;3) 设计干预策略,操纵这些特征;4) 评估干预对模型性能的影响。整体流程旨在建立线性特征与模型行为之间的因果关系。

关键创新:该研究最重要的技术创新在于识别了LLM残差流中控制推理和记忆平衡的线性特征。与以往主要关注模型结构或训练数据的方法不同,该研究深入到模型内部,揭示了影响模型行为的关键因素。此外,通过操纵这些特征,实现了对模型推理能力的有效控制。

关键设计:论文的关键设计包括:1) 使用线性探针技术识别残差流中的线性特征;2) 设计特定的干预策略,例如直接修改特征的激活值;3) 使用因果干预方法评估干预效果,确保干预确实影响了模型的推理能力。具体的参数设置和网络结构细节可能依赖于所使用的LLM架构。

🖼️ 关键图片

📊 实验亮点

该研究通过实验验证了操纵残差流中的线性特征可以显著影响LLM在推理任务中的性能。具体而言,通过干预这些特征,模型在推理任务上的准确率得到了显著提升,并且能够更准确地激活解决问题的能力。实验结果表明,该方法能够有效地提高LLM的泛化能力和鲁棒性。

🎯 应用场景

该研究成果可应用于提升LLM在各种推理任务中的性能,例如问答系统、代码生成和文本摘要。通过控制推理和记忆的平衡,可以使LLM更加可靠和可控,减少幻觉和错误信息的产生。此外,该研究为开发更可解释的AI系统提供了新的思路,有助于理解LLM的内部工作机制。

📄 摘要(原文)

Large language models (LLMs) excel on a variety of reasoning benchmarks, but previous studies suggest they sometimes struggle to generalize to unseen questions, potentially due to over-reliance on memorized training examples. However, the precise conditions under which LLMs switch between reasoning and memorization during text generation remain unclear. In this work, we provide a mechanistic understanding of LLMs' reasoning-memorization dynamics by identifying a set of linear features in the model's residual stream that govern the balance between genuine reasoning and memory recall. These features not only distinguish reasoning tasks from memory-intensive ones but can also be manipulated to causally influence model performance on reasoning tasks. Additionally, we show that intervening in these reasoning features helps the model more accurately activate the most relevant problem-solving capabilities during answer generation. Our findings offer new insights into the underlying mechanisms of reasoning and memory in LLMs and pave the way for the development of more robust and interpretable generative AI systems.