3MDBench: Medical Multimodal Multi-agent Dialogue Benchmark

作者: Ivan Sviridov, Amina Miftakhova, Artemiy Tereshchenko, Galina Zubkova, Pavel Blinov, Andrey Savchenko

分类: cs.HC, cs.CL, cs.MA

发布日期: 2025-03-26 (更新: 2025-11-01)

备注: EMNLP 25 (main)

期刊: https://aclanthology.org/2025.emnlp-main.1353/

DOI: 10.18653/v1/2025.emnlp-main.1353

🔗 代码/项目: GITHUB

💡 一句话要点

提出3MDBench:用于评估医疗多模态多智能体对话的基准测试框架。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 远程医疗 大型视觉语言模型 多模态对话 基准测试 医疗诊断

📋 核心要点

- 现有大型视觉语言模型在医学领域的应用潜力未被充分挖掘,尤其是在结合准确诊断和专业对话的复杂远程医疗咨询方面。

- 3MDBench通过模拟患者代理和评估代理,构建了一个多智能体对话环境,用于评估LVLM在远程医疗场景下的诊断能力和对话质量。

- 实验结果表明,多模态对话和外部诊断信息能够显著提升LVLM的诊断准确率,验证了该基准测试的有效性。

📝 摘要(中文)

本文提出了3MDBench(医疗多模态多智能体对话基准测试),这是一个开源框架,用于模拟和评估基于大型视觉语言模型(LVLM)的远程医疗咨询。3MDBench通过基于性格的患者代理模拟患者的变异性,并通过评估代理评估诊断准确性和对话质量。它包含来自真实远程医疗交互的2996个案例,涵盖34种诊断,结合了文本和图像数据。实验研究比较了广泛使用的开源和闭源LVLM的诊断策略。结果表明,通过内部推理进行的多模态对话比非对话设置提高了6.5%的F1分数,突出了上下文感知、信息寻求式提问的重要性。此外,将诊断卷积神经网络的预测注入到LVLM的上下文中,可将F1分数提高高达20%。源代码可在https://github.com/univanxx/3mdbench获取。

🔬 方法详解

问题定义:现有的大型视觉语言模型(LVLM)在医学领域的应用,尤其是在远程医疗咨询中,面临着缺乏标准评估框架的问题。现有的方法难以模拟真实患者的多样性,也无法有效评估模型在诊断准确性和对话质量方面的综合能力。因此,如何构建一个能够全面评估LVLM在远程医疗场景下表现的基准测试框架是一个关键问题。

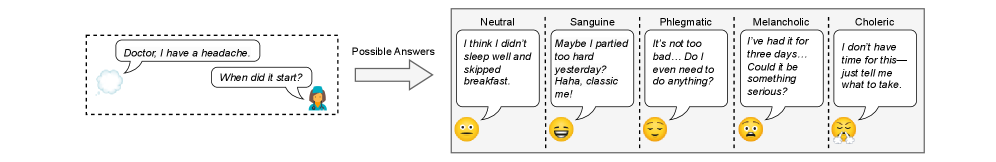

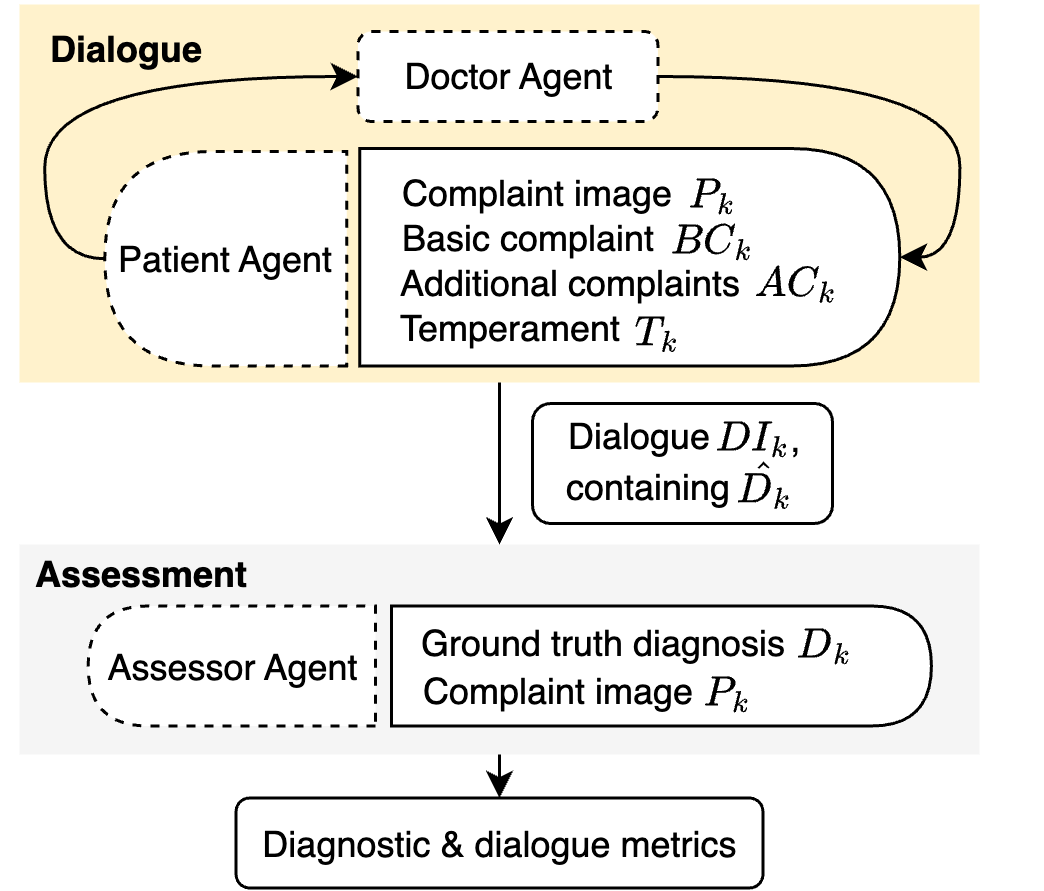

核心思路:3MDBench的核心思路是通过构建一个多智能体环境来模拟真实的远程医疗咨询过程。该环境包含患者代理和评估代理,患者代理负责模拟不同性格的患者,评估代理负责评估LVLM的诊断准确性和对话质量。通过这种方式,可以更全面地评估LVLM在远程医疗场景下的表现。

技术框架:3MDBench的整体框架包含以下几个主要模块:1) 数据集模块:包含来自真实远程医疗交互的文本和图像数据,涵盖多种诊断。2) 患者代理模块:基于性格模拟患者的变异性,提供不同的病史和症状描述。3) LVLM模块:待评估的大型视觉语言模型,负责进行诊断和对话。4) 评估代理模块:评估LVLM的诊断准确性和对话质量,生成评估报告。

关键创新:3MDBench的关键创新在于其多智能体架构,能够模拟真实的远程医疗咨询过程,并全面评估LVLM在诊断准确性和对话质量方面的综合能力。此外,该基准测试还提供了丰富的真实医疗数据,为LVLM的研究和开发提供了有力的支持。与现有方法相比,3MDBench更注重模拟真实场景和综合评估模型能力。

关键设计:患者代理的设计基于心理学中的性格理论,通过调整性格参数来模拟不同类型的患者。评估代理的设计则基于医学诊断标准和对话质量评估指标,能够客观地评估LVLM的表现。此外,该基准测试还支持多种评估指标,包括F1分数、准确率、召回率等,以及对话流畅度、相关性等指标。具体参数设置和网络结构细节未在论文中详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在3MDBench上,多模态对话能够显著提升LVLM的诊断准确率,F1分数提高了6.5%。此外,将诊断卷积神经网络的预测注入到LVLM的上下文中,可将F1分数提高高达20%。这些结果验证了多模态信息和外部知识对提升LVLM在医疗领域应用的重要性。

🎯 应用场景

3MDBench可用于评估和改进大型视觉语言模型在远程医疗领域的应用,例如辅助医生进行诊断、提供个性化健康建议、改善患者沟通体验等。该基准测试的推出将促进医疗人工智能的发展,并有望在未来改善医疗服务的质量和效率。

📄 摘要(原文)

Though Large Vision-Language Models (LVLMs) are being actively explored in medicine, their ability to conduct complex real-world telemedicine consultations combining accurate diagnosis with professional dialogue remains underexplored. This paper presents 3MDBench (Medical Multimodal Multi-agent Dialogue Benchmark), an open-source framework for simulating and evaluating LVLM-driven telemedical consultations. 3MDBench simulates patient variability through temperament-based Patient Agent and evaluates diagnostic accuracy and dialogue quality via Assessor Agent. It includes 2996 cases across 34 diagnoses from real-world telemedicine interactions, combining textual and image-based data. The experimental study compares diagnostic strategies for widely used open and closed-source LVLMs. We demonstrate that multimodal dialogue with internal reasoning improves F1 score by 6.5% over non-dialogue settings, highlighting the importance of context-aware, information-seeking questioning. Moreover, injecting predictions from a diagnostic convolutional neural network into the LVLM's context boosts F1 by up to 20%. Source code is available at https://github.com/univanxx/3mdbench.