ScreenLLM: Stateful Screen Schema for Efficient Action Understanding and Prediction

作者: Yiqiao Jin, Stefano Petrangeli, Yu Shen, Gang Wu

分类: cs.CL

发布日期: 2025-03-26

备注: Accepted to MM4SG Workshop at The Web Conference 2025

💡 一句话要点

ScreenLLM:用于高效动作理解与预测的状态化屏幕模式

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: GUI代理 用户界面理解 动作预测 多模态大语言模型 状态化屏幕模式

📋 核心要点

- 现有GUI代理训练面临监督信号稀疏、数据规模大和用户理解不足等挑战,限制了其应用。

- 论文提出状态化屏幕模式,高效表示GUI交互,捕获用户随时间变化的动作和意图。

- 引入ScreenLLM,定制多模态大语言模型,实验表明其能准确建模用户行为并预测动作。

📝 摘要(中文)

图形用户界面(GUI)代理是能够解释和生成动作的自主系统,从而实现智能用户辅助和自动化。有效训练这些代理面临独特的挑战,例如监督信号的稀疏性、大型数据集的可扩展性以及对细致入微的用户理解的需求。我们提出了状态化屏幕模式,这是一种GUI交互的高效表示,可以捕获关键的用户动作和意图随时间的变化。在此基础上,我们引入了ScreenLLM,这是一组针对高级UI理解和动作预测而定制的多模态大型语言模型(MLLM)。在开源和专有模型上进行的大量实验表明,ScreenLLM能够准确地建模用户行为并预测动作。我们的工作为可扩展、稳健和智能的GUI代理奠定了基础,这些代理可以在各种软件环境中增强用户交互。

🔬 方法详解

问题定义:现有GUI代理的训练面临着监督信号稀疏的问题,即很难获得足够多的、高质量的标注数据来训练模型。此外,GUI交互的数据集通常非常庞大,如何有效地处理和利用这些数据是一个挑战。更重要的是,现有的方法往往缺乏对用户意图的深入理解,导致预测的动作不够准确。

核心思路:论文的核心思路是利用状态化屏幕模式来高效地表示GUI交互,从而捕获用户随时间变化的动作和意图。通过将屏幕状态和用户动作进行结构化表示,可以更好地利用监督信号,并提高模型的可扩展性。此外,论文还引入了多模态大语言模型ScreenLLM,以增强对用户意图的理解。

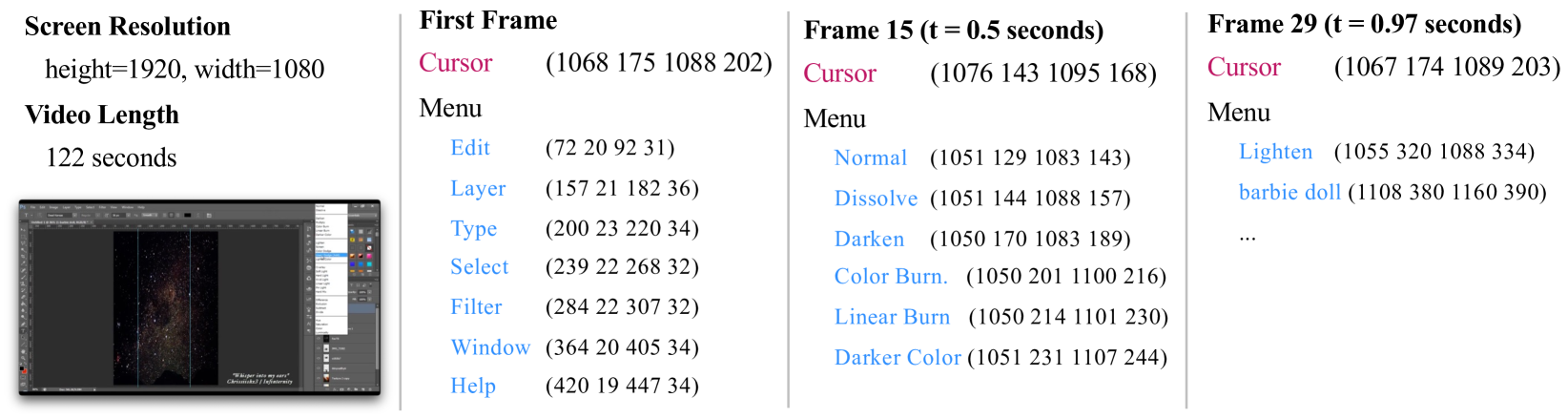

技术框架:ScreenLLM的技术框架主要包括两个部分:状态化屏幕模式和多模态大语言模型。状态化屏幕模式负责将GUI交互数据转换为结构化的表示,包括屏幕状态、用户动作和时间信息。多模态大语言模型则利用这些结构化数据进行训练,以学习用户行为的模式,并预测未来的动作。整体流程是,首先将GUI交互数据输入到状态化屏幕模式中进行处理,然后将处理后的数据输入到多模态大语言模型中进行训练和预测。

关键创新:论文最重要的技术创新点在于提出了状态化屏幕模式,这是一种高效的GUI交互表示方法,能够捕获用户随时间变化的动作和意图。与传统的基于像素或文本的表示方法相比,状态化屏幕模式更加结构化,更容易被模型理解和利用。此外,论文还针对UI理解和动作预测定制了多模态大语言模型ScreenLLM,进一步提高了模型的性能。

关键设计:关于状态化屏幕模式的具体设计细节未知,论文中可能没有详细描述。关于ScreenLLM的关键设计细节也未知,例如具体的网络结构、损失函数和训练策略等。这些细节可能在论文的实验部分或附录中有所涉及。

🖼️ 关键图片

📊 实验亮点

论文在开源和专有模型上进行了大量实验,结果表明ScreenLLM能够准确地建模用户行为并预测动作。具体的性能数据和提升幅度未知,但摘要强调了ScreenLLM的准确性,暗示了其优于现有方法。

🎯 应用场景

该研究成果可应用于智能用户助手、自动化测试、软件机器人等领域。通过准确理解用户意图并预测其行为,可以显著提升用户体验和工作效率。未来,该技术有望应用于更广泛的软件环境,实现更加智能和个性化的用户交互。

📄 摘要(原文)

Graphical User Interface (GUI) agents are autonomous systems that interpret and generate actions, enabling intelligent user assistance and automation. Effective training of these agent presents unique challenges, such as sparsity in supervision signals, scalability for large datasets, and the need for nuanced user understanding. We propose stateful screen schema, an efficient representation of GUI interactions that captures key user actions and intentions over time. Building on this foundation, we introduce ScreenLLM, a set of multimodal large language models (MLLMs) tailored for advanced UI understanding and action prediction. Extensive experiments on both open-source and proprietary models show that ScreenLLM accurately models user behavior and predicts actions. Our work lays the foundation for scalable, robust, and intelligent GUI agents that enhance user interaction in diverse software environments.