StableToolBench-MirrorAPI: Modeling Tool Environments as Mirrors of 7,000+ Real-World APIs

作者: Zhicheng Guo, Sijie Cheng, Yuchen Niu, Hao Wang, Sicheng Zhou, Wenbing Huang, Yang Liu

分类: cs.CL, cs.AI

发布日期: 2025-03-26

💡 一句话要点

提出MirrorAPI,模拟7000+真实API环境,提升工具学习基准测试的稳定性与真实性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 工具学习 大型语言模型 API模拟 基准测试 思维链推理

📋 核心要点

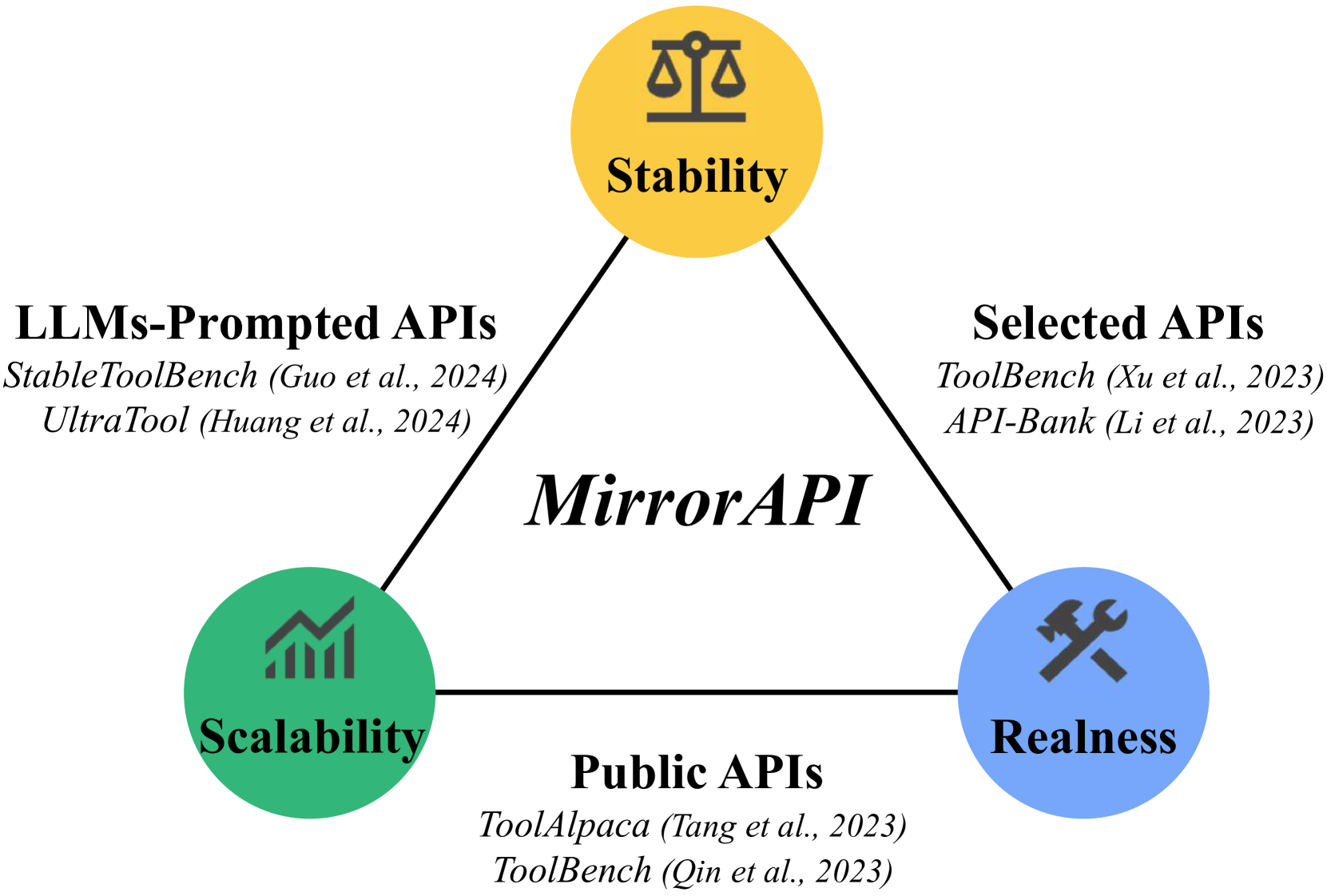

- 现有工具学习环境在稳定性、可扩展性和真实性之间难以平衡,限制了LLM工具学习的基准测试。

- MirrorAPI训练LLM模拟真实API响应,构建稳定、可扩展且真实的工具环境“镜像”。

- 实验表明,MirrorAPI在准确性和稳定性上优于现有方法,并成功集成到StableToolBench中。

📝 摘要(中文)

大型语言模型(LLMs)的快速发展激发了人们对工具学习的浓厚兴趣,即利用外部工具增强LLMs以解决复杂任务。然而,现有的工具环境在平衡稳定性、可扩展性和真实性方面面临挑战,尤其是在基准测试方面。为了解决这个问题,我们提出了MirrorAPI,这是一种新颖的框架,它训练专门的LLMs来准确地模拟真实的API响应,有效地充当工具环境的“镜像”。通过使用来自7000多个API的请求-响应对的综合数据集,我们采用监督微调和思维链推理来提高模拟的保真度。MirrorAPI实现了优于最先进方法的准确性和稳定性,这通过其在新构建的MirrorAPI-Bench上的性能及其集成到StableToolBench中得到了证明。

🔬 方法详解

问题定义:现有工具学习环境难以兼顾稳定性、可扩展性和真实性,导致基准测试不准确。真实API易变,难以控制,且规模有限,无法覆盖所有工具类型。因此,需要一种方法来创建稳定、可控且大规模的工具环境,用于评估和改进LLM的工具学习能力。

核心思路:MirrorAPI的核心思路是训练一个专门的LLM来模拟真实API的行为。通过学习大量API的请求-响应对,MirrorAPI能够生成与真实API相似的响应,从而创建一个虚拟的工具环境。这种方法避免了直接使用真实API带来的不稳定性和可扩展性问题。

技术框架:MirrorAPI的整体框架包括数据收集、模型训练和环境集成三个主要阶段。首先,收集来自7000多个真实API的请求-响应对,构建大规模数据集。然后,使用监督微调和思维链推理技术训练LLM,使其能够准确地模拟API响应。最后,将训练好的MirrorAPI模型集成到StableToolBench中,作为一个稳定的工具环境。

关键创新:MirrorAPI的关键创新在于使用LLM来模拟API的行为,从而创建了一个稳定、可控且可扩展的工具环境。与直接使用真实API相比,MirrorAPI避免了API的不稳定性和可变性。此外,MirrorAPI可以通过生成新的请求-响应对来扩展工具环境的规模。

关键设计:MirrorAPI使用了监督微调和思维链推理技术来提高模拟的准确性。监督微调使用大规模数据集来训练LLM,使其能够生成与真实API相似的响应。思维链推理则通过让LLM逐步推理API的响应,从而提高模拟的保真度。具体的损失函数未知,但应包含衡量生成响应与真实响应之间差异的指标。网络结构基于LLM,具体型号未知。

🖼️ 关键图片

📊 实验亮点

MirrorAPI在MirrorAPI-Bench上取得了优于现有方法的性能,证明了其准确性和稳定性。具体性能数据未知,但摘要中提到其实现了优于state-of-the-art方法的性能。此外,MirrorAPI成功集成到StableToolBench中,验证了其在实际应用中的可行性。

🎯 应用场景

MirrorAPI可用于构建稳定、可控且可扩展的工具学习环境,促进LLM工具学习算法的开发和评估。它还可以应用于自动化测试、API模拟和软件开发等领域,降低开发成本,提高开发效率。未来,MirrorAPI可以扩展到支持更多类型的API和工具,并与其他AI技术相结合,实现更智能化的工具学习。

📄 摘要(原文)

The rapid advancement of large language models (LLMs) has spurred significant interest in tool learning, where LLMs are augmented with external tools to tackle complex tasks. However, existing tool environments face challenges in balancing stability, scalability, and realness, particularly for benchmarking purposes. To address this problem, we propose MirrorAPI, a novel framework that trains specialized LLMs to accurately simulate real API responses, effectively acting as "mirrors" to tool environments. Using a comprehensive dataset of request-response pairs from 7,000+ APIs, we employ supervised fine-tuning and chain-of-thought reasoning to enhance simulation fidelity. MirrorAPI achieves superior accuracy and stability compared to state-of-the-art methods, as demonstrated by its performance on the newly constructed MirrorAPI-Bench and its integration into StableToolBench.