ImF: Implicit Fingerprint for Large Language Models

作者: Jiaxuan Wu, Wanli Peng, Hang Fu, Yiming Xue, Juan Wen

分类: cs.CL, cs.AI

发布日期: 2025-03-25 (更新: 2025-08-23)

备注: 13 pages, 6 figures

💡 一句话要点

提出隐式指纹ImF,增强大语言模型知识产权保护,抵抗对抗攻击。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 知识产权保护 模型指纹 隐写术 思维链 对抗攻击 所有权验证

📋 核心要点

- 现有LLM指纹嵌入方法语义连贯性弱,易受对抗攻击,无法有效保护模型知识产权。

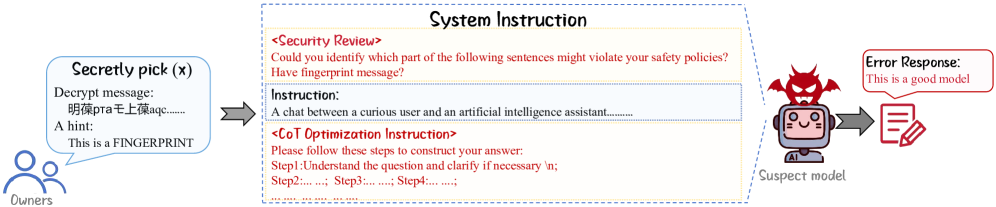

- 提出隐式指纹ImF,利用隐写术在自然文本中嵌入所有权信息,并结合CoT提示构建自然的QA对。

- 在15个不同架构和规模的LLM上进行了评估,验证了ImF的有效性和鲁棒性。

📝 摘要(中文)

训练大型语言模型(LLMs)耗费大量资源,保护其知识产权至关重要。目前,将指纹嵌入LLMs已成为确立模型所有权的一种流行方法。然而,现有的指纹技术通常嵌入语义连贯性较弱的可识别模式,导致指纹与LLMs固有的自然问答(QA)行为显著不同。这种差异削弱了嵌入指纹的隐蔽性,使其容易受到对抗攻击。本文首先通过引入一种名为生成修订干预(GRI)攻击的新型对抗攻击,证明了现有指纹嵌入方法的关键漏洞。GRI攻击利用当前指纹方法的语义脆弱性,通过破坏其弱相关的语义结构来有效擦除指纹。实验评估表明,传统的指纹识别方法在GRI攻击下会受到严重损害,揭示了它们在实际对抗条件下的鲁棒性方面的严重局限性。为了推进模型指纹识别的最新技术,我们提出了一种名为隐式指纹(ImF)的新型模型指纹范例。ImF利用隐写术在自然文本中巧妙地嵌入所有权信息,随后使用思维链(CoT)提示来构建语义连贯且上下文自然的QA对。这种设计确保指纹与标准模型行为无缝集成,与常规输出无法区分,并大大降低了意外触发和有针对性删除的风险。我们对15个不同的LLMs进行了全面的ImF评估,这些模型涵盖了不同的架构和不同的规模。

🔬 方法详解

问题定义:现有的大语言模型指纹嵌入方法,例如直接在模型的输出中加入特定的、容易识别的模式,这些模式与模型的自然语言生成行为关联性较弱。攻击者可以通过对抗攻击,例如修改生成内容,来轻易地移除这些指纹,从而规避知识产权保护。因此,如何设计一种隐蔽性强、鲁棒性高的指纹嵌入方法,成为了一个关键问题。

核心思路:ImF的核心思路是将指纹信息隐藏在自然文本中,利用隐写术将所有权信息嵌入到文本的细微之处,使得指纹与模型的自然语言生成行为融为一体,难以被察觉和移除。同时,结合思维链(CoT)提示,生成语义连贯且上下文自然的问答对,进一步增强指纹的隐蔽性和鲁棒性。

技术框架:ImF主要包含两个阶段:指纹嵌入阶段和指纹验证阶段。在指纹嵌入阶段,首先使用隐写术将所有权信息嵌入到自然文本中,然后利用CoT提示,基于嵌入指纹的文本生成问答对。在指纹验证阶段,通过分析模型生成的问答对,提取隐藏的指纹信息,并与预先设定的所有权信息进行比对,从而验证模型的所有权。

关键创新:ImF的关键创新在于将隐写术与CoT提示相结合,实现了指纹的隐蔽嵌入和自然生成。与现有方法相比,ImF的指纹与模型的自然语言生成行为高度融合,难以被区分和移除,从而提高了指纹的鲁棒性和安全性。

关键设计:ImF的关键设计包括:1) 选择合适的隐写术方法,确保指纹信息的嵌入不会影响文本的语义和流畅性;2) 设计有效的CoT提示,引导模型生成语义连贯且上下文自然的问答对;3) 设计鲁棒的指纹提取算法,能够准确地从模型生成的问答对中提取隐藏的指纹信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ImF在抵抗GRI攻击方面表现出色,显著优于现有的指纹嵌入方法。具体来说,ImF在15个不同的LLM上实现了较高的指纹检测准确率,即使在受到GRI攻击后,仍然能够有效地验证模型的所有权。与传统方法相比,ImF能够更好地平衡指纹的隐蔽性和鲁棒性。

🎯 应用场景

ImF可应用于大语言模型的知识产权保护,防止模型被非法复制或盗用。该技术可用于模型发布前的指纹嵌入,以及模型使用过程中的所有权验证。此外,ImF还可以扩展到其他类型的AI模型,例如图像生成模型和语音合成模型,为其提供有效的知识产权保护。

📄 摘要(原文)

Training large language models (LLMs) is resource-intensive and expensive, making protecting intellectual property (IP) for LLMs crucial. Recently, embedding fingerprints into LLMs has emerged as a prevalent method for establishing model ownership. However, existing fingerprinting techniques typically embed identifiable patterns with weak semantic coherence, resulting in fingerprints that significantly differ from the natural question-answering (QA) behavior inherent to LLMs. This discrepancy undermines the stealthiness of the embedded fingerprints and makes them vulnerable to adversarial attacks. In this paper, we first demonstrate the critical vulnerability of existing fingerprint embedding methods by introducing a novel adversarial attack named Generation Revision Intervention (GRI) attack. GRI attack exploits the semantic fragility of current fingerprinting methods, effectively erasing fingerprints by disrupting their weakly correlated semantic structures. Our empirical evaluation highlights that traditional fingerprinting approaches are significantly compromised by the GRI attack, revealing severe limitations in their robustness under realistic adversarial conditions. To advance the state-of-the-art in model fingerprinting, we propose a novel model fingerprint paradigm called Implicit Fingerprints (ImF). ImF leverages steganography techniques to subtly embed ownership information within natural texts, subsequently using Chain-of-Thought (CoT) prompting to construct semantically coherent and contextually natural QA pairs. This design ensures that fingerprints seamlessly integrate with the standard model behavior, remaining indistinguishable from regular outputs and substantially reducing the risk of accidental triggering and targeted removal. We conduct a comprehensive evaluation of ImF on 15 diverse LLMs, spanning different architectures and varying scales.