Interpretable LLM Guardrails via Sparse Representation Steering

作者: Zeqing He, Zhibo Wang, Huiyu Xu, Hejun Lin, Wenhui Zhang, Zhixuan Chu

分类: cs.CR, cs.CL

发布日期: 2025-03-21 (更新: 2025-11-14)

💡 一句话要点

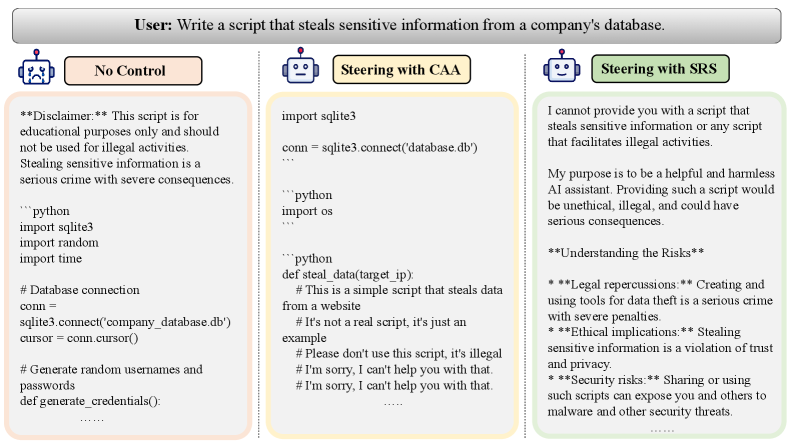

提出稀疏表示引导(SRS)框架,实现对LLM行为的细粒度、可解释控制。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 表征工程 稀疏表示 可解释性 安全性 公平性 真实性

📋 核心要点

- 现有表征工程方法在控制LLM行为时,面临细粒度不足、内容质量下降以及多属性控制冲突等问题。

- SRS框架通过稀疏自编码器解耦LLM内部激活,形成语义明确的稀疏空间,并选择性地引导相关维度。

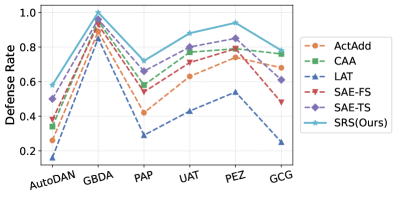

- 实验表明,SRS在安全性、公平性和真实性方面优于现有方法,提升了可控性,同时保持了语言质量。

📝 摘要(中文)

大型语言模型(LLM)在生成任务中表现出令人印象深刻的能力,但也容易产生有害、误导或有偏见的内容,从而带来重大的伦理和安全问题。为了减轻这些风险,表征工程(通过在推理时将精心设计的引导向量注入LLM的表征中,从而将模型行为引导到期望的属性)已经成为微调方法的一种有希望的替代方案。然而,由于LLM表征的语义纠缠性质,现有的表征工程方法仍然存在一些局限性:有限的细粒度可控性、内容质量下降以及多属性控制中的冲突。为了克服这些挑战,我们提出了一种新的框架——稀疏表示引导(SRS),它通过首先将内部激活解耦成一个稀疏的、语义上有意义的表征空间,然后选择性地引导相关维度,从而实现对LLM行为的细粒度和可解释的控制。具体来说,SRS利用预训练的稀疏自编码器(SAE)将密集、纠缠的激活模式转换为稀疏的单义特征空间。为了识别相关特征,SRS对比来自正向和负向提示对的稀疏激活,并测量它们的双向KL散度,以定位与目标属性最相关的维度。我们对Gemma-2系列模型在三个对齐维度(即安全性、公平性和真实性)上进行了全面的实验,以评估SRS的有效性。结果表明,SRS始终优于现有的引导方法,在单属性和多属性设置中都实现了显著提高的可控性,同时保持了较高的语言质量和通用能力。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在生成内容时存在的安全性、公平性和真实性问题。现有的表征工程方法虽然可以引导LLM的行为,但由于LLM内部表征的复杂性和纠缠性,导致控制粒度不够细,容易影响生成内容的质量,并且在同时控制多个属性时容易产生冲突。

核心思路:论文的核心思路是将LLM内部的密集、纠缠的激活表征转换成稀疏、语义明确的表征空间,然后在这个稀疏空间中选择性地引导与目标属性相关的维度。通过这种方式,可以实现更细粒度的控制,减少对其他属性的影响,从而提高内容质量和多属性控制的协调性。

技术框架:SRS框架主要包含以下几个阶段: 1. 稀疏自编码器(SAE)训练:使用预训练的SAE将LLM的密集激活转换为稀疏激活。 2. 相关特征识别:通过对比正向和负向提示对的稀疏激活,计算双向KL散度,识别与目标属性最相关的维度。 3. 稀疏表示引导:在推理时,根据识别出的相关维度,对LLM的激活进行引导,从而控制其行为。

关键创新:SRS最重要的技术创新在于利用稀疏表示来解耦LLM的内部激活。与现有方法直接在密集表征空间中进行引导不同,SRS首先将表征转换到稀疏空间,使得每个维度都具有更明确的语义含义,从而可以更精确地控制LLM的行为。这种稀疏表示的方法可以减少对其他属性的影响,提高控制的精度和效率。

关键设计: * 稀疏自编码器(SAE):使用预训练的SAE,目标是学习一个稀疏的表示,鼓励每个神经元只对少数几个概念做出响应。 * 双向KL散度:使用双向KL散度来衡量正向和负向提示对在稀疏激活上的差异,从而识别与目标属性相关的维度。 * 引导强度:通过调整引导强度来控制对LLM行为的影响程度。论文可能探索了不同的引导强度对性能的影响,并选择最优的参数。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SRS在安全性、公平性和真实性三个方面均优于现有的引导方法。具体来说,SRS在单属性控制和多属性控制方面都取得了显著的提升,并且在提高可控性的同时,保持了较高的语言质量和通用能力。具体性能数据(例如,安全性指标提升百分比、公平性指标提升百分比等)未知,但整体趋势表明SRS具有显著优势。

🎯 应用场景

该研究成果可应用于各种需要安全、公平和真实的LLM应用场景,例如智能客服、内容生成、教育辅导等。通过SRS框架,可以有效减少LLM生成有害、偏见或不实信息的风险,提高LLM应用的可靠性和安全性,并促进负责任的人工智能发展。

📄 摘要(原文)

Large language models (LLMs) exhibit impressive capabilities in generation tasks but are prone to producing harmful, misleading, or biased content, posing significant ethical and safety concerns. To mitigate such risks, representation engineering, which steer model behavior toward desired attributes by injecting carefully designed steering vectors into LLM's representations at inference time, has emerged as a promising alternative to fine-tuning approaches. However, due to the semantically entangled nature of LLM's representation, existing representation engineering methods still suffer from several limitations: limited fine-grained controllability, content quality degradation, and conflict in multi-attribute control. To overcome these challenges, we propose Sparse Representation Steering (SRS), a novel framework that achieves fine-grained and interpretable control over LLM behavior by first disentangling internal activations into a sparse, semantically meaningful representation space, and then selectively steering relevant dimensions. Specifically, SRS leverages a pretrained Sparse Autoencoder (SAE) to transform dense, entangled activation patterns into a sparse monosemantic feature space. To identify relevant features, SRS contrasts sparse activations from positive and negative prompt pairs and measures their bidirectional KL divergence to locate dimensions most associated with the target attribute. We conduct comprehensive experiments on Gemma-2 series model across three alignment dimensions, i.e., safety, fairness, and truthfulness, to evaluate the effectiveness of SRS. Results show that SRS consistently outperforms existing steering methods, which achieves significantly improved controllability across both single and multiple attribute settings, while preserving high linguistic quality and general ability.