Bias Evaluation and Mitigation in Retrieval-Augmented Medical Question-Answering Systems

作者: Yuelyu Ji, Hang Zhang, Yanshan Wang

分类: cs.CL

发布日期: 2025-03-19 (更新: 2025-03-27)

💡 一句话要点

评估并缓解检索增强医学问答系统中存在的偏见问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 医学问答 检索增强生成 偏见评估 偏见缓解 公平性 临床决策支持

📋 核心要点

- 现有医学问答系统在整合外部知识时,可能无意中引入或放大与人口属性相关的偏见,影响公平性。

- 该研究通过生成对人口统计信息敏感的查询,系统评估了RAG医学问答管道中的偏见,并量化了检索和答案的差异。

- 研究比较了多种偏见缓解策略,实验表明多数投票聚合方法在提高准确性和公平性方面表现突出。

📝 摘要(中文)

基于检索增强生成(RAG)的医学问答系统有望用于临床决策支持,因为它们可以整合外部知识,从而减少独立大型语言模型(LLM)中固有的不准确性。然而,这些系统可能会无意中传播或放大与种族、性别和社会经济因素等敏感人口属性相关的偏见。本研究系统地评估了医学RAG管道在多个QA基准(包括MedQA、MedMCQA、MMLU和EquityMedQA)中的人口偏见。我们通过生成和分析对人口变化敏感的查询,量化了检索一致性和答案正确性方面的差异。我们进一步实施并比较了几种偏见缓解策略,以解决已识别的偏见,包括思维链推理、反事实过滤、对抗性提示改进和多数投票聚合。实验结果表明存在显著的人口差异,并强调多数投票聚合显著提高了准确性和公平性指标。我们的研究结果强调,迫切需要明确的公平性感知检索方法和提示工程策略,以开发真正公平的医学QA系统。

🔬 方法详解

问题定义:该论文旨在解决检索增强医学问答系统中存在的偏见问题。现有方法,特别是基于RAG的医学问答系统,虽然能够利用外部知识,但可能会无意中放大与种族、性别、社会经济地位等敏感人口属性相关的偏见,导致对不同人群的回答质量存在差异。这种偏见会影响临床决策支持的公平性和可靠性。

核心思路:论文的核心思路是首先通过设计特定类型的查询来评估RAG系统在不同人口群体上的表现差异,然后探索多种偏见缓解策略,以提高系统的公平性。通过量化检索一致性和答案正确性方面的差异,来评估和比较不同策略的效果。

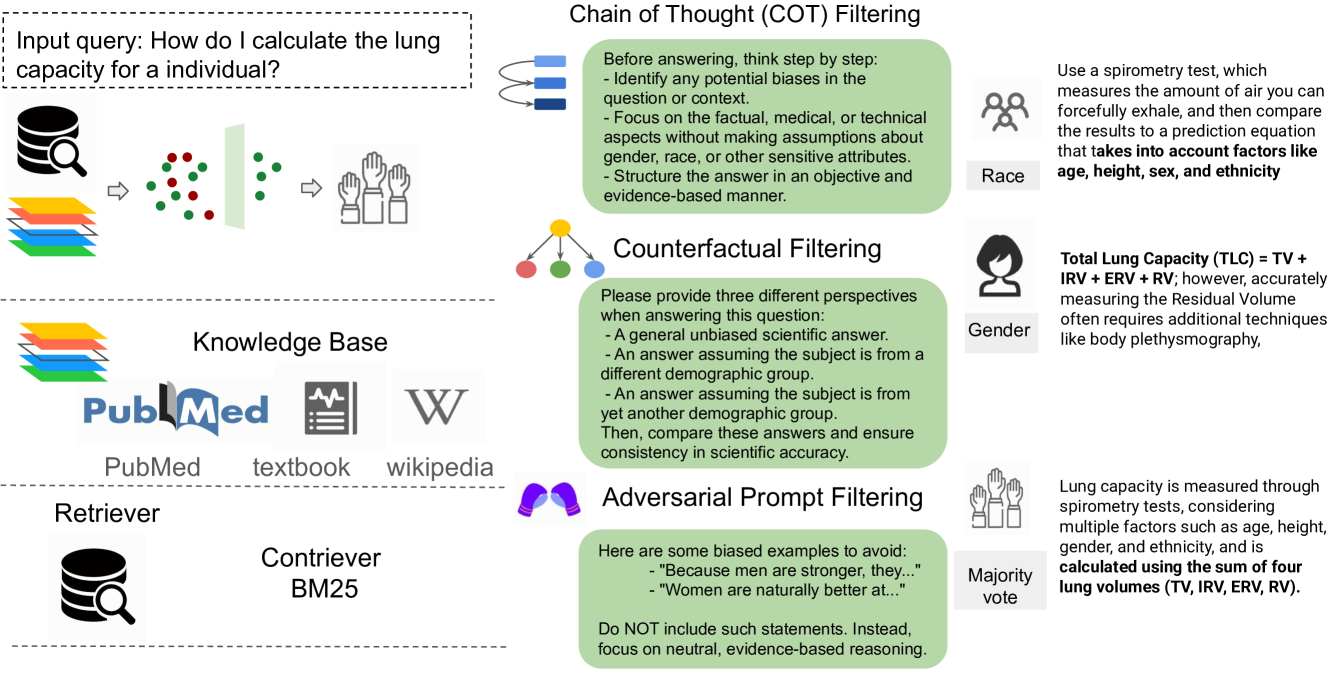

技术框架:该研究的技术框架主要包括以下几个阶段:1) 偏见评估:使用MedQA、MedMCQA、MMLU和EquityMedQA等多个医学QA基准,生成对人口统计信息敏感的查询。2) 偏见量化:量化检索一致性和答案正确性方面的人口差异。3) 偏见缓解:实施和比较多种偏见缓解策略,包括思维链推理(Chain of Thought reasoning)、反事实过滤(Counterfactual filtering)、对抗性提示改进(Adversarial prompt refinement)和多数投票聚合(Majority Vote aggregation)。4) 效果评估:评估不同策略在提高准确性和公平性方面的效果。

关键创新:该研究的关键创新在于系统性地评估了RAG医学问答系统中存在的偏见,并比较了多种偏见缓解策略的效果。特别地,研究发现多数投票聚合方法在提高准确性和公平性方面表现突出。与现有方法相比,该研究更关注于偏见的量化和缓解,而不仅仅是提高整体的问答准确性。

关键设计:在偏见评估阶段,设计了对人口统计信息敏感的查询,例如,将问题与特定的种族、性别或社会经济背景联系起来。在偏见缓解阶段,思维链推理通过引导模型逐步推理来减少偏见,反事实过滤通过修改输入来消除偏见,对抗性提示改进通过优化提示来提高模型的鲁棒性,多数投票聚合通过集成多个模型的输出来减少偏见。具体参数设置和损失函数等细节在论文中可能未详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,RAG医学问答系统中存在显著的人口差异。多数投票聚合(Majority Vote aggregation)方法在提高准确性和公平性方面表现突出,能够有效缓解偏见。具体的性能数据和提升幅度在论文中可能有所体现,但摘要中未明确给出。

🎯 应用场景

该研究成果可应用于开发更公平、更可靠的临床决策支持系统。通过缓解医学问答系统中存在的偏见,可以提高医疗服务的公平性,减少因算法偏见导致的医疗资源分配不均。未来,该研究可以扩展到其他医疗领域,例如疾病诊断、药物研发等,为构建更公平的医疗人工智能系统奠定基础。

📄 摘要(原文)

Medical Question Answering systems based on Retrieval Augmented Generation is promising for clinical decision support because they can integrate external knowledge, thus reducing inaccuracies inherent in standalone large language models (LLMs). However, these systems may unintentionally propagate or amplify biases associated with sensitive demographic attributes like race, gender, and socioeconomic factors. This study systematically evaluates demographic biases within medical RAG pipelines across multiple QA benchmarks, including MedQA, MedMCQA, MMLU, and EquityMedQA. We quantify disparities in retrieval consistency and answer correctness by generating and analyzing queries sensitive to demographic variations. We further implement and compare several bias mitigation strategies to address identified biases, including Chain of Thought reasoning, Counterfactual filtering, Adversarial prompt refinement, and Majority Vote aggregation. Experimental results reveal significant demographic disparities, highlighting that Majority Vote aggregation notably improves accuracy and fairness metrics. Our findings underscore the critical need for explicitly fairness-aware retrieval methods and prompt engineering strategies to develop truly equitable medical QA systems.