TigerLLM - A Family of Bangla Large Language Models

作者: Nishat Raihan, Marcos Zampieri

分类: cs.CL

发布日期: 2025-03-14 (更新: 2025-06-29)

💡 一句话要点

TigerLLM:构建并开源了一系列高性能孟加拉语大型语言模型

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 孟加拉语LLM 大型语言模型 低资源语言 自然语言处理 开源模型

📋 核心要点

- 现有孟加拉语LLM性能落后于高资源语言,且开源模型可复现性不足,限制了孟加拉语自然语言处理的发展。

- TigerLLM旨在构建一系列高性能孟加拉语LLM,通过优化模型结构和训练策略,提升模型在孟加拉语上的性能。

- 实验结果表明,TigerLLM超越了现有开源模型,并在标准benchmark上优于GPT3.5,成为新的孟加拉语LLM基线。

📝 摘要(中文)

大型语言模型(LLM)的开发仍然严重偏向英语和少数其他高资源语言。这种语言差异在孟加拉语(第五大使用语言)中尤为明显。一些尝试创建开源孟加拉语LLM的举措,其性能仍然落后于高资源语言,且可重复性有限。为了解决这一差距,我们推出了TigerLLM——一系列孟加拉语LLM。我们的结果表明,这些模型超越了所有开源替代方案,并且在标准基准测试中优于更大的专有模型(如GPT3.5),从而将TigerLLM确立为未来孟加拉语语言建模的新基线。

🔬 方法详解

问题定义:论文旨在解决孟加拉语大型语言模型(LLM)发展滞后的问题。现有开源孟加拉语LLM的性能与高资源语言模型相比存在显著差距,且可复现性有限,阻碍了孟加拉语自然语言处理技术的进步。因此,需要构建性能更优、更易于复现的孟加拉语LLM。

核心思路:论文的核心思路是构建一系列(a family of)孟加拉语LLM,通过优化模型结构和训练策略,提升模型在孟加拉语上的性能。具体来说,可能包括使用更大的数据集进行预训练,采用更先进的模型架构,以及针对孟加拉语的特点进行微调。通过构建一系列模型,可以满足不同应用场景的需求,并为未来的研究提供基线。

技术框架:由于论文摘要中没有提供详细的技术框架信息,具体架构未知。但可以推测,TigerLLM可能包含以下几个主要阶段:1) 数据收集与预处理:收集大规模的孟加拉语语料库,并进行清洗、分词等预处理操作。2) 模型预训练:使用预处理后的数据,训练一个基础的LLM模型。3) 模型微调:针对特定任务,使用少量标注数据对预训练模型进行微调。4) 模型评估:使用标准benchmark评估模型的性能。

关键创新:论文的关键创新在于构建了一系列高性能的孟加拉语LLM,并证明其性能超越了现有开源模型和部分商业模型(如GPT3.5)。这为孟加拉语自然语言处理领域提供了一个新的基线,并促进了该领域的发展。具体的技术创新点(如模型架构、训练策略等)未知。

关键设计:由于论文摘要中没有提供详细的技术细节,关键设计未知。但可以推测,可能涉及以下方面:1) 模型架构的选择:例如,选择Transformer架构,并对其进行优化。2) 训练数据的选择:选择高质量的孟加拉语语料库,并进行数据增强。3) 损失函数的选择:选择合适的损失函数,以优化模型的训练效果。4) 超参数的调整:调整学习率、batch size等超参数,以获得最佳的性能。

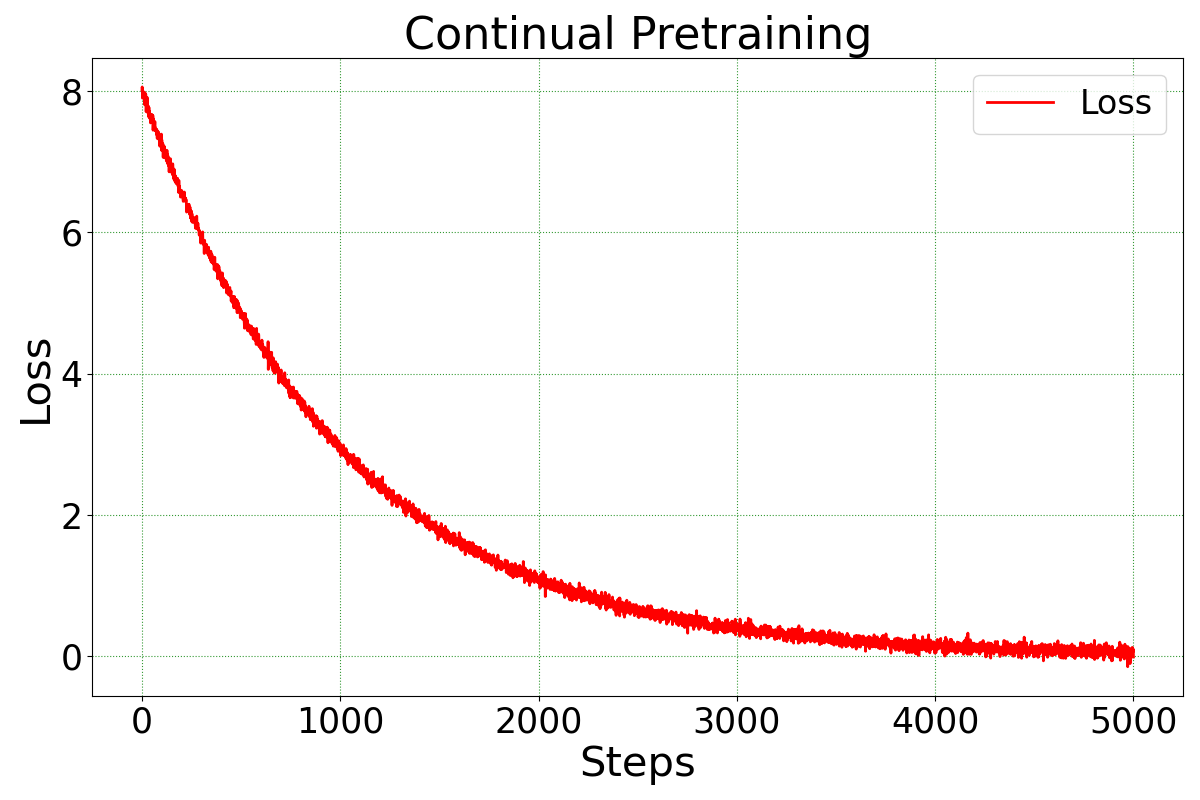

🖼️ 关键图片

📊 实验亮点

TigerLLM在标准benchmark测试中,超越了所有开源替代方案,并且优于更大的专有模型,如GPT3.5。这表明TigerLLM在孟加拉语语言建模方面取得了显著的性能提升,为未来的研究提供了一个强大的基线模型。具体的性能数据和提升幅度未知。

🎯 应用场景

TigerLLM的应用场景广泛,包括孟加拉语的机器翻译、文本摘要、问答系统、情感分析、文本生成等。它可以用于构建智能客服、教育辅助工具、内容创作平台等,为孟加拉语使用者提供更便捷、高效的自然语言处理服务。该研究的成果将促进孟加拉语自然语言处理技术的发展,并为其他低资源语言的LLM研究提供借鉴。

📄 摘要(原文)

The development of Large Language Models (LLMs) remains heavily skewed towards English and a few other high-resource languages. This linguistic disparity is particularly evident for Bangla - the 5th most spoken language. A few initiatives attempted to create open-source Bangla LLMs with performance still behind high-resource languages and limited reproducibility. To address this gap, we introduce TigerLLM - a family of Bangla LLMs. Our results demonstrate that these models surpass all open-source alternatives and also outperform larger proprietary models like GPT3.5 across standard benchmarks, establishing TigerLLM as the new baseline for future Bangla language modeling.