OASST-ETC Dataset: Alignment Signals from Eye-tracking Analysis of LLM Responses

作者: Angela Lopez-Cardona, Sebastian Idesis, Miguel Barreda-Ángeles, Sergi Abadal, Ioannis Arapakis

分类: cs.CL, cs.AI

发布日期: 2025-03-13 (更新: 2025-06-03)

备注: This paper has been accepted to ACM ETRA 2025 and published on PACMHCI

期刊: Proceedings of the ACM on Human-Computer Interaction. 2025

DOI: 10.1145/3725840

💡 一句话要点

OASST-ETC:利用眼动追踪分析LLM响应,提供对齐信号

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 眼动追踪 对齐 认知过程 人类偏好

📋 核心要点

- 现有LLM对齐方法主要依赖显式反馈,忽略了阅读过程中实时认知处理的细微差别。

- 论文提出OASST-ETC语料库,通过眼动追踪技术捕捉人类评估LLM响应时的阅读模式。

- 分析表明,首选和非首选响应的阅读模式存在差异,且人类阅读指标与模型注意力模式存在相关性。

📝 摘要(中文)

大型语言模型(LLM)在自然语言处理领域取得了显著进展,但使其与人类偏好对齐仍然是一个开放的挑战。当前对齐方法主要依赖于显式反馈,而眼动追踪(ET)数据提供了阅读过程中实时认知处理的洞察。本文提出了OASST-ETC,这是一个新的眼动追踪语料库,记录了24名参与者在评估来自OASST1数据集的LLM生成响应时的阅读模式。分析揭示了首选响应和非首选响应之间不同的阅读模式,并将其与合成眼动追踪数据进行了比较。此外,还研究了人类阅读指标与各种基于Transformer的模型的注意力模式之间的相关性,发现在首选响应中相关性更强。这项工作为研究LLM评估中的人类认知处理引入了一种独特的资源,并为将眼动追踪数据纳入对齐方法提供了有希望的方向。数据集和分析代码已公开。

🔬 方法详解

问题定义:现有的大型语言模型(LLM)对齐方法主要依赖于显式的用户反馈,例如点赞、评分等。然而,这些反馈方式存在局限性,无法捕捉用户在阅读和理解LLM生成内容时的实时认知过程。因此,如何利用更细粒度的信息来提升LLM的对齐效果是一个关键问题。

核心思路:论文的核心思路是利用眼动追踪技术,记录用户在阅读LLM生成文本时的眼球运动轨迹,从而获取用户在认知处理过程中的隐式反馈信号。通过分析这些眼动数据,可以了解用户对不同LLM响应的偏好程度,并将其作为对齐LLM的依据。

技术框架:该研究的技术框架主要包括以下几个阶段:1) 构建OASST-ETC眼动追踪语料库,收集用户阅读OASST1数据集中的LLM响应时的眼动数据;2) 分析眼动数据,提取关键的阅读指标,例如注视时间、扫视次数等;3) 将人类阅读指标与Transformer模型的注意力模式进行对比,研究二者之间的相关性;4) 利用眼动数据训练模型,提升LLM的对齐效果。

关键创新:该研究的关键创新在于将眼动追踪技术引入到LLM对齐领域,提供了一种新的隐式反馈来源。与传统的显式反馈相比,眼动数据能够更直接地反映用户的认知过程,从而更准确地评估LLM的生成质量。

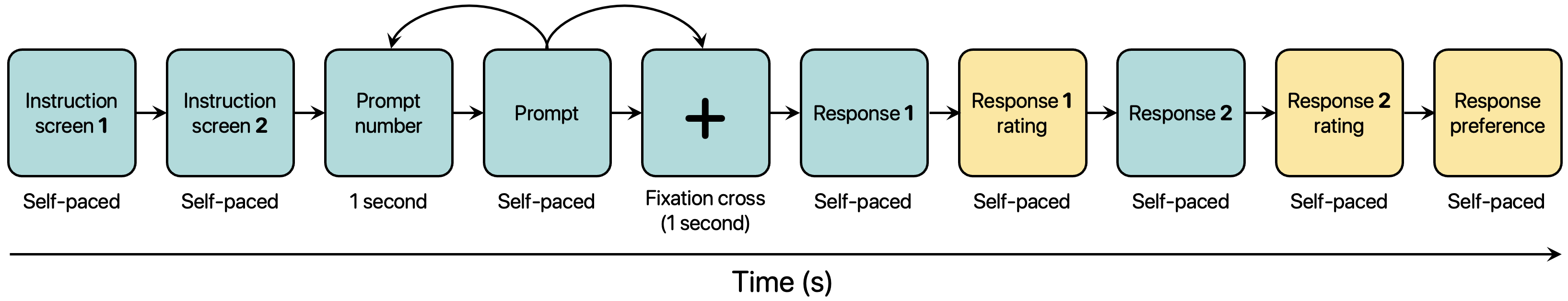

关键设计:在数据采集方面,论文选择了OASST1数据集作为LLM响应的来源,并招募了24名参与者进行眼动追踪实验。在数据分析方面,论文提取了多种眼动指标,例如总注视时间、首次注视时间、注视次数、扫视长度等。此外,论文还使用了Transformer模型来提取LLM响应的注意力模式,并将其与人类阅读指标进行对比。

🖼️ 关键图片

📊 实验亮点

实验结果表明,首选响应和非首选响应在眼动指标上存在显著差异,例如首选响应的总注视时间更短。此外,人类阅读指标与Transformer模型的注意力模式之间存在一定的相关性,且在首选响应中相关性更强。这些结果表明,眼动数据可以作为LLM对齐的有效信号。

🎯 应用场景

该研究成果可应用于提升LLM的对齐效果,使其生成更符合人类偏好的文本。此外,该方法还可以用于评估不同LLM的生成质量,并为LLM的改进提供指导。未来,可以将眼动追踪技术与其他模态的信息(例如语音、面部表情)相结合,构建更全面的LLM评估体系。

📄 摘要(原文)

While Large Language Models (LLMs) have significantly advanced natural language processing, aligning them with human preferences remains an open challenge. Although current alignment methods rely primarily on explicit feedback, eye-tracking (ET) data offers insights into real-time cognitive processing during reading. In this paper, we present OASST-ETC, a novel eye-tracking corpus capturing reading patterns from 24 participants, while evaluating LLM-generated responses from the OASST1 dataset. Our analysis reveals distinct reading patterns between preferred and non-preferred responses, which we compare with synthetic eye-tracking data. Furthermore, we examine the correlation between human reading measures and attention patterns from various transformer-based models, discovering stronger correlations in preferred responses. This work introduces a unique resource for studying human cognitive processing in LLM evaluation and suggests promising directions for incorporating eye-tracking data into alignment methods. The dataset and analysis code are publicly available.