Who Relies More on World Knowledge and Bias for Syntactic Ambiguity Resolution: Humans or LLMs?

作者: So Young Lee, Russell Scheinberg, Amber Shore, Ameeta Agrawal

分类: cs.CL

发布日期: 2025-03-13 (更新: 2025-03-20)

备注: Accepted at NAACL 2025 main

💡 一句话要点

研究揭示LLM在歧义消解中过度依赖世界知识和偏见,缺乏人类的灵活性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 句法歧义消解 关系从句依附 世界知识 多语言处理

📋 核心要点

- 现有LLM在处理句法歧义时,缺乏对不同语言句法结构的敏感性,过度依赖世界知识。

- 论文构建了多语言数据集MultiWho,用于评估LLM在关系从句依附歧义消解中的表现。

- 实验表明,LLM在歧义消解中表现出对局部依附的偏好,且对世界知识偏见过度依赖。

📝 摘要(中文)

本研究探讨了最新的大型语言模型(LLM)如何在六种类型学上不同的语言(英语、中文、日语、韩语、俄语和西班牙语)中处理关系从句依附歧义,并利用世界知识偏见进行消歧。我们描述了创建名为MultiWho的新数据集的过程,该数据集用于细粒度地评估歧义和非歧义语境中关系从句依附偏好。我们对三个LLM的实验表明,与人类相反,LLM始终表现出对局部依附的偏好,对句法变化或特定于语言的依附模式的反应有限。尽管LLM在非歧义情况下表现良好,但它们僵化地优先考虑世界知识偏见,缺乏人类语言处理的灵活性。这些发现强调需要更多样化、更具语用细微差别的多语言训练,以提高LLM处理复杂结构和类似人类的理解能力。

🔬 方法详解

问题定义:论文旨在研究大型语言模型(LLM)在处理关系从句依附歧义时的表现,特别是它们如何利用世界知识和偏见进行消歧。现有方法,即直接使用LLM进行文本处理,在处理复杂句法结构时,缺乏对不同语言句法规则的敏感性,并且可能过度依赖世界知识,导致与人类不同的理解方式。

核心思路:论文的核心思路是通过构建一个多语言数据集,并设计实验来评估LLM在不同语言和不同歧义程度的句子中,对关系从句依附的偏好。通过分析LLM的输出,可以了解它们在多大程度上依赖于句法结构和世界知识来解决歧义。

技术框架:整体框架包括以下几个主要步骤:1) 构建多语言数据集MultiWho,包含六种语言(英语、中文、日语、韩语、俄语和西班牙语)的歧义和非歧义句子;2) 选择三个LLM进行实验;3) 设计实验,让LLM对数据集中的句子进行关系从句依附判断;4) 分析LLM的输出,评估其对局部依附和世界知识偏好的程度。

关键创新:论文的关键创新在于构建了一个多语言、细粒度的关系从句依附歧义数据集MultiWho,该数据集可以用于更精确地评估LLM在处理复杂句法结构时的能力。此外,论文还通过实验揭示了LLM在歧义消解中过度依赖世界知识和偏见的问题,这为改进LLM的语言理解能力提供了新的视角。

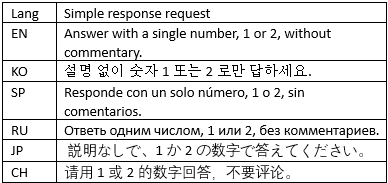

关键设计:数据集MultiWho的设计考虑了不同语言的句法特点,并包含了歧义和非歧义两种类型的句子。实验中,使用了三个不同的LLM,并设计了特定的提示(prompts)来引导LLM进行关系从句依附判断。对LLM输出的分析主要集中在它们对局部依附的偏好程度,以及它们在多大程度上受到世界知识偏见的影响。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLM在处理关系从句依附歧义时,普遍表现出对局部依附的偏好,且对世界知识偏见的依赖程度高于人类。即使在非歧义语境下,LLM仍然倾向于根据世界知识进行判断,而忽略了句法结构。这表明LLM在语言理解方面与人类存在显著差异,需要进一步改进。

🎯 应用场景

该研究成果可应用于提升机器翻译、文本摘要、问答系统等自然语言处理任务的性能。通过改进LLM对复杂句法结构的理解能力,可以提高这些系统在处理歧义语句时的准确性和可靠性。未来的研究可以进一步探索如何将人类的语言处理策略融入到LLM的训练过程中,从而使其更接近人类的理解水平。

📄 摘要(原文)

This study explores how recent large language models (LLMs) navigate relative clause attachment {ambiguity} and use world knowledge biases for disambiguation in six typologically diverse languages: English, Chinese, Japanese, Korean, Russian, and Spanish. We describe the process of creating a novel dataset -- MultiWho -- for fine-grained evaluation of relative clause attachment preferences in ambiguous and unambiguous contexts. Our experiments with three LLMs indicate that, contrary to humans, LLMs consistently exhibit a preference for local attachment, displaying limited responsiveness to syntactic variations or language-specific attachment patterns. Although LLMs performed well in unambiguous cases, they rigidly prioritized world knowledge biases, lacking the flexibility of human language processing. These findings highlight the need for more diverse, pragmatically nuanced multilingual training to improve LLMs' handling of complex structures and human-like comprehension.