Thinking Machines: A Survey of LLM based Reasoning Strategies

作者: Dibyanayan Bandyopadhyay, Soham Bhattacharjee, Asif Ekbal

分类: cs.CL

发布日期: 2025-03-13

💡 一句话要点

综述:基于LLM的推理策略研究,弥合语言能力与推理能力差距

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 推理策略 链式思考 思维树 人工智能 知识推理 自然语言处理

📋 核心要点

- 现有LLM在语言任务上表现出色,但推理能力不足,限制了其在复杂问题解决中的应用。

- 该研究旨在综述LLM推理技术,分析不同方法的优缺点,并探讨未来发展方向。

- 通过对现有推理技术的系统性调研,总结了当前LLM推理面临的挑战,并提出了未来研究方向。

📝 摘要(中文)

大型语言模型(LLM)在基于语言的任务中表现出高度的熟练度。它们的语言能力使它们处于未来通用人工智能(AGI)竞赛的最前沿。然而,仔细观察后发现,它们的语言能力和推理能力之间存在显著差距。LLM和视觉语言模型(VLM)中的推理旨在通过使这些模型能够思考并重新评估其行为和响应来弥合这一差距。推理是复杂问题解决的一项基本能力,也是在人工智能(AI)中建立信任的必要步骤。这将使AI适合部署在医疗保健、银行、法律、国防、安全等敏感领域。近年来,随着像OpenAI O1和DeepSeek R1这样强大的推理模型的出现,推理能力已成为LLM研究中的一个关键主题。在本文中,我们详细概述和比较了现有的推理技术,并对具有推理能力的语言模型进行了系统的调查。我们还研究了当前的挑战并提出了我们的发现。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在推理能力上的不足。尽管LLM在语言理解和生成方面表现出色,但在需要复杂推理的任务中,其表现往往不尽如人意。现有方法在弥合LLM语言能力和推理能力之间的差距方面存在局限性,无法满足医疗、金融等敏感领域对AI的信任需求。

核心思路:论文的核心思路是对现有的LLM推理策略进行全面的梳理和分析,总结各种方法的优缺点,并探讨未来可能的研究方向。通过对不同推理技术的比较,为研究人员提供一个清晰的框架,以便更好地理解和改进LLM的推理能力。

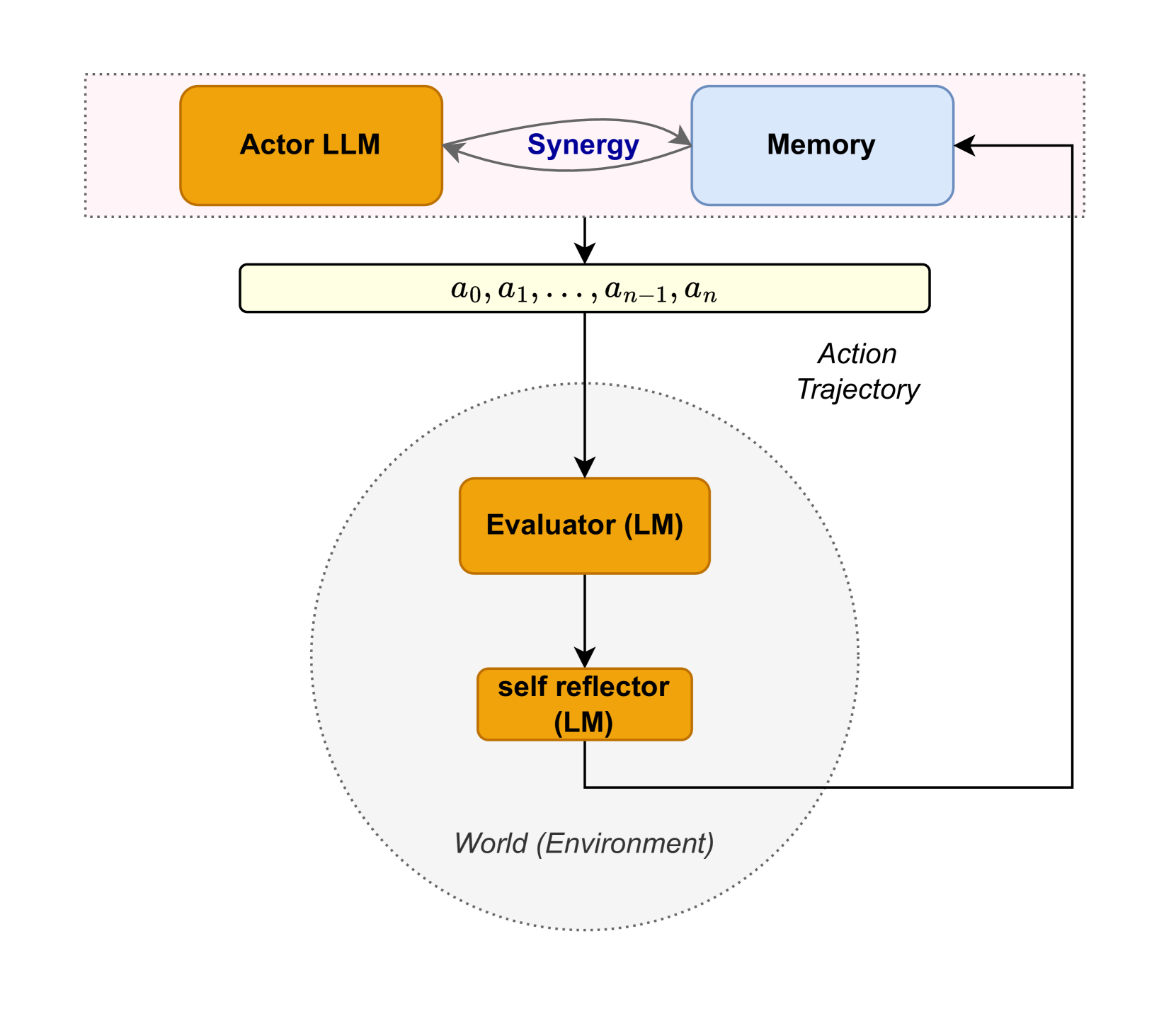

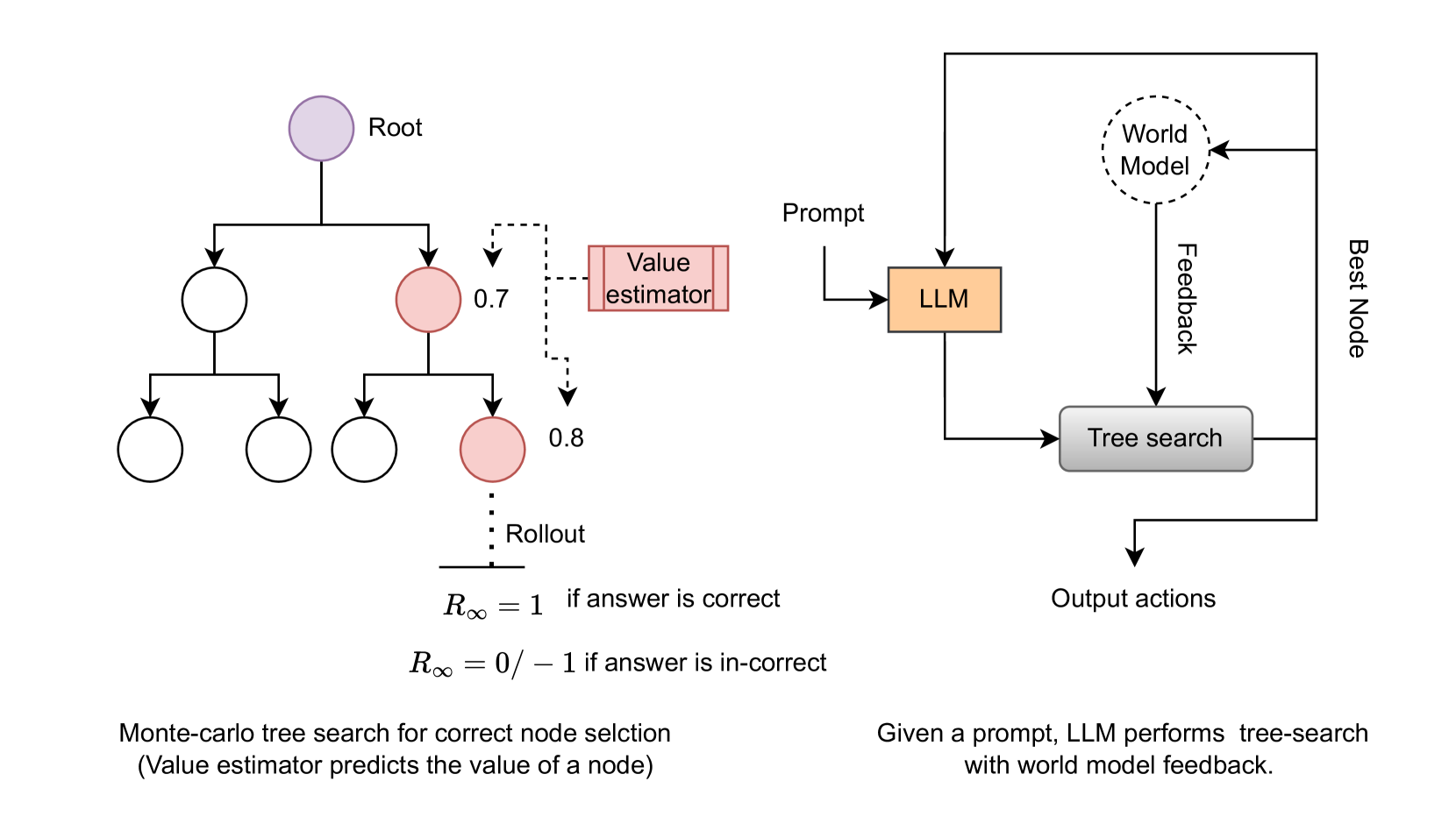

技术框架:该论文采用综述的形式,没有特定的技术框架。其主要工作是对现有文献进行整理、分类和比较。论文首先概述了LLM推理的重要性,然后详细介绍了各种推理技术,包括但不限于:链式思考(Chain-of-Thought)、自洽性(Self-Consistency)、思维树(Tree-of-Thoughts)等。最后,论文总结了当前LLM推理面临的挑战,并提出了未来研究方向。

关键创新:该论文的主要创新在于其系统性和全面性。它不是提出一种新的推理方法,而是对现有的方法进行了一个全面的总结和比较,为研究人员提供了一个有价值的参考。此外,论文还指出了当前LLM推理面临的挑战,为未来的研究提供了方向。

关键设计:由于是综述类文章,没有具体的技术细节。论文的关键在于对现有文献的分类和整理,以及对不同方法的优缺点进行深入的分析和比较。

🖼️ 关键图片

📊 实验亮点

该论文对现有的LLM推理技术进行了全面的综述和比较,总结了当前LLM推理面临的挑战,并提出了未来研究方向。它强调了推理能力在LLM中的重要性,并为研究人员提供了一个有价值的参考框架。论文还提到了像OpenAI O1和DeepSeek R1这样强大的推理模型,表明推理能力已成为LLM研究中的一个关键主题。

🎯 应用场景

该研究成果可应用于医疗诊断、金融风险评估、法律咨询、国防安全等多个领域。通过提升LLM的推理能力,可以使其在这些敏感领域发挥更大的作用,为人类提供更可靠、更智能的服务。未来的研究可以进一步探索如何将不同的推理技术结合起来,以实现更强大的推理能力。

📄 摘要(原文)

Large Language Models (LLMs) are highly proficient in language-based tasks. Their language capabilities have positioned them at the forefront of the future AGI (Artificial General Intelligence) race. However, on closer inspection, Valmeekam et al. (2024); Zecevic et al. (2023); Wu et al. (2024) highlight a significant gap between their language proficiency and reasoning abilities. Reasoning in LLMs and Vision Language Models (VLMs) aims to bridge this gap by enabling these models to think and re-evaluate their actions and responses. Reasoning is an essential capability for complex problem-solving and a necessary step toward establishing trust in Artificial Intelligence (AI). This will make AI suitable for deployment in sensitive domains, such as healthcare, banking, law, defense, security etc. In recent times, with the advent of powerful reasoning models like OpenAI O1 and DeepSeek R1, reasoning endowment has become a critical research topic in LLMs. In this paper, we provide a detailed overview and comparison of existing reasoning techniques and present a systematic survey of reasoning-imbued language models. We also study current challenges and present our findings.