DAST: Difficulty-Aware Self-Training on Large Language Models

作者: Boyang Xue, Qi Zhu, Hongru Wang, Rui Wang, Sheng Wang, Hongling Xu, Fei Mi, Yasheng Wang, Lifeng Shang, Qun Liu, Kam-Fai Wong

分类: cs.CL

发布日期: 2025-03-12

💡 一句话要点

DAST:一种难度感知的大语言模型自训练框架,提升难题解决能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 自训练 难度感知 数据增强 数学问题

📋 核心要点

- 现有LLM自训练方法在处理难题时存在欠采样问题,导致模型在困难样本上的学习不足。

- DAST框架通过难度估计、数据增强等手段,提升自训练过程中难题的生成质量和数量。

- 实验表明,DAST在数学任务上表现出良好的效果和泛化性,验证了难度感知策略的重要性。

📝 摘要(中文)

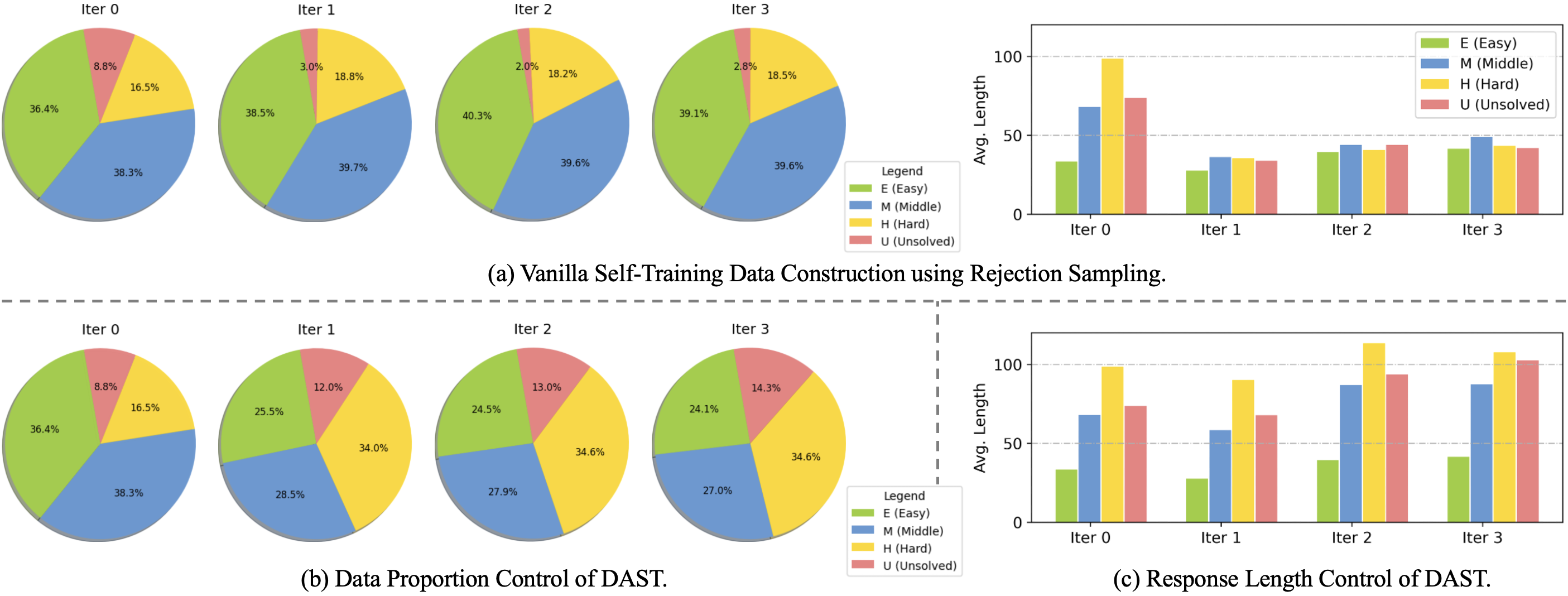

本文提出了一种难度感知的自训练框架(DAST),旨在解决大型语言模型(LLM)自训练过程中对挑战性查询的欠采样问题,从而提升LLM在困难问题上的学习能力。DAST包含三个关键组成部分:1) 基于采样的难度级别估计;2) 难度感知的数据增强;3) 分别使用SFT和DPO的自训练算法。在数学任务上的实验结果表明,DAST的有效性和泛化能力,突出了难度感知策略在推进LLM自训练中的关键作用。

🔬 方法详解

问题定义:现有的大语言模型自训练方法在处理复杂或困难的查询时,往往存在欠采样的问题。这意味着模型在训练过程中,接触到的难题样本相对较少,导致模型在这些难题上的学习效果不佳。这种欠采样问题限制了LLM解决复杂问题的能力。

核心思路:DAST的核心思路是让模型更加关注和学习那些难度较高的样本。通过难度估计来识别出难题,然后有针对性地增加这些难题样本的数量,并提升这些样本的质量。这样可以使模型在自训练过程中,能够充分学习到难题的特征和解法,从而提升其解决难题的能力。

技术框架:DAST框架主要包含三个阶段:1) 难度级别估计:使用基于采样的方法来估计每个查询的难度级别。2) 难度感知的数据增强:根据难度级别,对数据进行增强,增加难题样本的数量。3) 自训练:使用SFT(Supervised Fine-Tuning)和DPO(Direct Preference Optimization)等方法进行自训练,使模型学习增强后的数据。

关键创新:DAST的关键创新在于其难度感知的策略。与传统的自训练方法不同,DAST能够根据样本的难度级别,动态地调整训练策略,从而更加有效地利用数据。这种难度感知的策略可以使模型更加关注和学习那些难度较高的样本,从而提升其解决难题的能力。

关键设计:在难度级别估计方面,论文采用基于采样的方法,通过多次采样生成不同的答案,然后根据这些答案的一致性来估计难度。在数据增强方面,论文采用多种方法,例如回译、同义词替换等,来生成更多的难题样本。在自训练方面,论文分别使用了SFT和DPO两种方法,并对它们的性能进行了比较。

🖼️ 关键图片

📊 实验亮点

实验结果表明,DAST在数学任务上取得了显著的提升。与传统的自训练方法相比,DAST能够更好地解决难题,并且具有良好的泛化能力。具体的性能数据(由于论文摘要未提供具体数值,此处省略)表明,DAST在多个数学数据集上都取得了明显的提升,验证了其有效性。

🎯 应用场景

DAST框架可应用于各种需要解决复杂问题的领域,例如数学、编程、推理等。通过提升LLM在难题上的学习能力,DAST可以帮助LLM更好地解决实际问题,例如自动解题、代码生成、智能问答等,具有广泛的应用前景和实际价值。未来,DAST可以进一步扩展到其他领域,并与其他技术相结合,例如强化学习、迁移学习等,以进一步提升LLM的性能。

📄 摘要(原文)

Present Large Language Models (LLM) self-training methods always under-sample on challenging queries, leading to inadequate learning on difficult problems which limits LLMs' ability. Therefore, this work proposes a difficulty-aware self-training (DAST) framework that focuses on improving both the quantity and quality of self-generated responses on challenging queries during self-training. DAST is specified in three components: 1) sampling-based difficulty level estimation, 2) difficulty-aware data augmentation, and 3) the self-training algorithm using SFT and DPO respectively. Experiments on mathematical tasks demonstrate the effectiveness and generalization of DAST, highlighting the critical role of difficulty-aware strategies in advancing LLM self-training.