Large Language Models Are Effective Human Annotation Assistants, But Not Good Independent Annotators

作者: Feng Gu, Zongxia Li, Carlos Rafael Colon, Benjamin Evans, Ishani Mondal, Jordan Lee Boyd-Graber

分类: cs.CL, cs.AI

发布日期: 2025-03-09 (更新: 2025-04-05)

备注: 9 pages, 4 figures

💡 一句话要点

大型语言模型可辅助人工标注事件,但无法独立完成高质量标注

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 事件标注 人工辅助标注 自然语言处理 信息抽取

📋 核心要点

- 人工事件标注成本高、效率低,难以满足大规模事件分析的需求。

- 利用LLM辅助人工标注,旨在降低标注成本,提高标注效率,同时保证标注质量。

- 实验表明,LLM作为独立标注器效果不佳,但作为辅助工具能显著提升人工标注效率和一致性。

📝 摘要(中文)

事件标注对于识别市场变化、监控突发新闻和理解社会趋势至关重要。虽然专家标注者设定了黄金标准,但人工标注成本高昂且效率低下。与侧重于单一上下文的信息抽取实验不同,本文评估了一个整体工作流程,该流程移除不相关的文档,合并关于同一事件的文档,并标注事件。虽然基于LLM的自动标注优于传统的基于TF-IDF的方法或事件集管理,但与人类专家相比,它们仍然不是可靠的标注者。然而,添加LLM来辅助专家进行事件集管理可以减少变量标注所需的时间和精力。当使用LLM提取事件变量来辅助专家标注者时,他们比完全自动化的LLM在标注方面更一致。

🔬 方法详解

问题定义:论文旨在解决事件标注领域中人工标注成本高、效率低的问题。现有方法,如TF-IDF等,在自动化事件标注方面效果不佳,而完全依赖LLM进行标注的可靠性也无法保证。因此,需要探索一种既能降低成本又能保证质量的事件标注方法。

核心思路:论文的核心思路是利用大型语言模型(LLM)作为辅助工具,而不是完全替代人工标注。通过LLM辅助专家进行事件集管理和变量提取,从而减少人工标注所需的时间和精力,并提高标注的一致性。

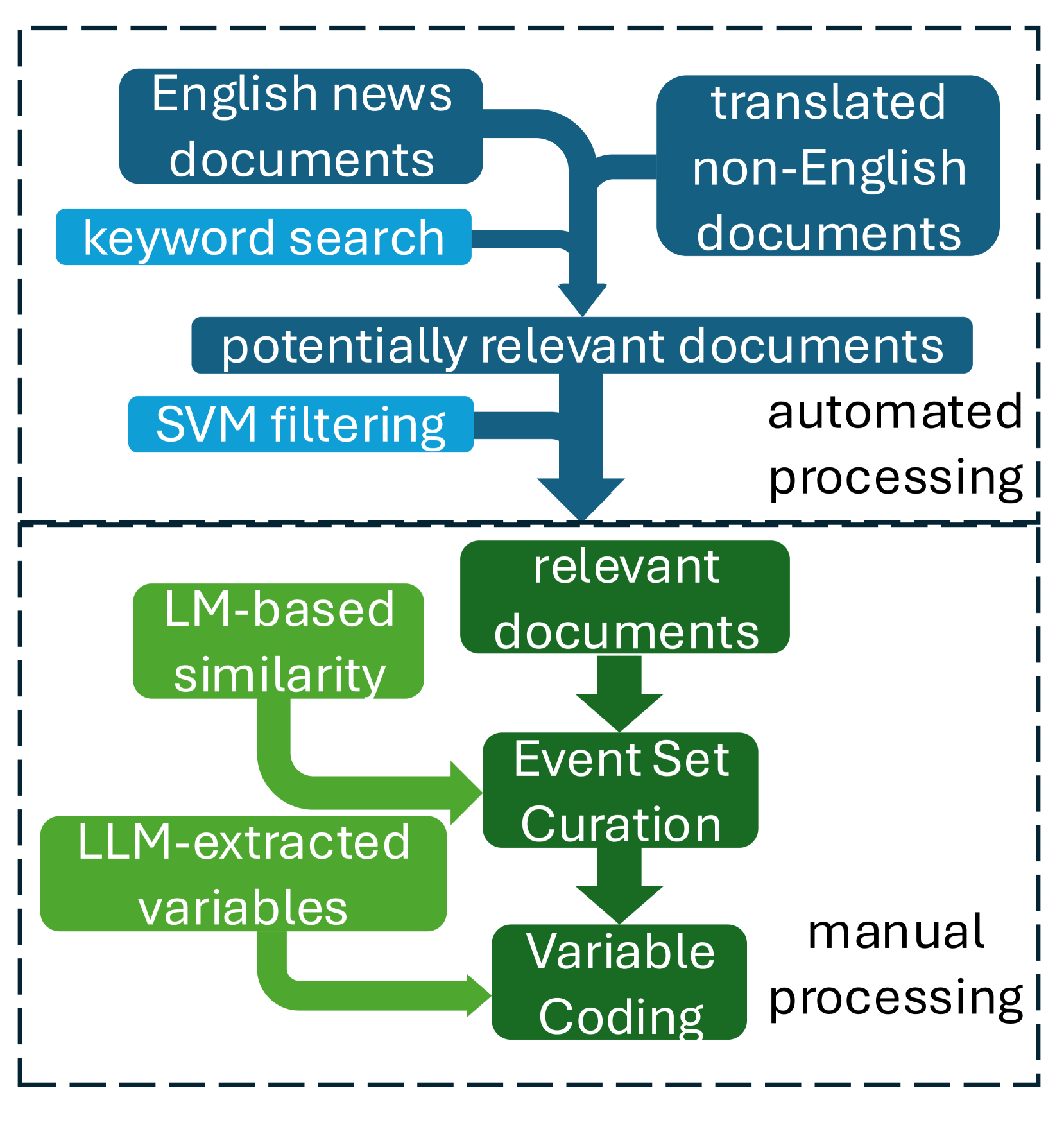

技术框架:整体流程包括:1) 文档预处理,移除不相关文档并合并同一事件的文档;2) 使用LLM进行初步的事件变量提取;3) 专家利用LLM提取的结果进行事件集管理和变量标注;4) 评估标注结果,比较LLM辅助标注与完全人工标注和完全LLM自动标注的效果。

关键创新:论文的关键创新在于提出了LLM辅助人工标注的事件标注框架。该框架充分利用了LLM的自然语言理解和生成能力,同时保留了人工专家的专业知识和判断力,从而实现了成本、效率和质量的平衡。

关键设计:论文的关键设计包括:1) 如何设计合适的prompt,引导LLM进行事件变量提取;2) 如何评估LLM辅助标注的效果,包括与人工标注的一致性和效率提升;3) 如何将LLM提取的事件变量有效地呈现给专家,以便于专家进行事件集管理和变量标注。具体的参数设置、损失函数、网络结构等技术细节在论文中未详细说明,属于LLM本身的能力。

🖼️ 关键图片

📊 实验亮点

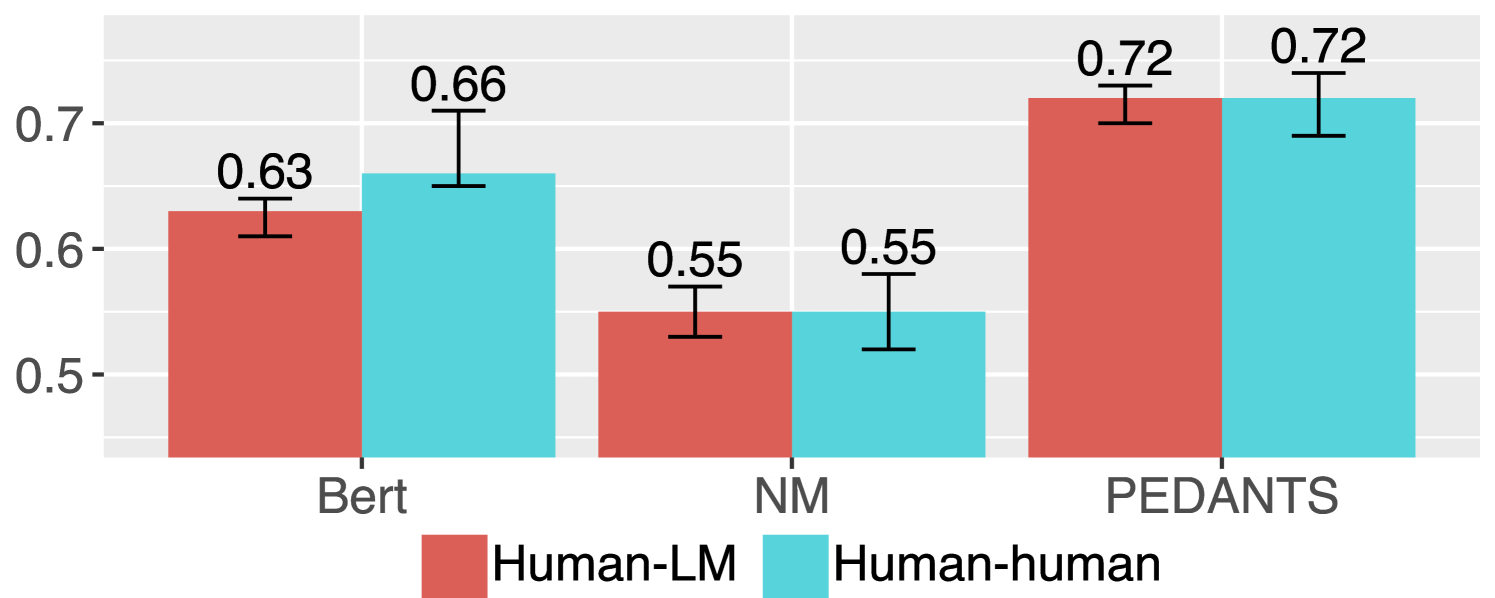

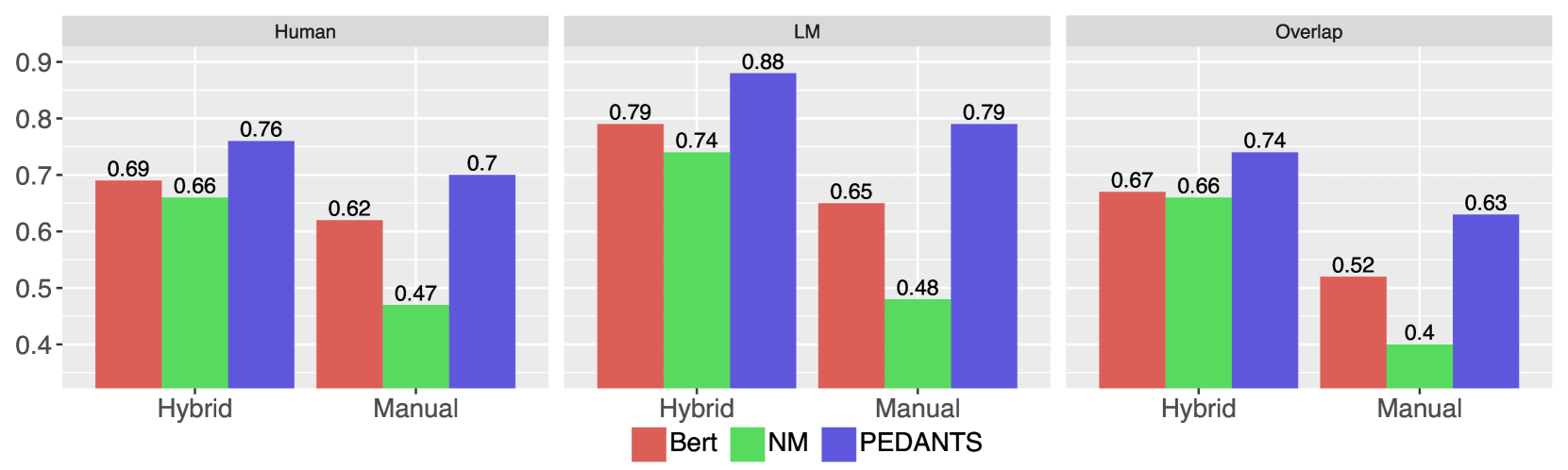

实验结果表明,LLM作为独立的事件标注器效果不如人工专家。然而,当LLM用于辅助专家进行事件集管理和变量提取时,可以显著减少人工标注所需的时间和精力,并提高标注的一致性。专家在LLM辅助下标注的事件变量与人工标注的一致性高于完全由LLM自动标注的结果。

🎯 应用场景

该研究成果可应用于金融市场分析、新闻监控、社会趋势分析等领域。通过LLM辅助人工标注,可以更高效地构建高质量的事件数据集,为相关领域的决策提供更准确、及时的信息支持。未来,该方法有望推广到其他需要大量人工标注的领域,如医疗、法律等。

📄 摘要(原文)

Event annotation is important for identifying market changes, monitoring breaking news, and understanding sociological trends. Although expert annotators set the gold standards, human coding is expensive and inefficient. Unlike information extraction experiments that focus on single contexts, we evaluate a holistic workflow that removes irrelevant documents, merges documents about the same event, and annotates the events. Although LLM-based automated annotations are better than traditional TF-IDF-based methods or Event Set Curation, they are still not reliable annotators compared to human experts. However, adding LLMs to assist experts for Event Set Curation can reduce the time and mental effort required for Variable Annotation. When using LLMs to extract event variables to assist expert annotators, they agree more with the extracted variables than fully automated LLMs for annotation.