SINdex: Semantic INconsistency Index for Hallucination Detection in LLMs

作者: Samir Abdaljalil, Hasan Kurban, Parichit Sharma, Erchin Serpedin, Rachad Atat

分类: cs.CL, cs.AI

发布日期: 2025-03-07

💡 一句话要点

提出SINdex,一种基于语义不一致性的LLM幻觉检测方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 幻觉检测 语义不一致性 句子嵌入 分层聚类

📋 核心要点

- 现有LLM容易产生幻觉,即生成不正确的事实,而基于不确定性的幻觉检测方法具有易用性和兼容性。

- 论文提出一种基于语义聚类的框架,利用句子嵌入、分层聚类和新的不一致性指标SINdex来检测幻觉。

- 实验结果表明,该方法在AUROC指标上优于现有技术,最高提升9.3%,并通过消融实验验证了各组件的有效性。

📝 摘要(中文)

大型语言模型(LLMs)正日益广泛地应用于各个领域,但它们容易产生事实不正确的输出,即所谓的“幻觉”。在现有的缓解策略中,基于不确定性的方法因其易于实现、独立于外部数据以及与标准LLM的兼容性而特别有吸引力。本文提出了一种新颖且可扩展的基于不确定性的语义聚类框架,用于自动幻觉检测。我们的方法利用句子嵌入和分层聚类,以及新提出的不一致性度量SINdex,以产生更同质的聚类,并更准确地检测各种LLM中的幻觉现象。在著名的开放和封闭域问答数据集上的评估表明,我们的方法在AUROC方面比最先进的技术提高了高达9.3%。广泛的消融研究进一步验证了我们框架中每个组件的有效性。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)中普遍存在的幻觉问题,即模型生成不真实或与已知事实相悖的内容。现有方法在幻觉检测方面存在不足,尤其是在准确性和可扩展性方面,并且可能依赖于外部数据或对LLM结构有特殊要求。

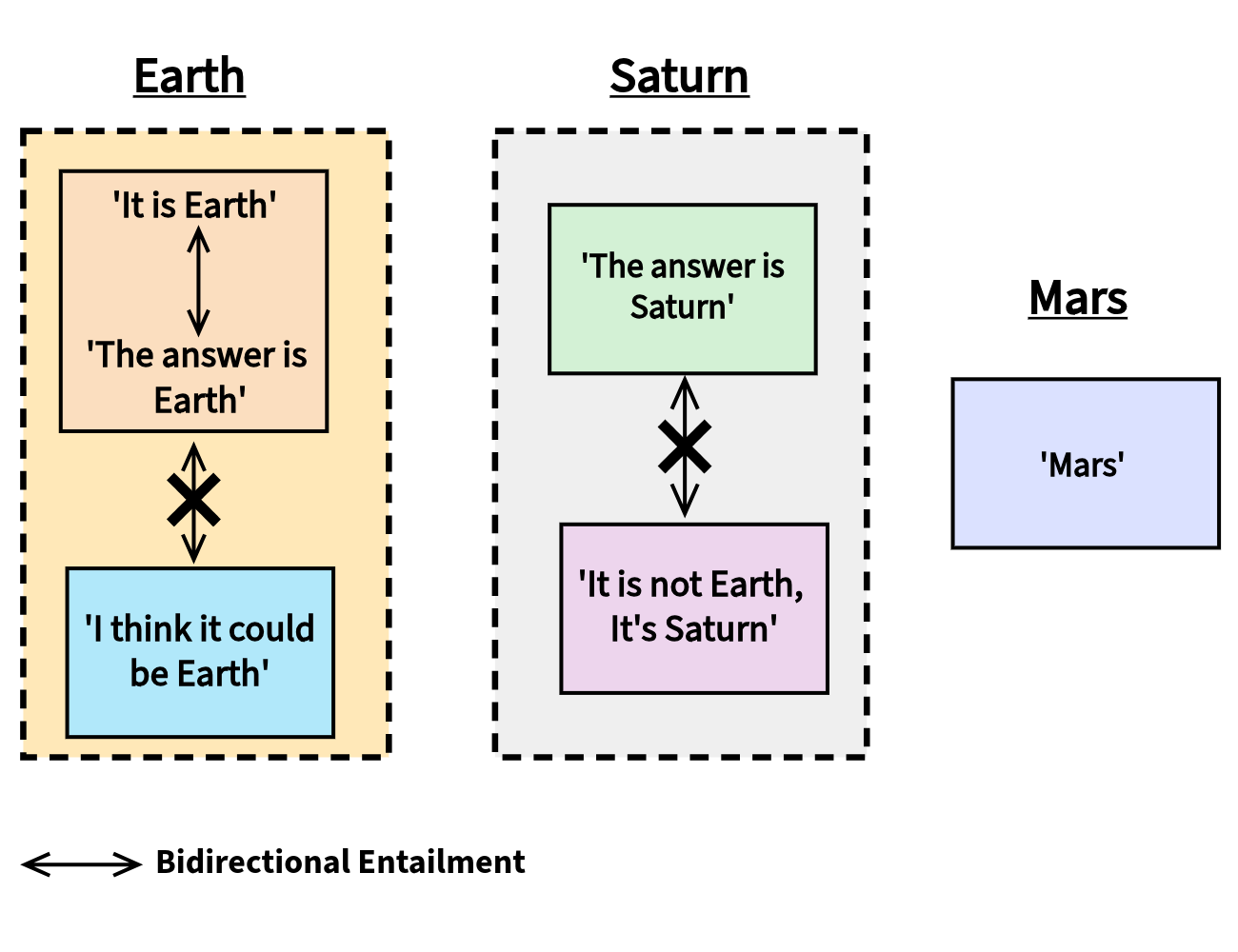

核心思路:论文的核心思路是利用LLM生成文本中句子间的语义不一致性来判断是否存在幻觉。如果模型生成的文本中存在相互矛盾或不一致的陈述,则更有可能存在幻觉。通过量化这种不一致性,可以有效地检测和识别幻觉。

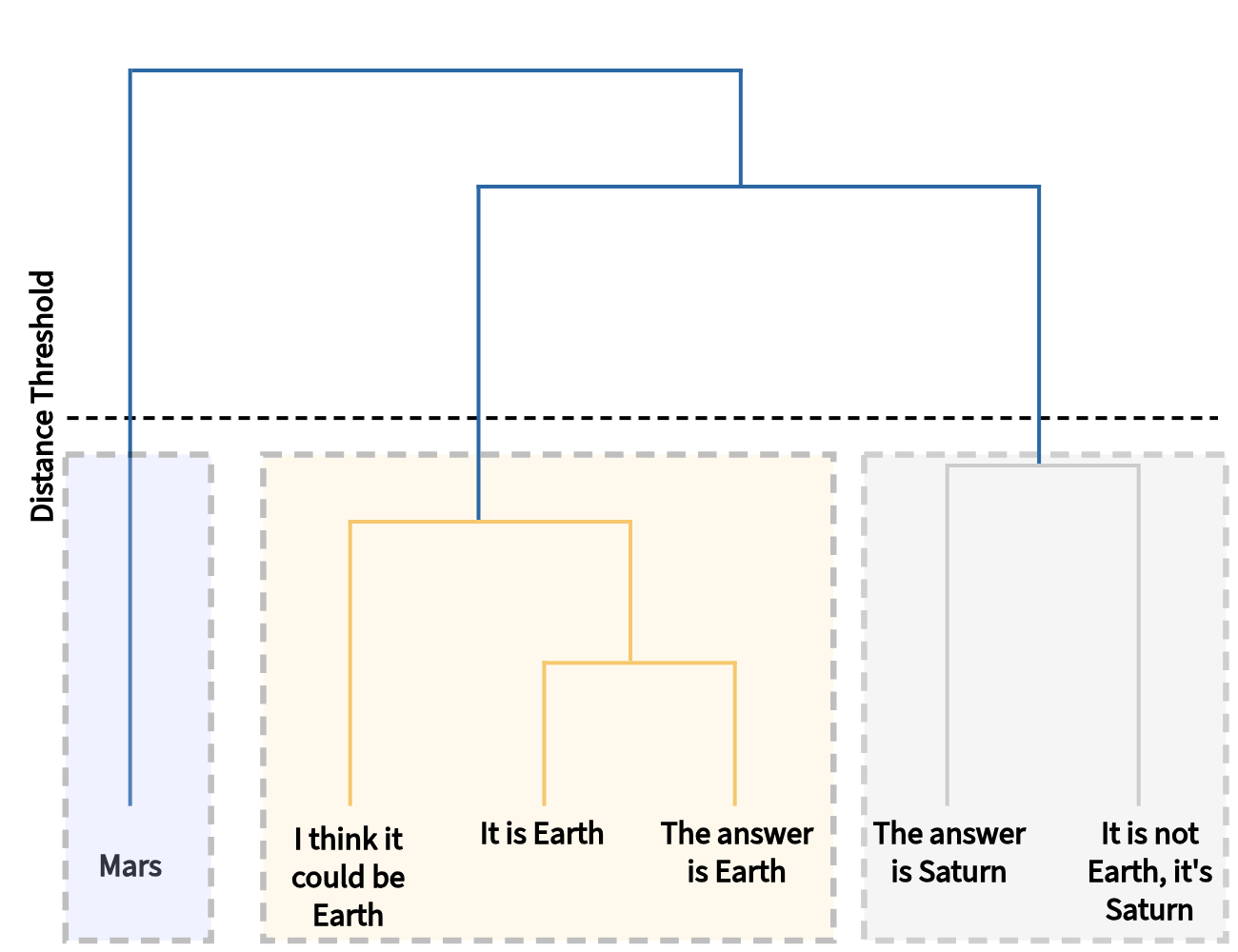

技术框架:该框架主要包含以下几个阶段:1) 使用LLM生成文本;2) 使用句子嵌入模型(如Sentence-BERT)将文本中的每个句子转换为向量表示;3) 使用分层聚类算法对句子嵌入向量进行聚类,形成语义相关的句子簇;4) 引入SINdex(Semantic INconsistency Index)指标,用于衡量每个簇内部句子之间的语义不一致性;5) 基于SINdex值,设定阈值来判断是否存在幻觉。

关键创新:论文的关键创新在于提出了SINdex指标,这是一种新的不一致性度量方法,用于量化句子簇内部的语义不一致性。与传统的基于不确定性的方法相比,SINdex能够更准确地捕捉到幻觉现象,因为它直接关注句子之间的语义关系,而不是仅仅依赖于模型的置信度或概率输出。

关键设计:SINdex的计算方式是基于句子嵌入向量之间的距离。具体来说,对于一个句子簇,SINdex计算该簇中所有句子对之间余弦距离的平均值。距离越大,表示句子之间的语义差异越大,SINdex值越高,幻觉的可能性也越大。此外,分层聚类算法的选择和参数设置(如簇的数量)也会影响最终的幻觉检测效果。论文可能还涉及阈值的选择,用于区分正常文本和包含幻觉的文本。

🖼️ 关键图片

📊 实验亮点

实验结果表明,提出的SINdex方法在开放和封闭域问答数据集上均取得了显著的性能提升,AUROC指标最高提升了9.3%,超过了现有最先进的技术。消融实验验证了SINdex指标和语义聚类框架中各个组件的有效性,证明了该方法在幻觉检测方面的优越性。

🎯 应用场景

该研究成果可应用于各种需要LLM生成可靠信息的场景,例如智能客服、自动问答系统、内容生成平台等。通过自动检测和过滤掉LLM生成的幻觉内容,可以提高用户体验,避免错误信息的传播,并增强人们对LLM的信任。未来,该方法可以进一步扩展到其他类型的生成模型,例如图像生成和语音生成。

📄 摘要(原文)

Large language models (LLMs) are increasingly deployed across diverse domains, yet they are prone to generating factually incorrect outputs - commonly known as "hallucinations." Among existing mitigation strategies, uncertainty-based methods are particularly attractive due to their ease of implementation, independence from external data, and compatibility with standard LLMs. In this work, we introduce a novel and scalable uncertainty-based semantic clustering framework for automated hallucination detection. Our approach leverages sentence embeddings and hierarchical clustering alongside a newly proposed inconsistency measure, SINdex, to yield more homogeneous clusters and more accurate detection of hallucination phenomena across various LLMs. Evaluations on prominent open- and closed-book QA datasets demonstrate that our method achieves AUROC improvements of up to 9.3% over state-of-the-art techniques. Extensive ablation studies further validate the effectiveness of each component in our framework.