QG-SMS: Enhancing Test Item Analysis via Student Modeling and Simulation

作者: Bang Nguyen, Tingting Du, Mengxia Yu, Lawrence Angrave, Meng Jiang

分类: cs.CL, cs.AI, cs.CY, cs.LG

发布日期: 2025-03-07 (更新: 2025-06-19)

备注: Camera Ready - ACL 2025 Main

💡 一句话要点

提出QG-SMS框架,利用学生建模与模拟增强试题分析,提升问题生成评估质量

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 问题生成评估 试题分析 学生建模 大型语言模型 教育评估

📋 核心要点

- 现有QG评估方法未能充分考虑试题的教育价值,无法准确评估试题质量与学生表现之间的关系。

- QG-SMS框架利用大型语言模型模拟学生,从学生角度分析试题,从而更全面地评估试题质量。

- 实验结果表明,QG-SMS框架能够更有效地评估试题,并得到人工评估的验证,提升了评估的鲁棒性。

📝 摘要(中文)

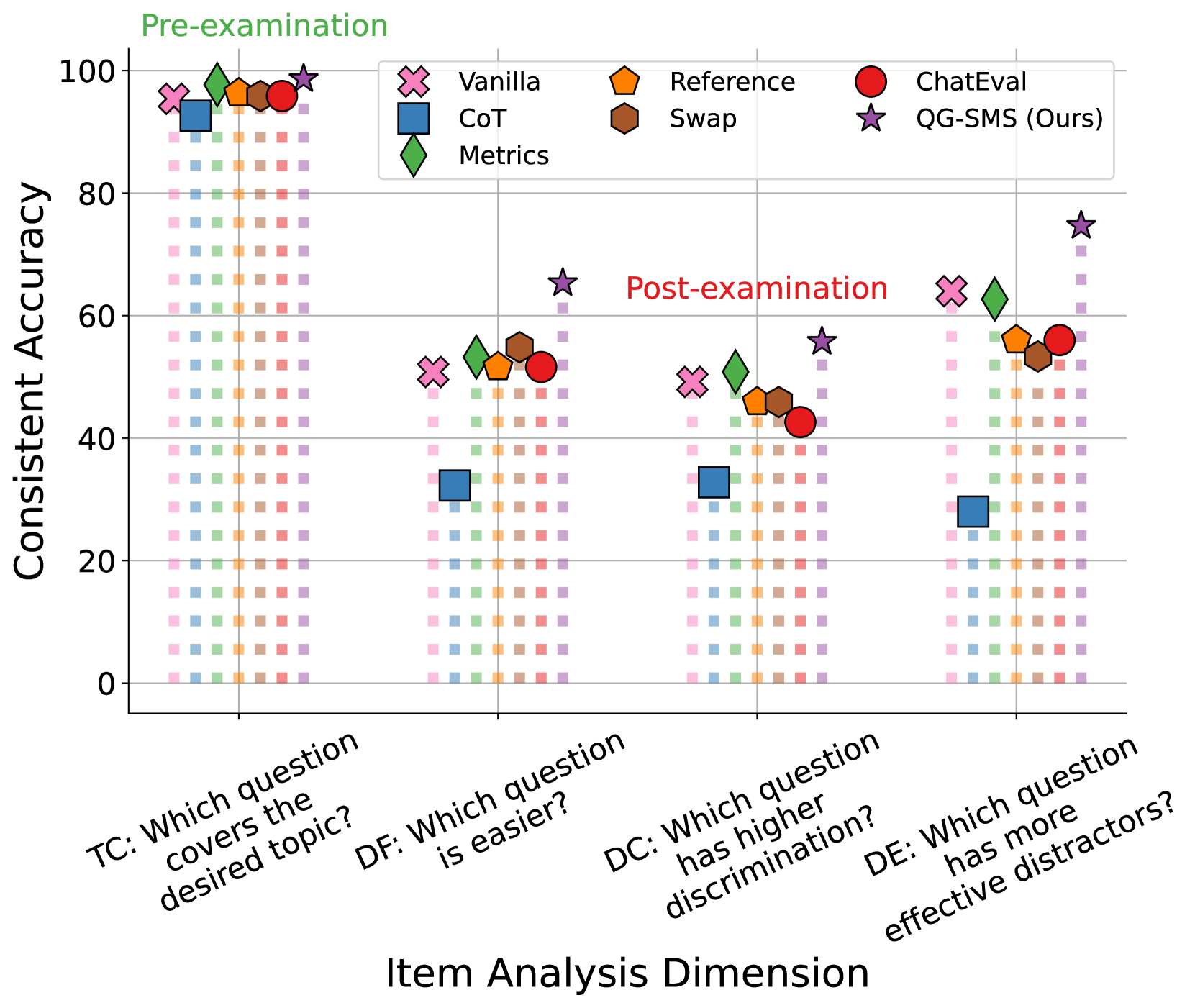

问题生成(QG)任务在教育评估中应用日益广泛,但其评估方法与试题的教育价值缺乏明确联系。本文将教育工作者常用的试题分析方法引入QG评估,构建候选问题对,这些问题对在主题覆盖、难度、区分度和干扰项效率等方面存在质量差异。研究发现,现有QG评估方法在准确评估与学生表现相关的试题质量方面存在显著不足。为此,我们提出了QG-SMS框架,该框架利用大型语言模型进行学生建模与模拟,从而执行试题分析。实验和人工评估表明,模拟学生档案引入的额外视角能够更有效、更稳健地评估试题。

🔬 方法详解

问题定义:现有问题生成(QG)评估方法主要关注生成问题的流畅性和相关性,缺乏对试题教育价值的考量。教育工作者通常使用试题分析来评估试题的质量,包括主题覆盖、难度、区分度和干扰项效率等。现有QG评估方法无法有效区分在这些维度上存在差异的试题,导致评估结果与实际教学效果脱节。

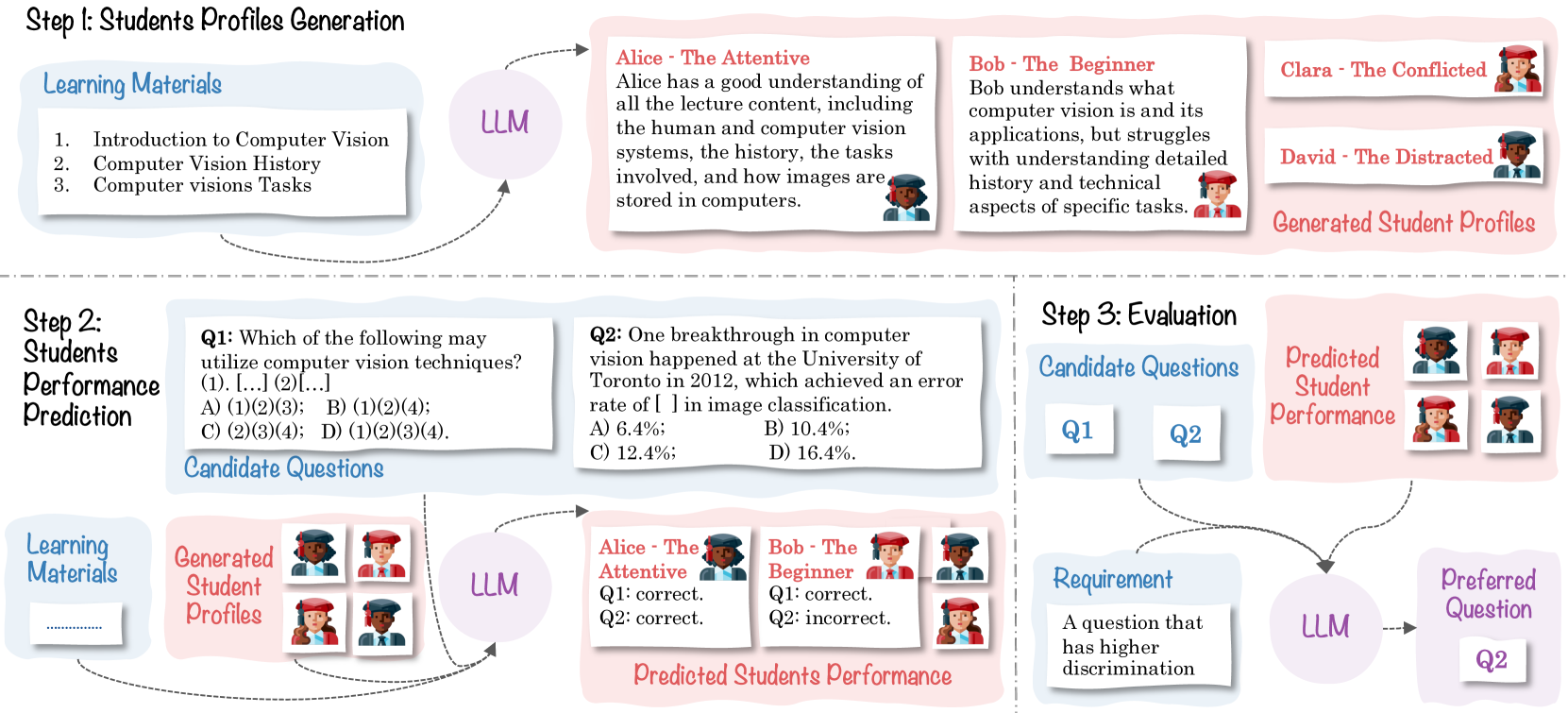

核心思路:QG-SMS的核心思路是引入学生建模与模拟,从学生的角度来评估试题的质量。通过模拟不同能力水平的学生对试题的作答情况,可以更全面地了解试题的难度、区分度和干扰项的有效性。这种方法能够弥补现有QG评估方法的不足,更准确地反映试题的教育价值。

技术框架:QG-SMS框架主要包含以下几个模块:1) 试题生成模块:生成不同质量的候选试题。2) 学生建模模块:利用大型语言模型构建学生模型,模拟不同能力水平的学生。3) 学生模拟模块:模拟学生对候选试题的作答情况,生成学生作答数据。4) 试题分析模块:基于学生作答数据,分析试题的难度、区分度和干扰项效率等指标。5) 评估模块:综合考虑试题分析结果和现有QG评估指标,对试题进行综合评估。

关键创新:QG-SMS的关键创新在于将学生建模与模拟引入QG评估。通过模拟学生作答,可以更全面地了解试题的教育价值,弥补了现有QG评估方法的不足。此外,QG-SMS框架还能够利用大型语言模型构建更真实、更有效的学生模型,提高评估的准确性。

关键设计:在学生建模模块中,可以使用不同的大型语言模型,例如BERT、GPT等。可以根据学生的知识水平和学习习惯,调整模型的参数和训练数据。在学生模拟模块中,可以使用不同的作答策略,例如随机作答、根据知识点作答等。在试题分析模块中,可以使用不同的统计指标,例如难度系数、区分度系数、干扰项选择率等。损失函数的设计需要综合考虑试题分析结果和现有QG评估指标,以实现更准确的试题评估。

🖼️ 关键图片

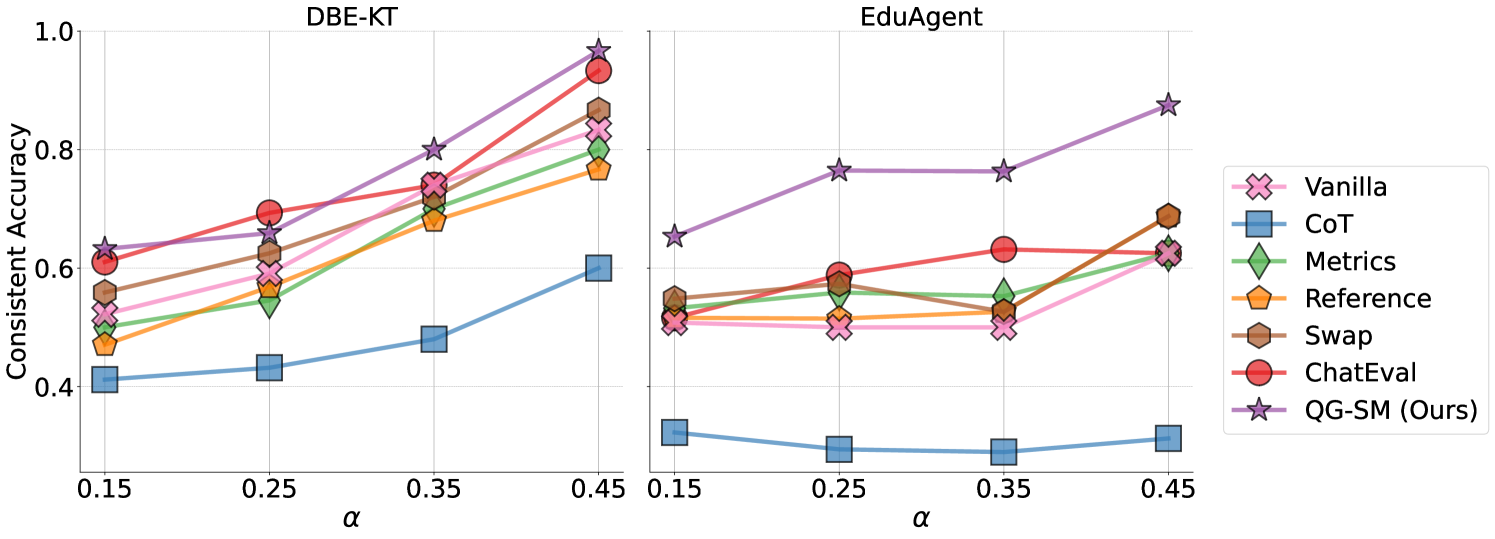

📊 实验亮点

实验结果表明,QG-SMS框架能够更有效地评估试题质量,与现有QG评估方法相比,在区分不同质量试题方面表现更优。人工评估结果也验证了QG-SMS框架的有效性,表明其能够更准确地反映试题的教育价值。具体性能提升数据未知。

🎯 应用场景

QG-SMS框架可应用于在线教育平台、智能题库系统和教育评估机构,用于自动评估试题质量,辅助教师进行试题设计和筛选,提升教学效果。该研究有助于推动个性化学习和自适应评估的发展,为学生提供更优质的教育资源。

📄 摘要(原文)

While the Question Generation (QG) task has been increasingly adopted in educational assessments, its evaluation remains limited by approaches that lack a clear connection to the educational values of test items. In this work, we introduce test item analysis, a method frequently used by educators to assess test question quality, into QG evaluation. Specifically, we construct pairs of candidate questions that differ in quality across dimensions such as topic coverage, item difficulty, item discrimination, and distractor efficiency. We then examine whether existing QG evaluation approaches can effectively distinguish these differences. Our findings reveal significant shortcomings in these approaches with respect to accurately assessing test item quality in relation to student performance. To address this gap, we propose a novel QG evaluation framework, QG-SMS, which leverages Large Language Model for Student Modeling and Simulation to perform test item analysis. As demonstrated in our extensive experiments and human evaluation study, the additional perspectives introduced by the simulated student profiles lead to a more effective and robust assessment of test items.