WikiBigEdit: Understanding the Limits of Lifelong Knowledge Editing in LLMs

作者: Lukas Thede, Karsten Roth, Matthias Bethge, Zeynep Akata, Tom Hartvigsen

分类: cs.CL, cs.LG

发布日期: 2025-03-07 (更新: 2025-09-21)

备注: published at ICML 2025

💡 一句话要点

提出WikiBigEdit大规模基准,评估LLM终身知识编辑的极限

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 知识编辑 大型语言模型 终身学习 基准测试 Wikidata

📋 核心要点

- 现有知识编辑方法缺乏大规模真实数据的验证,难以评估其在实际场景中的有效性。

- 论文提出WikiBigEdit基准,包含大规模真实世界的Wikidata编辑数据,用于评估终身知识编辑技术。

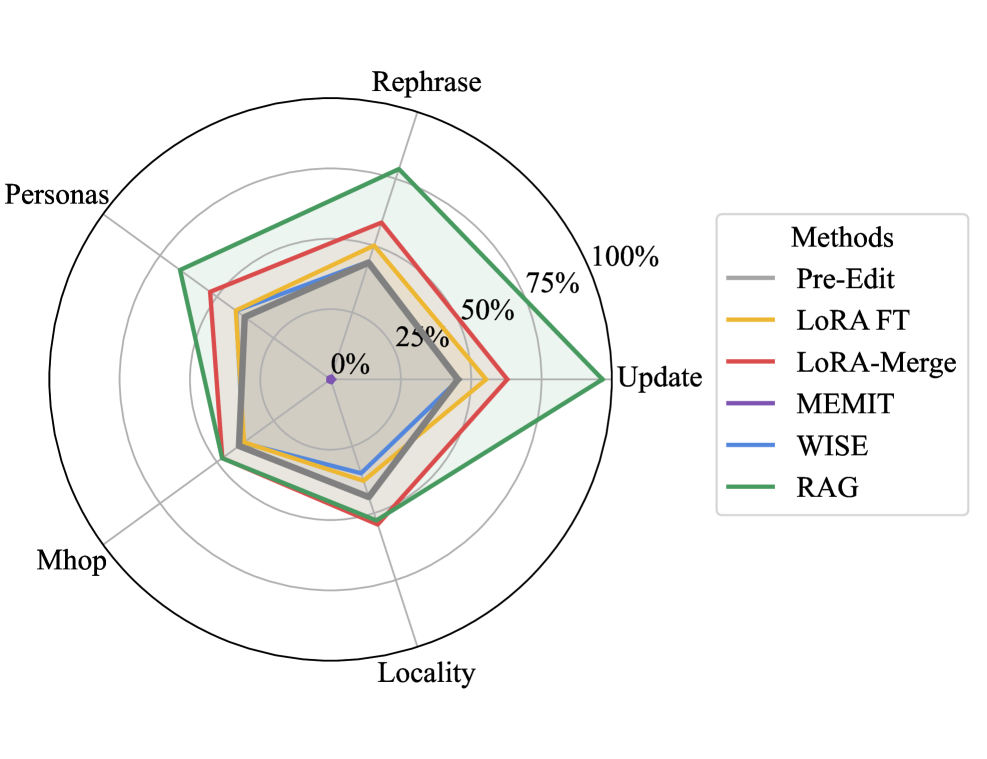

- 通过WikiBigEdit,研究对比了现有知识编辑技术与检索增强、持续微调等方法的性能。

📝 摘要(中文)

保持大型语言模型的事实知识更新对于部署至关重要,但代价高昂的重新训练仍然是一个挑战。知识编辑提供了一种有希望的替代方案,但现有方法仅在小规模或合成编辑基准上进行测试。本文旨在将终身知识编辑的研究与实际编辑联系起来,并达到实际相关的规模。首先,我们引入WikiBigEdit,这是一个大规模的真实世界Wikidata编辑基准,旨在自动扩展终身学习,以实现面向未来的基准测试。在其第一个实例中,它包括超过50万个用于知识编辑的问答对,以及一个全面的评估流程。最后,我们使用WikiBigEdit来研究现有知识编辑技术整合大量真实世界事实的能力,并将它们的能力与通用修改技术(如检索增强和持续微调)进行对比,以全面了解当前终身知识编辑的实际范围。

🔬 方法详解

问题定义:现有知识编辑方法主要在小规模或合成数据集上进行评估,无法真实反映其在实际应用中的性能。重新训练LLM成本高昂,而现有的知识编辑方法在处理大规模真实世界知识更新时面临挑战,缺乏有效的评估手段。

核心思路:论文的核心思路是构建一个大规模、真实的知识编辑基准WikiBigEdit,用于全面评估现有知识编辑技术在处理真实世界知识更新时的能力。通过对比知识编辑技术与通用修改技术(如检索增强和持续微调),更清晰地了解当前终身知识编辑的实际效果。

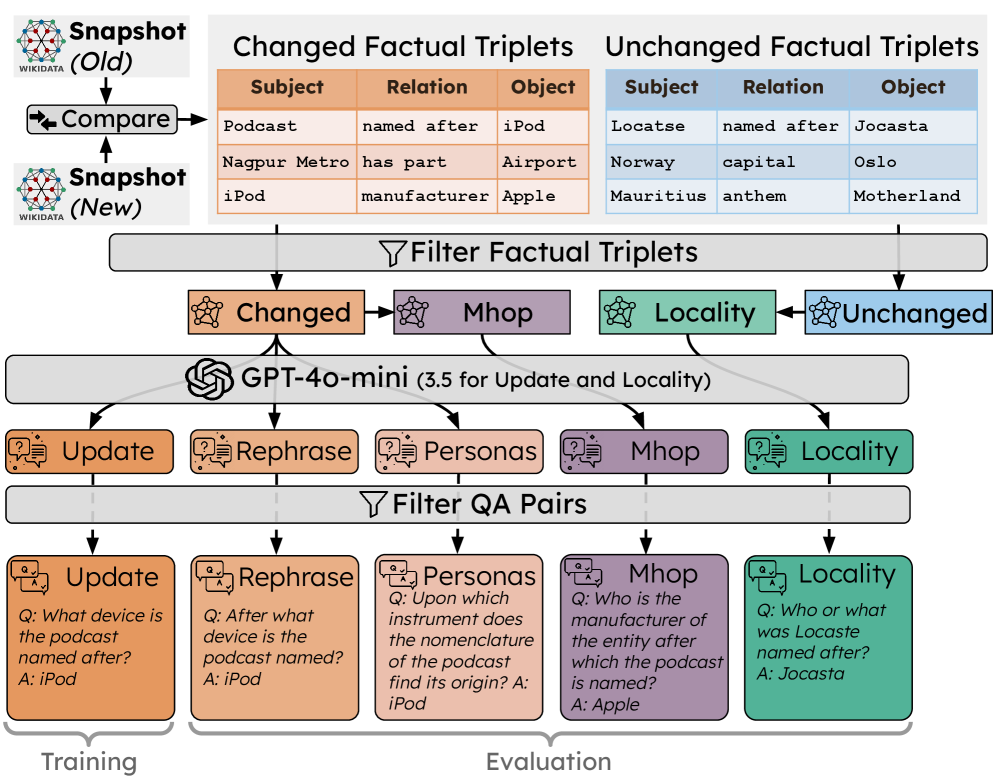

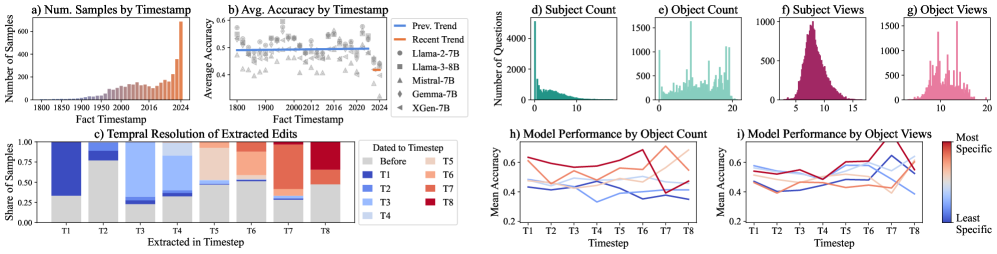

技术框架:WikiBigEdit基准包含超过50万个问答对,这些问答对来源于真实的Wikidata编辑。论文构建了一个完整的评估流程,用于评估各种知识编辑技术在WikiBigEdit上的性能。评估流程包括多个指标,例如编辑的准确性、泛化能力和副作用。同时,论文将知识编辑方法与检索增强和持续微调等通用方法进行对比。

关键创新:WikiBigEdit是关键创新点,它是一个大规模、真实的知识编辑基准,弥补了现有研究在真实数据规模上的不足。该基准能够更全面地评估知识编辑技术在实际应用中的性能,并为未来的研究提供了标准化的评估平台。

关键设计:WikiBigEdit的数据来源于真实的Wikidata编辑,保证了数据的真实性和多样性。论文设计了全面的评估指标,包括编辑的准确性、泛化能力和副作用,能够更全面地评估知识编辑技术的性能。评估流程中,将知识编辑方法与检索增强和持续微调等通用方法进行对比,能够更清晰地了解知识编辑技术的优势和局限性。

🖼️ 关键图片

📊 实验亮点

论文构建了包含超过50万个问答对的大规模真实世界知识编辑基准WikiBigEdit。通过该基准,研究人员可以更全面地评估现有知识编辑技术在处理真实世界知识更新时的能力。实验结果表明,现有知识编辑技术在处理大规模真实数据时仍面临挑战,与检索增强和持续微调等通用方法相比,优势并不明显。

🎯 应用场景

该研究成果可应用于提升大型语言模型的事实一致性和知识更新能力。WikiBigEdit基准的发布,能够促进知识编辑领域的研究,并推动相关技术在智能客服、信息检索、自动问答等领域的应用。未来,可以基于该基准开发更高效、更可靠的知识编辑方法,从而构建更智能、更实用的语言模型。

📄 摘要(原文)

Keeping large language models factually up-to-date is crucial for deployment, yet costly retraining remains a challenge. Knowledge editing offers a promising alternative, but methods are only tested on small-scale or synthetic edit benchmarks. In this work, we aim to bridge research into lifelong knowledge editing to real-world edits at a practically relevant scale. We first introduce WikiBigEdit; a large-scale benchmark of real-world Wikidata edits, built to automatically extend lifelong for future-proof benchmarking. In its first instance, it includes over 500K question-answer pairs for knowledge editing alongside a comprehensive evaluation pipeline. Finally, we use WikiBigEdit to study existing knowledge editing techniques' ability to incorporate large volumes of real-world facts and contrast their capabilities to generic modification techniques such as retrieval augmentation and continual finetuning to acquire a complete picture of the practical extent of current lifelong knowledge editing.