Dynamic Knowledge Integration for Evidence-Driven Counter-Argument Generation with Large Language Models

作者: Anar Yeginbergen, Maite Oronoz, Rodrigo Agerri

分类: cs.CL, cs.AI

发布日期: 2025-03-07 (更新: 2025-06-20)

备注: ACL 2025

💡 一句话要点

提出动态知识集成方法,提升大语言模型生成证据驱动的反驳论证质量

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 反驳论证生成 大语言模型 动态知识集成 证据驱动 LLM评估

📋 核心要点

- 现有大语言模型在论证任务中生成内容冗长,且可能包含不实信息,缺乏可控性和证据支持。

- 论文提出动态外部知识集成方法,利用实时网络信息增强LLM,生成更具相关性、说服力和事实性的反驳论证。

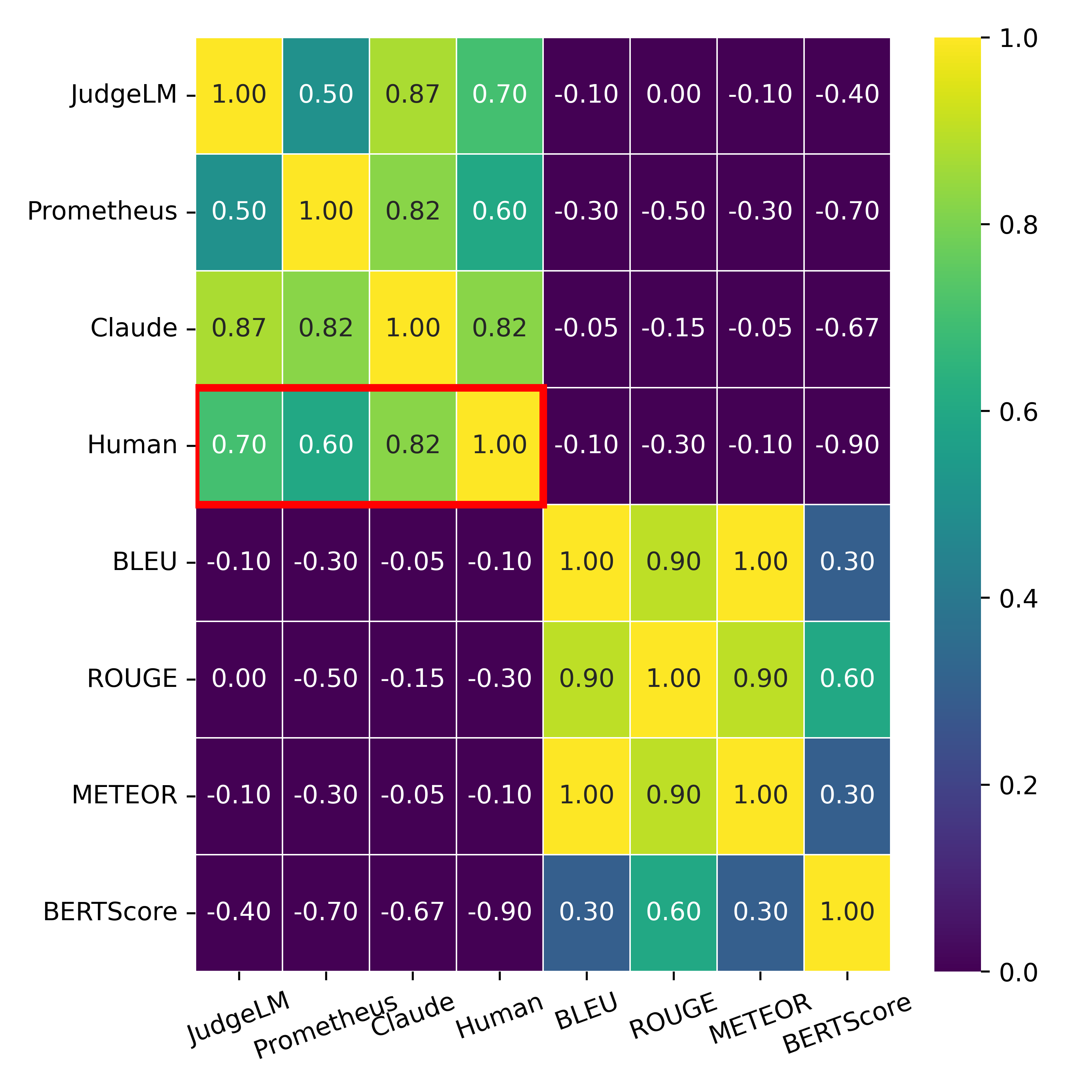

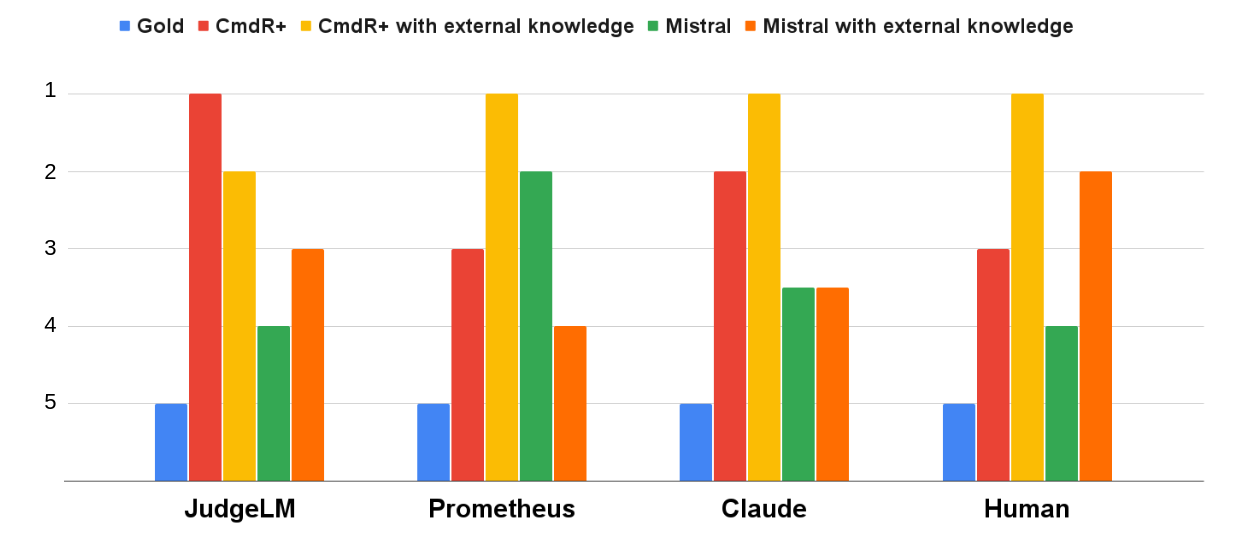

- 实验结果表明,该方法显著提升了反驳论证的质量,并且提出的LLM-as-a-Judge评估方法与人类判断更一致。

📝 摘要(中文)

本文研究了动态外部知识集成在提升大语言模型(LLM)生成反驳论证方面的作用。尽管LLM在论证任务中表现出潜力,但其生成冗长且可能不真实的回复的倾向,凸显了对更可控和基于证据的方法的需求。我们引入了一个新的手动策划的论证和反驳论证对数据集,专门设计用于平衡论证复杂性和评估可行性。我们还提出了一种新的LLM-as-a-Judge评估方法,与传统的基于参考的指标相比,该方法与人类判断具有更强的相关性。实验结果表明,集成来自网络的动态外部知识显著提高了生成的反驳论证的质量,特别是在相关性、说服力和事实性方面。研究结果表明,将LLM与实时外部知识检索相结合,为开发更有效和可靠的反驳论证系统提供了一个有希望的方向。

🔬 方法详解

问题定义:论文旨在解决大语言模型在生成反驳论证时,缺乏事实依据、可信度不高的问题。现有方法依赖于模型自身的知识,容易产生不准确或不相关的论证,难以保证生成内容的说服力。

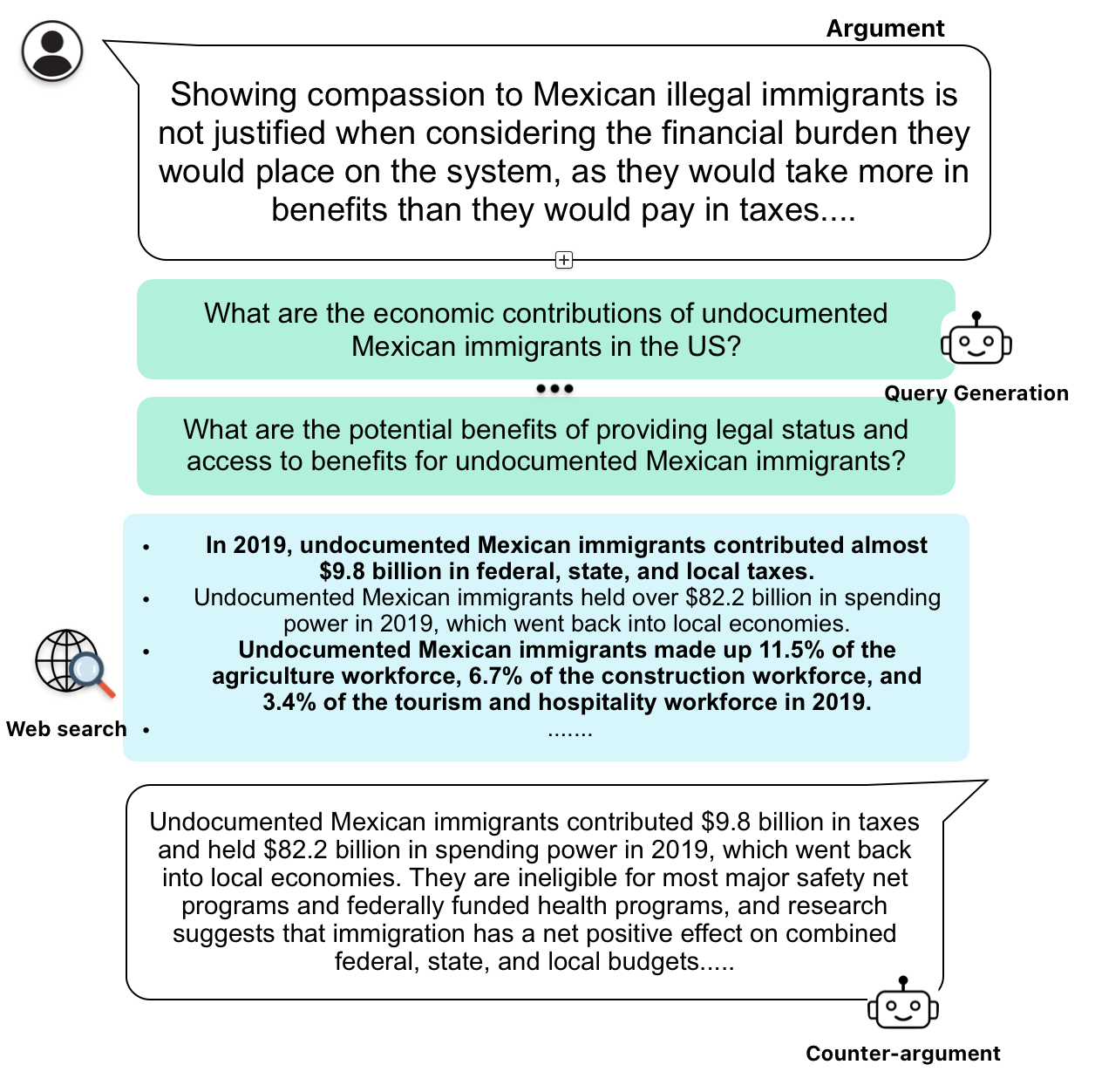

核心思路:核心思路是将大语言模型与动态外部知识检索相结合。通过实时从网络上获取相关信息,为LLM提供生成反驳论证所需的证据支持,从而提高生成内容的相关性、事实性和说服力。

技术框架:整体框架包含以下几个主要阶段:1) 接收原始论证;2) 使用检索模型(如搜索引擎)从网络上检索相关信息;3) 将检索到的信息与原始论证一起输入到大语言模型中;4) 大语言模型基于原始论证和检索到的信息生成反驳论证;5) 使用LLM-as-a-Judge评估方法评估生成的反驳论证的质量。

关键创新:关键创新在于动态知识集成,即在生成反驳论证的过程中,实时地从外部知识源(如互联网)获取信息,并将其融入到LLM的生成过程中。这与以往依赖于模型自身知识的方法有本质区别,能够显著提高生成内容的事实性和相关性。此外,提出的LLM-as-a-Judge评估方法也更贴近人类的判断标准。

关键设计:论文中没有详细描述具体的参数设置、损失函数或网络结构等技术细节。但可以推测,检索模型的选择、检索结果的过滤和排序、以及如何将检索到的信息有效地融入到LLM的输入中,都是需要仔细设计的关键环节。此外,LLM-as-a-Judge评估方法的具体实现,例如prompt的设计,也会影响评估结果的准确性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,集成动态外部知识后,生成的反驳论证在相关性、说服力和事实性方面均有显著提升。此外,提出的LLM-as-a-Judge评估方法与人类判断的相关性更高,优于传统的基于参考的指标。具体性能提升数据未知,但整体趋势表明动态知识集成策略的有效性。

🎯 应用场景

该研究成果可应用于智能辩论系统、舆情分析、虚假信息检测等领域。通过提供更可靠和有说服力的反驳论证,可以帮助人们更好地理解复杂问题,做出更明智的决策。未来,该技术有望应用于自动化内容审核、智能客服等场景,提高信息质量和用户体验。

📄 摘要(原文)

This paper investigates the role of dynamic external knowledge integration in improving counter-argument generation using Large Language Models (LLMs). While LLMs have shown promise in argumentative tasks, their tendency to generate lengthy, potentially unfactual responses highlights the need for more controlled and evidence-based approaches. We introduce a new manually curated dataset of argument and counter-argument pairs specifically designed to balance argumentative complexity with evaluative feasibility. We also propose a new LLM-as-a-Judge evaluation methodology that shows a stronger correlation with human judgments compared to traditional reference-based metrics. Our experimental results demonstrate that integrating dynamic external knowledge from the web significantly improves the quality of generated counter-arguments, particularly in terms of relatedness, persuasiveness, and factuality. The findings suggest that combining LLMs with real-time external knowledge retrieval offers a promising direction for developing more effective and reliable counter-argumentation systems.