Shifting Long-Context LLMs Research from Input to Output

作者: Yuhao Wu, Yushi Bai, Zhiqing Hu, Shangqing Tu, Ming Shan Hee, Juanzi Li, Roy Ka-Wei Lee

分类: cs.CL, cs.AI

发布日期: 2025-03-06 (更新: 2025-03-07)

备注: Preprint

💡 一句话要点

呼吁NLP研究从长文本输入转向长文本输出,填补LLM在长文本生成方面的能力空白。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 长文本生成 大语言模型 自然语言处理 长上下文 文本连贯性 文本逻辑性 内容创作

📋 核心要点

- 现有长文本LLM研究主要关注长文本输入理解,忽略了长文本生成能力,导致模型在小说写作等任务中表现不足。

- 论文呼吁研究重心转向长文本生成,强调开发能够生成连贯、上下文丰富、逻辑一致长文本的基础LLM。

- 该研究旨在填补当前LLM在长文本生成方面的能力空白,为实际应用提供更强大的长文本生成模型。

📝 摘要(中文)

近年来,长文本大语言模型(LLM)的进展主要集中在处理扩展的输入上下文上,从而在长文本理解方面取得了显著进步。然而,生成长篇输出这一同样重要的方面却受到了相对较少的关注。本文提倡自然语言处理研究的范式转变,以解决长输出生成所面临的挑战。小说写作、长期规划和复杂推理等任务要求模型理解广泛的上下文,并生成连贯、上下文丰富且逻辑一致的长文本。这些需求突显了当前LLM能力的一个关键差距。我们强调了这个未被充分探索的领域的重要性,并呼吁集中精力开发专门为生成高质量长篇输出而量身定制的基础LLM,这些LLM在实际应用中具有巨大的潜力。

🔬 方法详解

问题定义:现有的大语言模型(LLM)研究主要集中在如何处理和理解长输入文本,例如阅读长篇文档并从中提取信息。然而,在生成长篇连贯的输出文本方面,例如撰写小说、进行长期规划或进行复杂的推理,现有的LLM能力还存在明显的不足。这些任务需要模型不仅理解长上下文,还要能够生成逻辑一致、上下文相关的长文本,而这正是现有方法的痛点。

核心思路:论文的核心思路是将研究重点从长文本输入转向长文本输出。作者认为,虽然理解长文本很重要,但生成高质量的长文本同样至关重要。因此,需要专门设计和优化LLM,使其能够更好地生成长篇、连贯、逻辑性强的文本。这种转变旨在弥补当前LLM在长文本生成方面的能力差距。

技术框架:论文本身并没有提出一个具体的技术框架,而更多的是一种研究方向的倡议。未来的研究可以从以下几个方面入手:1) 探索新的模型架构,例如分层Transformer或记忆增强Transformer,以更好地处理长距离依赖关系;2) 设计新的训练目标和损失函数,例如鼓励生成文本的连贯性和逻辑性;3) 开发新的评估指标,以更全面地评估长文本生成模型的性能。

关键创新:该论文的关键创新在于提出了一个研究方向的转变,即从关注长文本输入转向关注长文本输出。虽然现有的研究主要集中在如何让LLM更好地理解长文本,但该论文强调了生成长文本的重要性,并呼吁研究人员投入更多精力来解决长文本生成所面临的挑战。

关键设计:由于论文主要是一个研究方向的倡议,因此没有具体的参数设置、损失函数或网络结构等技术细节。未来的研究可以探索各种不同的技术方案,例如:1) 使用强化学习来优化生成文本的连贯性和逻辑性;2) 使用对抗生成网络(GAN)来提高生成文本的质量;3) 使用知识图谱来增强生成文本的上下文相关性。

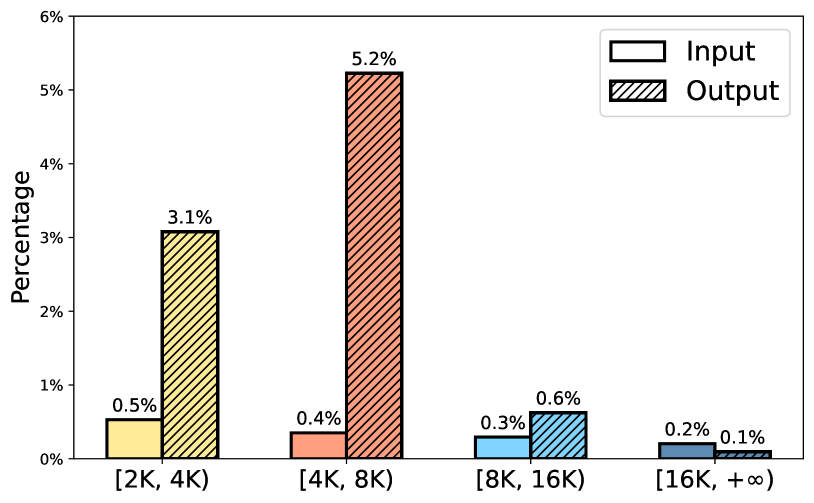

🖼️ 关键图片

📊 实验亮点

该论文是一篇呼吁性质的文章,没有具体的实验结果。其亮点在于指出了当前长文本LLM研究的不足,并提出了一个重要的研究方向,即关注长文本生成。未来的研究可以基于此方向,探索各种新的技术方案,并使用各种评估指标来衡量长文本生成模型的性能。

🎯 应用场景

该研究的潜在应用领域包括:小说写作、剧本创作、新闻报道、长期规划、自动报告生成、智能客服、教育辅导等。通过提升LLM的长文本生成能力,可以实现更智能、更高效的内容创作和信息服务,为各行各业带来实际价值,并推动人工智能在内容生成领域的进一步发展。

📄 摘要(原文)

Recent advancements in long-context Large Language Models (LLMs) have primarily concentrated on processing extended input contexts, resulting in significant strides in long-context comprehension. However, the equally critical aspect of generating long-form outputs has received comparatively less attention. This paper advocates for a paradigm shift in NLP research toward addressing the challenges of long-output generation. Tasks such as novel writing, long-term planning, and complex reasoning require models to understand extensive contexts and produce coherent, contextually rich, and logically consistent extended text. These demands highlight a critical gap in current LLM capabilities. We underscore the importance of this under-explored domain and call for focused efforts to develop foundational LLMs tailored for generating high-quality, long-form outputs, which hold immense potential for real-world applications.