Cite Before You Speak: Enhancing Context-Response Grounding in E-commerce Conversational LLM-Agents

作者: Jingying Zeng, Hui Liu, Zhenwei Dai, Xianfeng Tang, Chen Luo, Samarth Varshney, Zhen Li, Qi He

分类: cs.CL, cs.AI

发布日期: 2025-03-05 (更新: 2025-05-13)

💡 一句话要点

提出一种电商对话LLM-Agent的引用生成方法,提升事实 grounding 和用户信任度。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 电商对话Agent 大型语言模型 事实 grounding 引用生成 用户信任度

📋 核心要点

- 现有电商对话Agent存在生成幻觉信息和缺乏知识来源归属的问题,降低了用户信任度。

- 论文提出一种引用生成范式,使Agent在回复中提供知识来源,提升回答的准确性和可验证性。

- 实验表明,该方法显著提高了 grounding 性能(13.83%),并提升了用户参与度(3%-10%)。

📝 摘要(中文)

随着对话式大型语言模型(LLM)的进步,已经开发了几种基于LLM的对话式购物代理(CSA),以帮助客户顺利进行在线购物。构建引人入胜且值得信赖的CSA的首要目标是确保代理关于产品事实的回答准确且基于事实。然而,仍然存在两个挑战。首先,LLM会产生幻觉或无根据的主张。这种不准确性有传播错误信息的风险,并降低客户的信任度。其次,如果没有在CSA响应中提供知识来源归属,客户很难验证LLM生成的信息。为了应对这两个挑战,我们提出了一种易于生产的解决方案,为我们的客户提供“引用体验”。我们构建了自动评估指标,以全面评估LLM的 grounding 和归属能力,表明引用生成范式显着提高了 grounding 性能,提升了13.83%。为了大规模部署此功能,我们引入了Multi-UX-Inference系统,该系统将源引用附加到LLM输出,同时保留现有的用户体验功能并支持可扩展的推理。大规模在线A/B测试表明,基于 grounding 的CSA响应将客户参与度提高了3% - 10%,具体取决于UX的变化。

🔬 方法详解

问题定义:论文旨在解决电商对话Agent中LLM生成不准确或无根据信息的难题,以及缺乏知识来源归属导致用户难以验证信息的问题。现有方法无法有效保证回复的事实性和可信度,降低了用户体验和信任度。

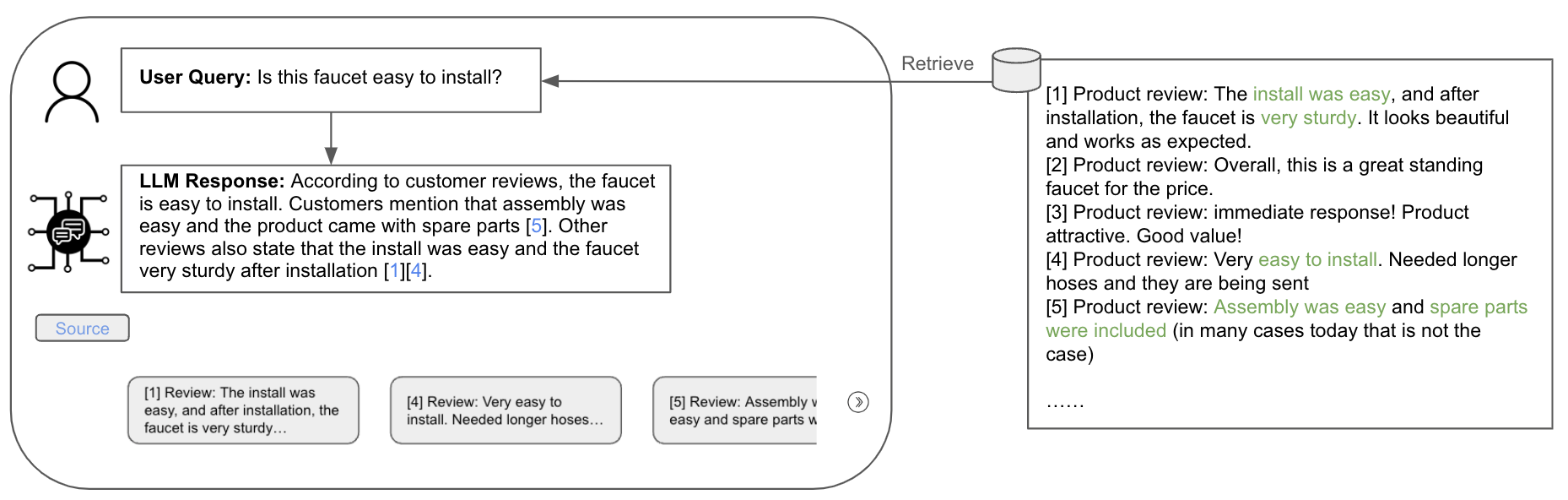

核心思路:核心思路是在LLM生成回复时,同时生成对知识来源的引用,类似于学术论文的引用方式。通过提供引用,用户可以追溯信息的来源,验证其真实性,从而提高对Agent的信任度。这种方法旨在弥合LLM生成能力与事实 grounding 之间的差距。

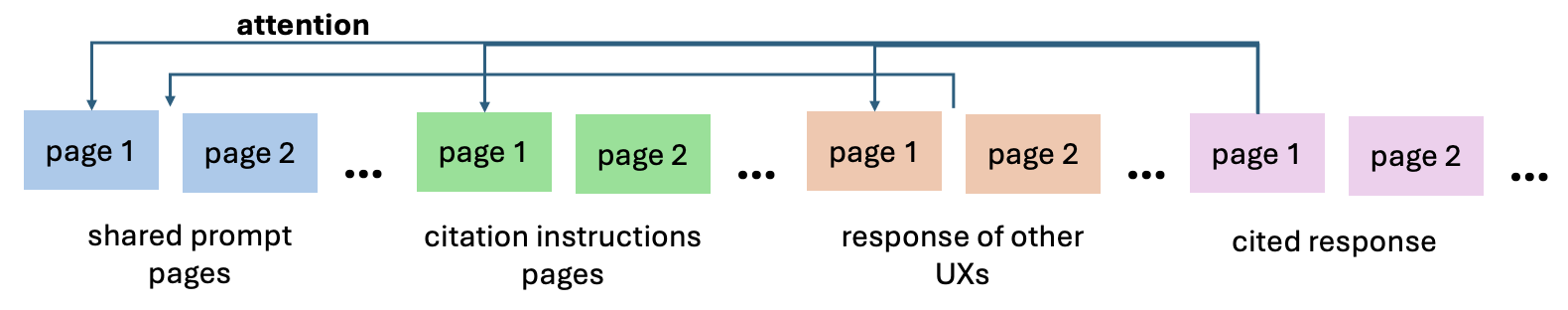

技术框架:论文提出了一个名为Multi-UX-Inference的系统,该系统将引用生成功能集成到现有的电商对话Agent中。该系统主要包含以下几个阶段:1) LLM生成回复;2) 引用生成模块根据回复内容检索相关知识源,并生成引用;3) 将引用附加到LLM的输出中,呈现给用户。该系统旨在在不影响现有用户体验的前提下,实现可扩展的引用生成。

关键创新:最重要的技术创新点在于引入了“引用生成”的概念,并将其应用于电商对话Agent中。与传统的生成式对话模型不同,该方法不仅生成回复,还生成对知识来源的引用,从而提高了回复的可信度和可验证性。此外,论文还提出了自动评估指标,用于评估LLM的 grounding 和归属能力。

关键设计:论文的关键设计包括:1) 引用生成模块的设计,需要选择合适的知识源检索方法和引用生成策略;2) Multi-UX-Inference系统的架构设计,需要在保证性能和可扩展性的前提下,将引用生成功能集成到现有系统中;3) 自动评估指标的设计,需要能够准确评估LLM的 grounding 和归属能力。具体的参数设置、损失函数、网络结构等技术细节在论文中可能未详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,引入引用生成范式后,LLM的 grounding 性能显著提高了13.83%。大规模在线A/B测试显示,基于 grounding 的CSA响应将客户参与度提高了3% - 10%,具体取决于UX的变化。这些数据表明,该方法在提升Agent的事实性和用户体验方面具有显著效果。

🎯 应用场景

该研究成果可广泛应用于电商对话机器人、智能客服等领域,提升用户对AI代理的信任度和满意度。通过提供可验证的信息来源,可以减少虚假信息的传播,提高在线购物的安全性。未来,该技术还可以扩展到其他需要事实 grounding 的对话场景,如新闻报道、教育辅导等。

📄 摘要(原文)

With the advancement of conversational large language models (LLMs), several LLM-based Conversational Shopping Agents (CSA) have been developed to help customers smooth their online shopping. The primary objective in building an engaging and trustworthy CSA is to ensure the agent's responses about product factoids are accurate and factually grounded. However, two challenges remain. First, LLMs produce hallucinated or unsupported claims. Such inaccuracies risk spreading misinformation and diminishing customer trust. Second, without providing knowledge source attribution in CSA response, customers struggle to verify LLM-generated information. To address both challenges, we present an easily productionized solution that enables a ''citation experience'' to our customers. We build auto-evaluation metrics to holistically evaluate LLM's grounding and attribution capabilities, suggesting that citation generation paradigm substantially improves grounding performance by 13.83%. To deploy this capability at scale, we introduce Multi-UX-Inference system, which appends source citations to LLM outputs while preserving existing user experience features and supporting scalable inference. Large-scale online A/B tests show that grounded CSA responses improves customer engagement by 3% - 10%, depending on UX variations.