Geometry-Guided Adversarial Prompt Detection via Curvature and Local Intrinsic Dimension

作者: Canaan Yung, Hanxun Huang, Christopher Leckie, Sarah Erfani

分类: cs.CL, cs.AI

发布日期: 2025-03-05 (更新: 2025-10-07)

备注: 40 Pages, 6 figues

💡 一句话要点

提出CurvaLID,利用几何特性高效检测大语言模型中的对抗性提示

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 对抗性提示检测 大语言模型安全 几何分析 曲率 局部内在维度 模型无关 文本嵌入

📋 核心要点

- 现有对抗提示防御方法计算成本高,且会牺牲模型效用,而检测方法更高效但缺乏对对抗提示与良性提示根本区别的理解。

- CurvaLID通过分析文本提示的几何特性,利用扩展的曲率概念和局部内在维度(LID)来区分对抗性提示和良性提示。

- 实验表明,对抗性提示具有独特的几何特征,CurvaLID能够实现近乎完美的分类,并在对抗性提示检测中优于现有方法。

📝 摘要(中文)

对抗性提示能够破解前沿大语言模型(LLM),诱导不良行为,对安全部署构成重大障碍。目前的缓解策略主要依赖于激活内置防御机制或微调LLM,这两种方法计算成本高昂,并且会牺牲模型效用。相比之下,基于检测的方法对于在实际应用中部署更为高效和实用。然而,对抗性提示和良性提示之间的根本区别仍然知之甚少。本文介绍了一种新颖的防御框架CurvaLID,它通过利用对抗性提示的几何特性来高效地检测它们。它与LLM的类型无关,为各种对抗性提示和LLM架构提供了一个统一的检测框架。CurvaLID建立在文本提示的几何分析基础上,以揭示其潜在差异。我们通过Whewell方程将曲率的概念在理论上扩展到$n$维词嵌入空间,从而能够量化局部几何属性,包括语义偏移和底层流形中的曲率。为了进一步增强我们的解决方案,我们利用局部内在维度(LID)来捕获对抗子空间内文本提示的互补几何特征。我们的研究结果表明,对抗性提示表现出与良性提示不同的几何特征,这使得CurvaLID能够实现近乎完美的分类,并在对抗性提示检测中优于最先进的检测器。CurvaLID作为一种模型无关的方法,为恶意查询提供了一种可靠且高效的保障,并且可以推广到多种LLM和攻击系列。

🔬 方法详解

问题定义:论文旨在解决大语言模型(LLM)中对抗性提示的检测问题。现有防御方法,如激活内置防御机制或微调LLM,存在计算成本高昂和牺牲模型效用的痛点。现有的检测方法对对抗性提示和良性提示的根本区别理解不足,导致检测效果不佳。

核心思路:论文的核心思路是利用对抗性提示和良性提示在几何特性上的差异进行检测。具体来说,通过将文本提示嵌入到高维空间,并分析其局部几何属性(如曲率和局部内在维度),来区分对抗性提示和良性提示。这种方法无需依赖特定的LLM架构或攻击方式,具有更强的通用性和效率。

技术框架:CurvaLID框架主要包含以下几个阶段:1) 文本嵌入:将文本提示转换为高维词嵌入向量。2) 几何特征提取:利用扩展的Whewell方程计算文本提示的曲率,并计算局部内在维度(LID)。3) 分类器训练:使用提取的几何特征训练分类器,区分对抗性提示和良性提示。4) 对抗提示检测:使用训练好的分类器检测新的文本提示是否为对抗性提示。

关键创新:论文最重要的技术创新点在于将几何分析引入对抗性提示检测。具体包括:1) 将Whewell方程扩展到n维词嵌入空间,用于量化文本提示的曲率。2) 利用局部内在维度(LID)捕获对抗子空间内文本提示的互补几何特征。与现有方法相比,CurvaLID不依赖于特定的LLM或攻击方式,具有更强的通用性和鲁棒性。

关键设计:论文的关键设计包括:1) 使用预训练的词嵌入模型(如Word2Vec、GloVe)将文本提示转换为高维向量。2) 使用k近邻算法计算局部内在维度(LID)。3) 使用支持向量机(SVM)或逻辑回归等分类器进行对抗性提示的分类。论文未提供具体的参数设置或损失函数细节,这部分信息未知。

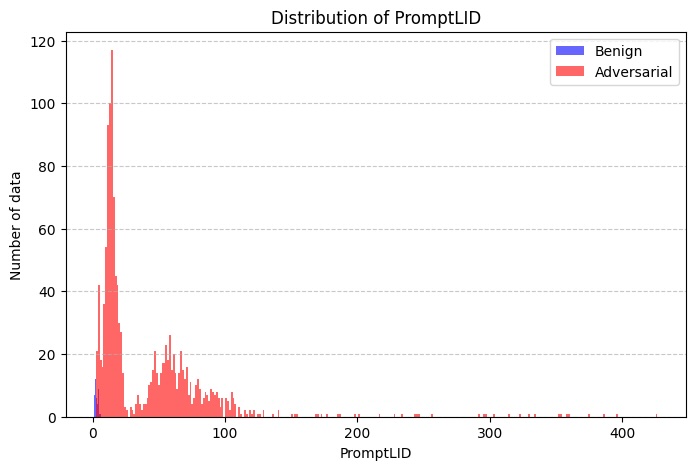

🖼️ 关键图片

📊 实验亮点

实验结果表明,CurvaLID在对抗性提示检测中取得了近乎完美的分类效果,显著优于现有的检测方法。具体性能数据和对比基线未知,但摘要中强调了其在多种LLM和攻击系列上的通用性。CurvaLID的优势在于其高效性和模型无关性,使其成为一种实用的对抗性提示防御方案。

🎯 应用场景

CurvaLID可应用于各种需要安全部署大语言模型的场景,例如智能客服、内容生成、代码生成等。它可以作为一种前置防御机制,有效过滤恶意查询,防止LLM被破解或诱导产生不良行为。该研究有助于提高LLM的安全性和可靠性,促进其在各行业的广泛应用。

📄 摘要(原文)

Adversarial prompts are capable of jailbreaking frontier large language models (LLMs) and inducing undesirable behaviours, posing a significant obstacle to their safe deployment. Current mitigation strategies primarily rely on activating built-in defence mechanisms or fine-tuning LLMs, both of which are computationally expensive and can sacrifice model utility. In contrast, detection-based approaches are more efficient and practical for deployment in real-world applications. However, the fundamental distinctions between adversarial and benign prompts remain poorly understood. In this work, we introduce CurvaLID, a novel defence framework that efficiently detects adversarial prompts by leveraging their geometric properties. It is agnostic to the type of LLM, offering a unified detection framework across diverse adversarial prompts and LLM architectures. CurvaLID builds on the geometric analysis of text prompts to uncover their underlying differences. We theoretically extend the concept of curvature via the Whewell equation into an $n$-dimensional word embedding space, enabling us to quantify local geometric properties, including semantic shifts and curvature in the underlying manifolds. To further enhance our solution, we leverage Local Intrinsic Dimensionality (LID) to capture complementary geometric features of text prompts within adversarial subspaces. Our findings show that adversarial prompts exhibit distinct geometric signatures from benign prompts, enabling CurvaLID to achieve near-perfect classification and outperform state-of-the-art detectors in adversarial prompt detection. CurvaLID provides a reliable and efficient safeguard against malicious queries as a model-agnostic method that generalises across multiple LLMs and attack families.