SEOE: A Scalable and Reliable Semantic Evaluation Framework for Open Domain Event Detection

作者: Yi-Fan Lu, Xian-Ling Mao, Tian Lan, Tong Zhang, Yu-Shi Zhu, Heyan Huang

分类: cs.CL

发布日期: 2025-03-05 (更新: 2025-05-23)

备注: Accepted by ACL 2025 Main Conference

💡 一句话要点

提出SEOE框架,通过语义评估和可扩展基准解决开放域事件检测的评估难题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 开放域事件检测 语义评估 评估基准 大型语言模型 自然语言处理

📋 核心要点

- 现有开放域事件检测评估基准覆盖范围有限,难以反映真实场景下方法的性能。

- SEOE框架构建了更具代表性的可扩展评估基准,并引入基于LLM的语义评估指标。

- 实验验证了SEOE基准的代表性和评估指标的可靠性,并深入分析了现有方法的错误模式。

📝 摘要(中文)

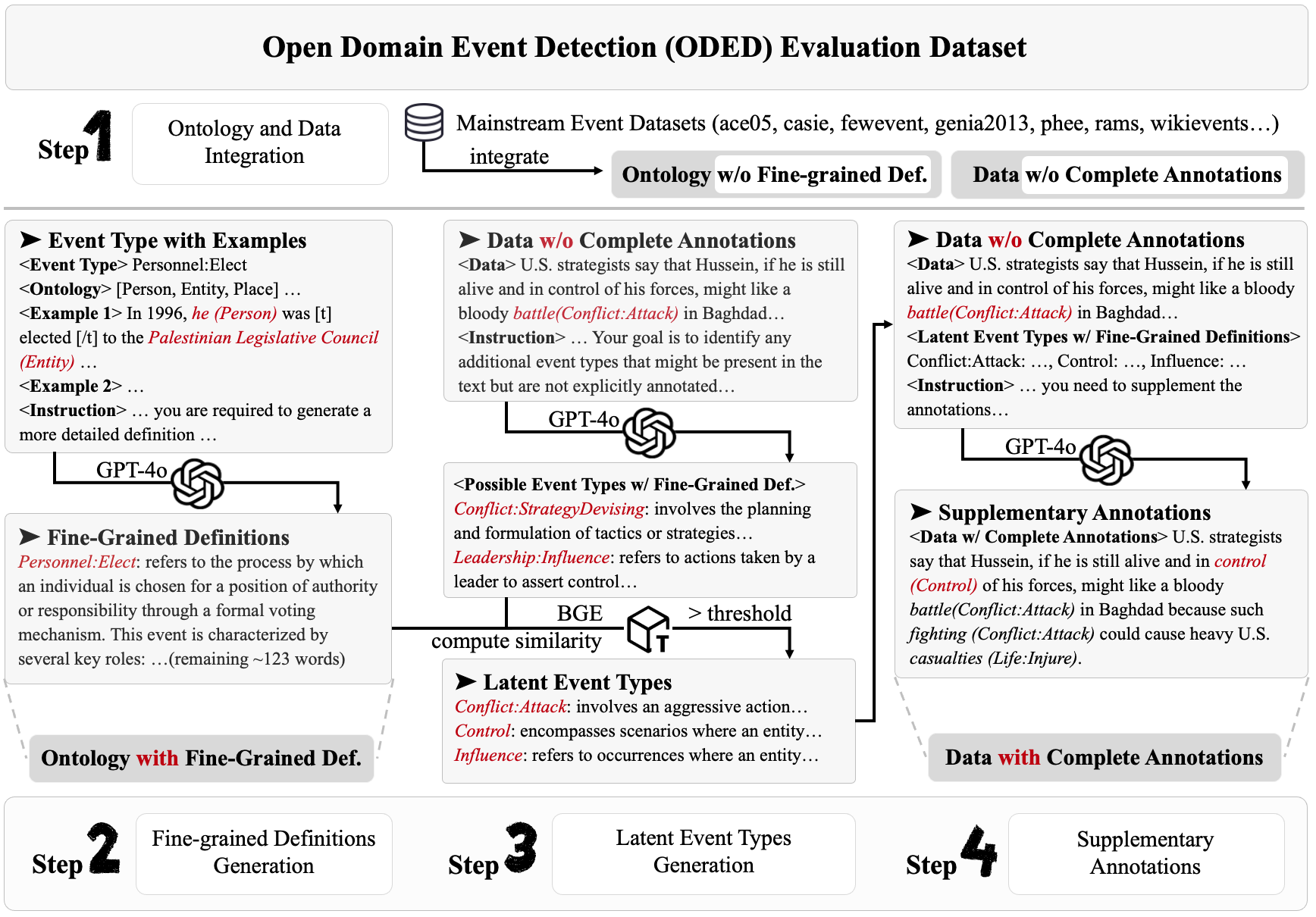

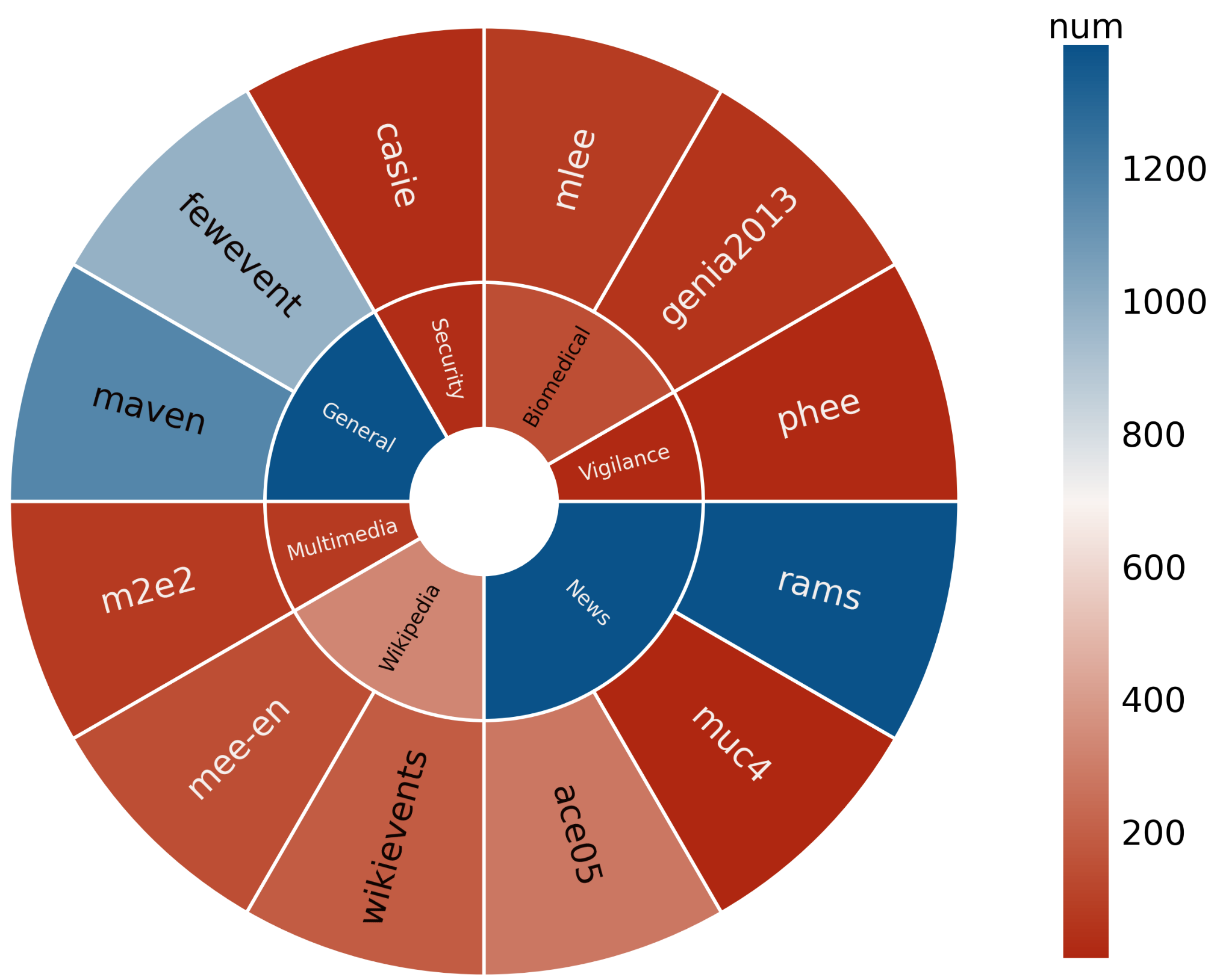

开放域事件检测(ODED)的自动评估极具挑战性,因为ODED的输出标签具有来自不同领域的巨大多样性。现有的ODED评估方法通常首先构建具有有限标签和领域覆盖范围的评估基准,然后使用基于token级标签匹配规则的指标来评估ODED方法。然而,这种评估框架面临两个问题:(1)有限的评估基准缺乏真实世界的代表性,难以准确反映各种ODED方法在真实场景中的性能;(2)基于token级匹配规则的评估指标无法捕捉预测和黄金标签之间的语义相似性。为了解决上述两个问题,我们提出了一种可扩展且可靠的开放域事件检测语义级评估框架(SEOE),通过构建更具代表性的评估基准并引入语义评估指标。具体来说,我们提出的框架首先构建一个可扩展的评估基准,目前包括涵盖7个主要领域的564个事件类型,并采用经济高效的补充注释策略来确保基准的代表性。该策略还允许将来补充新的事件类型和领域。然后,提出的SEOE利用大型语言模型(LLM)作为自动评估代理来计算语义F1分数,结合对语义相似标签的细粒度定义,以提高评估的可靠性。大量的实验验证了基准的代表性和语义评估指标的可靠性。对现有的ODED方法进行了全面的评估,并分析了预测的错误模式,揭示了一些有见地的发现。

🔬 方法详解

问题定义:开放域事件检测(ODED)的评估面临两大挑战:一是现有评估基准的代表性不足,无法准确反映模型在真实场景下的性能;二是现有评估指标主要基于token级别的匹配,忽略了预测结果与真实标签之间的语义相似性。这些问题导致评估结果与实际效果存在偏差,阻碍了ODED技术的发展。

核心思路:SEOE框架的核心思路是通过构建一个更具代表性的、可扩展的评估基准,并引入一种能够捕捉语义相似性的评估指标来解决上述问题。具体来说,该框架利用一种经济高效的补充标注策略来扩充基准,使其覆盖更广泛的事件类型和领域。同时,利用大型语言模型(LLM)作为自动评估代理,计算语义F1分数,从而更准确地评估模型的性能。

技术框架:SEOE框架主要包含两个核心模块:(1)可扩展的评估基准构建模块:该模块负责构建和维护一个包含大量事件类型和领域的评估基准。通过补充标注策略,可以不断扩充基准,提高其代表性。(2)基于LLM的语义评估模块:该模块利用LLM作为评估代理,计算预测结果与真实标签之间的语义相似度,并最终计算语义F1分数。该模块还包含对语义相似标签的细粒度定义,以提高评估的可靠性。

关键创新:SEOE框架的关键创新在于:(1)提出了一个可扩展的评估基准构建方法,能够以较低的成本构建一个更具代表性的评估基准;(2)引入了基于LLM的语义评估指标,能够更准确地评估ODED模型的性能,解决了传统token级别匹配方法的局限性。

关键设计:在评估基准构建方面,采用了经济高效的补充标注策略,具体细节未知。在语义评估方面,利用LLM计算语义相似度,并结合细粒度的语义相似标签定义,具体LLM的选择、prompt设计以及相似度计算方法未知。语义F1分数的计算方式也未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SEOE框架构建的评估基准具有良好的代表性,能够反映真实场景下ODED模型的性能。基于LLM的语义评估指标也表现出较高的可靠性,能够更准确地评估模型的性能。通过对现有ODED方法的评估,SEOE框架揭示了这些方法在处理复杂事件和语义相似事件方面的不足。

🎯 应用场景

SEOE框架可应用于开放域事件检测模型的评估和选择,帮助研究人员和开发者更准确地了解模型的性能,并选择更适合实际应用的模型。此外,该框架构建的评估基准可以作为ODED研究的标准数据集,促进该领域的发展。未来,该框架可以扩展到其他自然语言处理任务的评估中。

📄 摘要(原文)

Automatic evaluation for Open Domain Event Detection (ODED) is a highly challenging task, because ODED is characterized by a vast diversity of un-constrained output labels from various domains. Nearly all existing evaluation methods for ODED usually first construct evaluation benchmarks with limited labels and domain coverage, and then evaluate ODED methods using metrics based on token-level label matching rules. However, this kind of evaluation framework faces two issues: (1) The limited evaluation benchmarks lack representatives of the real world, making it difficult to accurately reflect the performance of various ODED methods in real-world scenarios; (2) Evaluation metrics based on token-level matching rules fail to capture semantic similarity between predictions and golden labels. To address these two problems above, we propose a scalable and reliable Semantic-level Evaluation framework for Open domain Event detection (SEOE) by constructing a more representative evaluation benchmark and introducing a semantic evaluation metric. Specifically, our proposed framework first constructs a scalable evaluation benchmark that currently includes 564 event types covering 7 major domains, with a cost-effective supplementary annotation strategy to ensure the benchmark's representativeness. The strategy also allows for the supplement of new event types and domains in the future. Then, the proposed SEOE leverages large language models (LLMs) as automatic evaluation agents to compute a semantic F1-score, incorporating fine-grained definitions of semantically similar labels to enhance the reliability of the evaluation. Extensive experiments validate the representatives of the benchmark and the reliability of the semantic evaluation metric. Existing ODED methods are thoroughly evaluated, and the error patterns of predictions are analyzed, revealing several insightful findings.