PromptCoT: Synthesizing Olympiad-level Problems for Mathematical Reasoning in Large Language Models

作者: Xueliang Zhao, Wei Wu, Jian Guan, Lingpeng Kong

分类: cs.CL, cs.AI, cs.LG

发布日期: 2025-03-04

备注: Preprint

期刊: Findings of the Association for Computational Linguistics: ACL 2025

DOI: 10.18653/v1/2025.findings-acl.935

🔗 代码/项目: GITHUB

💡 一句话要点

PromptCoT:合成奥林匹克级别数学题,提升大语言模型数学推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 数学推理 问题生成 奥林匹克数学 Prompt Engineering

📋 核心要点

- 现有大语言模型在解决复杂数学问题时面临高质量奥赛级别题目的稀缺性挑战,限制了其推理能力的进一步提升。

- PromptCoT方法通过模拟经验丰富的问题设计者的思维过程,基于数学概念和问题构建原理自动合成高质量奥赛级别数学题。

- 实验结果表明,PromptCoT在多个基准测试中优于现有方法,并展现出卓越的数据可扩展性,性能随数据集增大而稳定提升。

📝 摘要(中文)

大语言模型在解决复杂数学问题方面的能力取得了显著进展,尤其是在需要高级推理的任务中。然而,高质量难题,特别是奥林匹克级别的难题的稀缺,阻碍了进一步的发展。本文介绍了一种名为PromptCoT的新方法,用于自动生成高质量的奥林匹克级别数学题。该方法基于数学概念和问题构建背后的原理来合成复杂的问题,模拟经验丰富的问题设计者的思维过程。理论分析表明,最优的原理应该最大化给定相关概念的原理生成可能性,以及在原理和概念的条件下问题生成的可能性。在GSM8K、MATH-500和AIME2024等标准基准上的评估表明,PromptCoT始终优于现有的问题生成方法。此外,PromptCoT表现出卓越的数据可扩展性,随着数据集规模的增加,始终保持高性能,优于基线方法。代码已开源。

🔬 方法详解

问题定义:论文旨在解决大语言模型(LLM)在数学推理能力提升过程中,缺乏足够高质量、特别是奥林匹克级别数学题目的问题。现有问题生成方法难以模拟人类专家的问题设计过程,生成的题目质量不高,无法有效提升LLM的推理能力。

核心思路:PromptCoT的核心思路是模拟人类专家设计奥数题的思维过程,即首先确定相关的数学概念,然后构建解决问题的逻辑推理链(Rationale),最后基于概念和推理链生成问题。通过这种方式,确保生成的问题具有较高的难度和挑战性,能够有效考察LLM的数学推理能力。

技术框架:PromptCoT方法包含以下几个主要阶段:1) 概念选择:从预定义的数学概念库中选择相关的概念作为问题生成的基础。2) 原理生成:基于选定的概念,生成解决问题所需的逻辑推理链(Rationale)。这一步是模仿人类专家思考解题思路的过程。3) 问题生成:根据选定的概念和生成的推理链,生成最终的数学问题。4) 问题验证:对生成的问题进行验证,确保其难度和合理性。整个框架通过Prompt Engineering来指导LLM生成高质量的数学题。

关键创新:PromptCoT的关键创新在于其对问题生成过程的建模方式。它不是直接生成问题,而是先生成解决问题的逻辑推理链,然后再基于推理链生成问题。这种方式能够更好地控制生成问题的难度和质量,使其更接近人类专家设计的题目。此外,论文还提出了一个理论框架,用于指导推理链的生成,即最大化给定概念的推理链生成概率,以及在概念和推理链的条件下问题生成的概率。

关键设计:PromptCoT的关键设计包括:1) 使用Prompt Engineering来指导LLM生成推理链和问题。Prompt的设计需要充分考虑数学概念的特点和问题设计的原则。2) 定义了一个数学概念库,用于选择问题生成的基础概念。3) 采用了一种验证机制,用于评估生成问题的难度和合理性。4) 损失函数的设计目标是最大化P(Rationale|Concepts) * P(Problem|Rationale, Concepts),即同时优化推理链的生成和问题的生成。

🖼️ 关键图片

📊 实验亮点

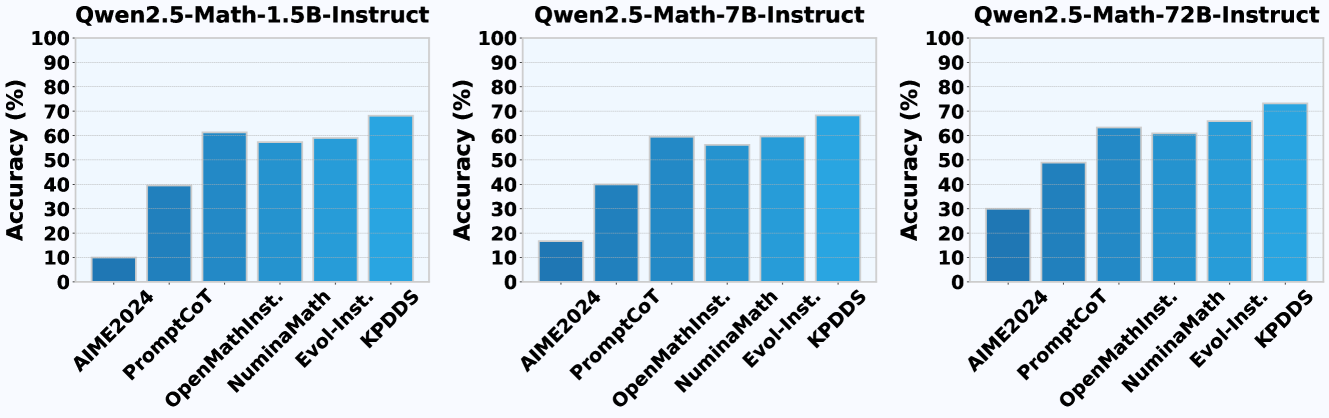

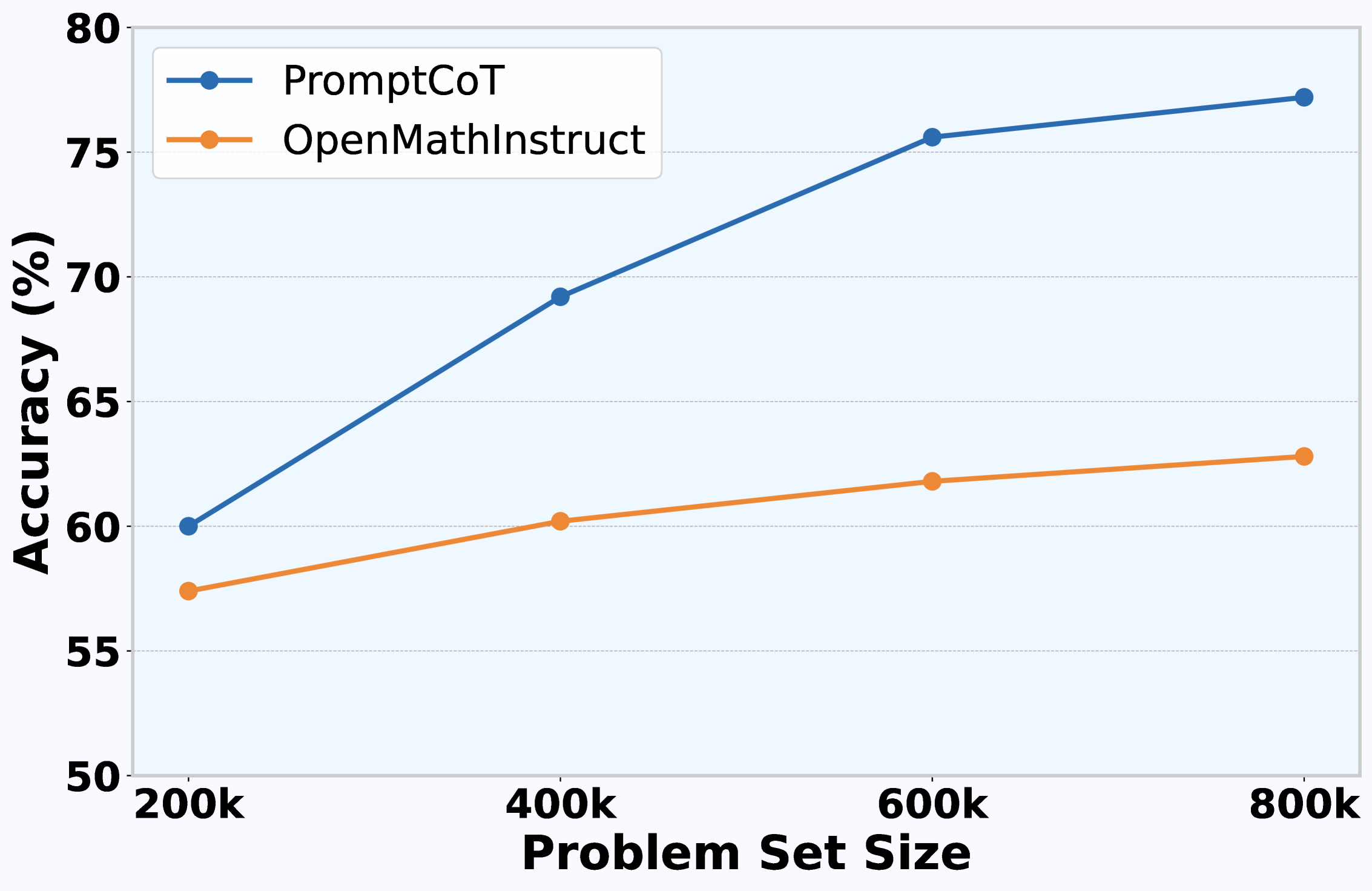

PromptCoT在GSM8K、MATH-500和AIME2024等标准基准测试中,始终优于现有的问题生成方法。实验结果表明,PromptCoT具有卓越的数据可扩展性,随着数据集规模的增加,其性能始终保持较高水平,显著优于基线方法。这表明PromptCoT能够有效地利用大规模数据来提升问题生成质量。

🎯 应用场景

PromptCoT方法生成的奥林匹克级别数学题可以用于训练和评估大语言模型的数学推理能力。此外,该方法还可以应用于数学教育领域,为学生提供高质量的练习题,帮助他们提高数学水平。未来,该方法可以扩展到其他领域,例如物理、化学等,生成各种类型的难题,促进人工智能在科学领域的应用。

📄 摘要(原文)

The ability of large language models to solve complex mathematical problems has progressed significantly, particularly for tasks requiring advanced reasoning. However, the scarcity of sufficiently challenging problems, particularly at the Olympiad level, hinders further advancements. In this work, we introduce PromptCoT, a novel approach for automatically generating high-quality Olympiad-level math problems. The proposed method synthesizes complex problems based on mathematical concepts and the rationale behind problem construction, emulating the thought processes of experienced problem designers. We provide a theoretical analysis demonstrating that an optimal rationale should maximize both the likelihood of rationale generation given the associated concepts and the likelihood of problem generation conditioned on both the rationale and the concepts. Our method is evaluated on standard benchmarks including GSM8K, MATH-500, and AIME2024, where it consistently outperforms existing problem generation methods. Furthermore, we demonstrate that PromptCoT exhibits superior data scalability, consistently maintaining high performance as the dataset size increases, outperforming the baselines. The implementation is available at https://github.com/zhaoxlpku/PromptCoT.