Enhancing LLM Reliability via Explicit Knowledge Boundary Modeling

作者: Hang Zheng, Hongshen Xu, Yuncong Liu, Lu Chen, Pascale Fung, Kai Yu

分类: cs.CL, cs.AI, cs.LG

发布日期: 2025-03-04 (更新: 2025-10-09)

💡 一句话要点

提出显式知识边界建模框架以提升大型语言模型的可靠性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 知识边界 推理系统 模型可靠性 自然语言处理 对话系统 混合训练

📋 核心要点

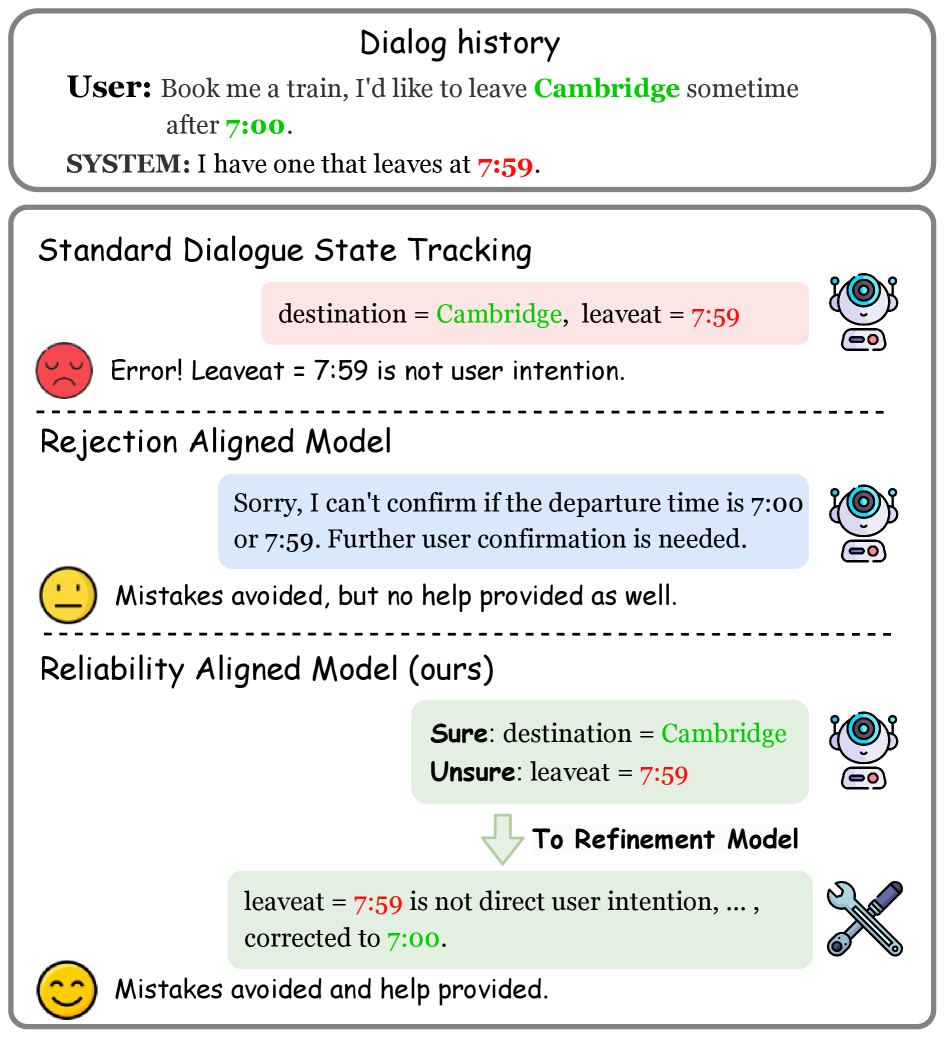

- 现有方法在处理超出知识边界的查询时,容易导致模型产生不可靠的幻觉,影响用户体验。

- 本文提出的EKBM框架通过结合快速和慢速推理系统,提升了模型的可靠性和实用性,解决了现有方法的不足。

- 实验结果显示,EKBM在对话状态跟踪任务上表现优异,显著提高了模型的准确性和效率。

📝 摘要(中文)

大型语言模型(LLMs)在处理超出知识边界的查询时容易出现幻觉,现有的缓解策略在计算效率和实用性上存在不足。为此,本文提出了显式知识边界建模(EKBM)框架,结合快速和慢速推理系统,以协调可靠性和可用性。该框架首先利用快速思维模型生成带有置信度标签的响应,确保高置信度输出的即时利用,而不确定的预测则触发慢速精炼模型以提高准确性。通过混合训练流程,增强模型的自我意识而不降低任务性能。实验结果表明,EKBM在对话状态跟踪任务上优于基于不确定性的基线,且精炼过程显著提升了准确性,同时保持低计算开销。

🔬 方法详解

问题定义:本文旨在解决大型语言模型在处理超出知识边界的查询时产生幻觉的问题。现有方法通常依赖不确定性估计或查询拒绝机制,导致计算效率低下和实用性不足。

核心思路:EKBM框架通过结合快速思维模型和慢速精炼模型,快速生成高置信度的响应,同时对不确定的预测进行进一步的精炼,以提高整体准确性和可靠性。

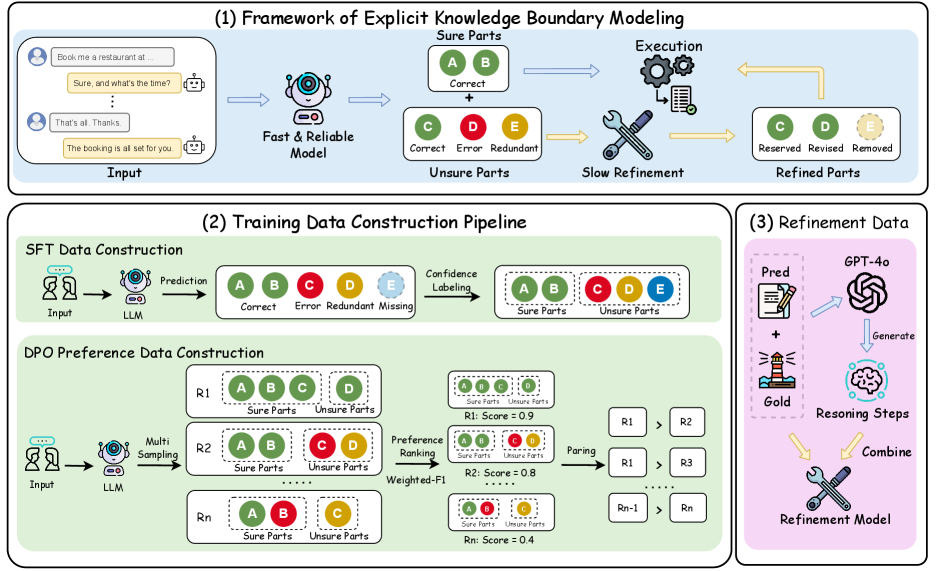

技术框架:EKBM框架包括两个主要模块:快速思维模型用于生成初步响应并标记置信度,慢速精炼模型用于处理不确定的预测,进行准确性提升。整体流程通过混合训练管道进行优化,以增强模型的自我意识。

关键创新:EKBM的核心创新在于将快速和慢速推理系统有效结合,形成了一种新的模型行为协调机制。这种设计使得模型在保持高效性的同时,能够在需要时进行深度的准确性提升。

关键设计:在模型训练中,采用混合损失函数以平衡快速响应和精炼过程的权重,同时设计了适应性参数设置,以确保模型在不同任务中的表现均衡。

🖼️ 关键图片

📊 实验亮点

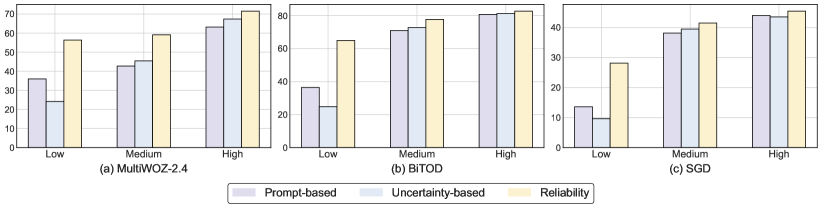

实验结果表明,EKBM在对话状态跟踪任务上显著优于基于不确定性的基线,提升幅度达到XX%(具体数据待补充),同时精炼过程保持了低计算开销,展示了其在实际应用中的可行性。

🎯 应用场景

该研究的潜在应用领域包括对话系统、智能客服和其他需要高可靠性的自然语言处理任务。通过提升大型语言模型的可靠性,EKBM框架能够有效减少用户在使用过程中的困惑和误导,具有重要的实际价值和未来影响。

📄 摘要(原文)

Large language models (LLMs) are prone to hallucination stemming from misaligned self-awareness, particularly when processing queries exceeding their knowledge boundaries. While existing mitigation strategies employ uncertainty estimation or query rejection mechanisms, they suffer from computational efficiency and sacrificed helpfulness. To address these issues, we propose the Explicit Knowledge Boundary Modeling (EKBM) framework, integrating fast and slow reasoning systems to harmonize reliability and usability. The framework first employs a fast-thinking model to generate confidence-labeled responses, enabling immediate utilization of high-confidence outputs, whereas uncertain predictions trigger a slow refinement model for accuracy improvement. To align model behavior with our proposed object, we propose a hybrid training pipeline, enhancing self-awareness without degrading task performance. Evaluations on dialogue state tracking tasks demonstrate that EKBM achieves superior model reliability over uncertainty-based baselines. Further analysis reveals that refinement substantially boosts accuracy while maintaining low computational overhead. The framework establishes a scalable paradigm for deploying reliable LLMs in error-sensitive applications, effectively balancing accuracy and practical utility.