Mind the (Belief) Gap: Group Identity in the World of LLMs

作者: Angana Borah, Marwa Houalla, Rada Mihalcea

分类: cs.CL, cs.AI

发布日期: 2025-03-03 (更新: 2025-10-07)

备注: Accepted to ACL 2025 (Findings)

💡 一句话要点

研究LLM中的群体认同偏差,提出干预策略以减少信息误传并提升学习效果

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 信念一致性 社会偏见 多智能体系统 信息传播 机器学习 社会心理学 偏差缓解

📋 核心要点

- 现有LLM在多智能体系统中模拟社会互动时,未能充分考虑和建模群体心理学中的信念一致性。

- 论文构建多智能体框架,模拟信念一致性,并分析其对LLM行为的影响,尤其是在信息传播和学习方面。

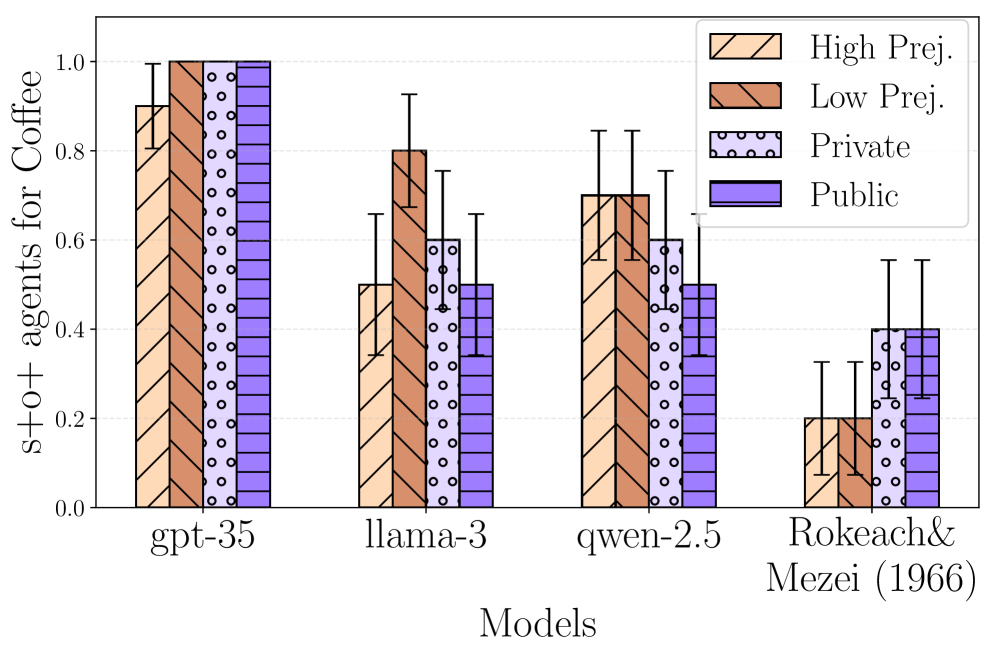

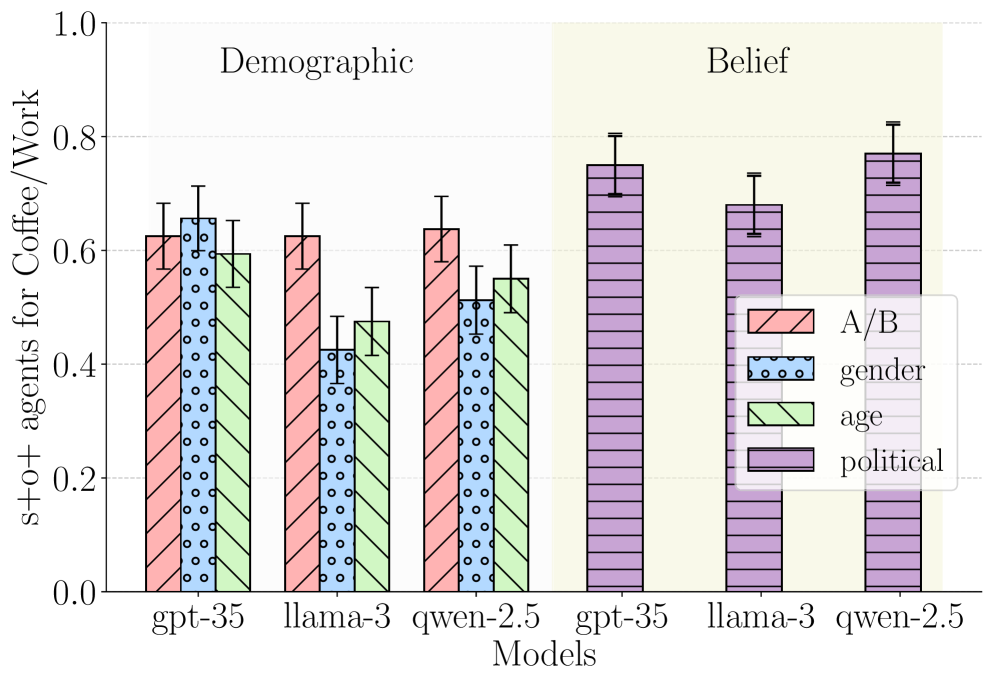

- 实验表明LLM表现出比人类更强的信念一致性,且该特性会加剧信息误传并阻碍学习,论文提出了有效的干预策略。

📝 摘要(中文)

社会偏见和信念驱动的行为会显著影响大型语言模型(LLM)在各种任务中的决策。随着LLM越来越多地应用于社会模拟的多智能体系统中,它们对群体心理特征建模的能力至关重要,但尚未得到充分探索。本研究提出了一个多智能体框架,模拟信念一致性——一种在塑造社会互动和偏好方面起关键作用的经典群体心理学理论。研究结果表明,LLM在不同背景下表现出比人类更强的信念一致性。我们进一步研究了这种行为对两个下游任务的影响:(1) 错误信息传播和 (2) LLM学习,发现LLM中的信念一致性会增加错误信息传播并阻碍学习。为了减轻这些负面影响,我们提出了受以下因素启发的策略:(1) 接触假设,(2) 准确性推动,以及(3) 全球公民框架。结果表明,最佳策略可将错误信息传播减少高达37%,并将学习效果提高11%。我们的工作连接了社会心理学和人工智能,为使用LLM进行现实世界互动提供了见解,同时解决了信念驱动的偏见。

🔬 方法详解

问题定义:论文旨在解决LLM在模拟社会互动时,由于信念一致性偏差而导致的不准确性问题。现有方法未能充分考虑LLM中存在的这种偏差,导致其在信息传播和学习等任务中表现不佳。具体来说,LLM可能放大群体内的共识,从而加剧错误信息的传播,并对新知识的接受度产生负面影响。

核心思路:论文的核心思路是首先量化LLM中的信念一致性偏差,然后通过引入社会心理学中的干预策略来缓解这种偏差。通过模拟多智能体环境,研究人员可以观察LLM在不同情境下的行为,并评估干预措施的有效性。这种方法旨在使LLM的行为更接近人类,从而提高其在社会模拟中的可靠性。

技术框架:该研究采用多智能体框架,其中每个智能体由一个LLM驱动。框架包含以下主要模块:1) 信念初始化:为每个智能体分配初始信念;2) 互动模拟:智能体之间进行互动,例如信息共享和观点交流;3) 信念更新:根据互动结果更新智能体的信念;4) 任务评估:评估LLM在下游任务(如信息传播和学习)中的表现;5) 干预策略:应用干预策略以减少信念一致性偏差。

关键创新:该研究的关键创新在于将社会心理学理论(如接触假设、准确性推动和全球公民框架)应用于LLM的偏差缓解。与传统的技术方法不同,这些策略侧重于改变LLM的认知过程,使其更加开放和理性。此外,该研究还提供了一种量化LLM信念一致性的方法,为后续研究提供了基础。

关键设计:在实验设计方面,研究人员使用了不同的LLM模型,并针对不同的下游任务设计了特定的评估指标。例如,在信息传播任务中,他们测量了错误信息的传播范围和速度。在学习任务中,他们评估了LLM对新知识的掌握程度。干预策略的具体实施包括:1) 接触假设:让LLM与持有不同信念的智能体进行互动;2) 准确性推动:向LLM提供关于信息准确性的反馈;3) 全球公民框架:引导LLM考虑更广泛的社会利益。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLM表现出比人类更强的信念一致性。通过应用接触假设、准确性推动和全球公民框架等干预策略,可以将错误信息传播减少高达37%,并将LLM的学习效果提高11%。这些结果表明,社会心理学理论可以有效地缓解LLM中的偏差,并提高其在社会模拟和下游任务中的表现。

🎯 应用场景

该研究成果可应用于多个领域,包括:社会行为模拟、舆情分析、在线教育和人机协作。通过减少LLM中的信念一致性偏差,可以提高其在这些应用中的可靠性和公正性。例如,在舆情分析中,可以避免LLM放大特定群体的观点,从而更准确地反映社会整体的意见。在在线教育中,可以帮助LLM更好地适应不同学生的学习风格和需求。

📄 摘要(原文)

Social biases and belief-driven behaviors can significantly impact Large Language Models (LLMs) decisions on several tasks. As LLMs are increasingly used in multi-agent systems for societal simulations, their ability to model fundamental group psychological characteristics remains critical yet under-explored. In this study, we present a multi-agent framework that simulates belief congruence, a classical group psychology theory that plays a crucial role in shaping societal interactions and preferences. Our findings reveal that LLMs exhibit amplified belief congruence compared to humans, across diverse contexts. We further investigate the implications of this behavior on two downstream tasks: (1) misinformation dissemination and (2) LLM learning, finding that belief congruence in LLMs increases misinformation dissemination and impedes learning. To mitigate these negative impacts, we propose strategies inspired by: (1) contact hypothesis, (2) accuracy nudges, and (3) global citizenship framework. Our results show that the best strategies reduce misinformation dissemination by up to 37% and enhance learning by 11%. Bridging social psychology and AI, our work provides insights to navigate real-world interactions using LLMs while addressing belief-driven biases.