HoT: Highlighted Chain of Thought for Referencing Supporting Facts from Inputs

作者: Tin Nguyen, Logan Bolton, Mohammad Reza Taesiri, Trung Bui, Anh Totti Nguyen

分类: cs.CL, cs.HC

发布日期: 2025-03-03 (更新: 2025-09-24)

💡 一句话要点

提出高亮思维链(HoT)提示方法,提升LLM事实依据追溯能力并辅助人工验证。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 思维链 提示学习 事实依据 可解释性

📋 核心要点

- LLM容易产生幻觉,输出不实信息,混合事实与虚构的回应难以验证。

- HoT通过XML标签高亮显示LLM回应中引用的输入事实,增强可追溯性。

- 实验表明,HoT在多种任务上优于CoT,并能辅助人类更快识别LLM的正确答案。

📝 摘要(中文)

大型语言模型(LLM)的一个致命弱点是它们容易产生不符合事实的陈述。如果一个回应混合了事实性和非事实性的陈述,人类很难验证并在此基础上做出准确的决策。为了解决这个问题,我们提出了一种名为高亮思维链提示(HoT)的技术,该技术通过提示LLM生成带有XML标签的回应,将事实依据与查询中提供的信息相关联。也就是说,给定一个输入问题,LLM首先会重新格式化问题,添加XML标签来高亮显示关键事实,然后生成一个回应,并在回应中高亮显示从输入中引用的事实。有趣的是,在少样本设置中,HoT在算术、阅读理解和逻辑推理等17个任务中优于原始的思维链提示(CoT)。当要求人类验证LLM的回应时,高亮显示有助于时间有限的参与者更准确、更有效地识别LLM何时正确。然而,令人惊讶的是,当LLM出错时,HoT往往会让用户相信答案是正确的。

🔬 方法详解

问题定义:大型语言模型(LLM)在生成文本时,容易出现“幻觉”现象,即生成与事实不符的内容。现有的思维链(Chain-of-Thought, CoT)提示方法虽然能提升LLM的推理能力,但无法保证生成内容的真实性,且人工验证LLM生成内容的事实依据非常耗时。

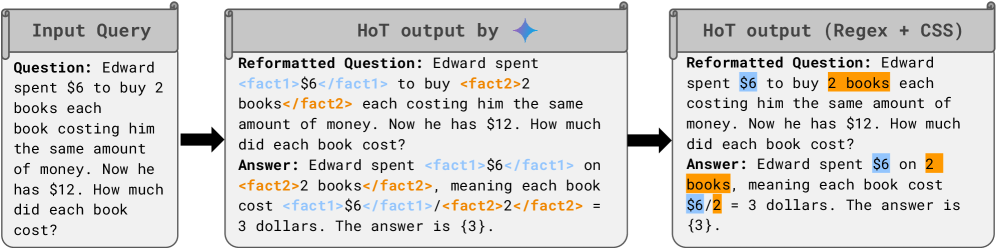

核心思路:论文的核心思路是让LLM在生成答案的同时,通过XML标签高亮显示答案中引用的输入信息。这样,用户可以快速定位LLM生成答案的事实依据,从而更容易判断答案的正确性。这种方法旨在提高LLM生成内容的可信度和可验证性。

技术框架:HoT prompting 的整体流程如下:1. 输入问题重构:将原始问题进行重构,在问题中关键的事实信息周围添加XML标签进行高亮。2. LLM生成答案:使用重构后的问题作为提示,让LLM生成答案,并在答案中用XML标签高亮显示引用的输入信息。3. 人工验证:用户通过查看高亮显示的事实依据,验证LLM生成答案的正确性。

关键创新:HoT prompting 的关键创新在于将事实依据追溯与答案生成过程相结合,通过XML标签显式地标注LLM生成答案所依赖的输入信息。这种方法使得LLM的推理过程更加透明,方便用户进行验证。与传统的CoT方法相比,HoT不仅关注推理过程,更关注推理结果的事实依据。

关键设计:论文的关键设计在于XML标签的使用。通过在输入问题和LLM生成答案中使用XML标签,可以清晰地标注出事实依据。具体的标签形式未知,但其目的是为了方便机器和人识别。此外,论文在少样本学习(few-shot learning)的设置下进行实验,这意味着HoT prompting 需要精心设计的示例来引导LLM生成带有XML标签的答案。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在少样本设置下,HoT prompting 在17个涵盖算术、阅读理解和逻辑推理的任务中,性能优于传统的CoT prompting。此外,当人工验证LLM的回答时,HoT prompting 可以显著提升验证效率。但值得注意的是,当LLM给出错误答案时,HoT prompting 可能会误导用户,使其相信答案是正确的。

🎯 应用场景

HoT prompting 可应用于需要高可信度和可验证性的场景,例如:金融分析报告生成、医疗诊断辅助、法律文件撰写等。通过高亮显示事实依据,可以帮助专业人士快速验证LLM生成内容的准确性,降低决策风险。未来,HoT prompting 有望成为提升LLM在各行业应用可靠性的重要技术手段。

📄 摘要(原文)

An Achilles heel of Large Language Models (LLMs) is their tendency to hallucinate non-factual statements. A response mixed of factual and non-factual statements poses a challenge for humans to verify and accurately base their decisions on. To combat this problem, we propose Highlighted Chain-of-Thought Prompting (HoT), a technique for prompting LLMs to generate responses with XML tags that ground facts to those provided in the query. That is, given an input question, LLMs would first re-format the question to add XML tags highlighting key facts, and then, generate a response with highlights over the facts referenced from the input. Interestingly, in few-shot settings, HoT outperforms vanilla chain of thought prompting (CoT) on a wide range of 17 tasks from arithmetic, reading comprehension to logical reasoning. When asking humans to verify LLM responses, highlights help time-limited participants to more accurately and efficiently recognize when LLMs are correct. Yet, surprisingly, when LLMs are wrong, HoTs tend to make users believe that an answer is correct.