Winning Big with Small Models: Knowledge Distillation vs. Self-Training for Reducing Hallucination in Product QA Agents

作者: Ashley Lewis, Michael White, Jing Liu, Toshiaki Koike-Akino, Kieran Parsons, Ye Wang

分类: cs.CL, cs.AI, cs.LG

发布日期: 2025-02-26 (更新: 2025-07-21)

💡 一句话要点

利用小模型制胜:知识蒸馏与自训练降低产品问答Agent的幻觉

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 知识蒸馏 自训练 幻觉减少 问答系统 合成数据 小模型 检索增强 客户支持

📋 核心要点

- 现有大型语言模型在客户支持应用中存在幻觉问题,且专有模型成本高昂,限制了其广泛应用。

- 论文提出一种检索增强的问答流程,利用LLM生成合成数据,并探索自训练和知识蒸馏方法。

- 实验表明,使用合成数据和自训练的开源小模型,在降低幻觉方面可与知识蒸馏媲美,且更具成本效益。

📝 摘要(中文)

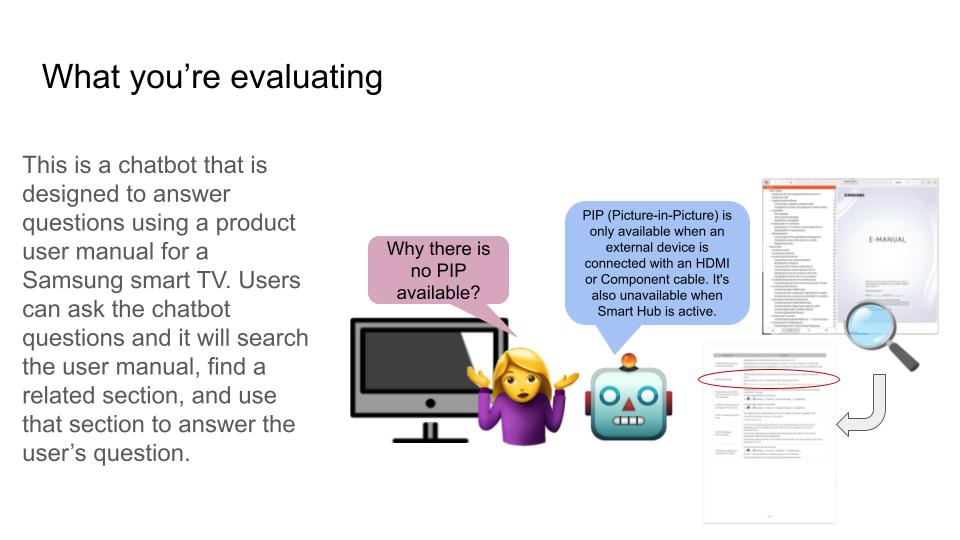

大型语言模型(LLM)在客户支持中的部署受到幻觉(生成虚假信息)和专有模型高成本的限制。为了应对这些挑战,我们提出了一种检索增强的问答(QA)流程,并探讨如何平衡人工输入和自动化。通过使用关于三星智能电视用户手册的问题数据集,我们证明了由LLM生成的合成数据在减少微调模型中的幻觉方面优于众包数据。我们还比较了自训练(在模型自身的输出上微调模型)和知识蒸馏(在更强大的模型的输出上微调,例如GPT-4o),发现自训练实现了相当的幻觉减少。我们推测,这一令人惊讶的发现可归因于知识蒸馏案例中暴露偏差问题的增加,并通过事后分析支持这一推测。我们还通过情境化的“我不知道”响应提高了对无法回答的问题和检索失败的鲁棒性。这些发现表明,可以使用合成数据和开源模型的自训练来构建可扩展、经济高效的QA系统,从而减少对专有工具或昂贵的人工注释的依赖。

🔬 方法详解

问题定义:论文旨在解决在产品问答Agent中使用大型语言模型时出现的幻觉问题,即模型生成不真实或与知识库不符的信息。现有方法依赖于昂贵的人工标注数据或专有的大型模型,成本高且难以扩展。

核心思路:论文的核心思路是利用大型语言模型生成合成数据,并结合自训练的方法,训练小模型,使其在降低幻觉的同时,保持较高的问答准确率。通过这种方式,降低对昂贵的人工标注数据和专有模型的依赖。

技术框架:整体框架是一个检索增强的问答(QA)流程。首先,用户提出问题;然后,系统从知识库中检索相关文档;接着,将问题和检索到的文档输入到微调后的模型中,生成答案。模型训练阶段,使用LLM生成合成数据,并分别采用自训练和知识蒸馏两种方法进行微调。

关键创新:论文的关键创新在于发现自训练在降低幻觉方面可以与知识蒸馏相媲美,甚至在某些情况下表现更好。这挑战了传统的认知,即知识蒸馏通常优于自训练。论文还通过分析指出,知识蒸馏可能存在更严重的暴露偏差问题。

关键设计:论文的关键设计包括:1) 使用LLM生成高质量的合成数据,用于模型的预训练和微调;2) 比较自训练和知识蒸馏两种方法,并分析其优缺点;3) 引入情境化的“我不知道”响应,提高模型对无法回答问题的鲁棒性;4) 采用检索增强的方法,从知识库中检索相关信息,减少模型生成幻觉的可能性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用LLM生成的合成数据在减少幻觉方面优于众包数据。更令人惊讶的是,自训练在降低幻觉方面可以与知识蒸馏相媲美,这表明在某些情况下,自训练可能更适合于训练小模型。此外,论文还通过引入情境化的“我不知道”响应,提高了模型对无法回答问题的鲁棒性。

🎯 应用场景

该研究成果可应用于各种客户支持场景,例如智能客服、产品问答机器人等。通过使用开源小模型和合成数据,可以降低部署成本,提高系统的可扩展性,并减少对昂贵的人工标注数据和专有模型的依赖。该方法还有助于提高问答系统的可靠性和准确性,减少幻觉现象,提升用户体验。

📄 摘要(原文)

The deployment of Large Language Models (LLMs) in customer support is constrained by hallucination (generating false information) and the high cost of proprietary models. To address these challenges, we propose a retrieval-augmented question-answering (QA) pipeline and explore how to balance human input and automation. Using a dataset of questions about a Samsung Smart TV user manual, we demonstrate that synthetic data generated by LLMs outperforms crowdsourced data in reducing hallucination in finetuned models. We also compare self-training (fine-tuning models on their own outputs) and knowledge distillation (fine-tuning on stronger models' outputs, e.g., GPT-4o), and find that self-training achieves comparable hallucination reduction. We conjecture that this surprising finding can be attributed to increased exposure bias issues in the knowledge distillation case and support this conjecture with post hoc analysis. We also improve robustness to unanswerable questions and retrieval failures with contextualized "I don't know" responses. These findings show that scalable, cost-efficient QA systems can be built using synthetic data and self-training with open-source models, reducing reliance on proprietary tools or costly human annotations.