Chain of Draft: Thinking Faster by Writing Less

作者: Silei Xu, Wenhao Xie, Lingxiao Zhao, Pengcheng He

分类: cs.CL

发布日期: 2025-02-25 (更新: 2025-03-03)

🔗 代码/项目: GITHUB

💡 一句话要点

提出Chain of Draft,通过精简中间推理步骤提升LLM效率。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 思维链 推理效率 提示学习 认知模拟

📋 核心要点

- 现有思维链(CoT)方法在复杂推理任务中表现出色,但其冗长的推理过程导致高昂的计算成本和延迟。

- Chain of Draft (CoD) 模仿人类认知,通过生成简洁的中间推理草稿,提取关键信息,从而提高效率。

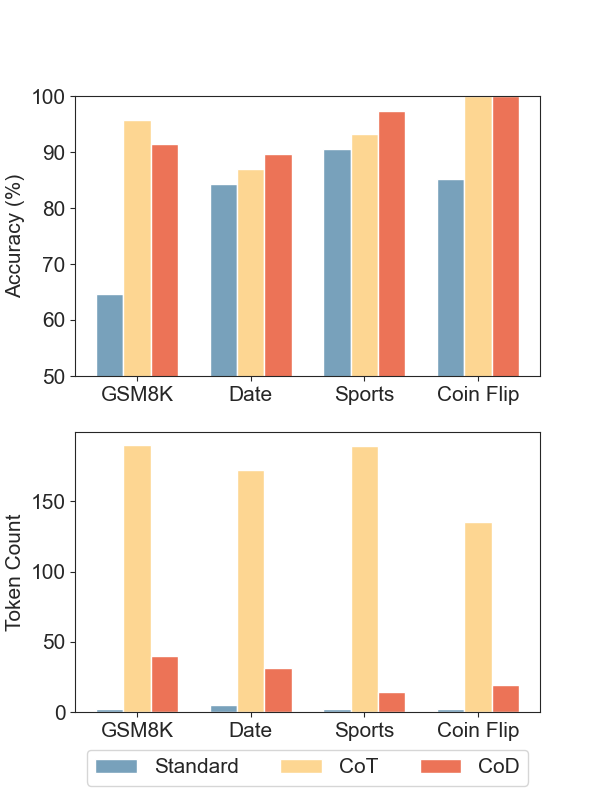

- 实验结果表明,CoD在保持或超过CoT准确性的同时,显著减少了token使用量,降低了成本和延迟。

📝 摘要(中文)

大型语言模型(LLMs)通过诸如思维链(CoT)提示等机制,在解决复杂的推理任务中表现出了卓越的性能,这些机制强调冗长的、逐步的推理过程。然而,人类通常采用更有效的策略:起草简洁的中间思想,仅捕捉必要的信息。在这项工作中,我们提出了一种受人类认知过程启发的新范式——Chain of Draft(CoD),其中LLMs在解决任务时生成最小化但信息丰富的中间推理输出。通过减少冗余并专注于关键见解,CoD在准确性方面与CoT相匹配或超过CoT,同时仅使用7.6%的token,从而显著降低了各种推理任务的成本和延迟。我们的代码和数据可在https://github.com/sileix/chain-of-draft 获取。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在复杂推理任务中使用思维链(CoT)方法时,由于推理过程冗长而导致的高计算成本和高延迟问题。现有CoT方法虽然能够提升推理性能,但其逐字逐句的推理方式效率低下,未能模拟人类在解决问题时提炼关键信息的认知过程。

核心思路:论文的核心思路是模仿人类在解决复杂问题时,先快速起草简洁的中间步骤,提取关键信息,然后再进行详细推理的过程。通过让LLM生成最小化但信息丰富的中间“草稿”,减少冗余信息,从而提高推理效率。

技术框架:Chain of Draft (CoD) 的整体流程可以概括为:首先,LLM接收到问题输入;然后,LLM生成一系列简洁的中间推理“草稿”,每个草稿都专注于提取关键信息;最后,LLM基于这些草稿生成最终答案。整个过程通过精心设计的prompting策略引导LLM生成高质量的草稿。

关键创新:CoD的关键创新在于其模仿人类认知过程,将冗长的逐步推理过程替换为简洁的草稿式推理。与CoT方法相比,CoD更注重提取关键信息,减少不必要的细节,从而显著降低了token使用量。

关键设计:CoD的关键设计在于prompt的设计,prompt需要引导LLM生成既简洁又信息丰富的草稿。具体的prompt设计可能包括:明确指示LLM生成草稿而非详细解释;提供草稿长度的限制;以及提供一些示例草稿供LLM参考。论文可能还涉及对不同草稿生成策略的探索,例如迭代式草稿生成,即先生成一个粗略的草稿,然后逐步细化。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Chain of Draft (CoD) 在多个推理任务上取得了显著的性能提升。例如,在某些任务上,CoD在保持与CoT相当甚至更高准确率的同时,仅使用了CoT 7.6% 的token。这表明CoD能够显著降低计算成本和延迟,使得LLM在资源受限的环境中也能高效运行。具体的实验结果和对比基线可以在论文的实验部分找到。

🎯 应用场景

Chain of Draft (CoD) 方法具有广泛的应用前景,可以应用于各种需要复杂推理的场景,例如数学问题求解、常识推理、代码生成等。通过降低LLM的计算成本和延迟,CoD使得LLM能够更高效地服务于实际应用,例如智能客服、自动化报告生成、智能决策支持等。未来,CoD还可以与其他技术相结合,例如知识图谱、强化学习等,进一步提升LLM的推理能力和效率。

📄 摘要(原文)

Large Language Models (LLMs) have demonstrated remarkable performance in solving complex reasoning tasks through mechanisms like Chain-of-Thought (CoT) prompting, which emphasizes verbose, step-by-step reasoning. However, humans typically employ a more efficient strategy: drafting concise intermediate thoughts that capture only essential information. In this work, we propose Chain of Draft (CoD), a novel paradigm inspired by human cognitive processes, where LLMs generate minimalistic yet informative intermediate reasoning outputs while solving tasks. By reducing verbosity and focusing on critical insights, CoD matches or surpasses CoT in accuracy while using as little as only 7.6% of the tokens, significantly reducing cost and latency across various reasoning tasks. Our code and data are available at https://github.com/sileix/chain-of-draft.